Steering Vector Fields for Context-Aware Inference-Time Control in Large Language Models

作者: Jiaqian Li, Yanshu Li, Kuan-Hao Huang

分类: cs.CL

发布日期: 2026-02-02

💡 一句话要点

提出Steering Vector Fields,解决大语言模型推理时控制向量的不可靠性问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 推理时控制 Steering Vector 上下文相关 可微评分函数

📋 核心要点

- 现有steering vectors方法在控制大语言模型时,由于忽略了上下文信息,导致控制效果不稳定,甚至适得其反。

- 论文提出Steering Vector Fields (SVF),通过学习可微的概念评分函数,利用局部梯度动态调整steering方向,实现上下文相关的控制。

- 实验表明,SVF在多个LLM和steering任务中,相比静态steering vectors,实现了更强大和更可靠的控制效果。

📝 摘要(中文)

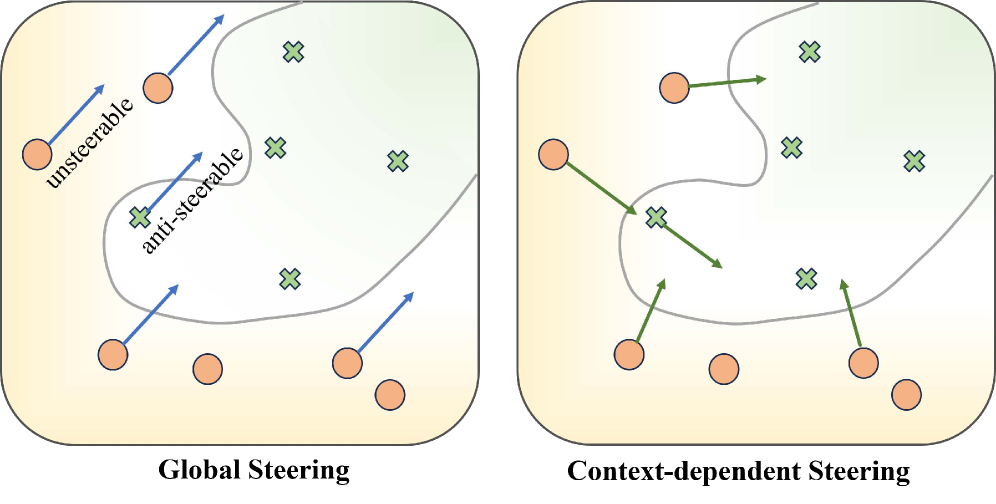

Steering vectors (SVs) 提供了一种轻量级的方式,通过改变隐藏层激活来在推理时控制大型语言模型 (LLMs),它介于提示工程和微调之间。然而,SVs 在实践中可能不可靠。某些概念是不可控的,即使 steering 在平均意义上有帮助,也可能对相当一部分输入产生反作用。在长文本生成和多属性 steering 中,可靠性也会降低。本文从几何角度看待这些失败。静态 SV 在表征空间中的每个位置应用相同的更新向量,隐式地假设概念改进的方向在不同上下文中是恒定的。当局部有效方向随当前激活而变化时,单个全局向量可能会错位,从而产生微弱或相反的效果。基于此,本文提出了 Steering Vector Fields (SVF),它学习一个可微的概念评分函数,其局部梯度定义了每个激活处的 steering 方向,从而使干预显式地依赖于上下文。这种公式支持在共享的、对齐的概念空间中进行协调的多层干预,并能够在统一的框架内实现高效的长文本和多属性控制。在多个 LLM 和 steering 任务中,SVF 提供了更强大、更可靠的控制,提高了推理时 steering 的实用性。

🔬 方法详解

问题定义:现有steering vectors方法在推理时控制大语言模型时,采用静态的steering vector,即对所有上下文都使用相同的方向进行干预。这种方法忽略了不同上下文下概念改进方向的差异,导致控制效果不稳定,甚至可能产生负面影响,尤其是在长文本生成和多属性控制中。

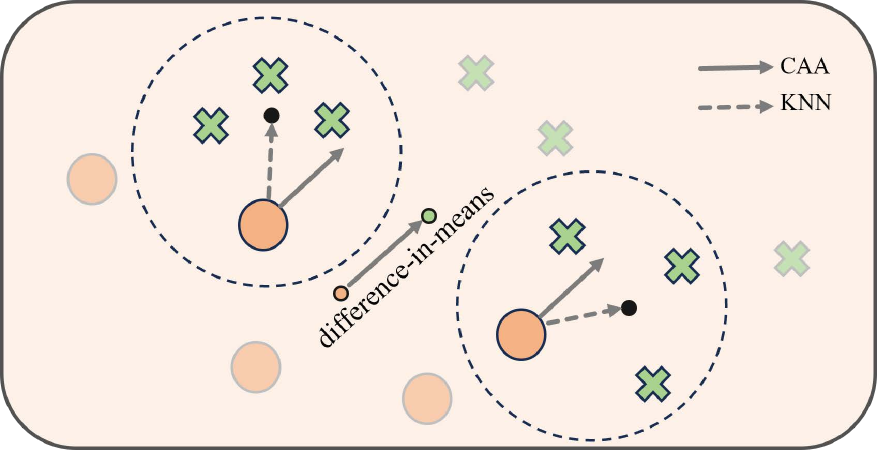

核心思路:论文的核心思路是使steering vector能够根据当前的上下文动态调整。具体来说,不是使用一个固定的向量,而是学习一个概念评分函数,该函数能够根据当前的激活状态评估概念的强度。然后,使用该评分函数的局部梯度作为steering vector,从而实现上下文相关的控制。

技术框架:SVF的技术框架主要包含以下几个步骤:1. 概念评分函数学习:使用一个神经网络来学习一个可微的概念评分函数,该函数以模型的隐藏层激活作为输入,输出一个标量值,表示该激活状态下概念的强度。2. 局部梯度计算:对于给定的激活状态,计算概念评分函数的局部梯度。该梯度向量表示在该激活状态下,概念改进的最有效方向。3. steering干预:使用计算得到的局部梯度作为steering vector,对模型的隐藏层激活进行干预,从而影响模型的输出。

关键创新:SVF的关键创新在于引入了上下文相关的steering机制。与传统的静态steering vectors方法相比,SVF能够根据当前的激活状态动态调整steering方向,从而更准确地控制模型的行为。此外,SVF还支持多层干预,允许在多个隐藏层同时进行steering,从而实现更精细的控制。

关键设计:概念评分函数可以使用各种神经网络结构,例如多层感知机或Transformer。损失函数的设计需要保证评分函数能够准确地评估概念的强度。一种常用的方法是使用对比学习,即通过比较正例和负例的评分来训练评分函数。此外,还可以使用正则化技术来防止过拟合。在多层干预中,需要对不同层的steering vector进行对齐,以确保它们在同一个概念空间中进行操作。

🖼️ 关键图片

📊 实验亮点

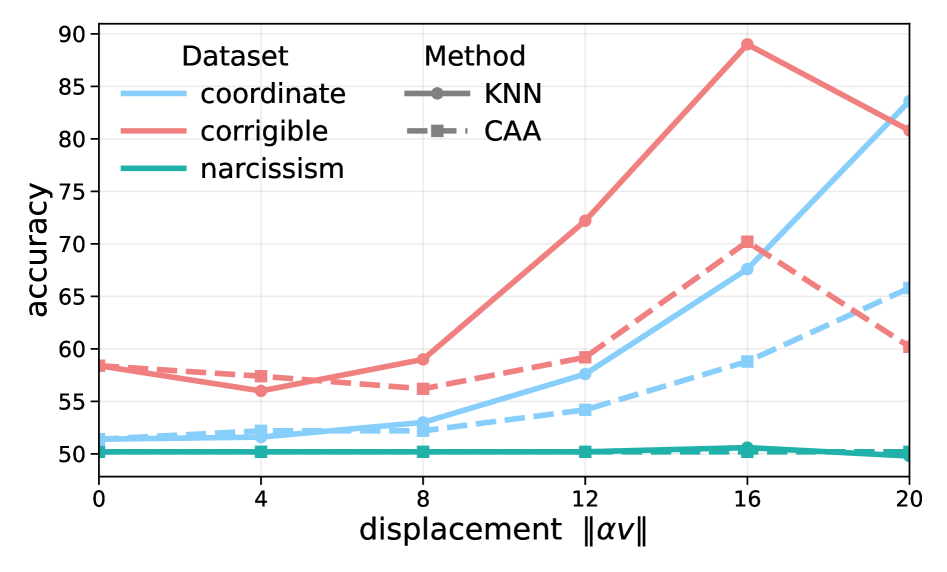

实验结果表明,SVF在多个LLM和steering任务中,相比静态steering vectors,实现了显著的性能提升。例如,在控制语言模型的生成风格方面,SVF能够更准确地控制模型的输出,并减少了不希望出现的副作用。在长文本生成和多属性控制方面,SVF也表现出更强的稳定性和可靠性。

🎯 应用场景

Steering Vector Fields (SVF) 可应用于多种场景,例如:控制语言模型的生成风格(例如,使其更正式或更幽默),引导模型生成特定主题的内容,以及提高模型在特定任务上的性能。该技术还可用于提高模型的可解释性,通过分析steering vector来理解模型内部的表征。

📄 摘要(原文)

Steering vectors (SVs) offer a lightweight way to control large language models (LLMs) at inference time by shifting hidden activations, providing a practical middle ground between prompting and fine-tuning. Yet SVs can be unreliable in practice. Some concepts are unsteerable, and even when steering helps on average it can backfire for a non-trivial fraction of inputs. Reliability also degrades in long-form generation and multi-attribute steering. We take a geometric view of these failures. A static SV applies the same update vector everywhere in representation space, implicitly assuming that the concept-improving direction is constant across contexts. When the locally effective direction varies with the current activation, a single global vector can become misaligned, which yields weak or reversed effects. Guided by this perspective, we propose Steering Vector Fields (SVF), which learns a differentiable concept scoring function whose local gradient defines the steering direction at each activation, making interventions explicitly context-dependent. This formulation supports coordinated multi-layer interventions in a shared, aligned concept space, and enables efficient long-form and multi-attribute control within a unified framework. Across multiple LLMs and steering tasks, SVF delivers stronger and more reliable control, improving the practicality of inference-time steering.