Autonomous Chain-of-Thought Distillation for Graph-Based Fraud Detection

作者: Yuan Li, Jun Hu, Bryan Hooi, Bingsheng He, Cheng Chen

分类: cs.CL, cs.CR

发布日期: 2026-01-30

💡 一句话要点

提出FraudCoT,通过自主CoT蒸馏和LLM-GNN协同训练提升图文属性图上的欺诈检测。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 欺诈检测 图神经网络 思维链 大语言模型 协同训练 文本属性图 知识蒸馏

📋 核心要点

- 现有基于LLM增强的GNN方法在文本属性图欺诈检测中受限于预定义的提示和解耦的训练流程,限制了推理自主性和语义-结构对齐。

- FraudCoT通过自主的、图感知的思维链推理和可扩展的LLM-GNN协同训练,统一解决文本属性图上的欺诈检测问题。

- 实验结果表明,FraudCoT在AUPRC指标上提升高达8.8%,训练吞吐量加速高达1066倍,显著提升了检测性能和效率。

📝 摘要(中文)

本文提出FraudCoT,一个统一的框架,通过自主的、图感知的思维链(CoT)推理和可扩展的LLM-GNN协同训练来推进基于文本属性图(TAG)的欺诈检测。为了解决预定义提示的局限性,我们引入了一种欺诈感知的选择性CoT蒸馏机制,该机制生成多样化的推理路径并增强语义-结构理解。这些蒸馏的CoT被集成到节点文本中,为GNN提供丰富的、多跳的语义和结构线索,以用于欺诈检测。此外,我们开发了一种高效的非对称协同训练策略,该策略支持端到端优化,同时显著降低了朴素联合训练的计算成本。在公共和工业基准上的大量实验表明,FraudCoT比最先进的方法实现了高达8.8%的AUPRC改进,并在训练吞吐量方面提供了高达1,066倍的加速,从而大大提高了检测性能和效率。

🔬 方法详解

问题定义:论文旨在解决文本属性图(TAG)上的欺诈检测问题。现有方法,特别是基于LLM增强的GNN方法,通常依赖于预定义的提示,并且训练流程是解耦的,这限制了模型的推理自主性,并削弱了语义和结构信息之间的对齐。这些方法无法充分利用LLM的推理能力和GNN的图结构学习能力,导致检测性能受限。

核心思路:FraudCoT的核心思路是利用LLM生成图感知的思维链(CoT),并通过蒸馏的方式将这些CoT融入到节点文本中,从而增强GNN对语义和结构信息的理解。同时,采用非对称协同训练策略,实现LLM和GNN的端到端优化,提高训练效率。这种方法旨在弥合LLM和GNN之间的差距,充分发挥各自的优势。

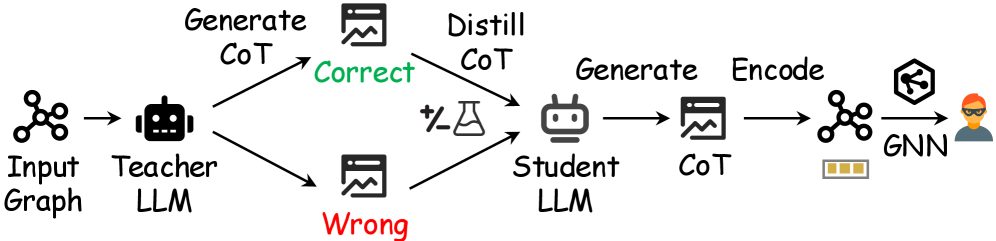

技术框架:FraudCoT框架主要包含两个阶段:CoT蒸馏和LLM-GNN协同训练。在CoT蒸馏阶段,利用LLM生成多样化的推理路径,并通过欺诈感知的选择机制,选择与欺诈检测相关的CoT。然后,将这些CoT集成到节点文本中,形成增强的文本属性图。在LLM-GNN协同训练阶段,采用非对称训练策略,交替训练LLM和GNN,实现端到端优化。

关键创新:FraudCoT的关键创新点在于:1) 提出了一种欺诈感知的选择性CoT蒸馏机制,能够生成多样化的推理路径,并增强语义-结构理解。2) 开发了一种高效的非对称协同训练策略,能够在保证性能的同时,显著降低计算成本。这种策略避免了朴素联合训练带来的巨大计算开销。

关键设计:在CoT蒸馏阶段,设计了欺诈感知的选择机制,用于选择与欺诈检测相关的CoT。在LLM-GNN协同训练阶段,采用了非对称训练策略,即固定LLM的参数,只训练GNN,或者反过来。这种策略可以有效降低计算成本,同时保证模型的性能。具体的损失函数包括分类损失和对比学习损失,用于优化GNN和LLM的参数。

🖼️ 关键图片

📊 实验亮点

FraudCoT在公共和工业基准数据集上进行了广泛的实验,结果表明,FraudCoT比最先进的方法实现了高达8.8%的AUPRC改进,并在训练吞吐量方面提供了高达1,066倍的加速。这些结果充分证明了FraudCoT在欺诈检测任务中的优越性和实用性。

🎯 应用场景

FraudCoT在金融欺诈检测、社交网络垃圾信息识别、电商平台虚假评论检测等领域具有广泛的应用前景。该研究能够有效提升欺诈检测的准确性和效率,降低企业的运营风险和经济损失,为构建更安全可靠的网络环境提供技术支持。

📄 摘要(原文)

Graph-based fraud detection on text-attributed graphs (TAGs) requires jointly modeling rich textual semantics and relational dependencies. However, existing LLM-enhanced GNN approaches are constrained by predefined prompting and decoupled training pipelines, limiting reasoning autonomy and weakening semantic-structural alignment. We propose FraudCoT, a unified framework that advances TAG-based fraud detection through autonomous, graph-aware chain-of-thought (CoT) reasoning and scalable LLM-GNN co-training. To address the limitations of predefined prompts, we introduce a fraud-aware selective CoT distillation mechanism that generates diverse reasoning paths and enhances semantic-structural understanding. These distilled CoTs are integrated into node texts, providing GNNs with enriched, multi-hop semantic and structural cues for fraud detection. Furthermore, we develop an efficient asymmetric co-training strategy that enables end-to-end optimization while significantly reducing the computational cost of naive joint training. Extensive experiments on public and industrial benchmarks demonstrate that FraudCoT achieves up to 8.8% AUPRC improvement over state-of-the-art methods and delivers up to 1,066x speedup in training throughput, substantially advancing both detection performance and efficiency.