MM-THEBench: Do Reasoning MLLMs Think Reasonably?

作者: Zhidian Huang, Zijun Yao, Ji Qi, Shangqing Tu, Junxian Ma, Jinxin Liu, Weichuan Liu, Xiaoyin Che, Lei Hou, Juanzi Li

分类: cs.CL

发布日期: 2026-01-30

💡 一句话要点

提出MM-THEBench,评估推理多模态大模型中间CoT中的幻觉问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 幻觉评估 推理链 基准测试 认知维度

📋 核心要点

- 现有基准测试忽略了推理MLLM的内部思考过程,无法有效衡量思考过程中产生的幻觉。

- MM-THEBench通过构建细粒度分类体系、验证推理标注数据和多层次自动化评估框架来解决上述问题。

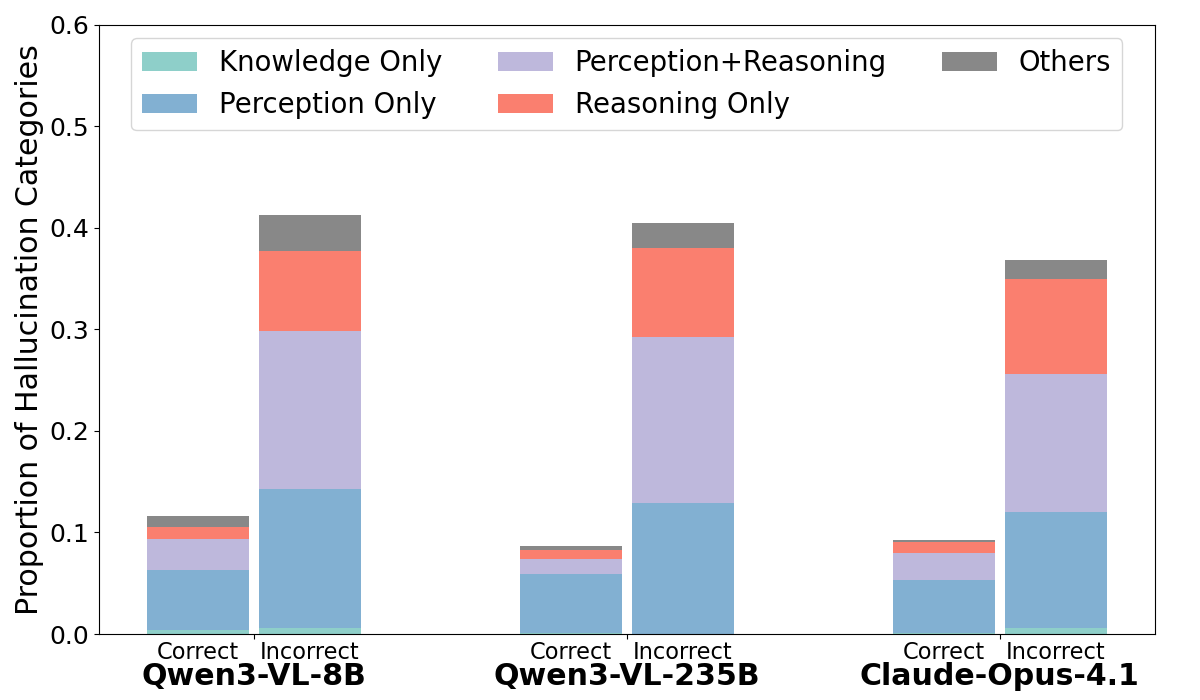

- 实验结果表明,思考过程对多模态任务中的幻觉和推理能力有显著影响,并提供了深入的分析。

📝 摘要(中文)

多模态大语言模型(MLLM)的最新进展标志着从非思考模型向后训练推理模型的转变,这些模型能够通过思考解决复杂问题。然而,这种思考是否能减轻多模态感知和推理中的幻觉仍不清楚。自我反思推理增强了鲁棒性,但也引入了额外的幻觉,细微的感知错误仍然会导致不正确或偶然正确的答案。现有的基准主要关注推理MLLM出现之前的模型,忽略了内部思考过程,无法衡量思考过程中发生的幻觉。为了应对这些挑战,我们引入了MM-THEBench,这是一个综合基准,用于评估推理MLLM中间CoT中的幻觉。MM-THEBench具有基于认知维度的细粒度分类、具有验证推理注释的多样化数据以及多层次的自动化评估框架。对主流推理MLLM的广泛实验揭示了思考如何影响各种多模态任务中的幻觉和推理能力。

🔬 方法详解

问题定义:论文旨在解决推理型多模态大语言模型(MLLMs)在中间推理步骤(Chain-of-Thought, CoT)中产生的幻觉问题。现有基准测试主要关注模型最终输出的正确性,忽略了模型内部的推理过程,无法有效评估和诊断中间步骤中产生的幻觉,这使得我们难以理解幻觉的来源和影响。现有方法的痛点在于缺乏对中间推理步骤幻觉的细粒度评估和诊断。

核心思路:论文的核心思路是构建一个专门用于评估推理MLLMs中间CoT幻觉的基准测试集MM-THEBench。通过设计精细的认知维度分类体系,收集并验证推理标注数据,并建立多层次的自动化评估框架,从而能够更全面、深入地评估和诊断MLLMs在推理过程中的幻觉问题。这种方法能够帮助研究人员更好地理解幻觉的产生机制,并为开发更可靠的MLLMs提供指导。

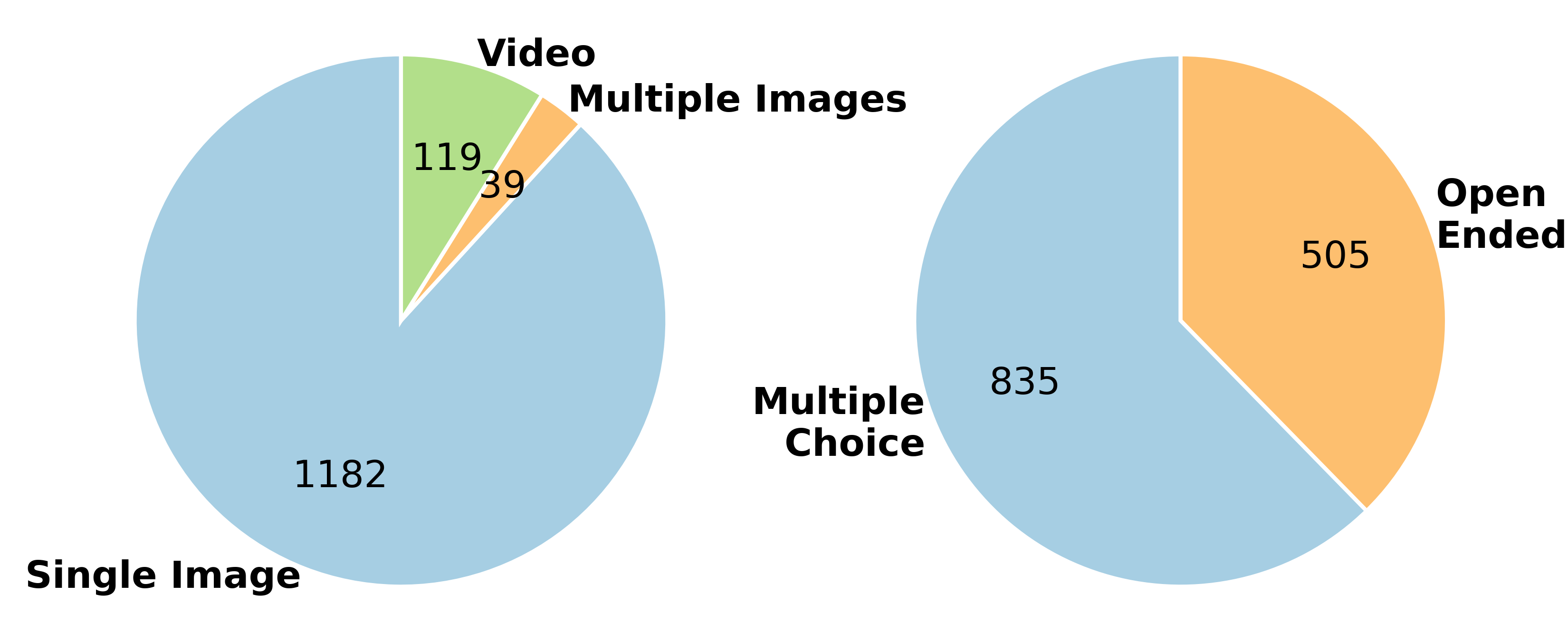

技术框架:MM-THEBench的整体框架包括以下几个主要组成部分: 1. 数据收集与标注:收集多样化的多模态数据,并进行人工标注,确保标注的推理过程是正确的。 2. 认知维度分类体系:构建一个基于认知维度的细粒度分类体系,用于对幻觉进行分类和分析。 3. 多层次自动化评估框架:设计一个多层次的自动化评估框架,用于评估MLLMs在中间CoT中的幻觉。 4. 基准测试与分析:使用MM-THEBench对主流推理MLLMs进行基准测试,并对结果进行深入分析。

关键创新:MM-THEBench的关键创新在于: 1. 关注中间推理步骤:首次关注并系统地评估推理MLLMs在中间CoT中的幻觉问题。 2. 细粒度分类体系:构建了一个基于认知维度的细粒度分类体系,能够更精确地对幻觉进行分类和分析。 3. 多层次自动化评估框架:设计了一个多层次的自动化评估框架,能够更全面地评估MLLMs的幻觉问题。

关键设计:MM-THEBench的关键设计包括: 1. 数据多样性:收集包含多种模态和任务的数据,以确保基准测试的泛化能力。 2. 标注质量:采用严格的人工标注流程,确保标注的推理过程是正确的。 3. 评估指标:设计多种评估指标,包括准确率、幻觉率等,以全面评估MLLMs的性能。 4. 自动化评估:开发自动化评估工具,以提高评估效率和可重复性。

🖼️ 关键图片

📊 实验亮点

通过在MM-THEBench上对主流推理MLLM进行测试,论文揭示了思考过程对幻觉和推理能力的影响。实验结果表明,即使是具有推理能力的MLLM,在中间CoT中仍然存在显著的幻觉问题。该基准测试为未来研究如何减少MLLM中的幻觉提供了重要的工具和方向。

🎯 应用场景

该研究成果可应用于提升多模态大语言模型在图像理解、视频分析、机器人导航等领域的可靠性和安全性。通过评估和减少模型推理过程中的幻觉,可以提高模型在实际应用中的准确性和可信度,例如在自动驾驶、医疗诊断等关键领域。

📄 摘要(原文)

Recent advances in multimodal large language models (MLLMs) mark a shift from non-thinking models to post-trained reasoning models capable of solving complex problems through thinking. However, whether such thinking mitigates hallucinations in multimodal perception and reasoning remains unclear. Self-reflective reasoning enhances robustness but introduces additional hallucinations, and subtle perceptual errors still result in incorrect or coincidentally correct answers. Existing benchmarks primarily focus on models before the emergence of reasoning MLLMs, neglecting the internal thinking process and failing to measure the hallucinations that occur during thinking. To address these challenges, we introduce MM-THEBench, a comprehensive benchmark for assessing hallucinations of intermediate CoTs in reasoning MLLMs. MM-THEBench features a fine-grained taxonomy grounded in cognitive dimensions, diverse data with verified reasoning annotations, and a multi-level automated evaluation framework. Extensive experiments on mainstream reasoning MLLMs reveal insights into how thinking affects hallucination and reasoning capability in various multimodal tasks.