Layer-wise Swapping for Generalizable Multilingual Safety

作者: Hyunseo Shin, Wonseok Hwang

分类: cs.CL

发布日期: 2026-01-30

💡 一句话要点

提出层级交换方法,提升低资源语言大模型安全性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多语言安全 层级交换 低资源语言 知识迁移 大型语言模型

📋 核心要点

- 低资源语言大模型安全性不足,缺乏多语言安全对齐数据是主要瓶颈。

- 提出层级交换方法,将英语安全专家的知识迁移到低资源语言模型。

- 实验表明,该方法在保证通用性能的同时,显著提升了低资源语言模型的安全性。

📝 摘要(中文)

尽管大型语言模型(LLMs)取得了快速进展,但对于低资源语言而言,安全风险仍然是一个关键挑战。现有的安全数据集主要以英语为中心,限制了多语言安全对齐的进展。因此,在各自的指令数据集上进行微调的低资源专家模型,与高资源模型相比,往往表现出更高的不安全率。本文提出了一种安全感知的层交换方法,该方法将英语安全专家的安全对齐能力迁移到低资源语言专家,而无需额外的训练。为了进一步提高迁移能力,我们的方法根据模块的专业化程度自适应地选择或混合模块。我们的方法在保持通用语言理解任务性能的同时,增强了目标语言的安全性。实验结果表明,所提出的方法在MMMLU、BELEBELE和MGSM等通用基准测试中取得了与语言专家相当的性能,同时在MultiJail安全基准测试中产生了更对齐和更少有害的响应。

🔬 方法详解

问题定义:现有的大型语言模型在低资源语言上的安全性不足,主要原因是缺乏针对这些语言的安全对齐数据。直接对低资源语言模型进行安全微调成本高昂,且效果往往不如高资源语言模型。因此,如何有效地将高资源语言(如英语)的安全知识迁移到低资源语言模型是一个亟待解决的问题。

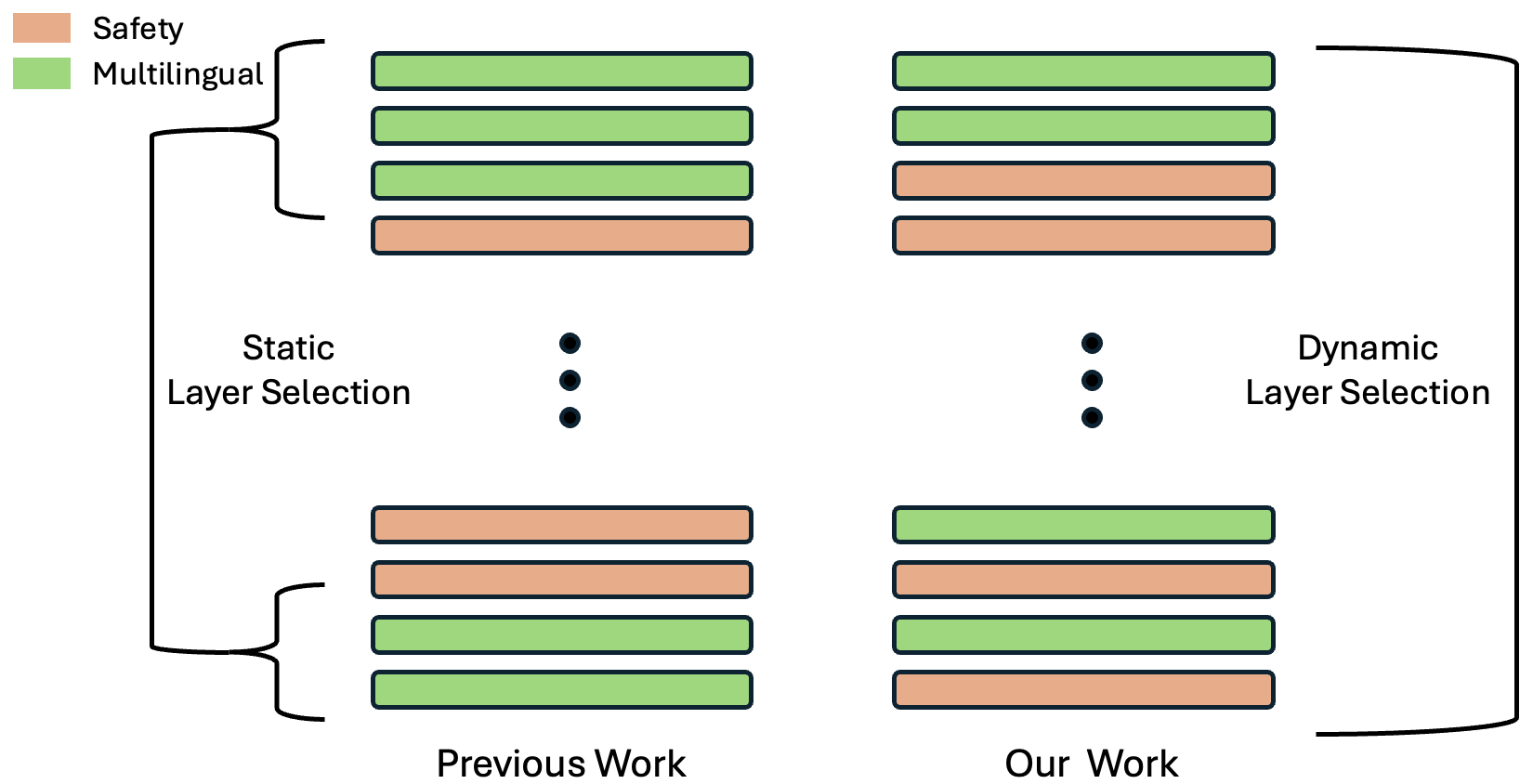

核心思路:本文的核心思路是通过层级交换,将英语安全专家的知识迁移到低资源语言专家模型。具体来说,就是将英语安全专家模型的某些层替换到低资源语言专家模型的相应层,从而使低资源语言模型获得一定的安全对齐能力。这种方法避免了对低资源语言模型进行额外的训练,降低了成本。

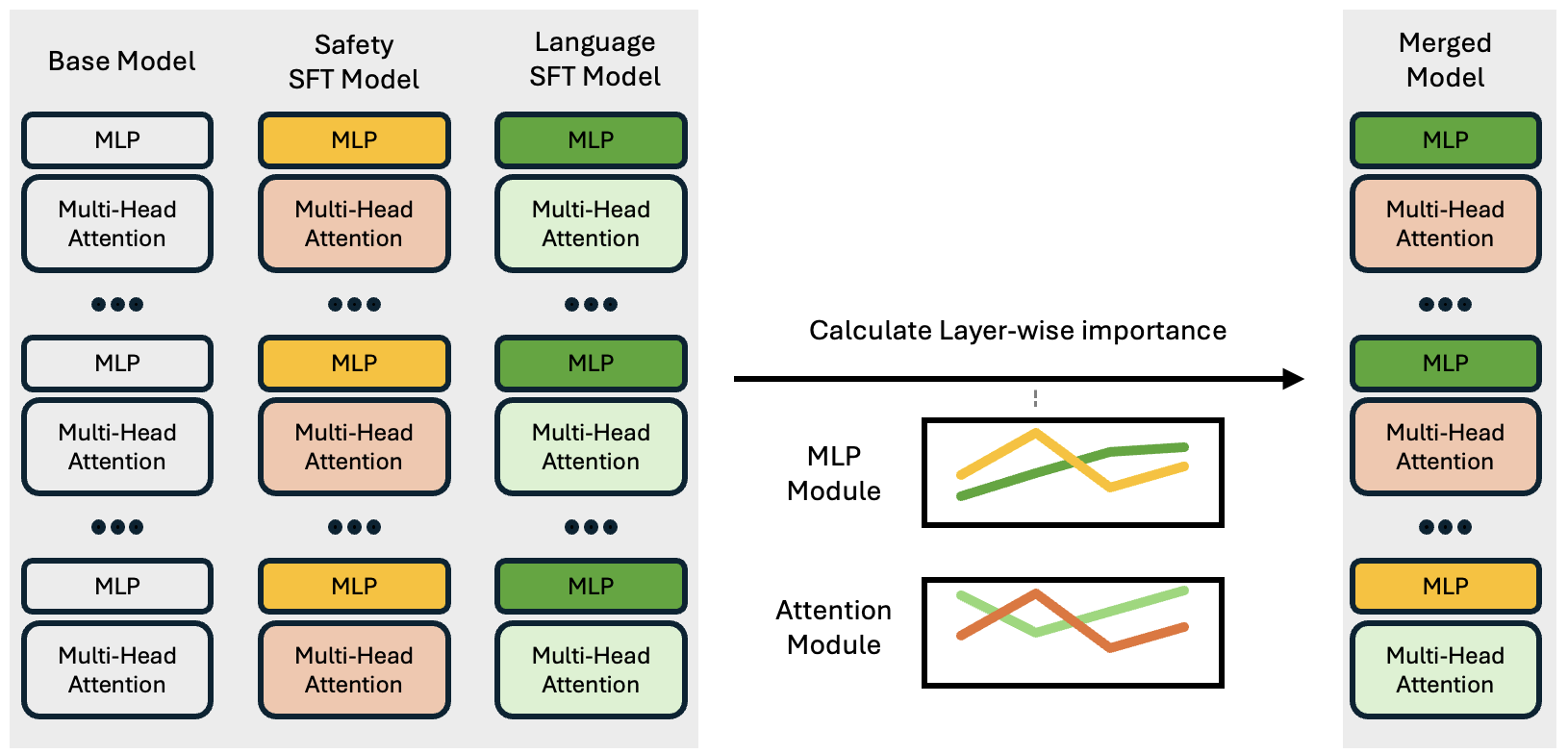

技术框架:该方法主要包含以下几个步骤:1) 准备一个英语安全专家模型和一个低资源语言专家模型。2) 确定需要交换的层。3) 根据模块的专业化程度自适应地选择或混合模块。4) 将英语安全专家模型的选定层替换到低资源语言专家模型的相应层。5) 评估交换后的低资源语言模型的性能和安全性。

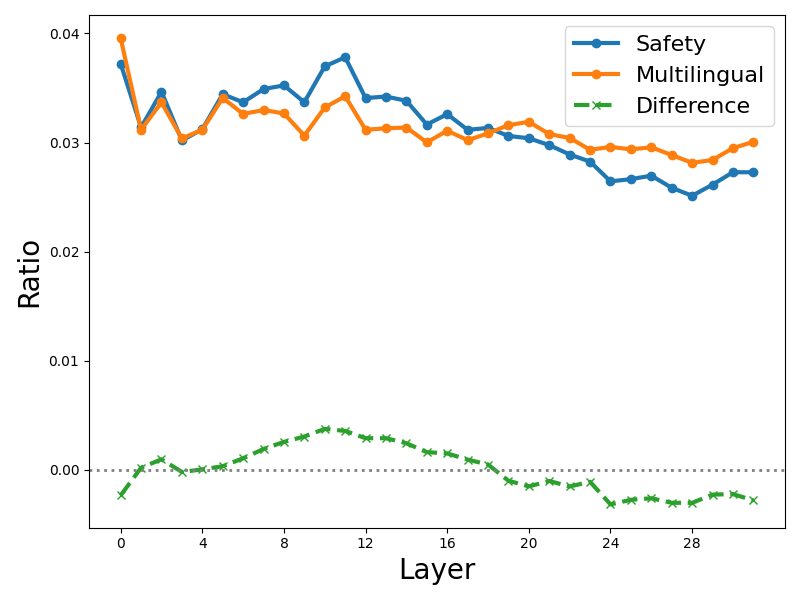

关键创新:该方法的关键创新在于安全感知的层交换策略,以及自适应的模块选择或混合机制。传统的层交换方法通常是随机或基于经验的,而本文提出的方法能够根据模块的专业化程度,有选择性地交换层,从而更有效地迁移安全知识。自适应的模块选择或混合机制进一步提高了迁移的灵活性和效果。

关键设计:该方法的关键设计包括:1) 如何衡量模块的专业化程度(例如,通过计算模块对安全相关输入的响应强度)。2) 如何确定需要交换的层(例如,通过实验或启发式方法)。3) 如何进行模块的混合(例如,通过加权平均)。4) 如何评估交换后的模型的性能和安全性(例如,使用通用语言理解基准测试和安全基准测试)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在MMMLU、BELEBELE和MGSM等通用基准测试中取得了与语言专家相当的性能,同时在MultiJail安全基准测试中产生了更对齐和更少有害的响应。这表明该方法能够在保证通用性能的同时,显著提升低资源语言模型的安全性。

🎯 应用场景

该研究成果可应用于提升多语言大型语言模型的安全性,尤其是在低资源语言场景下。通过将高资源语言的安全知识迁移到低资源语言模型,可以有效降低有害内容的生成风险,提高用户体验。此外,该方法还可以应用于其他知识迁移场景,例如将一个领域的知识迁移到另一个领域。

📄 摘要(原文)

Despite the rapid advancements of Large Language Models (LLMs), safety risks remain a critical challenge for low-resource languages. Existing safety datasets are predominantly English centric, limiting progress in multilingual safety alignment. As a result, low resource expert models, finetuned on their respective instruction datasets, tend to exhibit higher unsafety rates compared to their high resource counterparts. In this work, we propose a safety aware layer swapping method that transfers safety alignment from an English safety expert to low resource language experts without additional training. To further enhance transfer ability, our method adaptively selects or blends modules based on their degree of specialization. Our approach preserves performance on general language understanding tasks while enhancing safety in the target languages. Experimental results show that the proposed method achieves comparable performance to the language expert on general benchmarks such as MMMLU, BELEBELE, and MGSM, while producing more aligned and less harmful responses on the MultiJail safety benchmark.