ILRR: Inference-Time Steering Method for Masked Diffusion Language Models

作者: Eden Avrahami, Eliya Nachmani

分类: cs.CL, cs.AI, cs.LG

发布日期: 2026-01-29

💡 一句话要点

提出ILRR:一种用于Masked扩散语言模型的推理时引导方法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 扩散语言模型 文本生成 推理时引导 属性控制 非自回归 语义对齐 空间调制

📋 核心要点

- 现有离散扩散语言模型缺乏有效的推理时控制机制,限制了对生成文本属性的灵活操控。

- ILRR通过在去噪过程中动态对齐生成序列和参考序列的内部激活,实现对生成文本属性的引导。

- 实验表明,ILRR在计算开销很小的情况下,显著提高了属性控制的准确性,并保持了较高的生成质量。

📝 摘要(中文)

离散扩散语言模型(DLMs)为文本生成提供了一种有前景的非自回归替代方案,但有效的推理时控制机制仍相对未被充分探索。现有方法包括采样级别的引导过程或轨迹优化机制。本文介绍了一种迭代潜在表示细化(ILRR)方法,这是一个无需学习的框架,用于使用单个参考序列来引导DLM。ILRR通过在去噪过程中动态地将生成序列的内部激活与给定参考序列的激活对齐来引导生成。这种方法捕获并传递高层次的语义属性,并通过可调节的引导尺度实现对情感等属性的灵活控制。我们进一步引入了空间调制引导,这是一种扩展,通过调节序列中的引导强度,可以使用较短的参考来引导长文本。实验结果表明,ILRR在LLaDA和MDLM架构上实现了有效的属性引导,计算开销很小,每个去噪步骤仅需要一个额外的并行前向传递。在相同的计算预算下,ILRR在属性准确性方面比同类基线提高了10%到60%,同时保持了较高的生成质量。

🔬 方法详解

问题定义:论文旨在解决离散扩散语言模型(DLMs)在推理时缺乏有效控制机制的问题。现有的方法,如采样级别的引导或轨迹优化,要么计算成本高昂,要么控制精度有限,难以灵活地控制生成文本的特定属性(如情感)。

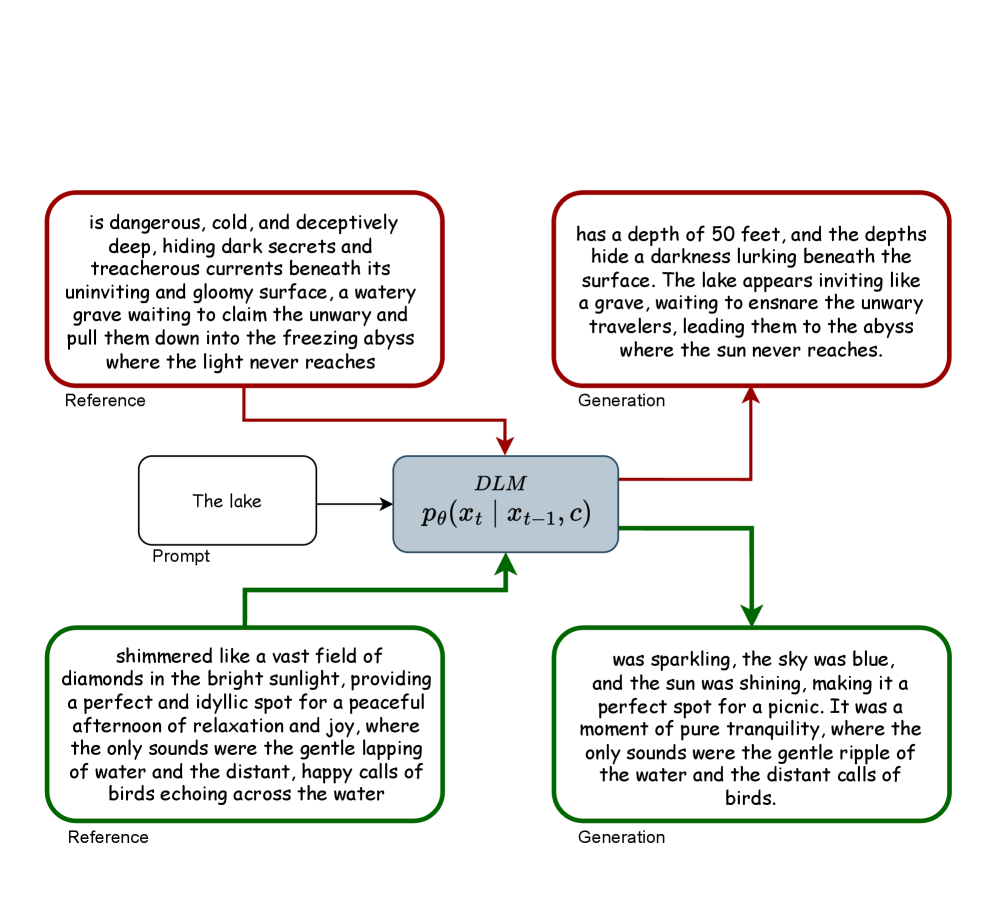

核心思路:论文的核心思路是利用参考序列的内部激活作为引导信号,在DLM的去噪过程中,迭代地将生成序列的内部激活与参考序列对齐。通过这种方式,可以将参考序列的高层次语义属性(如情感)传递到生成序列中,从而实现对生成文本属性的精确控制。

技术框架:ILRR框架主要包含以下几个步骤:1) 给定一个参考序列和一个初始噪声序列;2) 在DLM的去噪过程中,计算生成序列和参考序列在特定层的内部激活;3) 计算两个激活之间的差异,并将其作为引导信号;4) 将引导信号添加到生成序列的激活中,使其向参考序列靠拢;5) 重复步骤2-4,直到去噪过程完成。此外,论文还提出了空间调制引导,用于处理长文本生成,通过调节序列不同位置的引导强度,可以使用较短的参考序列来引导长文本的生成。

关键创新:ILRR的关键创新在于提出了一种无需学习的、基于内部激活对齐的引导方法。与现有的方法相比,ILRR不需要额外的训练,计算成本低,并且能够实现对生成文本属性的精确控制。空间调制引导是另一个创新点,它解决了长文本生成中参考序列长度的限制。

关键设计:ILRR的关键设计包括:1) 选择合适的内部激活层进行对齐,通常选择Transformer模型的中间层;2) 使用可调节的引导尺度来控制引导强度,从而实现对属性控制的灵活调节;3) 空间调制引导中,使用注意力机制来动态调节序列不同位置的引导强度。论文没有明确说明损失函数,因为该方法是learning-free的。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ILRR在LLaDA和MDLM架构上实现了有效的属性引导,且计算开销很小,每个去噪步骤仅需增加一次并行前向传递。在相同的计算预算下,ILRR在属性准确性方面比同类基线提高了10%到60%,同时保持了较高的生成质量。这表明ILRR是一种高效且有效的文本属性控制方法。

🎯 应用场景

ILRR可应用于多种文本生成任务,例如情感控制的文本生成、风格迁移、以及基于关键词的文本生成。该方法能够提升生成文本的可控性和多样性,在对话系统、内容创作、以及文本摘要等领域具有广泛的应用前景。未来,可以探索将ILRR与其他控制方法相结合,进一步提升文本生成的可控性。

📄 摘要(原文)

Discrete Diffusion Language Models (DLMs) offer a promising non-autoregressive alternative for text generation, yet effective mechanisms for inference-time control remain relatively underexplored. Existing approaches include sampling-level guidance procedures or trajectory optimization mechanisms. In this work, we introduce Iterative Latent Representation Refinement (ILRR), a learning-free framework for steering DLMs using a single reference sequence. ILRR guides generation by dynamically aligning the internal activations of the generated sequence with those of a given reference throughout the denoising process. This approach captures and transfers high-level semantic properties, with a tunable steering scale enabling flexible control over attributes such as sentiment. We further introduce Spatially Modulated Steering, an extension that enables steering long texts using shorter references by regulating guidance intensity across the sequence. Empirically, we demonstrate that ILRR achieves effective attribute steering on LLaDA and MDLM architectures with a minor computational overhead, requiring only one additional parallel forward pass per denoising step. Under the same compute budget, ILRR improves attribute accuracy over comparable baselines by 10$\%$ to 60$\%$ points, while maintaining high generation quality.