Beyond Divergent Creativity: A Human-Based Evaluation of Creativity in Large Language Models

作者: Kumiko Nakajima, Jan Zuiderveld, Sandro Pezzelle

分类: cs.CL

发布日期: 2026-01-28

备注: Accepted to Findings of EACL 2026

💡 一句话要点

提出条件发散联想任务以评估语言模型的创造力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 创造力评估 发散联想任务 条件发散联想任务 新颖性 适当性 机器学习 自然语言处理

📋 核心要点

- 现有的创造力评估方法如DAT,主要关注新颖性,忽视了适当性这一创造力的核心要素,导致评估结果的有效性受到质疑。

- 论文提出了条件发散联想任务(CDAT),该方法在评估新颖性时考虑上下文适当性,从而更有效地区分噪声与创造力。

- 实验结果表明,CDAT能够更好地评估模型的创造力,较小模型在创造力上表现更佳,而高级模型则在适当性上占优。

📝 摘要(中文)

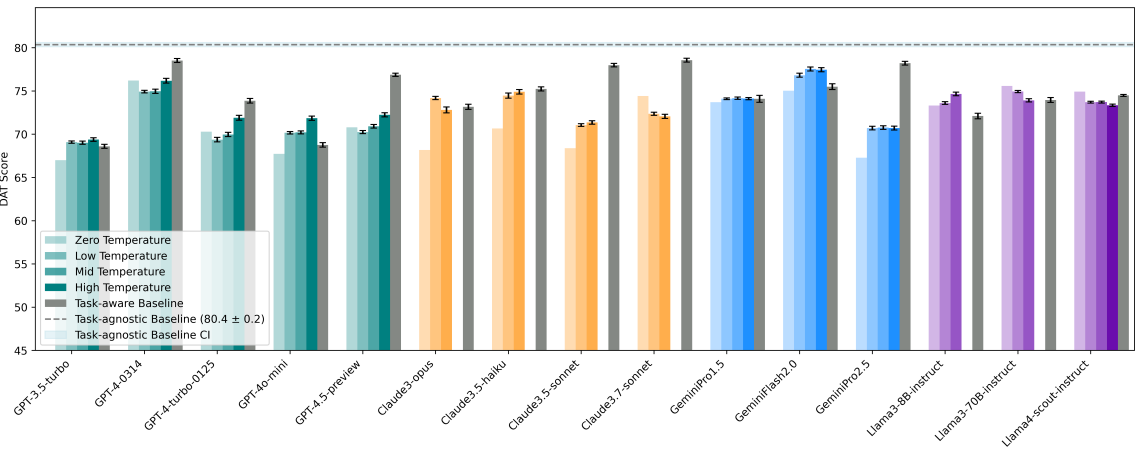

大型语言模型(LLMs)在语言创造性任务中的应用日益增多。然而,现有的创造力评估方法缺乏对人类创造力理论的扎实基础,导致结果难以解释。广泛使用的发散联想任务(DAT)侧重于新颖性,忽视了创造力的核心组成部分——适当性。我们对多种最先进的LLMs在DAT上的表现进行了评估,结果显示其得分低于两个不具备创造能力的基线模型,削弱了DAT作为模型评估工具的有效性。基于人类创造力理论,我们提出了条件发散联想任务(CDAT),该任务在上下文适当性条件下评估新颖性,能够更好地区分噪声与创造力,同时保持简单和客观。在CDAT下,较小的模型家族通常表现出更高的创造力,而高级模型则在较低的新颖性下更偏向适当性。我们假设训练和对齐可能会使模型沿着这一边界移动,使输出更适当但创造力降低。我们发布了数据集和代码。

🔬 方法详解

问题定义:本论文旨在解决现有发散联想任务(DAT)在评估大型语言模型创造力时的不足,特别是忽视适当性的问题。DAT的有效性受到质疑,因为其得分低于不具创造能力的基线模型。

核心思路:论文提出条件发散联想任务(CDAT),通过在评估新颖性时引入上下文适当性,来更全面地反映模型的创造力。这种设计旨在提高评估的有效性和客观性。

技术框架:CDAT的整体架构包括新颖性和适当性两个评估模块。首先,模型生成候选输出,然后根据上下文对这些输出进行适当性评估,最后结合新颖性和适当性得出综合评分。

关键创新:CDAT的主要创新在于将适当性纳入创造力评估中,使得评估结果更具解释性和有效性。这一方法与传统的DAT相比,能够更好地区分噪声与真正的创造力。

关键设计:在CDAT中,设计了特定的评估标准和评分机制,以确保新颖性和适当性能够被独立且客观地评估。此外,模型的训练和对齐策略也可能影响其在CDAT中的表现。

🖼️ 关键图片

📊 实验亮点

实验结果显示,使用CDAT评估的模型在创造力方面表现更为优越,尤其是较小模型家族的创造力得分显著高于高级模型。此外,CDAT能够有效地区分噪声与创造力,提升了评估的有效性。

🎯 应用场景

该研究的潜在应用领域包括教育、创意写作、广告和游戏设计等。在这些领域中,评估和提升机器生成内容的创造力具有重要的实际价值。未来,CDAT可能成为评估语言模型创造力的标准工具,推动相关技术的发展。

📄 摘要(原文)

Large language models (LLMs) are increasingly used in verbal creative tasks. However, previous assessments of the creative capabilities of LLMs remain weakly grounded in human creativity theory and are thus hard to interpret. The widely used Divergent Association Task (DAT) focuses on novelty, ignoring appropriateness, a core component of creativity. We evaluate a range of state-of-the-art LLMs on DAT and show that their scores on the task are lower than those of two baselines that do not possess any creative abilities, undermining its validity for model evaluation. Grounded in human creativity theory, which defines creativity as the combination of novelty and appropriateness, we introduce Conditional Divergent Association Task (CDAT). CDAT evaluates novelty conditional on contextual appropriateness, separating noise from creativity better than DAT, while remaining simple and objective. Under CDAT, smaller model families often show the most creativity, whereas advanced families favor appropriateness at lower novelty. We hypothesize that training and alignment likely shift models along this frontier, making outputs more appropriate but less creative. We release the dataset and code.