Can We Improve Educational Diagram Generation with In-Context Examples? Not if a Hallucination Spoils the Bunch

作者: Evanfiya Logacheva, Arto Hellas, Tsvetomila Mihaylova, Juha Sorva, Ava Heinonen, Juho Leinonen

分类: cs.CL

发布日期: 2026-01-28

💡 一句话要点

利用上下文示例改进教育图表生成?警惕幻觉问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 图表生成 大型语言模型 修辞结构理论 上下文学习 AI幻觉 教育应用 代码生成

📋 核心要点

- 现有图表生成方法难以保证生成图表的质量,尤其是在逻辑组织和避免AI幻觉方面存在挑战。

- 该论文提出了一种基于修辞结构理论(RST)的上下文示例方法,旨在提升图表生成的质量和对用户期望的对齐。

- 实验结果表明,该方法在降低事实幻觉率和提高图表对上下文的忠实度方面有所改进,但质量仍受LLM随机性的影响。

📝 摘要(中文)

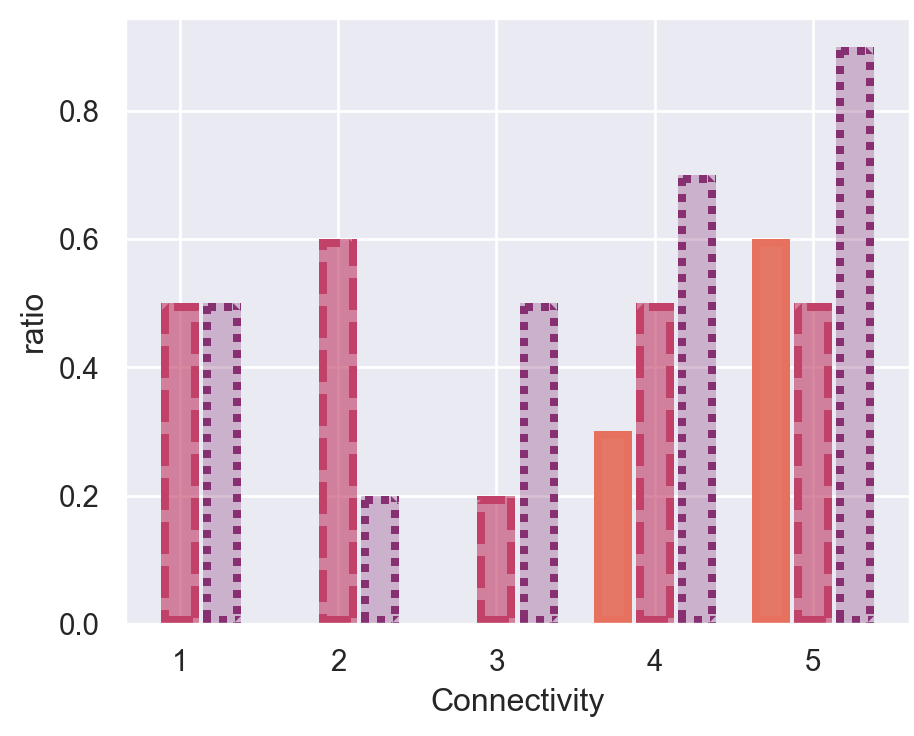

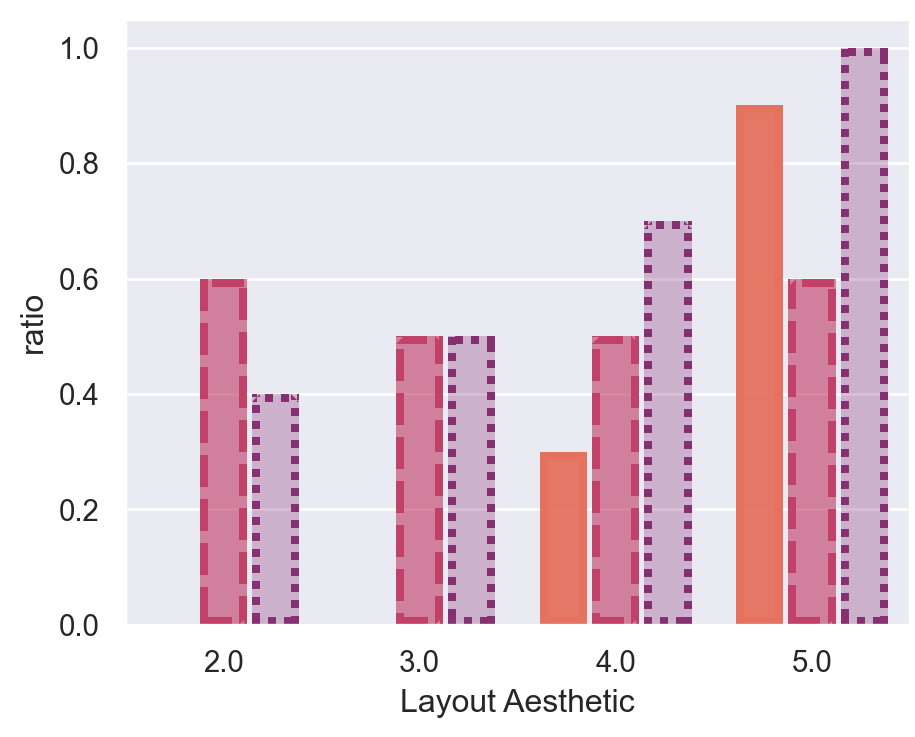

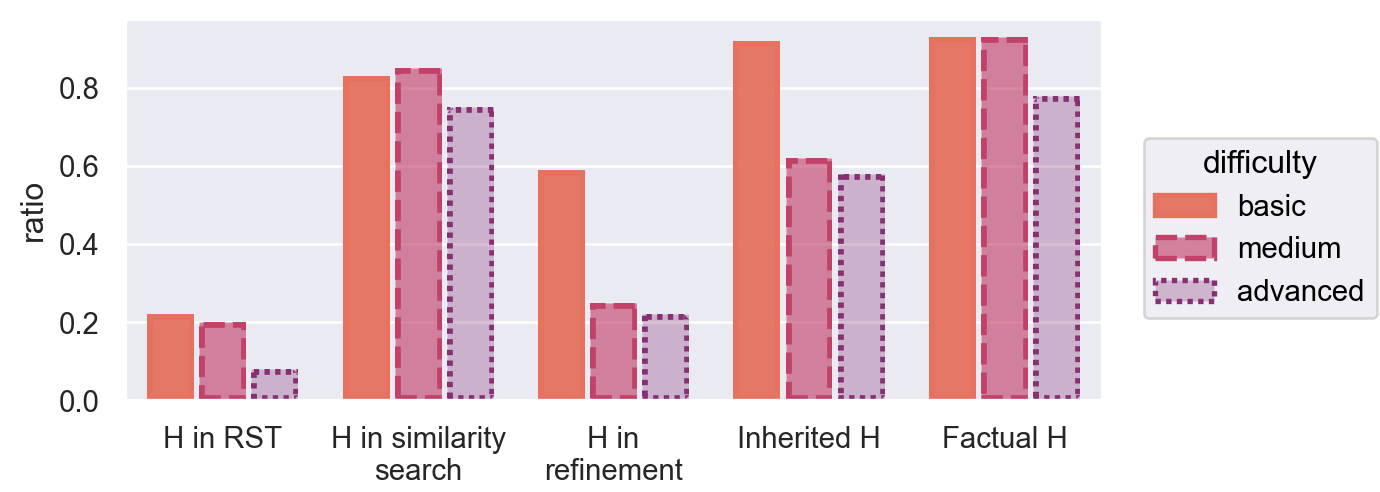

生成式人工智能在计算机教育中得到广泛应用,但生成材料的质量引起了教育者和学生的关注。本研究提出了一种基于修辞结构理论(RST)的上下文示例图表代码生成新方法,旨在通过使模型的输出与用户期望对齐来改进图表生成。计算机科学教育者评估了大型语言模型(LLM)生成的150个图表,评估指标包括逻辑组织、连通性、布局美观性和AI幻觉。评估数据集还被用于自动图表评估。初步结果表明,该方法降低了事实幻觉的发生率,并提高了图表对所提供上下文的忠实度;然而,由于LLM的随机性,生成的图表质量参差不齐。此外,我们对AI幻觉和生成图表质量之间的联系进行了深入分析和讨论,揭示了文本上下文的复杂性越高,幻觉的发生率越高,并且LLM通常无法检测到其输出中的错误。

🔬 方法详解

问题定义:论文旨在解决教育场景下图表生成质量不高,特别是大型语言模型(LLM)容易产生幻觉的问题。现有方法生成的图表在逻辑组织、连通性和内容准确性方面存在不足,难以满足教育者的需求。

核心思路:论文的核心思路是利用修辞结构理论(RST)构建上下文示例,引导LLM生成更符合用户期望且更准确的图表。通过提供高质量的上下文信息,减少LLM产生幻觉的可能性,并提升生成图表的整体质量。

技术框架:该方法主要包含以下几个阶段:1) 基于RST构建上下文示例,包括输入文本和期望生成的图表代码;2) 将上下文示例输入LLM,提示其生成新的图表代码;3) 对生成的图表进行评估,评估指标包括逻辑组织、连通性、布局美观性和AI幻觉;4) 分析评估结果,改进上下文示例的构建方法,并优化LLM的提示策略。

关键创新:该方法的关键创新在于将RST引入图表生成任务,并利用上下文示例来引导LLM生成更符合用户期望的图表。与传统的图表生成方法相比,该方法更加注重图表的语义和逻辑结构,能够有效减少LLM产生幻觉的可能性。

关键设计:论文的关键设计包括:1) 上下文示例的构建方法,需要仔细选择和组织输入文本,并提供清晰明确的图表代码示例;2) LLM的提示策略,需要设计合适的提示语,引导LLM理解输入文本的语义,并生成符合要求的图表代码;3) 评估指标的选择,需要综合考虑图表的逻辑结构、内容准确性和美观性。

🖼️ 关键图片

📊 实验亮点

研究结果表明,基于RST的上下文示例方法能够降低LLM在图表生成中产生事实幻觉的概率,并提高图表对上下文的忠实度。尽管由于LLM的随机性,生成图表的质量仍存在差异,但该方法为提升教育图表生成质量提供了一种有前景的途径。教育者对生成图表的评估也为自动图表评估提供了有价值的数据集。

🎯 应用场景

该研究成果可应用于各种教育场景,例如自动生成教学材料、辅助学生理解复杂概念、以及创建交互式学习工具。通过提高图表生成的质量和准确性,可以提升学生的学习效率和理解能力,并减轻教育者的工作负担。未来,该方法还可以扩展到其他类型的可视化内容生成,例如流程图、思维导图等。

📄 摘要(原文)

Generative artificial intelligence (AI) has found a widespread use in computing education; at the same time, quality of generated materials raises concerns among educators and students. This study addresses this issue by introducing a novel method for diagram code generation with in-context examples based on the Rhetorical Structure Theory (RST), which aims to improve diagram generation by aligning models' output with user expectations. Our approach is evaluated by computer science educators, who assessed 150 diagrams generated with large language models (LLMs) for logical organization, connectivity, layout aesthetic, and AI hallucination. The assessment dataset is additionally investigated for its utility in automated diagram evaluation. The preliminary results suggest that our method decreases the rate of factual hallucination and improves diagram faithfulness to provided context; however, due to LLMs' stochasticity, the quality of the generated diagrams varies. Additionally, we present an in-depth analysis and discussion on the connection between AI hallucination and the quality of generated diagrams, which reveals that text contexts of higher complexity lead to higher rates of hallucination and LLMs often fail to detect mistakes in their output.