Me-Agent: A Personalized Mobile Agent with Two-Level User Habit Learning for Enhanced Interaction

作者: Shuoxin Wang, Chang Liu, Gowen Loo, Lifan Zheng, Kaiwen Wei, Xinyi Zeng, Jingyuan Zhang, Yu Tian

分类: cs.CL

发布日期: 2026-01-28

💡 一句话要点

Me-Agent:一种基于双层用户习惯学习的个性化移动Agent,增强交互体验

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 移动Agent 个性化 用户习惯学习 大型语言模型 分层记忆

📋 核心要点

- 现有基于LLM的移动Agent忽略用户个性化需求,无法处理模糊指令,缺乏用户交互历史学习能力,限制了用户体验。

- Me-Agent通过双层用户习惯学习方法,在Prompt层面利用个性化奖励模型学习用户偏好,在记忆层面构建分层偏好记忆。

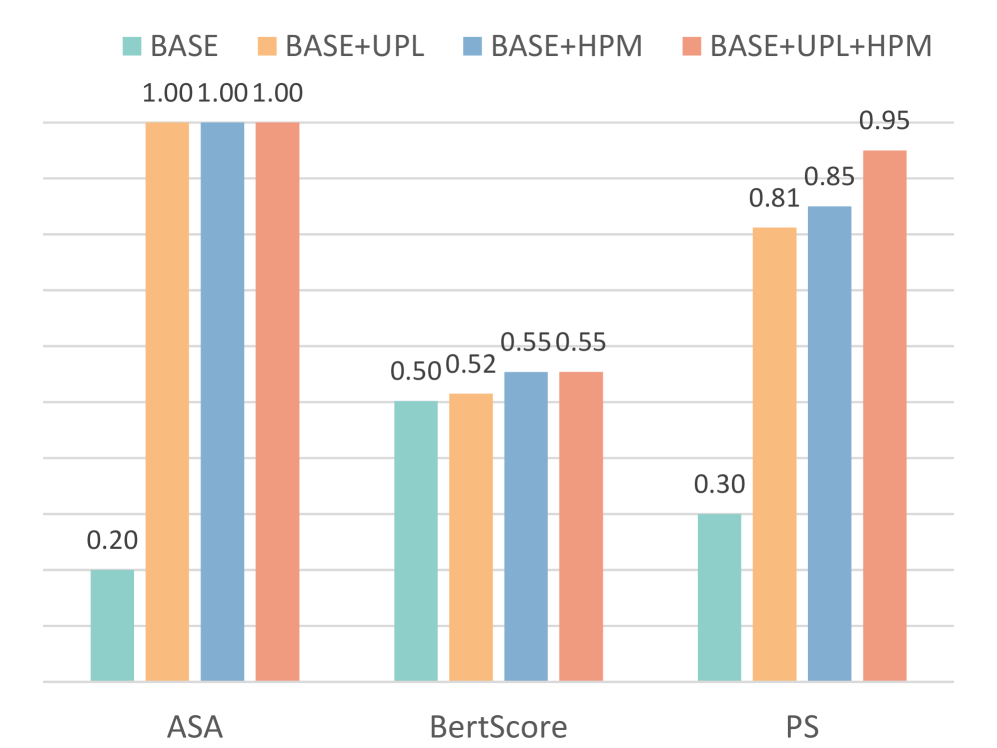

- 在User FingerTip等基准测试中,Me-Agent在个性化方面达到SOTA,同时保持了指令执行的竞争力,验证了其有效性。

📝 摘要(中文)

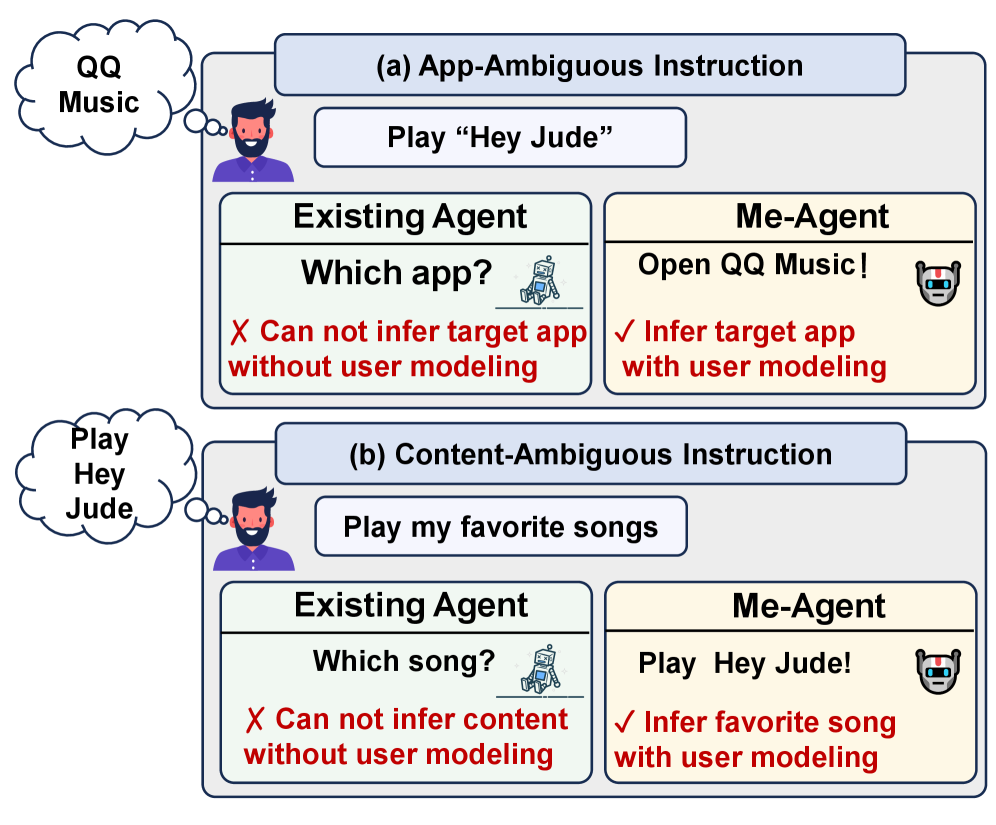

基于大型语言模型(LLM)的移动Agent在性能上取得了显著进展。然而,这些Agent通常只遵循明确的用户指令,而忽略了个性化需求,这给实际用户带来了很大的局限性,尤其是在缺乏个性化上下文的情况下:(1)无法解释模糊的指令,(2)缺乏从用户交互历史中学习的能力,(3)无法处理个性化的指令。为了缓解上述挑战,我们提出了Me-Agent,一个可学习和可记忆的个性化移动Agent。具体来说,Me-Agent采用了一种双层用户习惯学习方法。在prompt层面,我们设计了一种用户偏好学习策略,并使用个性化奖励模型来提高个性化性能。在记忆层面,我们设计了一个分层偏好记忆,它在不同层级的记忆中存储用户的长期记忆和特定于应用程序的记忆。为了验证移动Agent的个性化能力,我们引入了User FingerTip,这是一个新的基准,包含大量日常生活中的模糊指令。在User FingerTip和通用基准上的大量实验表明,Me-Agent在个性化方面实现了最先进的性能,同时保持了具有竞争力的指令执行性能。

🔬 方法详解

问题定义:现有基于大型语言模型的移动Agent在处理用户指令时,主要依赖于显式指令,缺乏对用户个性化需求的理解和适应能力。这导致Agent在面对模糊指令、用户历史交互信息以及个性化指令时表现不佳,无法提供真正个性化的服务。现有方法的痛点在于缺乏有效的用户习惯学习机制,无法将用户的长期偏好和特定应用场景下的偏好融入到Agent的决策过程中。

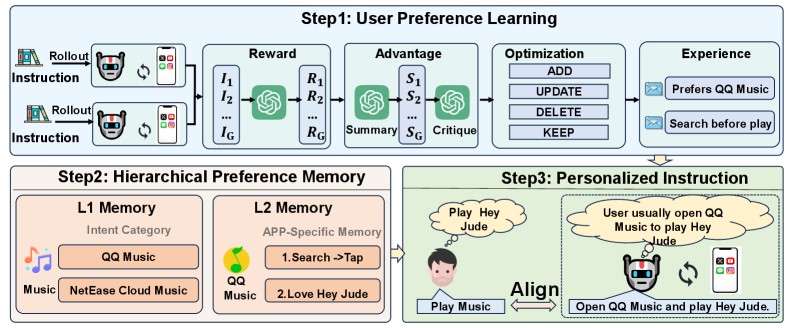

核心思路:Me-Agent的核心思路是通过双层用户习惯学习来提升Agent的个性化能力。第一层是Prompt层面的用户偏好学习,通过个性化奖励模型来优化Agent对用户指令的理解和执行。第二层是记忆层面的分层偏好记忆,用于存储用户的长期记忆和特定应用场景下的记忆,从而为Agent提供更丰富的上下文信息。这种双层结构使得Agent既能快速响应用户的即时指令,又能根据用户的长期习惯进行个性化调整。

技术框架:Me-Agent的整体框架包含以下几个主要模块:1) 指令解析模块:负责解析用户的自然语言指令。2) Prompt层面用户偏好学习模块:利用个性化奖励模型学习用户对不同指令执行结果的偏好。3) 记忆层面分层偏好记忆模块:构建和维护用户的长期记忆和特定应用场景下的记忆。4) 决策模块:根据用户指令、用户偏好和记忆信息,生成最终的执行动作。5) 执行模块:执行Agent的动作并返回结果给用户。

关键创新:Me-Agent最重要的技术创新点在于其双层用户习惯学习机制。Prompt层面的用户偏好学习能够快速适应用户的即时反馈,而记忆层面的分层偏好记忆则能够长期积累用户的个性化信息。这种双层结构使得Agent能够更好地理解用户的意图,并提供更加个性化的服务。与现有方法相比,Me-Agent能够更好地处理模糊指令和个性化指令,并能够从用户的交互历史中学习。

关键设计:在Prompt层面,个性化奖励模型的设计至关重要,需要仔细选择奖励信号和训练方法,以确保模型能够准确捕捉用户的偏好。在记忆层面,分层偏好记忆的结构和更新策略需要仔细设计,以确保记忆信息的有效性和时效性。此外,决策模块需要有效地融合来自Prompt层面和记忆层面的信息,以生成最佳的执行动作。具体的参数设置、损失函数和网络结构等技术细节需要在实验中进行仔细调整和优化。

🖼️ 关键图片

📊 实验亮点

Me-Agent在User FingerTip基准测试中取得了显著的性能提升,尤其是在处理模糊指令和个性化指令方面。实验结果表明,Me-Agent在个性化指标上超越了现有方法,同时保持了具有竞争力的指令执行性能。这些结果充分验证了Me-Agent双层用户习惯学习机制的有效性。

🎯 应用场景

Me-Agent具有广泛的应用前景,例如智能家居控制、个性化推荐系统、智能客服、辅助驾驶等。它可以根据用户的个人习惯和偏好,提供更加智能、便捷和个性化的服务。未来,Me-Agent有望成为人们日常生活中不可或缺的智能助手,极大地提升生活质量和工作效率。

📄 摘要(原文)

Large Language Model (LLM)-based mobile agents have made significant performance advancements. However, these agents often follow explicit user instructions while overlooking personalized needs, leading to significant limitations for real users, particularly without personalized context: (1) inability to interpret ambiguous instructions, (2) lack of learning from user interaction history, and (3) failure to handle personalized instructions. To alleviate the above challenges, we propose Me-Agent, a learnable and memorable personalized mobile agent. Specifically, Me-Agent incorporates a two-level user habit learning approach. At the prompt level, we design a user preference learning strategy enhanced with a Personal Reward Model to improve personalization performance. At the memory level, we design a Hierarchical Preference Memory, which stores users' long-term memory and app-specific memory in different level memory. To validate the personalization capabilities of mobile agents, we introduce User FingerTip, a new benchmark featuring numerous ambiguous instructions for daily life. Extensive experiments on User FingerTip and general benchmarks demonstrate that Me-Agent achieves state-of-the-art performance in personalization while maintaining competitive instruction execution performance.