DiaDem: Advancing Dialogue Descriptions in Audiovisual Video Captioning for Multimodal Large Language Models

作者: Xinlong Chen, Weihong Lin, Jingyun Hua, Linli Yao, Yue Ding, Bozhou Li, Bohan Zeng, Yang Shi, Qiang Liu, Yuanxing Zhang, Pengfei Wan, Liang Wang, Tieniu Tan

分类: cs.CL

发布日期: 2026-01-27

备注: Project webpage: https://diadem-captioner.github.io/

💡 一句话要点

DiaDem:一种用于多模态大语言模型的音视频视频字幕生成模型,提升对话描述的准确性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 音视频字幕生成 多模态学习 对话描述 大语言模型 GRPO 数据集合成 难度分区训练

📋 核心要点

- 现有音视频字幕模型在对话描述方面存在不足,难以生成准确的对话内容。

- DiaDem模型通过合成高质量数据集和采用难度分区的两阶段GRPO策略来提升对话描述的准确性。

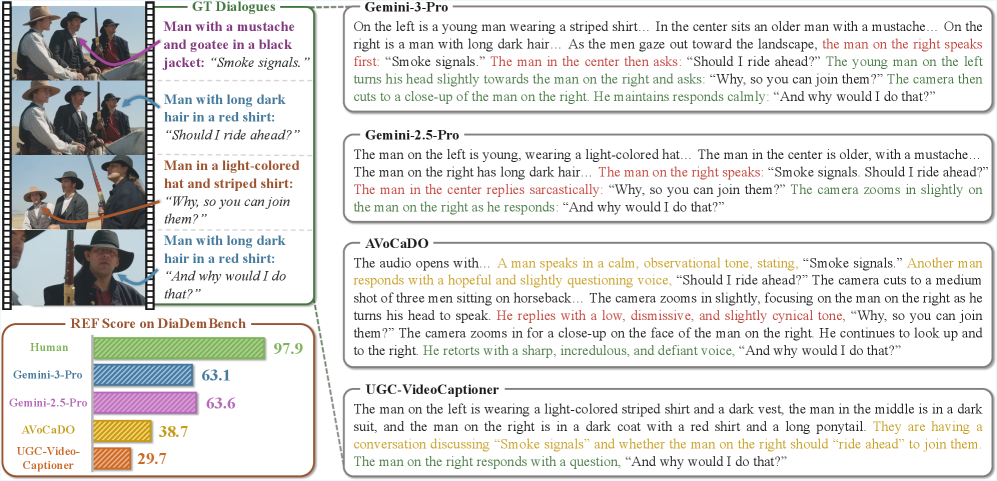

- DiaDem在对话描述准确性上优于Gemini系列,并在通用音视频字幕生成基准上表现出竞争力。

📝 摘要(中文)

本文提出了一种名为DiaDem的音视频视频字幕生成模型,旨在提高字幕中对话描述的准确性,同时保持整体性能。该模型首先合成了高质量的SFT数据集,然后采用了一种难度分区的两阶段GRPO策略来进一步增强对话描述能力。为了系统地评估对话描述能力,作者引入了DiaDemBench,这是一个综合性的基准,用于评估模型在各种对话场景中的表现,重点关注音视频字幕中的说话人归属准确性和话语转录保真度。在DiaDemBench上的大量实验表明,即使是商业模型在对话感知字幕生成方面仍有很大的改进空间。值得注意的是,DiaDem不仅在对话描述准确性方面优于Gemini系列,而且在通用音视频字幕生成基准上实现了具有竞争力的性能,证明了其整体有效性。

🔬 方法详解

问题定义:现有音视频视频字幕生成模型在处理包含对话的视频时,往往难以准确地描述对话内容,包括说话人身份的正确归属以及对话内容的精确转录。这限制了模型在需要理解和生成对话相关信息的下游任务中的应用,例如视频摘要、问答等。现有方法的痛点在于缺乏足够的高质量训练数据,以及缺乏针对对话描述的优化策略。

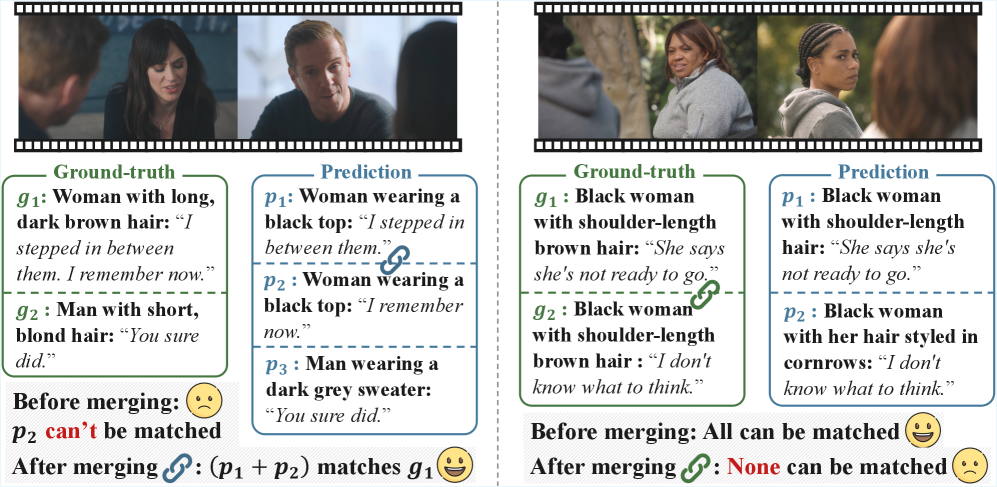

核心思路:DiaDem的核心思路是通过构建高质量的对话数据集,并设计专门的训练策略来提升模型对对话的理解和生成能力。具体来说,首先合成一个高质量的SFT数据集,用于初步提升模型的对话描述能力。然后,采用一种难度分区的两阶段GRPO(Gradient-Regularized Policy Optimization)策略,进一步优化模型在不同难度对话场景下的表现。

技术框架:DiaDem的整体框架基于现有的音视频字幕生成模型,并在其基础上进行了改进。主要包含以下几个模块:1) 视频和音频特征提取模块:用于提取视频和音频的视觉和听觉特征。2) 对话数据集构建模块:用于合成高质量的对话数据集。3) 模型训练模块:使用SFT和GRPO策略对模型进行训练。4) 字幕生成模块:根据提取的特征和训练好的模型生成字幕。

关键创新:DiaDem的关键创新点在于:1) 合成高质量的对话数据集,弥补了现有数据集的不足。2) 提出了一种难度分区的两阶段GRPO策略,能够更好地优化模型在不同难度对话场景下的表现。3) 构建了DiaDemBench基准,用于系统地评估模型在对话描述方面的能力。

关键设计:在数据集构建方面,作者采用了数据增强和过滤策略,以保证数据集的质量。在GRPO策略中,作者将对话场景分为不同的难度级别,并针对不同难度级别采用不同的优化目标。在DiaDemBench基准中,作者设计了多种评估指标,包括说话人归属准确性和话语转录保真度。

🖼️ 关键图片

📊 实验亮点

DiaDem在DiaDemBench基准测试中,对话描述准确性显著优于Gemini系列模型,证明了其在对话感知字幕生成方面的优越性。同时,DiaDem在通用音视频字幕生成基准上实现了具有竞争力的性能,表明其在提升对话描述能力的同时,没有牺牲整体的字幕生成质量。实验结果表明,即使是商业模型在对话感知字幕生成方面仍有很大的改进空间。

🎯 应用场景

DiaDem模型可应用于多种场景,例如:自动生成电影、电视剧、新闻等视频的字幕,提高视频的可访问性;辅助视频内容理解,例如视频摘要、视频问答等;应用于智能客服、虚拟助手等领域,提升人机对话的自然性和准确性。该研究的成果有助于推动多模态大语言模型在音视频领域的应用,并为未来的研究提供参考。

📄 摘要(原文)

Accurate dialogue description in audiovisual video captioning is crucial for downstream understanding and generation tasks. However, existing models generally struggle to produce faithful dialogue descriptions within audiovisual captions. To mitigate this limitation, we propose DiaDem, a powerful audiovisual video captioning model capable of generating captions with more precise dialogue descriptions while maintaining strong overall performance. We first synthesize a high-quality dataset for SFT, then employ a difficulty-partitioned two-stage GRPO strategy to further enhance dialogue descriptions. To enable systematic evaluation of dialogue description capabilities, we introduce DiaDemBench, a comprehensive benchmark designed to evaluate models across diverse dialogue scenarios, emphasizing both speaker attribution accuracy and utterance transcription fidelity in audiovisual captions. Extensive experiments on DiaDemBench reveal even commercial models still exhibit substantial room for improvement in dialogue-aware captioning. Notably, DiaDem not only outperforms the Gemini series in dialogue description accuracy but also achieves competitive performance on general audiovisual captioning benchmarks, demonstrating its overall effectiveness.