Hierarchical Text Classification with LLM-Refined Taxonomies

作者: Jonas Golde, Nicolaas Jedema, Ravi Krishnan, Phong Le

分类: cs.CL

发布日期: 2026-01-26

💡 一句话要点

提出TaxMorph框架以优化层次文本分类中的模糊分类问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 层次文本分类 大型语言模型 分类法优化 语义理解 机器学习

📋 核心要点

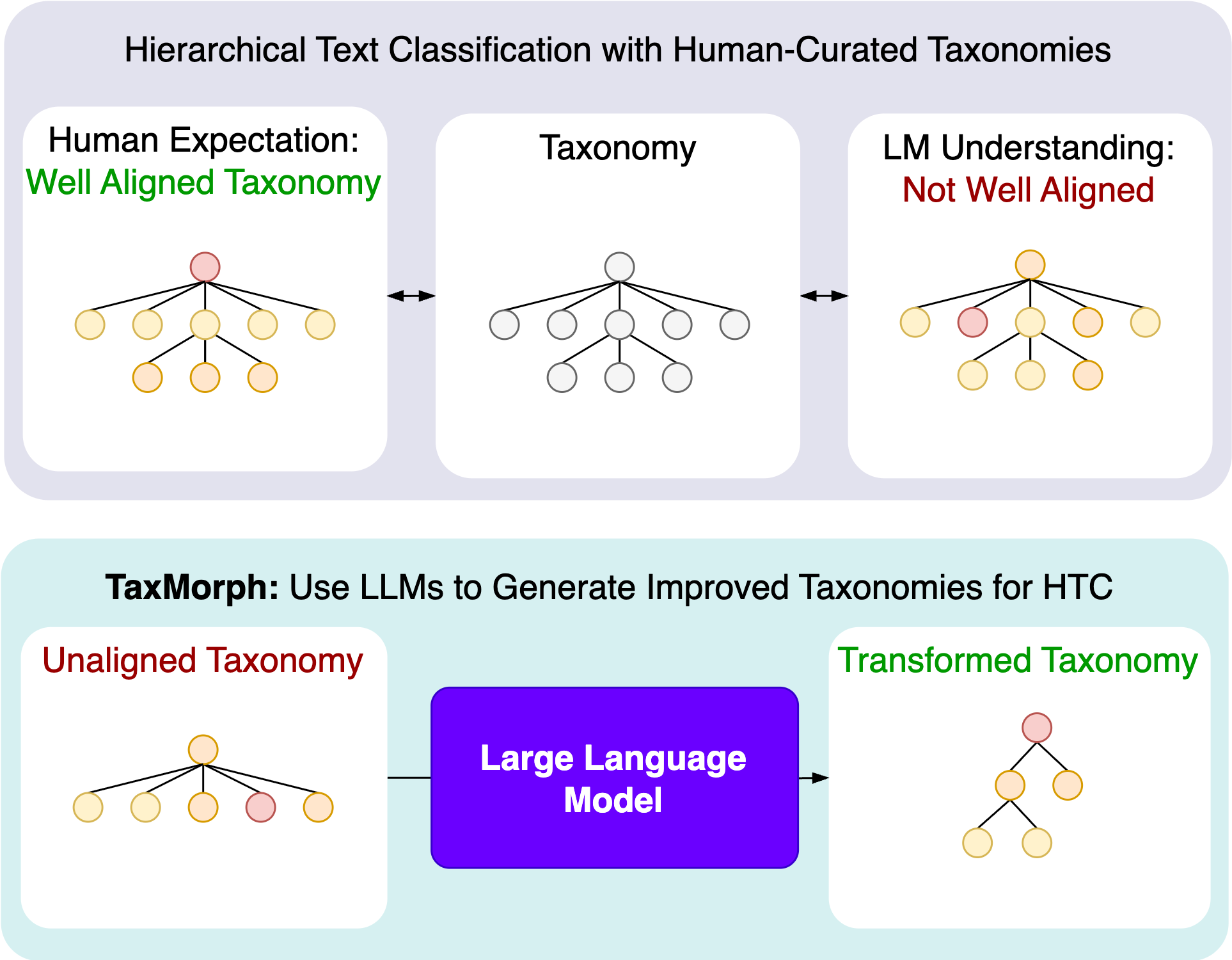

- 现有的层次文本分类方法在处理模糊分类法时存在困难,导致模型学习决策边界不清晰。

- 本文提出TaxMorph框架,利用大型语言模型对分类法进行重命名、合并等操作,以优化层次结构。

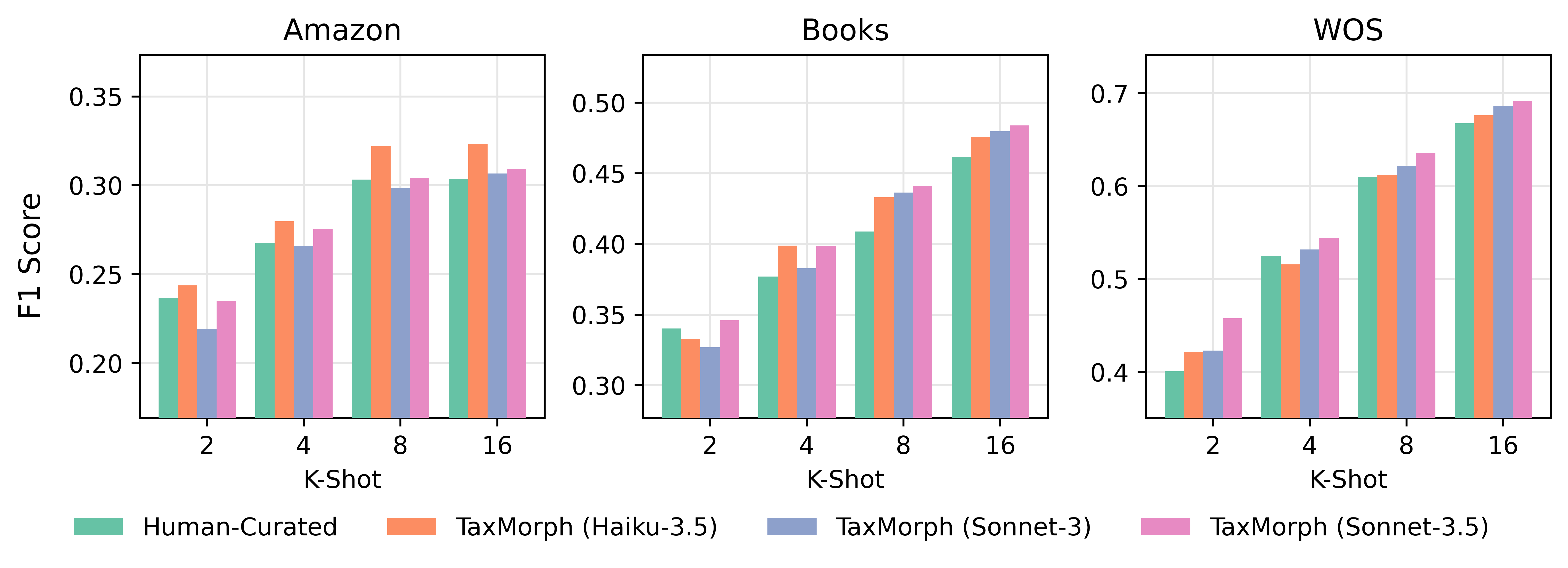

- 实验结果显示,LLM优化的分类法在多个基准测试中表现优于人工策划的分类法,F1分数提升显著。

📝 摘要(中文)

层次文本分类(HTC)依赖于将标签组织成结构化层次的分类法。然而,许多现实世界的分类法引入了模糊性,例如在相似父节点下存在相同的叶节点名称,这使得语言模型(LMs)难以学习清晰的决策边界。本文提出了TaxMorph框架,通过重命名、合并、拆分和重新排序等操作,利用大型语言模型(LLMs)对整个分类法进行转换。与以往工作不同,我们的方法修订了完整的层次结构,以更好地匹配LMs编码的语义。实验表明,LLM优化的分类法在多个设置中相较于人工策划的分类法在F1分数上提升了最多2.9个百分点。

🔬 方法详解

问题定义:本文旨在解决层次文本分类中因模糊分类法导致的决策边界不清晰的问题。现有方法在处理相似父节点下相同叶节点名称时,难以有效区分类别。

核心思路:论文的核心思路是通过大型语言模型对分类法进行优化,重新设计层次结构,使其更符合模型的学习方式,从而提升分类性能。

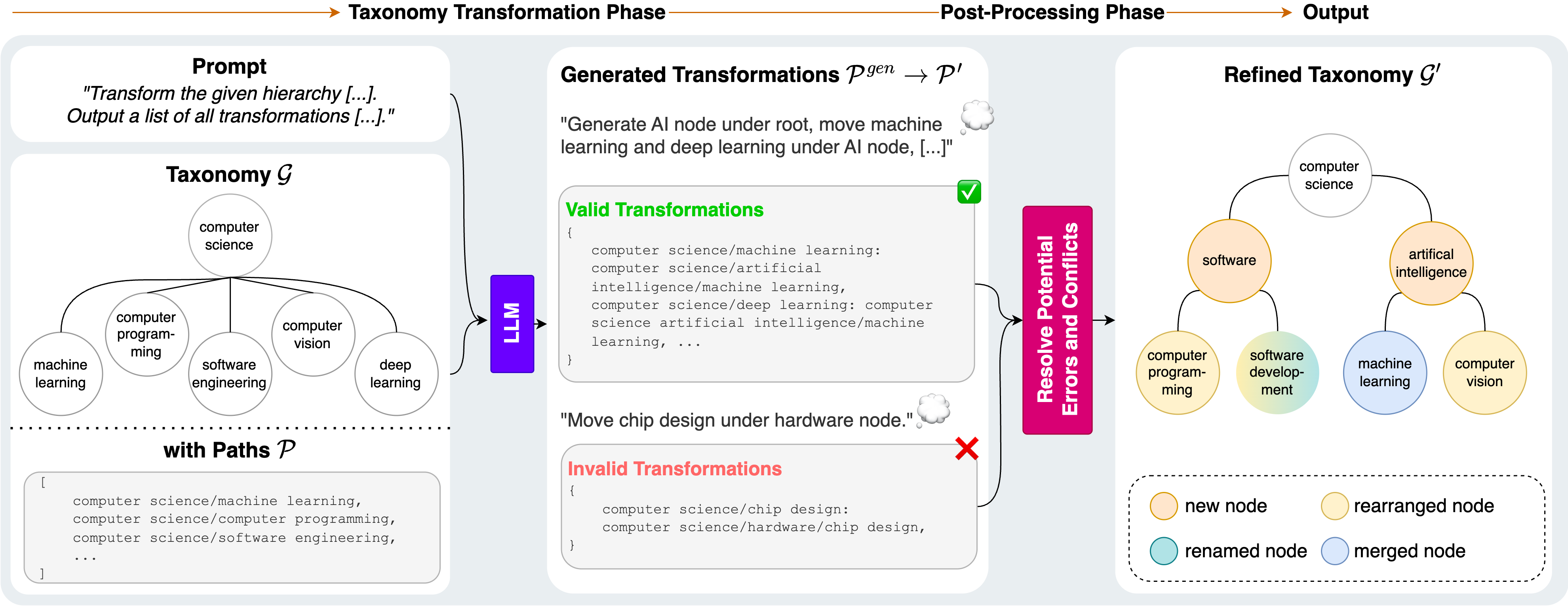

技术框架:整体框架包括四个主要模块:分类法重命名、合并、拆分和重新排序。通过这些模块,TaxMorph能够全面修订分类法,以适应模型的语义理解。

关键创新:最重要的创新点在于通过LLMs对整个层次结构进行修订,而非仅仅对单一标签进行调整。这种方法使得分类法更符合模型的实际混淆模式,从而提升了分类效果。

关键设计:在技术细节上,论文设计了特定的参数设置和损失函数,以确保模型在优化分类法时能够有效捕捉到语义信息,并通过嵌入空间的聚类分析来验证优化效果。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLM优化的分类法在三个层次文本分类基准测试中均表现出色,相较于人工策划的分类法,F1分数提升最多达到2.9个百分点。这一结果显示了LLM指导下的分类法优化在实际应用中的有效性。

🎯 应用场景

该研究的潜在应用领域包括文本分类、信息检索和自然语言处理等。通过优化层次文本分类的分类法,能够提高模型在实际应用中的分类准确性,进而提升用户体验和信息获取效率。未来,该方法可能会影响更多领域的分类系统设计,推动智能系统的进一步发展。

📄 摘要(原文)

Hierarchical text classification (HTC) depends on taxonomies that organize labels into structured hierarchies. However, many real-world taxonomies introduce ambiguities, such as identical leaf names under similar parent nodes, which prevent language models (LMs) from learning clear decision boundaries. In this paper, we present TaxMorph, a framework that uses large language models (LLMs) to transform entire taxonomies through operations such as renaming, merging, splitting, and reordering. Unlike prior work, our method revises the full hierarchy to better match the semantics encoded by LMs. Experiments across three HTC benchmarks show that LLM-refined taxonomies consistently outperform human-curated ones in various settings up to +2.9pp. in F1. To better understand these improvements, we compare how well LMs can assign leaf nodes to parent nodes and vice versa across human-curated and LLM-refined taxonomies. We find that human-curated taxonomies lead to more easily separable clusters in embedding space. However, the LLM-refined taxonomies align more closely with the model's actual confusion patterns during classification. In other words, even though they are harder to separate, they better reflect the model's inductive biases. These findings suggest that LLM-guided refinement creates taxonomies that are more compatible with how models learn, improving HTC performance.