U-Fold: Dynamic Intent-Aware Context Folding for User-Centric Agents

作者: Jin Su, Runnan Fang, Yeqiu Li, Xiaobin Wang, Shihao Cai, Pengjun Xie, Ningyu Zhang, Fajie Yuan

分类: cs.CL

发布日期: 2026-01-26

💡 一句话要点

U-Fold:面向用户中心代理的动态意图感知上下文折叠方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 上下文折叠 用户中心代理 大型语言模型 意图感知 动态摘要 工具调用 长上下文 多轮对话

📋 核心要点

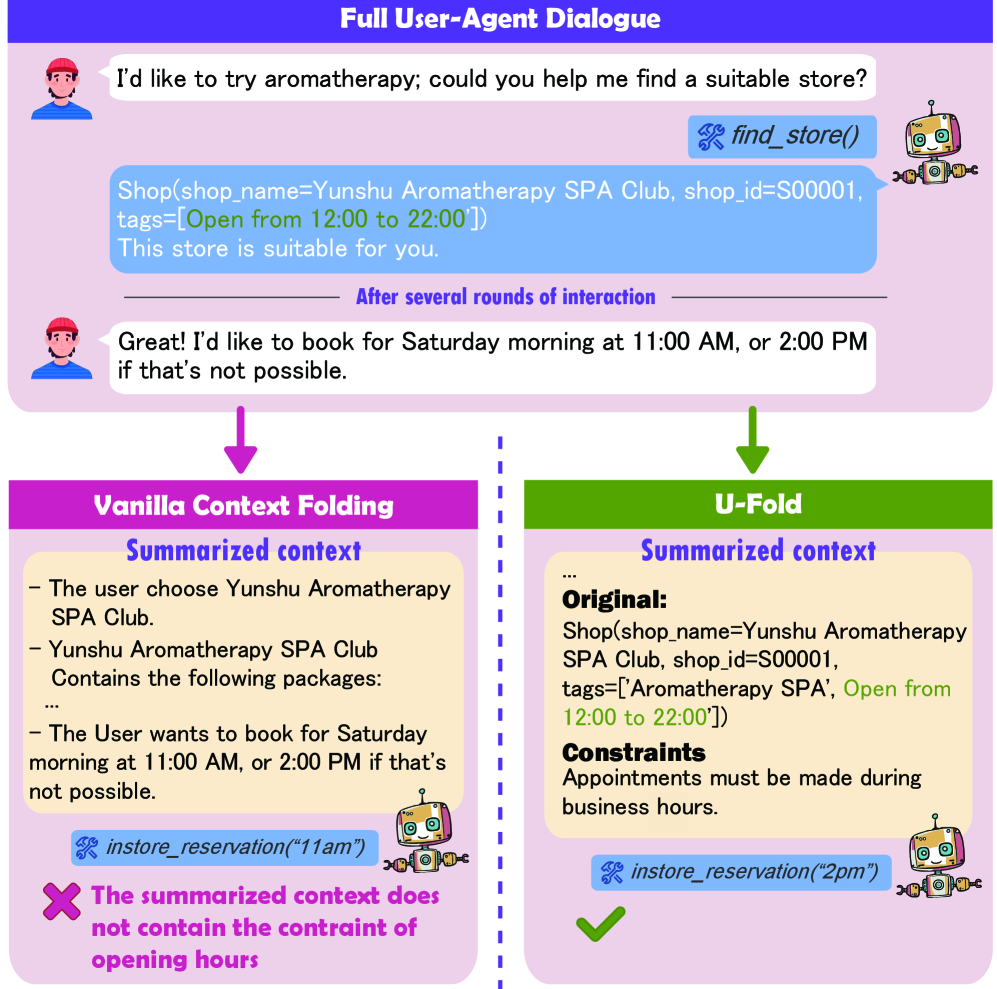

- 现有上下文折叠方法在用户中心对话中,会不可逆地丢弃细粒度约束和中间事实,影响后续决策。

- U-Fold通过动态生成意图感知的对话摘要和任务相关的工具日志,保留关键信息并跟踪用户意图。

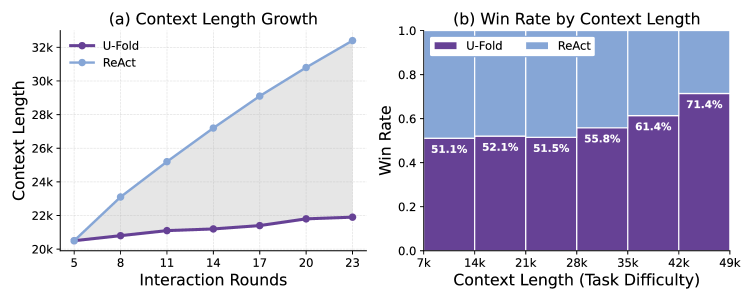

- 实验表明,U-Fold在长上下文、多轮对话任务中显著优于ReAct和现有上下文折叠基线,提升高达27%。

📝 摘要(中文)

基于大型语言模型(LLM)的代理已成功应用于许多工具增强场景,但其可扩展性受到上下文长度的根本限制。现有的上下文折叠方法通过总结过去的交互来缓解这个问题,但它们通常是为单查询或单意图场景设计的。在更真实的用户中心对话中,我们发现了两个主要的失败模式:(i)它们不可逆转地丢弃了对后续决策至关重要的细粒度约束和中间事实,以及(ii)它们的摘要未能跟踪不断变化的用户意图,导致遗漏和错误操作。为了解决这些限制,我们提出了U-Fold,这是一个专为用户中心任务定制的动态上下文折叠框架。U-Fold保留了完整的用户-代理对话和工具调用历史,但在每个回合中,使用两个核心组件来生成一个意图感知的、不断演变的对话摘要和一个紧凑的、任务相关的工具日志。在$τ$-bench、$τ^2$-bench、VitaBench和更难的上下文膨胀设置上的大量实验表明,U-Fold始终优于ReAct(在长上下文设置中实现了71.4%的胜率)和先前的折叠基线(改进高达27.0%),尤其是在长、嘈杂、多轮任务上。我们的研究表明,U-Fold是将上下文管理技术从单查询基准转移到真实用户中心应用的有希望的一步。

🔬 方法详解

问题定义:论文旨在解决基于LLM的代理在用户中心对话中,由于上下文长度限制而导致的可扩展性问题。现有上下文折叠方法在处理多轮、多意图对话时,会丢失重要的细粒度信息和未能准确跟踪用户意图,从而影响代理的决策质量。

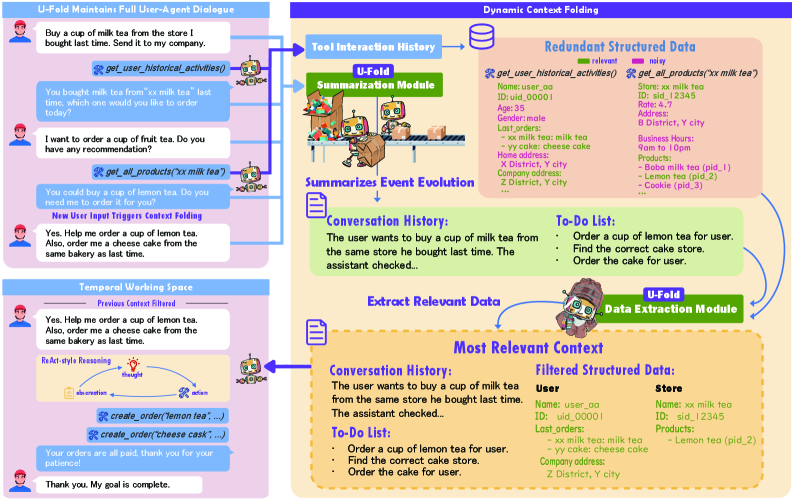

核心思路:U-Fold的核心思路是动态地、意图感知地折叠上下文。它保留完整的对话历史,并在每个回合动态生成一个意图感知的对话摘要和一个任务相关的工具日志。这种方式既能压缩上下文长度,又能保留关键信息,并准确跟踪用户意图的演变。

技术框架:U-Fold框架包含两个主要组件:1) 意图感知的对话摘要生成器:负责根据当前对话状态和用户意图,生成一个精简但信息丰富的对话摘要。2) 任务相关的工具日志生成器:负责记录与当前任务相关的工具调用历史,过滤掉无关信息。这两个组件共同作用,生成一个压缩且信息丰富的上下文表示,供代理进行决策。

关键创新:U-Fold的关键创新在于其动态性和意图感知能力。与静态的上下文折叠方法不同,U-Fold在每个回合都动态地更新上下文摘要和工具日志,从而能够更好地跟踪用户意图的演变。此外,U-Fold还显式地考虑了用户意图,从而能够更准确地过滤掉无关信息,保留关键信息。

关键设计:U-Fold的具体实现细节(如摘要生成器的网络结构、损失函数等)在论文中可能没有详细描述,属于未知信息。但其核心设计思想是利用LLM的强大能力,结合用户意图,动态地生成上下文摘要和工具日志。

🖼️ 关键图片

📊 实验亮点

U-Fold在$τ$-bench、$τ^2$-bench和VitaBench等基准测试中取得了显著的性能提升。在长上下文设置中,U-Fold的胜率比ReAct高出71.4%。与先前的上下文折叠基线相比,U-Fold的性能提升高达27.0%,尤其是在长、嘈杂、多轮任务上表现突出,证明了其在复杂用户中心对话场景中的有效性。

🎯 应用场景

U-Fold可应用于各种需要长期对话和复杂任务规划的用户中心代理场景,例如智能客服、虚拟助手、自动化流程管理等。通过有效管理上下文,U-Fold能够提升代理的对话质量、任务完成度和用户满意度,并降低计算成本,具有重要的实际应用价值和广阔的发展前景。

📄 摘要(原文)

Large language model (LLM)-based agents have been successfully deployed in many tool-augmented settings, but their scalability is fundamentally constrained by context length. Existing context-folding methods mitigate this issue by summarizing past interactions, yet they are typically designed for single-query or single-intent scenarios. In more realistic user-centric dialogues, we identify two major failure modes: (i) they irreversibly discard fine-grained constraints and intermediate facts that are crucial for later decisions, and (ii) their summaries fail to track evolving user intent, leading to omissions and erroneous actions. To address these limitations, we propose U-Fold, a dynamic context-folding framework tailored to user-centric tasks. U-Fold retains the full user--agent dialogue and tool-call history but, at each turn, uses two core components to produce an intent-aware, evolving dialogue summary and a compact, task-relevant tool log. Extensive experiments on $τ$-bench, $τ^2$-bench, VitaBench, and harder context-inflated settings show that U-Fold consistently outperforms ReAct (achieving a 71.4% win rate in long-context settings) and prior folding baselines (with improvements of up to 27.0%), particularly on long, noisy, multi-turn tasks. Our study demonstrates that U-Fold is a promising step toward transferring context-management techniques from single-query benchmarks to realistic user-centric applications.