White-Box Sensitivity Auditing with Steering Vectors

作者: Hannah Cyberey, Yangfeng Ji, David Evans

分类: cs.CY, cs.CL, cs.LG

发布日期: 2026-01-23

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于激活向量调控的白盒敏感性审计框架,用于评估LLM中的潜在偏见。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 白盒审计 敏感性分析 激活向量调控 偏见检测

📋 核心要点

- 现有LLM审计主要依赖黑盒方法,测试用例生成依赖启发式,难以有效评估抽象的社会属性(如偏见)。

- 提出白盒敏感性审计框架,通过激活向量调控模型内部状态,进行更细粒度的敏感性分析。

- 在模拟高风险决策任务中,该方法能有效揭示模型对受保护属性的依赖,优于传统黑盒方法。

📝 摘要(中文)

算法审计是检查系统是否满足监管要求或操作者期望属性的关键工具。目前对大型语言模型(LLM)的审计主要依赖于黑盒评估,仅通过输入-输出测试来评估模型行为。这些方法仅限于在输入空间中构建的测试,通常由启发式方法生成。此外,许多与社会相关的模型属性(例如,性别偏见)是抽象的,难以仅通过基于文本的输入来衡量。为了解决这些限制,我们提出了一种用于LLM的白盒敏感性审计框架,该框架利用激活向量调控,通过模型内部进行更严格的评估。我们的审计方法通过操纵与模型预期功能相关的关键概念来进行内部敏感性测试。我们展示了其在四个模拟的高风险LLM决策任务中进行偏见审计的应用。我们的方法始终揭示了模型预测中对受保护属性的显着依赖性,即使在标准黑盒评估表明几乎没有偏见的情况下也是如此。我们的代码已在https://github.com/hannahxchen/llm-steering-audit上公开。

🔬 方法详解

问题定义:现有大型语言模型(LLM)的审计方法主要采用黑盒测试,即通过输入输出来评估模型性能。这种方法依赖于人工设计的输入样本,难以覆盖所有可能的场景,尤其是在评估模型是否存在社会偏见等抽象属性时,黑盒测试的有效性会大打折扣。此外,黑盒方法无法深入了解模型内部的决策过程,难以定位偏见的根源。

核心思路:该论文的核心思路是利用LLM的内部激活状态(即激活向量)来审计模型的敏感性。通过操纵与特定概念(如性别、种族等)相关的激活向量,可以观察模型输出的变化,从而判断模型是否对这些概念存在偏见。这种方法类似于在模型内部进行“手术”,直接干预模型的决策过程,从而更准确地评估模型的行为。

技术框架:该白盒审计框架主要包含以下几个步骤:1) 确定审计目标:明确需要审计的社会属性(如性别、种族等)。2) 识别关键概念:找到与审计目标相关的关键概念,例如“男性”、“女性”等。3) 获取激活向量:针对每个关键概念,获取其在模型内部的激活向量。这可以通过分析大量文本数据,找到与该概念相关的激活模式来实现。4) 调控激活向量:通过修改或替换激活向量,模拟不同的场景。例如,将“男性”的激活向量替换为“女性”的激活向量。5) 评估模型输出:观察模型在调控激活向量后的输出变化,判断模型是否对该属性敏感。

关键创新:该论文的关键创新在于将激活向量调控技术应用于LLM的审计。与传统的黑盒测试相比,该方法能够深入了解模型内部的决策过程,更准确地评估模型是否存在偏见。此外,该方法还可以用于定位偏见的根源,为模型改进提供指导。

关键设计:论文中没有详细描述具体的参数设置、损失函数或网络结构,因为该方法主要关注的是如何利用现有的LLM进行审计,而不是如何训练新的LLM。关键的设计在于如何有效地获取和调控激活向量,这需要对LLM的内部结构有深入的了解,并需要设计合适的算法来识别与特定概念相关的激活模式。具体的实现细节可能因不同的LLM而异。

🖼️ 关键图片

📊 实验亮点

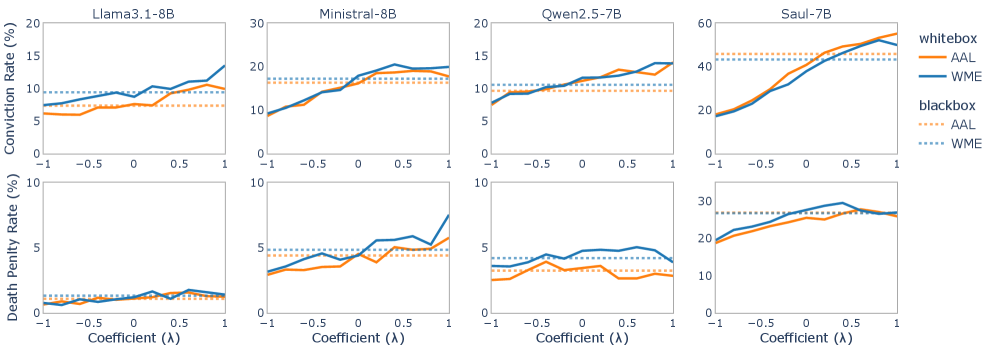

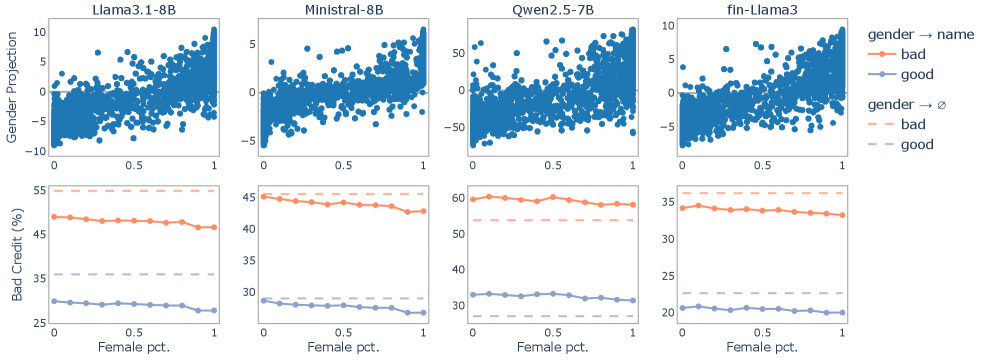

实验结果表明,该白盒审计方法能够揭示传统黑盒评估难以发现的偏见。在四个模拟的高风险LLM决策任务中,该方法均能检测到模型对受保护属性的显著依赖,即使黑盒评估显示偏见很小或没有偏见。这表明该方法能够更准确地评估LLM的公平性,为模型改进提供更可靠的依据。

🎯 应用场景

该研究成果可应用于各种需要评估LLM公平性和公正性的场景,例如招聘、信贷评估、法律咨询等。通过白盒审计,可以更有效地发现和消除模型中的偏见,提高模型的可信度和可靠性,避免因模型偏见而造成的社会不公。未来,该方法可以推广到其他类型的机器学习模型,为算法公平性研究提供更强大的工具。

📄 摘要(原文)

Algorithmic audits are essential tools for examining systems for properties required by regulators or desired by operators. Current audits of large language models (LLMs) primarily rely on black-box evaluations that assess model behavior only through input-output testing. These methods are limited to tests constructed in the input space, often generated by heuristics. In addition, many socially relevant model properties (e.g., gender bias) are abstract and difficult to measure through text-based inputs alone. To address these limitations, we propose a white-box sensitivity auditing framework for LLMs that leverages activation steering to conduct more rigorous assessments through model internals. Our auditing method conducts internal sensitivity tests by manipulating key concepts relevant to the model's intended function for the task. We demonstrate its application to bias audits in four simulated high-stakes LLM decision tasks. Our method consistently reveals substantial dependence on protected attributes in model predictions, even in settings where standard black-box evaluations suggest little or no bias. Our code is openly available at https://github.com/hannahxchen/llm-steering-audit