Cross-Lingual Activation Steering for Multilingual Language Models

作者: Rhitabrat Pokharel, Ameeta Agrawal, Tanay Nagar

分类: cs.CL, cs.AI

发布日期: 2026-01-23

备注: Under review

💡 一句话要点

提出跨语言激活调控(CLAS)方法,提升多语言模型在低资源语言上的性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多语言模型 跨语言迁移 激活调控 低资源语言 推理时干预

📋 核心要点

- 多语言模型在不同语言上的表现差异大,低资源语言性能明显落后。

- 论文提出CLAS方法,通过在推理时选择性地调节神经元激活来改善低资源语言性能。

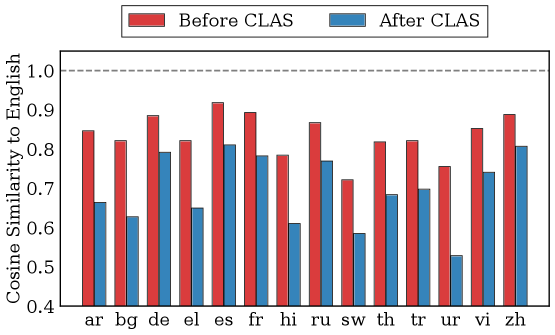

- 实验表明,CLAS在分类和生成任务上分别提升了2.3%和3.4%,且不影响高资源语言性能。

📝 摘要(中文)

大型语言模型展现出强大的多语言能力,但主要语言和非主要语言之间的性能差距仍然显著。先前的工作将这种差距归因于多语言表示中共享神经元和特定语言神经元之间的不平衡。我们提出了跨语言激活调控(CLAS),这是一种无需训练的推理时干预方法,可以选择性地调节神经元的激活。我们在分类和生成基准上评估了CLAS,分别实现了平均2.3%(准确率)和3.4%(F1)的提升,同时保持了高资源语言的性能。我们发现有效的迁移是通过功能差异而不是严格对齐来实现的;性能提升与语言簇分离的增加相关。我们的结果表明,有针对性的激活调控可以释放现有模型中潜在的多语言能力,而无需修改模型权重。

🔬 方法详解

问题定义:多语言模型在不同语言上的表现存在显著差距,尤其是在低资源语言上。现有方法通常侧重于模型训练阶段的改进,例如数据增强或模型结构调整,但这些方法往往需要大量的计算资源和重新训练。论文旨在解决如何在不修改模型权重的情况下,提升多语言模型在低资源语言上的性能。

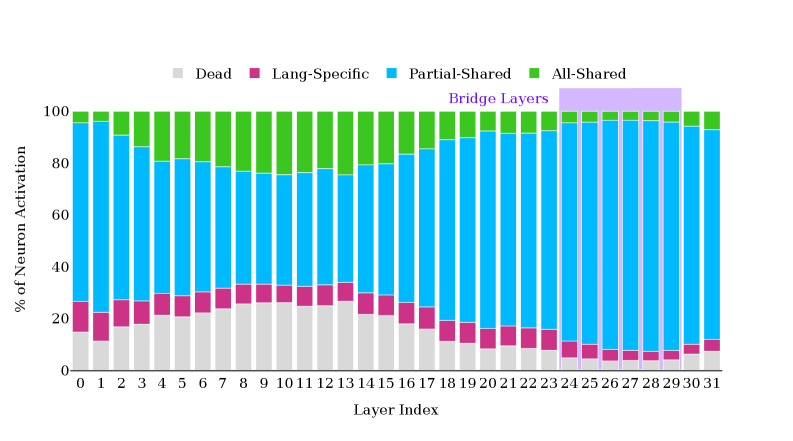

核心思路:论文的核心思路是通过在推理阶段对神经元的激活进行选择性调控,从而更好地利用模型中已有的多语言知识。作者认为,模型中存在一些神经元对特定语言更敏感,而另一些神经元则负责共享的语言特征。通过调整这些神经元的激活,可以增强模型对低资源语言的理解和生成能力。

技术框架:CLAS方法主要包含以下几个步骤:1) 确定需要调控的神经元集合。这可以通过分析不同语言的激活模式来实现。2) 设计调控策略,即如何调整这些神经元的激活值。论文探索了多种调控策略,例如增加或减少激活值。3) 在推理阶段应用调控策略,并评估模型在不同语言上的性能。整个过程无需重新训练模型,可以在推理阶段即插即用。

关键创新:CLAS的关键创新在于提出了一种无需训练的推理时干预方法,通过选择性地调节神经元的激活来提升多语言模型的性能。与现有方法相比,CLAS具有更高的效率和灵活性,可以方便地应用于各种预训练模型。此外,论文还发现有效的跨语言迁移是通过功能差异而不是严格对齐来实现的,这为多语言模型的研究提供了新的视角。

关键设计:论文中,神经元集合的选择基于不同语言的激活模式分析,具体方法未知。调控策略的设计探索了多种方式,例如线性缩放激活值。具体的缩放系数等参数设置未知,需要根据实验结果进行调整。损失函数没有涉及,因为该方法是推理时干预,不涉及模型训练。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CLAS方法在分类和生成任务上分别实现了平均2.3%(准确率)和3.4%(F1)的提升,同时保持了高资源语言的性能。这一结果表明,通过有针对性的激活调控,可以有效释放现有模型中潜在的多语言能力,而无需修改模型权重。此外,论文还发现性能提升与语言簇分离的增加相关,为多语言模型的研究提供了新的 insights。

🎯 应用场景

该研究成果可应用于机器翻译、跨语言信息检索、多语言文本摘要等领域。通过提升多语言模型在低资源语言上的性能,有助于打破语言障碍,促进全球范围内的信息交流和知识共享。该方法无需重新训练模型,具有很高的实用价值和推广潜力。

📄 摘要(原文)

Large language models exhibit strong multilingual capabilities, yet significant performance gaps persist between dominant and non-dominant languages. Prior work attributes this gap to imbalances between shared and language-specific neurons in multilingual representations. We propose Cross-Lingual Activation Steering (CLAS), a training-free inference-time intervention that selectively modulates neuron activations. We evaluate CLAS on classification and generation benchmarks, achieving average improvements of 2.3% (Acc.) and 3.4% (F1) respectively, while maintaining high-resource language performance. We discover that effective transfer operates through functional divergence rather than strict alignment; performance gains correlate with increased language cluster separation. Our results demonstrate that targeted activation steering can unlock latent multilingual capacity in existing models without modification to model weights.