Beyond Marginal Distributions: A Framework to Evaluate the Representativeness of Demographic-Aligned LLMs

作者: Tristan Williams, Franziska Weeber, Sebastian Padó, Alan Akbik

分类: cs.CL

发布日期: 2026-01-22

💡 一句话要点

提出评估框架,通过多元相关性分析提升人口统计对齐LLM的代表性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 价值观对齐 代表性评估 多元相关性 人口统计建模

📋 核心要点

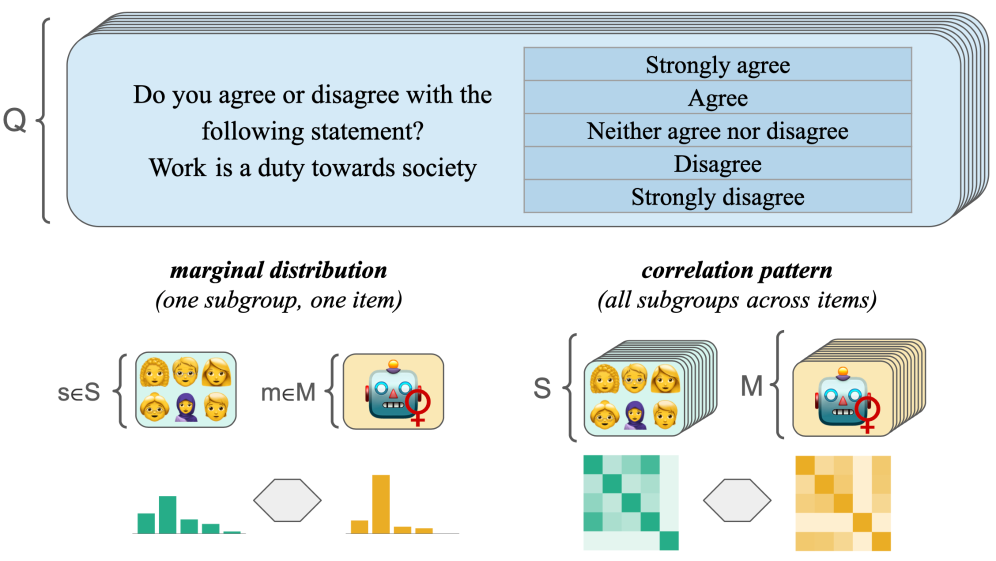

- 现有LLM对齐方法侧重于独立对齐边缘分布,忽略了人口潜在结构和文化价值观的多元相关性。

- 论文提出一种新框架,通过评估多元相关模式来衡量人口统计对齐LLM的代表性,弥补现有方法的不足。

- 实验表明,人口统计微调在边缘分布上优于角色扮演提示,但两者均未能完全捕捉真实世界的关联模式。

📝 摘要(中文)

大型语言模型越来越多地被用于表示人类的观点、价值观或信仰,而将其引导至这些理想状态是一个活跃的研究领域。现有工作主要集中在对齐边缘响应分布,独立地处理每个调查项目。虽然这很重要,但可能会忽略表征真实人口并支撑文化价值观理论的更深层潜在结构。我们提出了一个框架,通过多元相关模式以及边缘分布来评估对齐模型的代表性。通过比较两种模型引导技术(角色扮演提示和人口统计微调)并对照世界价值观调查中的人类响应进行评估,我们展示了评估方案的价值。虽然人口统计微调模型比角色扮演提示更接近边缘响应分布,但两种技术都未能完全捕捉到黄金标准的关联模式。我们得出结论,代表性是价值对齐的一个独特方面,而侧重于边缘分布的评估可能会掩盖结构性失败,从而导致对模型能力的过于乐观的结论。

🔬 方法详解

问题定义:现有的大型语言模型对齐方法,特别是针对人口统计属性的对齐,主要关注于独立地调整每个问题的边缘分布。这种方法忽略了真实世界中人口统计变量之间的复杂相关性,例如不同价值观之间的关联。因此,即使模型在单个问题上的回答与目标人群的分布一致,也可能无法捕捉到该人群的整体价值观和信念体系。现有方法的痛点在于无法保证模型在整体上具有代表性。

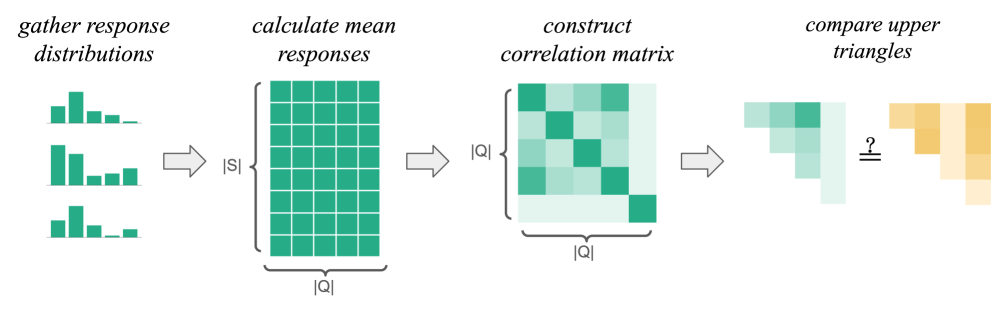

核心思路:论文的核心思路是,除了关注边缘分布之外,还应该评估模型生成响应的多元相关性模式。通过比较模型生成的响应与真实世界数据的相关性模式,可以更全面地评估模型的代表性。这种方法能够捕捉到模型是否能够模拟真实人群的价值观和信念体系的复杂结构。

技术框架:该框架主要包含以下几个步骤:1) 使用不同的模型引导技术(如角色扮演提示和人口统计微调)生成响应数据。2) 从真实世界的数据集(如世界价值观调查)中提取响应数据。3) 计算模型生成的数据和真实世界数据之间的多元相关性模式。4) 比较模型生成的相关性模式与真实世界的相关性模式,以评估模型的代表性。

关键创新:该论文最重要的技术创新点在于提出了一个评估LLM代表性的新框架,该框架不仅关注边缘分布,还关注多元相关性模式。这种方法能够更全面地评估模型是否能够模拟真实人群的价值观和信念体系的复杂结构。与现有方法相比,该框架能够更好地识别模型在代表性方面的不足。

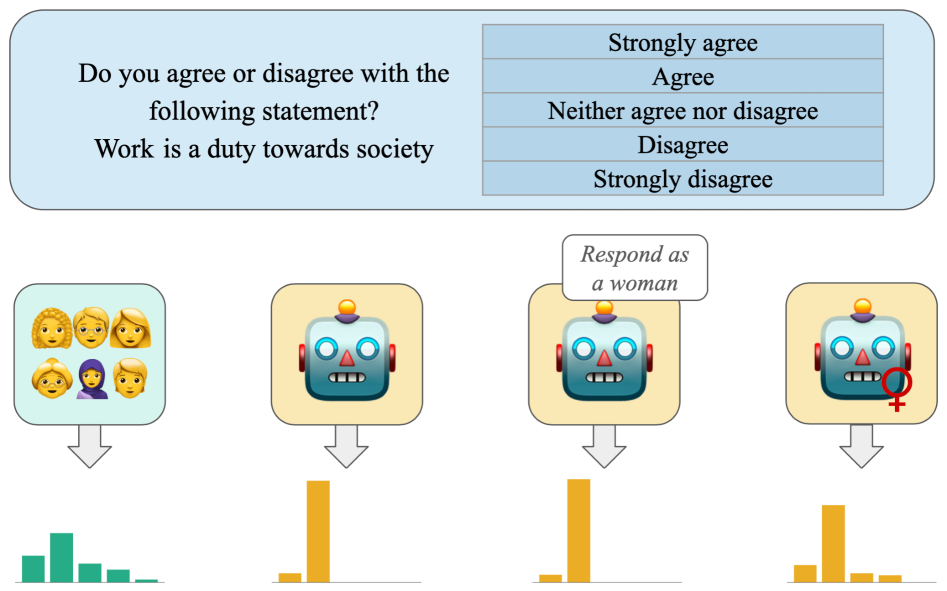

关键设计:论文使用了两种模型引导技术:角色扮演提示和人口统计微调。角色扮演提示通过向模型提供特定的人口统计信息来引导其生成响应。人口统计微调则通过在特定人口统计群体的数据上微调模型来使其更好地适应该群体的价值观和信念。论文使用了世界价值观调查作为真实世界的数据集,并使用相关性分析来比较模型生成的数据和真实世界数据之间的相关性模式。具体的参数设置和损失函数等技术细节在论文中有详细描述,此处不再赘述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,虽然人口统计微调在边缘分布上优于角色扮演提示,但两种技术都未能完全捕捉到世界价值观调查中的黄金标准相关模式。这表明,即使模型在单个问题上的回答与目标人群的分布一致,也可能无法捕捉到该人群的整体价值观和信念体系。该研究强调了评估LLM代表性的重要性,并提出了一个有价值的评估框架。

🎯 应用场景

该研究成果可应用于提升LLM在社会科学、市场调研、政策制定等领域的应用效果。通过更准确地模拟不同人群的价值观和信念,可以帮助研究人员更好地理解社会现象,企业更精准地定位目标客户,政府更有效地制定公共政策。该研究也为未来开发更具代表性和公平性的LLM提供了新的思路。

📄 摘要(原文)

Large language models are increasingly used to represent human opinions, values, or beliefs, and their steerability towards these ideals is an active area of research. Existing work focuses predominantly on aligning marginal response distributions, treating each survey item independently. While essential, this may overlook deeper latent structures that characterise real populations and underpin cultural values theories. We propose a framework for evaluating the representativeness of aligned models through multivariate correlation patterns in addition to marginal distributions. We show the value of our evaluation scheme by comparing two model steering techniques (persona prompting and demographic fine-tuning) and evaluating them against human responses from the World Values Survey. While the demographically fine-tuned model better approximates marginal response distributions than persona prompting, both techniques fail to fully capture the gold standard correlation patterns. We conclude that representativeness is a distinct aspect of value alignment and an evaluation focused on marginals can mask structural failures, leading to overly optimistic conclusions about model capabilities.