ToxiTwitch: Toward Emote-Aware Hybrid Moderation for Live Streaming Platforms

作者: Baktash Ansari, Shiza Ali, Elias Martin, Maryna Sivachenko, Afra Mashhadi

分类: cs.CL, cs.SI

发布日期: 2026-01-22

备注: Exploratory study; prior versions submitted to peer review

💡 一句话要点

ToxiTwitch:面向直播平台的表情符号感知混合型恶意内容检测

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 恶意内容检测 直播平台 表情符号 大型语言模型 混合模型

📋 核心要点

- 现有直播平台恶意内容检测方法难以有效应对快节奏、高流量和上下文丰富的聊天环境,人工审核存在扩展性问题。

- ToxiTwitch提出了一种混合模型,结合大型语言模型生成的文本和表情符号嵌入,以及传统机器学习分类器,提升恶意内容检测效果。

- 实验结果表明,ToxiTwitch在特定频道训练下,准确率达到80%,相比BERT提升13%,F1值达到76%,验证了该方法的有效性。

📝 摘要(中文)

Twitch等直播平台的快速发展给恶意行为的监管带来了复杂的挑战。传统的人工标注和基于关键词过滤等方法已经显示出一定的作用,但Twitch上的人工审核员在快节奏、高流量和上下文丰富的聊天环境中,不断挣扎于如何有效地扩展规模,同时他们自身也面临着骚扰。DeepSeek-R1-Distill和Llama-3-8B-Instruct等大型语言模型(LLM)的最新进展为恶意内容检测提供了新的机会,尤其是在理解涉及表情符号的细微多模态交流方面。本文对针对Twitch定制的恶意内容检测方法进行了探索性比较。分析表明,结合表情符号可以提高恶意行为的检测效果。为此,我们提出了ToxiTwitch,一种混合模型,它将LLM生成的文本和表情符号嵌入与包括随机森林和SVM在内的传统机器学习分类器相结合。在我们的案例研究中,所提出的混合方法在特定频道训练下达到了高达80%的准确率(比BERT提高了13%,F1值为76%)。这项工作是一项探索性研究,旨在揭示Twitch上表情符号感知恶意内容检测的挑战和局限性。

🔬 方法详解

问题定义:论文旨在解决直播平台(特别是Twitch)上恶意内容检测的问题。现有方法,如人工审核和关键词过滤,难以有效扩展以应对平台上海量且快速变化的聊天信息。此外,这些方法通常忽略了表情符号在表达恶意信息中的作用,导致检测效果不佳。

核心思路:论文的核心思路是利用大型语言模型(LLM)理解文本和表情符号的语义信息,并将其与传统机器学习分类器相结合,构建一个混合模型。通过同时考虑文本和表情符号,模型可以更准确地识别恶意内容,尤其是在包含讽刺、隐喻等复杂表达的情况下。

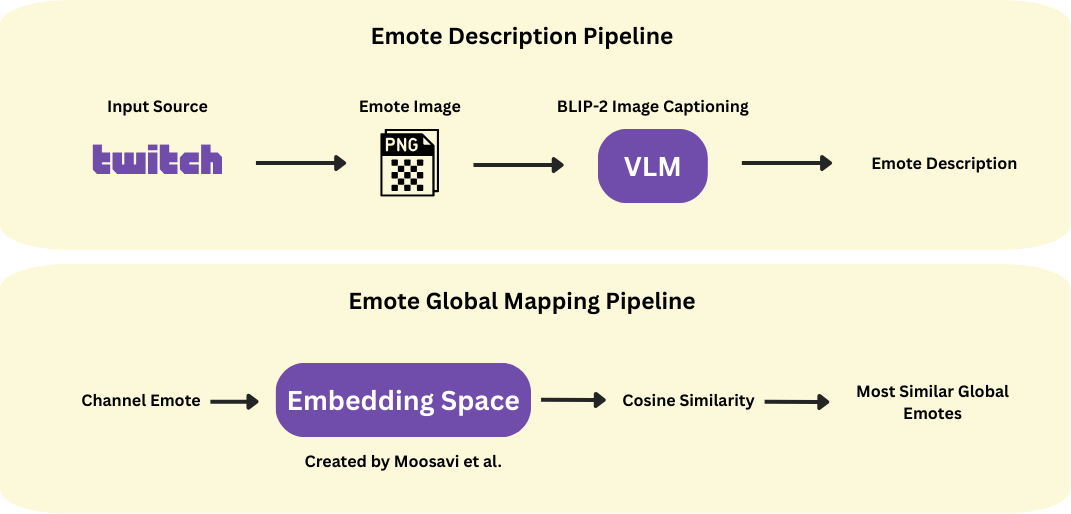

技术框架:ToxiTwitch模型主要包含以下几个阶段:1) 数据预处理:对聊天文本进行清洗和标准化,提取文本和表情符号。2) 特征提取:使用LLM(如DeepSeek-R1-Distill或Llama-3-8B-Instruct)生成文本和表情符号的嵌入向量。3) 模型训练:将文本和表情符号的嵌入向量输入到传统机器学习分类器(如随机森林或SVM)中进行训练。4) 恶意内容检测:使用训练好的模型对新的聊天信息进行分类,判断其是否包含恶意内容。

关键创新:论文的关键创新在于提出了一个表情符号感知的混合模型,该模型能够同时利用文本和表情符号的信息进行恶意内容检测。与仅使用文本信息的模型相比,ToxiTwitch能够更准确地识别恶意内容,尤其是在包含表情符号的情况下。

关键设计:论文中,LLM的选择和嵌入向量的生成方式是关键设计。研究者尝试了不同的LLM,并比较了它们在恶意内容检测任务上的性能。此外,分类器的选择和参数设置也对模型的最终效果有重要影响。论文还强调了特定频道训练的重要性,即使用特定频道的数据对模型进行微调,可以进一步提高模型的准确率。

🖼️ 关键图片

📊 实验亮点

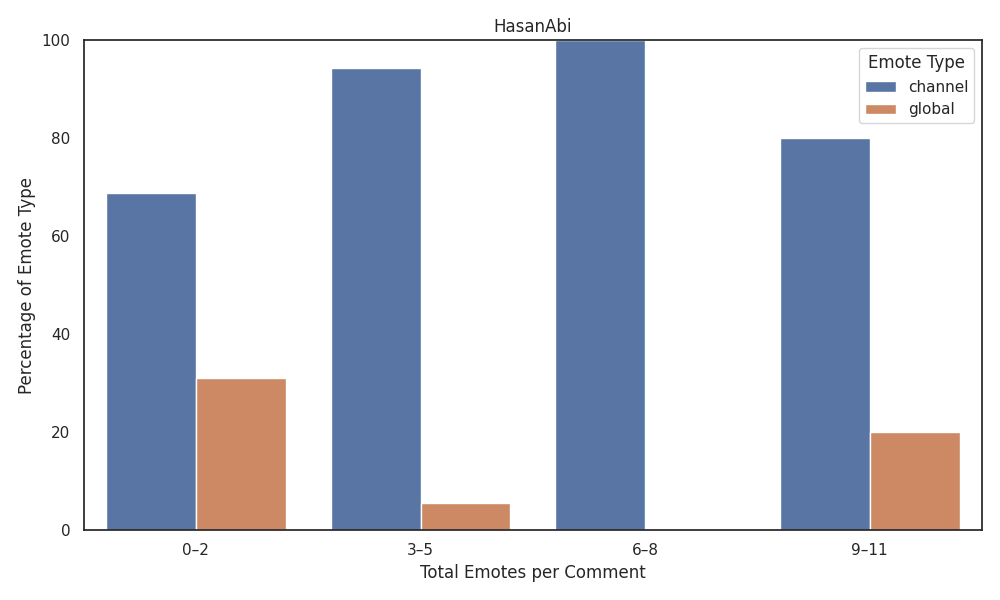

实验结果表明,ToxiTwitch在特定频道训练下,准确率达到80%,相比于仅使用文本信息的BERT模型,准确率提升了13%,F1值达到76%。这表明,结合表情符号信息能够显著提高恶意内容检测的性能。该研究强调了表情符号在恶意内容表达中的重要性,并为未来的研究提供了新的方向。

🎯 应用场景

ToxiTwitch可应用于各类直播平台,提升恶意内容检测的准确性和效率,减轻人工审核的压力。该研究成果有助于构建更健康、积极的在线社区环境,减少网络暴力和骚扰行为。未来,该方法可扩展到其他社交媒体平台,并与其他恶意内容检测技术相结合,形成更完善的解决方案。

📄 摘要(原文)

The rapid growth of live-streaming platforms such as Twitch has introduced complex challenges in moderating toxic behavior. Traditional moderation approaches, such as human annotation and keyword-based filtering, have demonstrated utility, but human moderators on Twitch constantly struggle to scale effectively in the fast-paced, high-volume, and context-rich chat environment of the platform while also facing harassment themselves. Recent advances in large language models (LLMs), such as DeepSeek-R1-Distill and Llama-3-8B-Instruct, offer new opportunities for toxicity detection, especially in understanding nuanced, multimodal communication involving emotes. In this work, we present an exploratory comparison of toxicity detection approaches tailored to Twitch. Our analysis reveals that incorporating emotes improves the detection of toxic behavior. To this end, we introduce ToxiTwitch, a hybrid model that combines LLM-generated embeddings of text and emotes with traditional machine learning classifiers, including Random Forest and SVM. In our case study, the proposed hybrid approach reaches up to 80 percent accuracy under channel-specific training (with 13 percent improvement over BERT and F1-score of 76 percent). This work is an exploratory study intended to surface challenges and limits of emote-aware toxicity detection on Twitch.