Metadata Conditioned Large Language Models for Localization

作者: Anjishnu Mukherjee, Ziwei Zhu, Antonios Anastasopoulos

分类: cs.CL

发布日期: 2026-01-21

备注: under review

💡 一句话要点

提出元数据条件化大语言模型,提升模型在特定地理区域的性能且不牺牲跨区域泛化能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 元数据条件化 本地化 地理信息 预训练 指令微调 新闻数据

📋 核心要点

- 现有大语言模型训练方式忽略了地理信息,导致模型行为的地理同质化,缺乏区域针对性。

- 提出元数据条件化方法,利用URL、国家和洲等元数据,在预训练阶段引导模型学习区域特征。

- 实验表明,该方法在提升区域内性能的同时,保持了跨区域泛化能力,并提高了学习效率。

📝 摘要(中文)

大型语言模型通常被训练成将文本视为单一全局分布,这常常导致地理同质化的行为。本文研究了元数据条件化作为一种轻量级的本地化方法,从头开始在带有验证URL、国家标签和洲标签的大规模英语新闻数据上预训练了31个模型(参数规模为0.5B和1B),涵盖4个大洲和17个国家。在四个受控实验中,我们表明元数据条件化始终如一地提高了区域内性能,而没有牺牲跨区域泛化能力,使全局模型能够恢复与区域特定模型相当的本地化能力,并提高了学习效率。我们的消融研究表明,仅URL级别的元数据就捕获了大部分地理信号,而平衡的区域数据覆盖仍然至关重要,因为元数据无法完全弥补缺失的区域。最后,我们引入了一个包含800个本地化新闻MCQ的下游基准,并表明经过指令微调后,元数据条件化的全局模型实现了与LLaMA-3.2-1B-Instruct相当的准确率,尽管训练数据量大大减少。总之,这些结果确立了元数据条件化作为一种实用且计算高效的语言模型本地化方法。

🔬 方法详解

问题定义:现有的大型语言模型在训练时通常将所有文本视为来自一个单一的全局分布,忽略了文本的地理来源信息。这导致模型在生成文本时,无法很好地适应特定区域的语言习惯、文化背景和新闻事件,从而产生“地理同质化”的现象。现有的区域特定模型虽然可以解决这个问题,但需要针对每个区域单独训练,成本高昂,且难以进行跨区域的知识迁移。

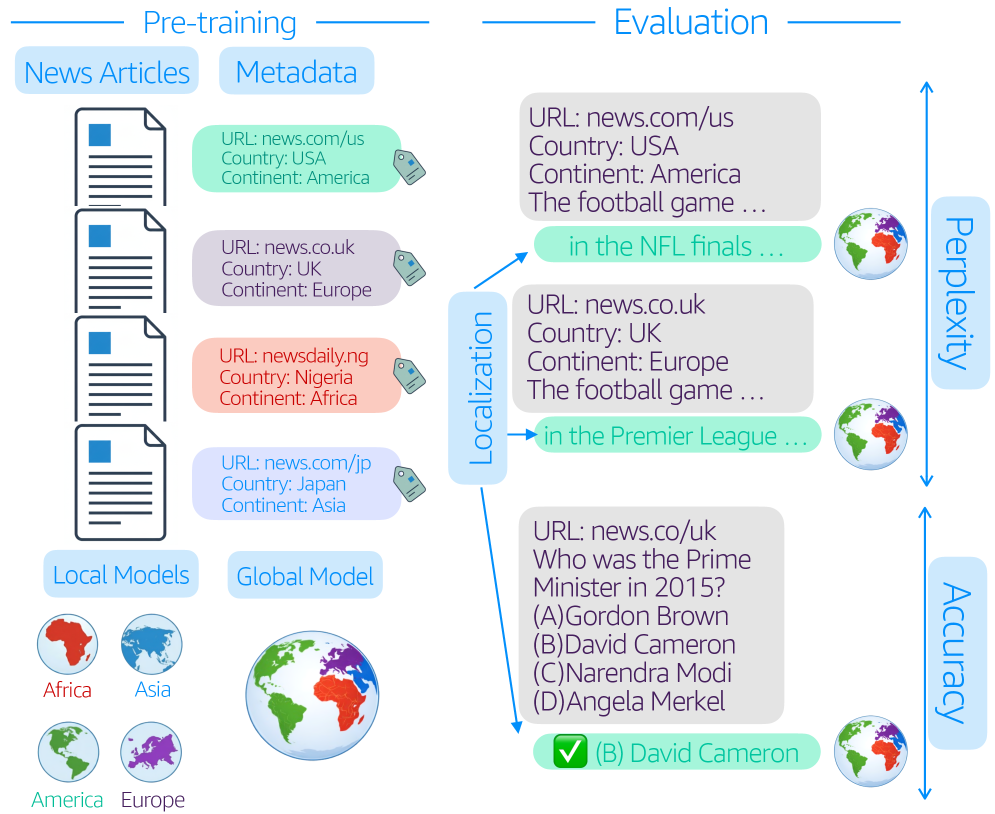

核心思路:本文的核心思路是利用与文本相关的元数据(如URL、国家标签、洲标签等)来引导语言模型的训练,使其能够学习到不同地理区域的特征。通过在预训练阶段将这些元数据作为条件输入到模型中,模型可以区分不同区域的文本,并学习到相应的语言模式和知识。这种方法可以在一个全局模型中实现区域特定的行为,而无需针对每个区域单独训练模型。

技术框架:该方法的核心在于预训练阶段的元数据条件化。具体来说,模型在训练时,除了输入文本之外,还会输入与该文本相关的元数据,例如URL、国家标签和洲标签。这些元数据被编码成向量,并与文本的嵌入向量进行拼接或融合,然后输入到Transformer模型中进行训练。模型的目标是预测下一个词,同时学习到元数据与文本之间的关系。在推理阶段,可以根据需要输入不同的元数据,从而控制模型生成特定区域的文本。

关键创新:该方法最重要的创新点在于将元数据条件化引入到大语言模型的预训练中,从而实现了一种轻量级的本地化方法。与传统的区域特定模型相比,该方法可以在一个全局模型中实现区域特定的行为,无需针对每个区域单独训练模型,大大降低了训练成本。此外,该方法还可以提高模型的泛化能力,使其能够更好地适应不同区域的文本。

关键设计:在实验中,作者使用了0.5B和1B参数规模的Transformer模型,并从头开始进行预训练。他们使用了大规模的英语新闻数据,并标注了每个新闻的URL、国家标签和洲标签。为了保证数据的平衡性,他们对不同区域的数据进行了采样和加权。在训练过程中,他们使用了标准的交叉熵损失函数,并采用Adam优化器进行优化。他们还进行了一系列的消融实验,以评估不同元数据和数据平衡策略的影响。

🖼️ 关键图片

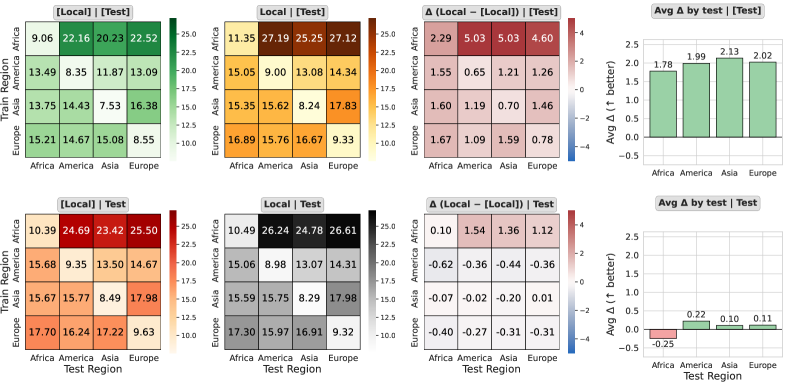

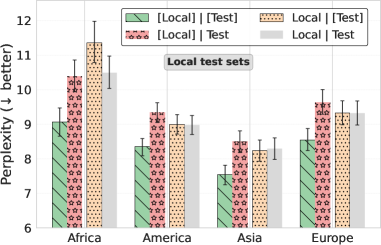

📊 实验亮点

实验结果表明,元数据条件化方法在四个受控实验中均能提高区域内性能,且不牺牲跨区域泛化能力。经过指令微调后,元数据条件化的全局模型在本地化新闻MCQ基准测试中,达到了与LLaMA-3.2-1B-Instruct相当的准确率,尽管训练数据量大大减少。消融实验表明,URL级别的元数据捕获了大部分地理信号。

🎯 应用场景

该研究成果可应用于新闻内容生成、本地化营销、跨文化交流等领域。例如,可以利用该技术生成更符合当地语言习惯和文化背景的新闻报道,提高用户阅读体验。此外,该技术还可以用于构建更智能的聊天机器人,使其能够更好地理解和回应不同地区用户的需求。

📄 摘要(原文)

Large language models are typically trained by treating text as a single global distribution, often resulting in geographically homogenized behavior. We study metadata conditioning as a lightweight approach for localization, pre-training 31 models (at 0.5B and 1B parameter scales) from scratch on large-scale English news data annotated with verified URLs, country tags, and continent tags, covering 4 continents and 17 countries. Across four controlled experiments, we show that metadata conditioning consistently improves in-region performance without sacrificing cross-region generalization, enables global models to recover localization comparable to region-specific models, and improves learning efficiency. Our ablation studies demonstrate that URL-level metadata alone captures much of the geographic signal, while balanced regional data coverage remains essential, as metadata cannot fully compensate for missing regions. Finally, we introduce a downstream benchmark of 800 localized news MCQs and show that after instruction tuning, metadata conditioned global models achieve accuracy comparable to LLaMA-3.2-1B-Instruct, despite being trained on substantially less data. Together, these results establish metadata conditioning as a practical and compute-efficient approach for localization of language models.