Obscuring Data Contamination Through Translation: Evidence from Arabic Corpora

作者: Chaymaa Abbas, Nour Shamaa, Mariette Awad

分类: cs.CL, cs.AI

发布日期: 2026-01-21

💡 一句话要点

提出翻译感知污染检测方法,解决多语言大模型评估中数据污染的盲区问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 数据污染检测 多语言大模型 翻译感知 模型评估 阿拉伯语 Tested Slot Guessing Min-K%概率分析

📋 核心要点

- 现有污染检测方法主要针对英语基准,忽略了多语言环境下数据污染的复杂性,导致评估结果不准确。

- 论文提出翻译感知污染检测方法,通过分析不同翻译版本基准上的模型表现,更有效地识别数据污染。

- 实验表明,即使传统方法失效,该方法也能可靠地检测到污染,提升了多语言大模型评估的可靠性。

📝 摘要(中文)

数据污染使得大语言模型评估的有效性降低,因为模型可能依赖于记忆的基准内容,而非真正的泛化能力。现有污染检测方法主要集中在英语基准上,对多语言环境下的污染理解不足。本文通过在不同比例的阿拉伯语数据集上微调多个开源LLM,并在原始英语基准上评估它们,研究多语言环境下的污染动态。为了检测记忆,我们扩展了Tested Slot Guessing方法,加入了选择重排序策略,并结合Min-K%概率分析,捕捉行为和分布式的污染信号。结果表明,翻译成阿拉伯语会抑制传统的污染指标,但模型仍然受益于受污染数据的暴露,特别是那些具有更强阿拉伯语能力的模型。这种效应一致地反映在Min-K%分数的上升和交叉语言答案一致性的增加上,随着污染水平的增长。为了解决这个盲点,我们提出了翻译感知污染检测,通过比较多个翻译后的基准变体的信号来识别污染,而不是仅依赖英语。即使在仅使用英语的方法失败时,翻译感知污染检测也能可靠地揭示污染。总之,我们的发现强调了需要多语言的、翻译感知的评估流程,以确保对LLM进行公平、透明和可重复的评估。

🔬 方法详解

问题定义:现有的大语言模型评估方法在多语言环境下存在数据污染问题,即模型可能在训练过程中接触到测试数据或其变体,导致评估结果虚高。尤其是在非英语语种中,由于翻译的存在,传统的污染检测方法难以有效识别,存在盲区。现有方法主要依赖于英语基准,无法有效检测翻译带来的污染。

核心思路:论文的核心思路是利用翻译的特性来揭示数据污染。即使模型在训练时接触的是测试数据的翻译版本,仍然会影响其在原始测试集上的表现。通过比较模型在不同翻译版本测试集上的表现差异,可以更有效地识别出数据污染。

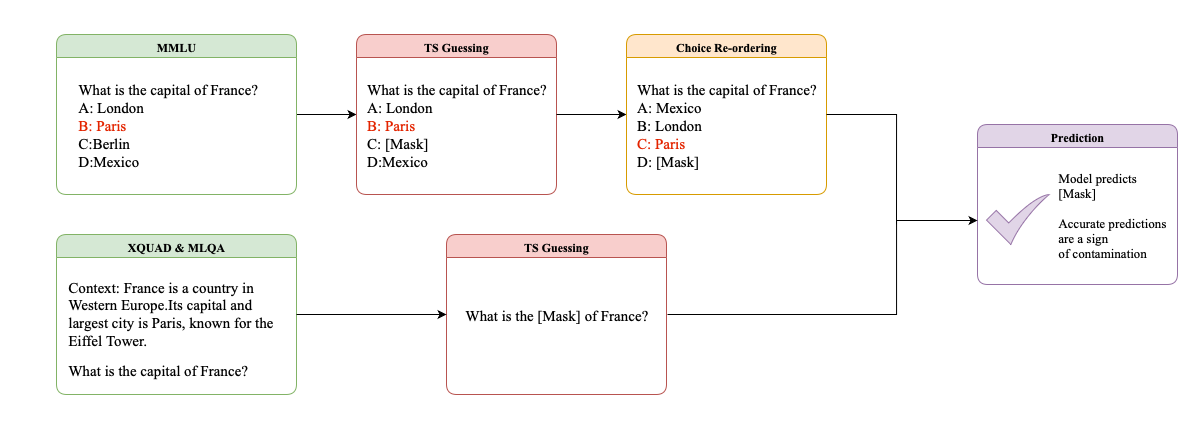

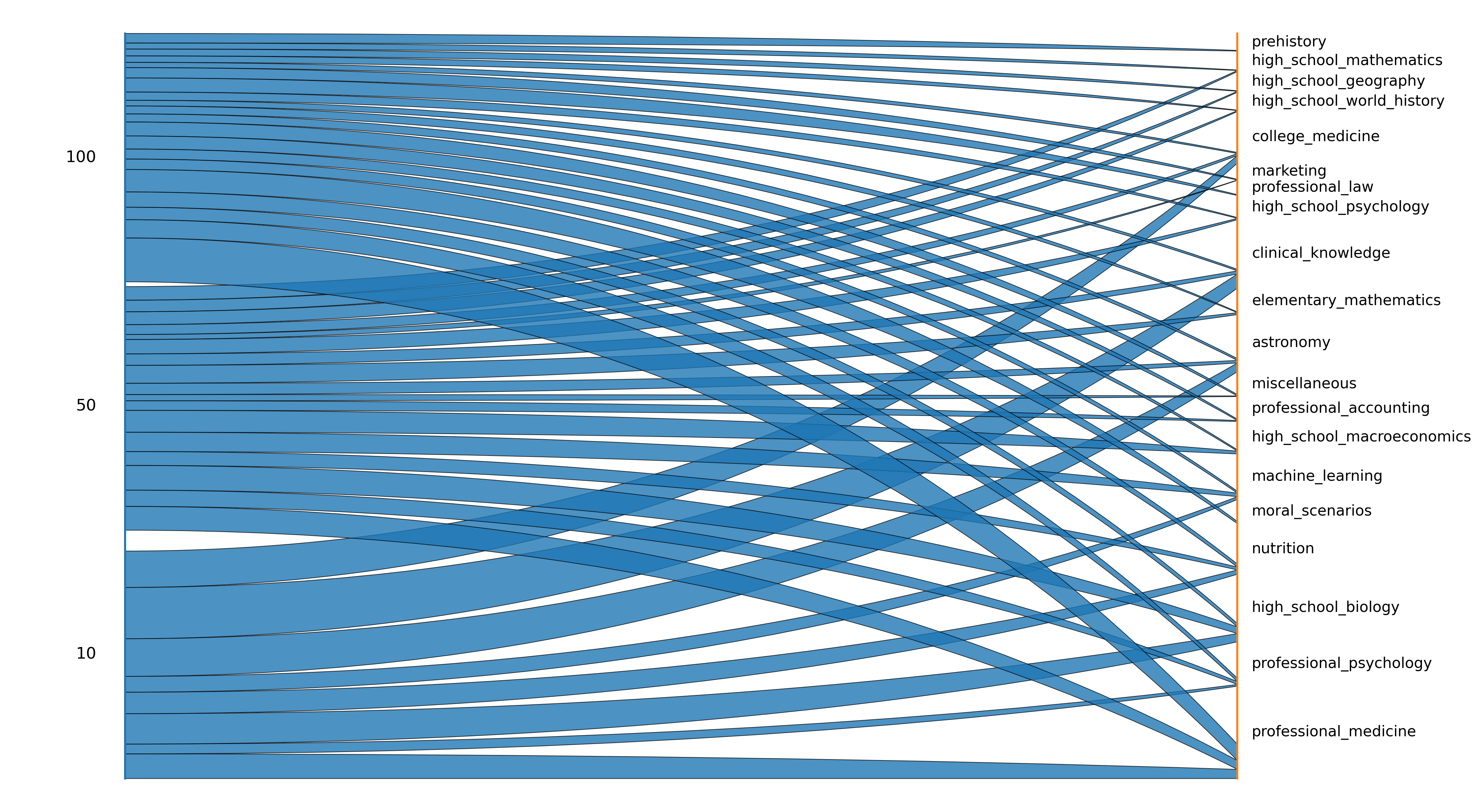

技术框架:论文的技术框架主要包括以下几个步骤:1) 在不同比例的阿拉伯语数据集上微调多个开源LLM;2) 在原始英语基准以及其阿拉伯语翻译版本上评估这些模型;3) 使用扩展的Tested Slot Guessing方法和Min-K%概率分析来检测污染信号;4) 比较模型在不同翻译版本上的表现,识别翻译感知的污染。

关键创新:论文的关键创新在于提出了翻译感知污染检测方法。该方法不再仅仅依赖于英语基准,而是通过分析模型在多个翻译版本基准上的表现,来识别数据污染。这种方法能够有效地克服传统方法在多语言环境下的局限性,更准确地评估模型的泛化能力。

关键设计:论文的关键设计包括:1) 使用选择重排序策略扩展了Tested Slot Guessing方法,提高了污染检测的灵敏度;2) 引入Min-K%概率分析,捕捉模型输出的分布特征,更全面地评估污染程度;3) 通过比较模型在原始英语基准和阿拉伯语翻译基准上的表现差异,识别翻译带来的污染信号。

🖼️ 关键图片

📊 实验亮点

实验结果表明,翻译成阿拉伯语会抑制传统的污染指标,但模型仍然受益于受污染数据的暴露。随着污染水平的增长,Min-K%分数上升,交叉语言答案一致性增加。翻译感知污染检测方法能够可靠地揭示污染,即使在仅使用英语的方法失败时也能有效。

🎯 应用场景

该研究成果可应用于多语言大语言模型的公平评估和基准测试集的构建。通过翻译感知的污染检测,可以更准确地评估模型的泛化能力,避免因数据污染导致的评估偏差。这有助于推动多语言大模型的发展,并确保其在实际应用中的可靠性。

📄 摘要(原文)

Data contamination undermines the validity of Large Language Model evaluation by enabling models to rely on memorized benchmark content rather than true generalization. While prior work has proposed contamination detection methods, these approaches are largely limited to English benchmarks, leaving multilingual contamination poorly understood. In this work, we investigate contamination dynamics in multilingual settings by fine-tuning several open-weight LLMs on varying proportions of Arabic datasets and evaluating them on original English benchmarks. To detect memorization, we extend the Tested Slot Guessing method with a choice-reordering strategy and incorporate Min-K% probability analysis, capturing both behavioral and distributional contamination signals. Our results show that translation into Arabic suppresses conventional contamination indicators, yet models still benefit from exposure to contaminated data, particularly those with stronger Arabic capabilities. This effect is consistently reflected in rising Mink% scores and increased cross-lingual answer consistency as contamination levels grow. To address this blind spot, we propose Translation-Aware Contamination Detection, which identifies contamination by comparing signals across multiple translated benchmark variants rather than English alone. The Translation-Aware Contamination Detection reliably exposes contamination even when English-only methods fail. Together, our findings highlight the need for multilingual, translation-aware evaluation pipelines to ensure fair, transparent, and reproducible assessment of LLMs.