CorpusQA: A 10 Million Token Benchmark for Corpus-Level Analysis and Reasoning

作者: Zhiyuan Lu, Chenliang Li, Yingcheng Shi, Weizhou Shen, Ming Yan, Fei Huang

分类: cs.CL, cs.AI

发布日期: 2026-01-21

💡 一句话要点

提出CorpusQA,一个千万token级别的语料库分析与推理基准。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语料库分析 长文本推理 基准测试 数据合成 语言模型

📋 核心要点

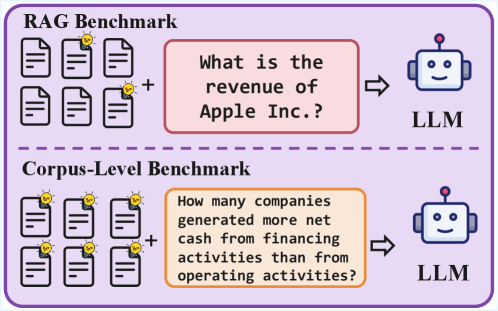

- 现有基准测试无法有效评估LLM在大型文档库上的推理能力,因为它们依赖于稀疏检索假设。

- CorpusQA通过数据合成框架生成大规模、复杂的查询,挑战模型进行全局信息整合和推理。

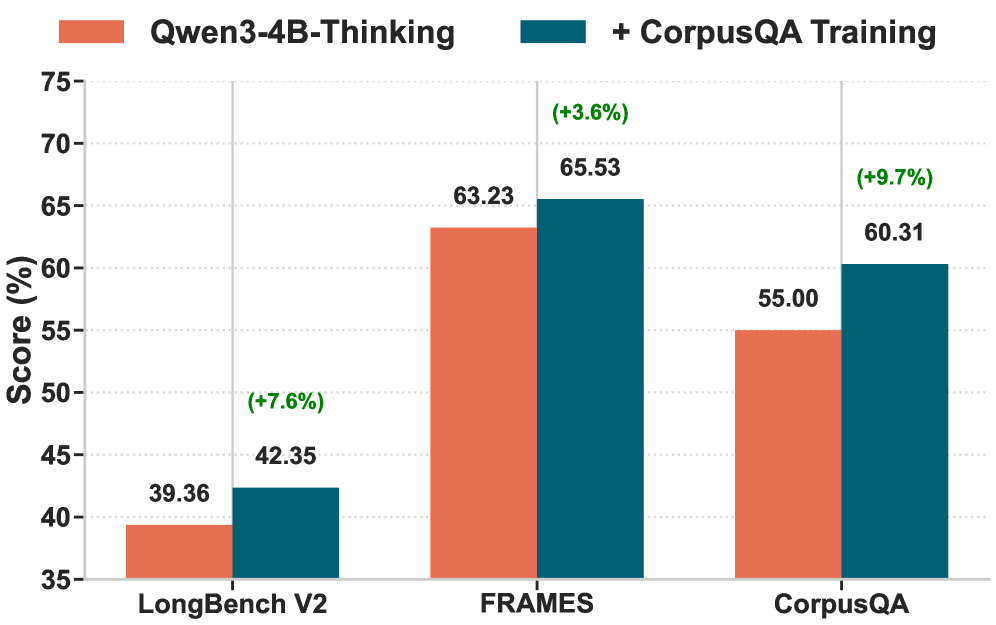

- 实验表明,现有LLM在处理长上下文时性能下降,而内存增强的agentic架构表现更优。

📝 摘要(中文)

大型语言模型现在可以处理百万token级别的上下文,但它们在整个文档库中进行推理的能力在很大程度上仍未经过测试。现有的基准测试不足,因为它们大多局限于单个长文本,或者依赖于“稀疏检索”假设,即答案可以从少数相关块中得出。对于真正的语料库级别分析,这种假设是无效的,因为证据高度分散在数百个文档中,并且答案需要全局整合、比较和统计聚合。为了解决这个关键差距,我们引入了CorpusQA,这是一个新的基准,规模达到1000万个token,通过一种新的数据合成框架生成。通过将推理与文本表示分离,该框架创建了复杂的、计算密集型的查询,并以编程方式保证了ground-truth答案,从而挑战系统在没有依赖于易出错的人工标注的情况下,对庞大的、非结构化文本执行整体推理。我们进一步证明了我们的框架在评估之外的实用性,表明在我们的合成数据上进行微调可以有效地提高LLM的一般长上下文推理能力。大量的实验表明,即使是最先进的长上下文LLM,也会随着输入长度的增加而遇到困难,并且标准的检索增强生成系统会完全崩溃。我们的研究结果表明,内存增强的agentic架构提供了一种更强大的替代方案,这表明需要从简单地扩展上下文窗口转变为开发用于全局信息合成的先进架构。

🔬 方法详解

问题定义:论文旨在解决现有长文本QA基准无法有效评估LLM在大型文档库中进行复杂推理的问题。现有方法通常依赖于稀疏检索,即假设答案可以从少数相关文档片段中找到,这对于需要全局信息整合和统计聚合的语料库级别分析是不够的。现有方法的痛点在于无法模拟真实世界中信息分散在大量文档中的情况,以及需要复杂推理才能得出答案的场景。

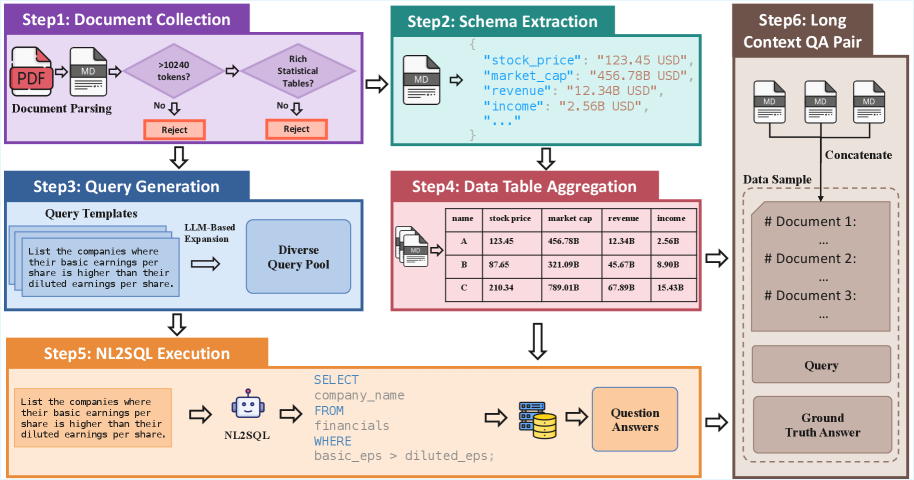

核心思路:论文的核心思路是通过数据合成框架生成大规模的、具有挑战性的QA数据集,从而更有效地评估LLM在语料库级别的推理能力。该框架通过解耦推理和文本表示,可以创建具有程序化保证的ground-truth答案的复杂查询,避免了人工标注的偏差和成本。

技术框架:CorpusQA的数据生成框架包含以下主要模块:1) 数据源选择:选择合适的文本语料库作为数据源。2) 查询生成:根据预定义的推理类型(例如,比较、统计聚合)生成复杂的查询。3) 答案生成:通过程序化方式,基于语料库内容和查询,生成ground-truth答案。4) 数据格式化:将查询和答案格式化为标准的QA数据集格式。整体流程旨在创建需要全局信息整合和复杂推理才能回答的问题。

关键创新:CorpusQA最重要的技术创新点在于其数据合成框架,该框架能够以程序化的方式生成大规模、高质量的QA数据集,而无需依赖人工标注。这种方法可以避免人工标注的偏差和成本,并且可以灵活地控制数据集的难度和复杂度。与现有方法的本质区别在于,CorpusQA侧重于评估LLM在全局信息整合和复杂推理方面的能力,而不是简单的信息检索。

关键设计:数据合成框架的关键设计包括:1) 推理类型定义:定义了多种需要全局信息整合和复杂推理的推理类型,例如比较、统计聚合、趋势分析等。2) 查询模板设计:设计了用于生成不同类型查询的模板,这些模板可以灵活地组合和修改。3) 答案验证机制:设计了用于验证生成答案的正确性的机制,确保数据集的质量。

🖼️ 关键图片

📊 实验亮点

实验结果表明,即使是最先进的长上下文LLM,在CorpusQA基准上的性能也随着输入长度的增加而显著下降。标准的检索增强生成系统在处理需要全局信息整合的查询时表现不佳。内存增强的agentic架构表现出更强的鲁棒性,表明其在处理大规模语料库推理任务方面的潜力。具体性能数据未知,但趋势表明现有模型在长上下文推理方面仍有很大的提升空间。

🎯 应用场景

CorpusQA基准的潜在应用领域包括:企业知识管理、金融风险分析、法律文档审查等。通过评估和提升LLM在大型文档库上的推理能力,可以帮助企业更有效地利用其知识资产,提高决策效率,降低风险。未来,该研究可以推动开发更强大的智能文档处理系统,实现更高级别的自动化和智能化。

📄 摘要(原文)

While large language models now handle million-token contexts, their capacity for reasoning across entire document repositories remains largely untested. Existing benchmarks are inadequate, as they are mostly limited to single long texts or rely on a "sparse retrieval" assumption-that answers can be derived from a few relevant chunks. This assumption fails for true corpus-level analysis, where evidence is highly dispersed across hundreds of documents and answers require global integration, comparison, and statistical aggregation. To address this critical gap, we introduce CorpusQA, a new benchmark scaling up to 10 million tokens, generated via a novel data synthesis framework. By decoupling reasoning from textual representation, this framework creates complex, computation-intensive queries with programmatically guaranteed ground-truth answers, challenging systems to perform holistic reasoning over vast, unstructured text without relying on fallible human annotation. We further demonstrate the utility of our framework beyond evaluation, showing that fine-tuning on our synthesized data effectively enhances an LLM's general long-context reasoning capabilities. Extensive experiments reveal that even state-of-the-art long-context LLMs struggle as input length increases, and standard retrieval-augmented generation systems collapse entirely. Our findings indicate that memory-augmented agentic architectures offer a more robust alternative, suggesting a critical shift is needed from simply extending context windows to developing advanced architectures for global information synthesis.