Language-Coupled Reinforcement Learning for Multilingual Retrieval-Augmented Generation

作者: Rui Qi, Fengran Mo, Yufeng Chen, Xue Zhang, Shuo Wang, Hongliang Li, Jinan Xu, Meng Jiang, Jian-Yun Nie, Kaiyu Huang

分类: cs.CL

发布日期: 2026-01-21

🔗 代码/项目: GITHUB

💡 一句话要点

提出LcRL框架,通过语言耦合强化学习提升多语言检索增强生成效果

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多语言检索增强生成 强化学习 语言耦合 策略优化 知识偏差 知识冲突

📋 核心要点

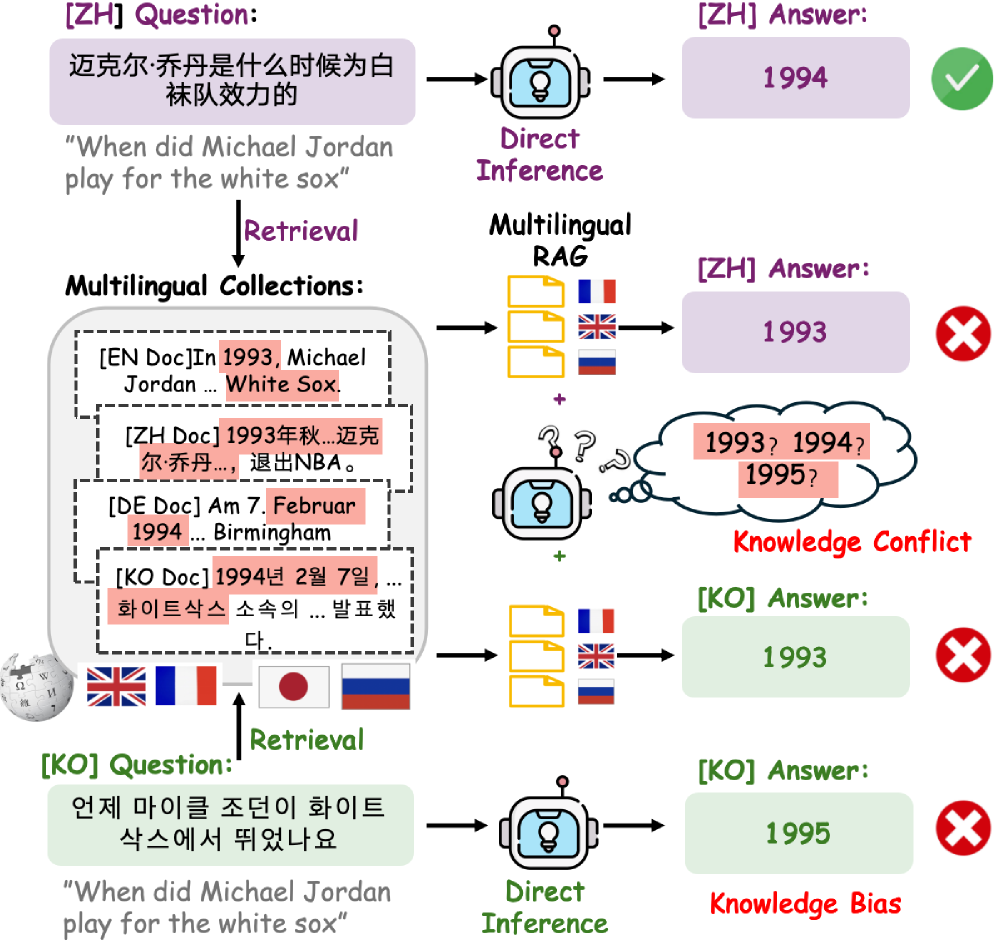

- 现有MRAG方法采用“一刀切”策略,忽略了不同语言的差异,导致知识偏差和冲突。

- LcRL框架通过语言耦合的组相对策略优化,减少知识偏差和冲突,提升模型性能。

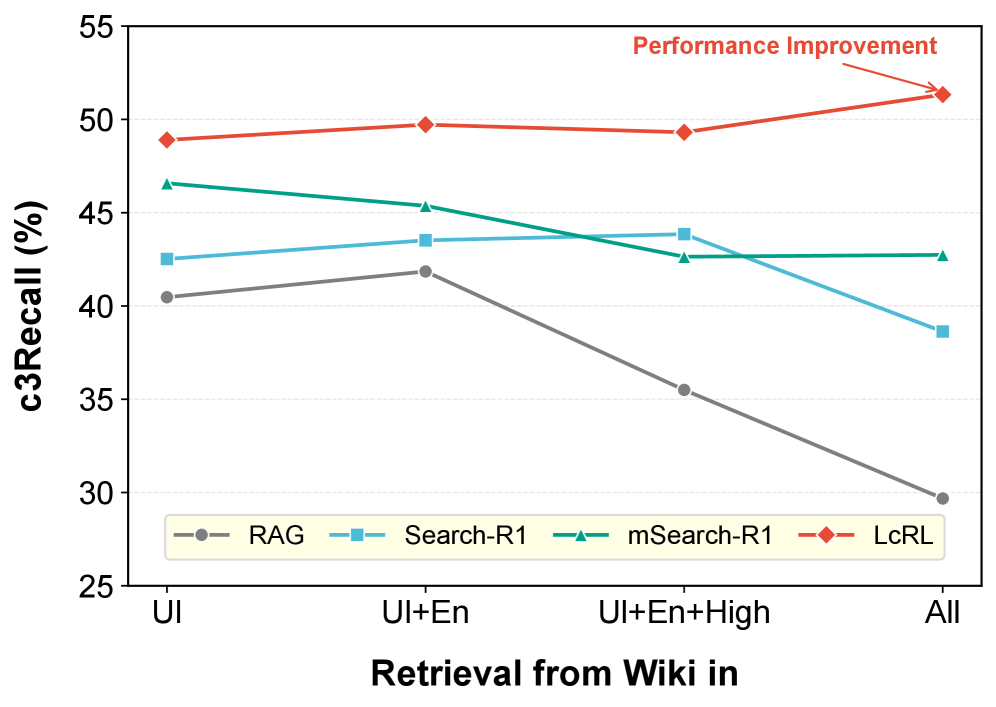

- 实验表明,LcRL在各种场景下均表现出色,尤其是在数据受限和多语言检索环境中。

📝 摘要(中文)

多语言检索增强生成(MRAG)要求模型有效地获取和整合来自多语言集合的有益外部知识。然而,现有研究大多采用统一的处理流程,即不同语言中语义等价的查询通过单轮检索和后续优化进行处理。这种“一刀切”的策略在多语言环境中通常不是最优的,因为模型在与搜索引擎交互时容易出现知识偏差和冲突。为了缓解这些问题,我们提出了LcRL,一个多语言搜索增强强化学习框架,它将语言耦合的组相对策略优化集成到策略和奖励模型中。我们在rollout模块中采用语言耦合的组采样来减少知识偏差,并在奖励模型中正则化一个辅助的反一致性惩罚来减轻知识冲突。实验结果表明,LcRL不仅取得了有竞争力的性能,而且适用于各种实际场景,如受限的训练数据和对包含大量语言的集合进行检索。我们的代码可在https://github.com/Cherry-qwq/LcRL-Open 获取。

🔬 方法详解

问题定义:论文旨在解决多语言检索增强生成(MRAG)中,由于现有方法采用统一处理流程而导致的知识偏差和冲突问题。现有方法忽略了不同语言的特性,使得模型在检索和生成过程中无法有效利用多语言知识,导致性能下降。

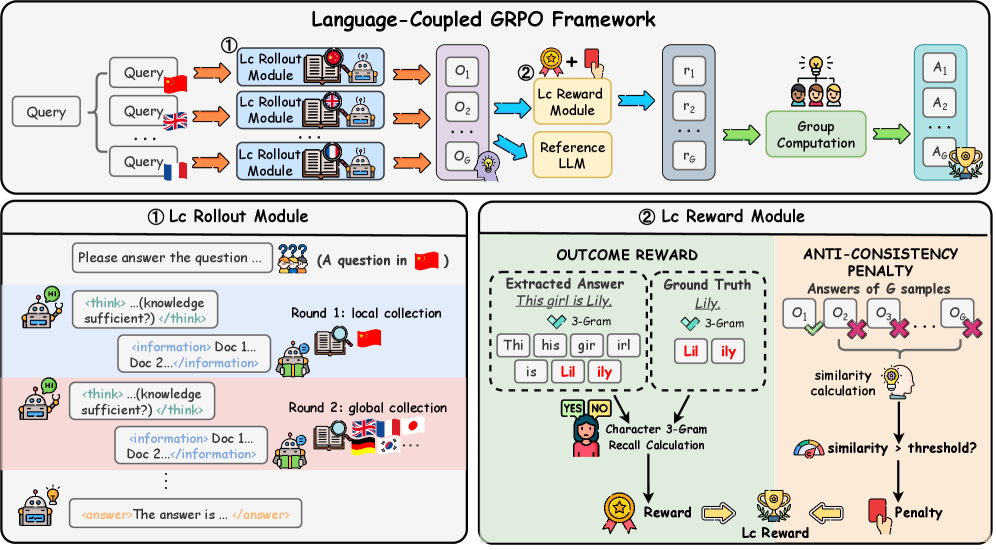

核心思路:论文的核心思路是引入语言耦合(Language-Coupled)的概念,针对不同语言的查询,采用不同的策略进行检索和生成。通过强化学习的方式,学习一个能够根据语言特性进行优化的策略,从而减少知识偏差和冲突。

技术框架:LcRL框架主要包含三个模块:策略模型、奖励模型和rollout模块。策略模型负责生成检索查询,奖励模型评估生成质量,rollout模块负责与搜索引擎交互并收集反馈。框架采用强化学习算法,通过不断迭代优化策略模型,使其能够生成更有效的检索查询。语言耦合体现在rollout模块的组采样和奖励模型的反一致性惩罚上。

关键创新:论文的关键创新在于提出了语言耦合的组相对策略优化方法。该方法通过在rollout模块中采用语言耦合的组采样,减少知识偏差;同时,在奖励模型中引入辅助的反一致性惩罚,减轻知识冲突。这种语言耦合的设计使得模型能够更好地适应多语言环境,提升检索增强生成的效果。

关键设计:在rollout模块中,论文采用了语言耦合的组采样策略,即根据查询语言的不同,选择不同的检索结果进行采样。在奖励模型中,论文引入了一个辅助的反一致性惩罚项,用于惩罚模型在不同语言之间产生不一致的生成结果。具体来说,对于语义相同的查询,模型在不同语言下生成的答案应该保持一致,否则将受到惩罚。此外,论文还采用了相对策略优化算法,以提高训练的稳定性和效率。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LcRL框架在多语言检索增强生成任务上取得了显著的性能提升。相较于现有方法,LcRL在多个数据集上均取得了更优的ROUGE指标。尤其是在数据受限和多语言检索环境中,LcRL的优势更加明显,证明了其在实际应用中的潜力。

🎯 应用场景

该研究成果可应用于多语言问答系统、多语言机器翻译、跨语言信息检索等领域。通过提升多语言检索增强生成的效果,可以帮助用户更有效地获取和利用来自不同语言的信息,促进跨文化交流和知识共享。未来,该方法有望应用于更广泛的多语言自然语言处理任务。

📄 摘要(原文)

Multilingual retrieval-augmented generation (MRAG) requires models to effectively acquire and integrate beneficial external knowledge from multilingual collections. However, most existing studies employ a unitive process where queries of equivalent semantics across different languages are processed through a single-turn retrieval and subsequent optimization. Such a ``one-size-fits-all'' strategy is often suboptimal in multilingual settings, as the models occur to knowledge bias and conflict during the interaction with the search engine. To alleviate the issues, we propose LcRL, a multilingual search-augmented reinforcement learning framework that integrates a language-coupled Group Relative Policy Optimization into the policy and reward models. We adopt the language-coupled group sampling in the rollout module to reduce knowledge bias, and regularize an auxiliary anti-consistency penalty in the reward models to mitigate the knowledge conflict. Experimental results demonstrate that LcRL not only achieves competitive performance but is also appropriate for various practical scenarios such as constrained training data and retrieval over collections encompassing a large number of languages. Our code is available at https://github.com/Cherry-qwq/LcRL-Open.