Large Language Models for Large-Scale, Rigorous Qualitative Analysis in Applied Health Services Research

作者: Sasha Ronaghi, Emma-Louise Aveling, Maria Levis, Rachel Lauren Ross, Emily Alsentzer, Sara Singer

分类: cs.CL

发布日期: 2026-01-20

备注: 20 pages, 6 figures

DOI: 10.21203/rs.3.rs-7794878/v1

💡 一句话要点

提出人机协同框架,利用大语言模型高效严谨地进行大规模定性健康服务研究

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 定性分析 健康服务研究 人机协同 文本摘要 演绎编码

📋 核心要点

- 现有定性分析方法在大规模健康服务研究中效率低,且缺乏LLM集成的方法论指导。

- 论文提出一个模型和任务无关的人机协同框架,用于设计LLM辅助的定性分析方法。

- 实验表明,该框架能有效提高分析效率,同时保持研究的严谨性,并能及时向从业者提供反馈。

📝 摘要(中文)

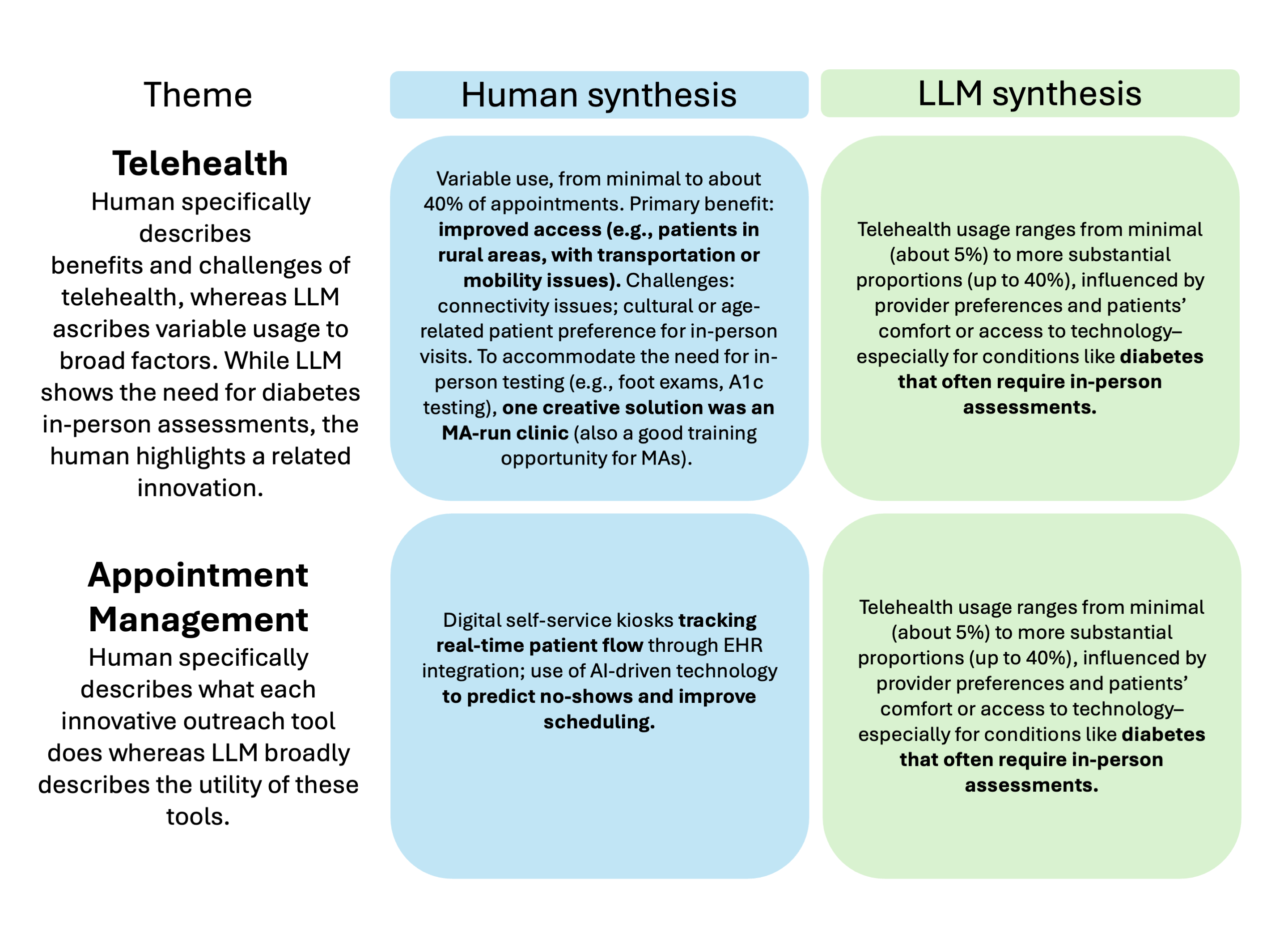

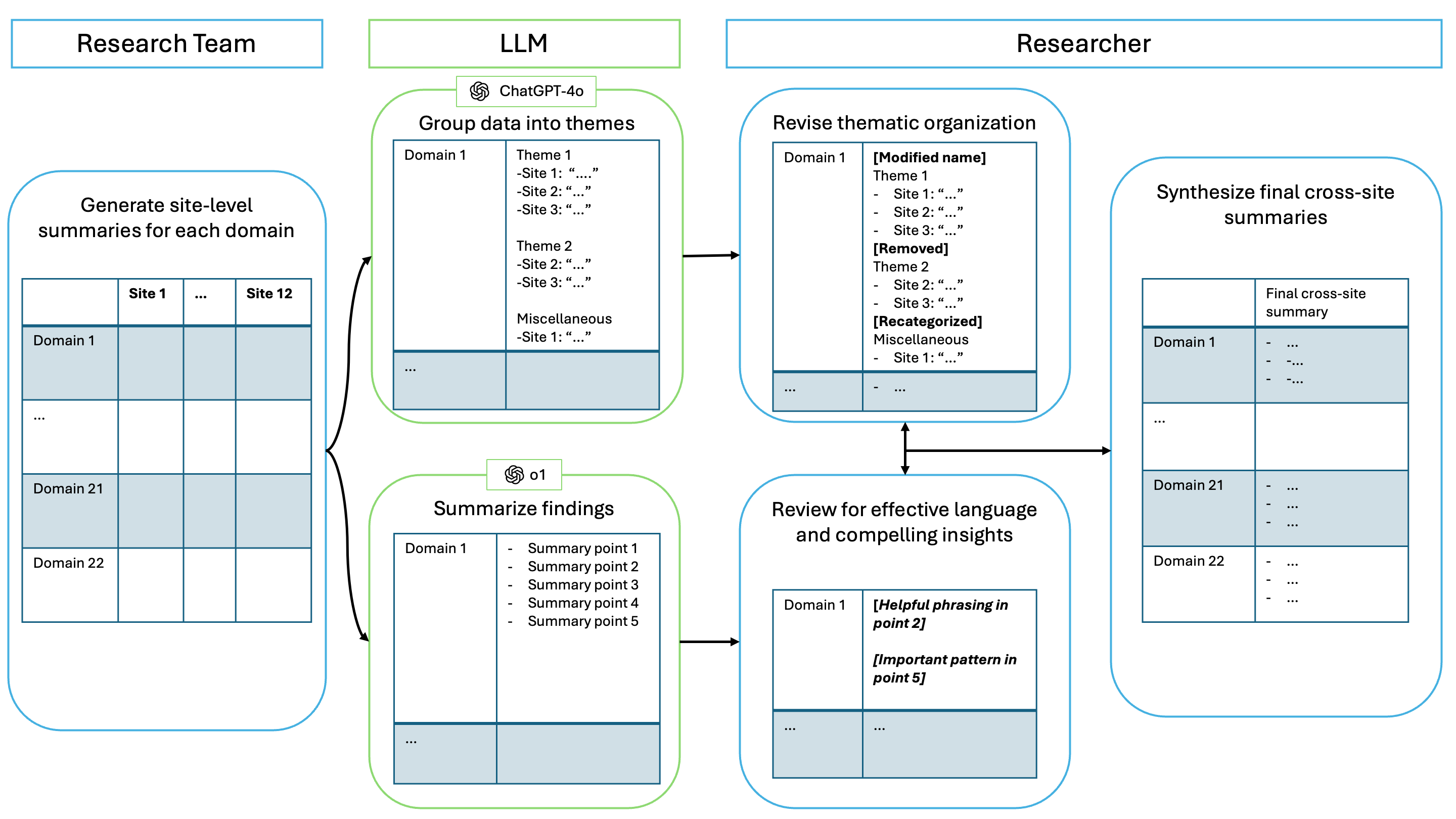

大型语言模型(LLMs)在提高大规模、多站点健康服务研究中定性分析的效率方面显示出潜力。然而,将LLM集成到定性分析中的方法论指导以及它们对真实研究方法和结果的影响的证据仍然有限。我们开发了一个模型和任务无关的框架,用于设计人机协同的定性分析方法,以支持不同的分析目标。在一个针对联邦合格健康中心(FQHCs)糖尿病护理的多站点研究中,我们利用该框架实施了人机协同方法,用于(1)研究人员生成的摘要的定性综合,以生成比较反馈报告,以及(2)对167份访谈记录进行演绎编码,以改进实践转型干预。LLM的辅助使得能够及时向从业者提供反馈,并将大规模定性数据纳入以指导理论和实践的改变。这项工作展示了如何将LLM集成到应用健康服务研究中,以提高效率,同时保持严谨性,为在定性研究中继续使用LLM进行创新提供指导。

🔬 方法详解

问题定义:论文旨在解决大规模健康服务研究中定性分析效率低下的问题。传统定性分析方法耗时耗力,难以处理大量数据,且缺乏有效利用新兴LLM技术的指导。现有方法难以快速从大量访谈记录和研究报告中提取关键信息,并及时向从业者提供反馈,从而影响了研究的实际应用价值。

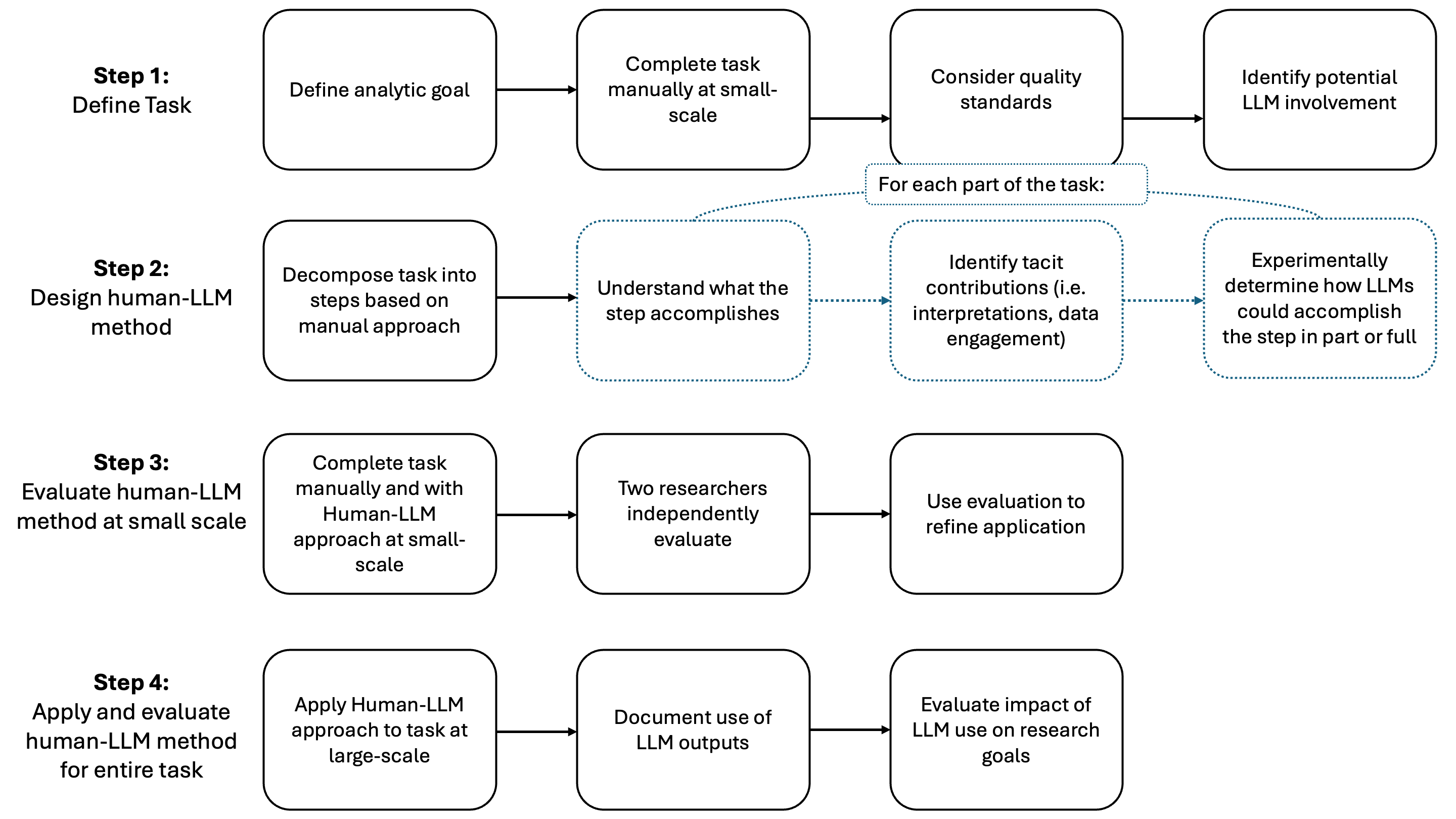

核心思路:论文的核心思路是构建一个人机协同的定性分析框架,充分利用LLM的文本处理能力,同时保留研究人员的专业知识和判断力。该框架旨在实现效率与严谨性的平衡,通过合理分配任务,使LLM负责初步的信息提取、归纳和编码,而研究人员负责审核、验证和解释结果。

技术框架:该框架包含以下主要阶段:1) 数据准备:收集和整理定性数据,如访谈记录、研究报告等。2) 任务分解:将定性分析任务分解为LLM可执行的子任务,如文本摘要、主题提取、情感分析等。3) LLM执行:使用预训练或微调的LLM执行子任务,生成初步的分析结果。4) 人工审核:研究人员审核LLM的输出结果,进行修正、补充和验证。5) 结果整合:将LLM和人工分析结果整合,形成最终的定性分析报告。

关键创新:该框架的关键创新在于其模型和任务无关性,这意味着它可以应用于不同的LLM和不同的定性分析任务。此外,该框架强调人机协同,充分发挥LLM的效率优势,同时保证研究的严谨性和可靠性。它提供了一种系统化的方法,将LLM集成到定性研究中,并为未来的研究提供了指导。

关键设计:论文中没有明确给出关键参数设置或网络结构等技术细节,因为该框架是模型和任务无关的。关键设计在于任务分解的策略,以及人工审核的标准和流程。例如,在演绎编码任务中,研究人员需要预先定义编码方案,并指导LLM如何应用这些编码方案。在人工审核阶段,研究人员需要仔细检查LLM的编码结果,并进行必要的修正。

🖼️ 关键图片

📊 实验亮点

该研究在联邦合格健康中心(FQHCs)糖尿病护理的多站点研究中,成功应用人机协同方法进行定性综合和演绎编码。LLM辅助实现了及时向从业者提供反馈,并将大规模定性数据纳入以指导理论和实践的改变,展示了LLM在提高效率和保持严谨性方面的潜力。

🎯 应用场景

该研究成果可广泛应用于健康服务研究、社会科学研究、市场调研等领域,尤其适用于需要处理大量定性数据的场景。通过提高定性分析的效率和质量,该方法可以加速研究进程,为政策制定和实践改进提供更及时、更可靠的依据,具有重要的实际价值和未来影响。

📄 摘要(原文)

Large language models (LLMs) show promise for improving the efficiency of qualitative analysis in large, multi-site health-services research. Yet methodological guidance for LLM integration into qualitative analysis and evidence of their impact on real-world research methods and outcomes remain limited. We developed a model- and task-agnostic framework for designing human-LLM qualitative analysis methods to support diverse analytic aims. Within a multi-site study of diabetes care at Federally Qualified Health Centers (FQHCs), we leveraged the framework to implement human-LLM methods for (1) qualitative synthesis of researcher-generated summaries to produce comparative feedback reports and (2) deductive coding of 167 interview transcripts to refine a practice-transformation intervention. LLM assistance enabled timely feedback to practitioners and the incorporation of large-scale qualitative data to inform theory and practice changes. This work demonstrates how LLMs can be integrated into applied health-services research to enhance efficiency while preserving rigor, offering guidance for continued innovation with LLMs in qualitative research.