"The Whole Is Greater Than the Sum of Its Parts": A Compatibility-Aware Multi-Teacher CoT Distillation Framework

作者: Jin Cui, Jiaqi Guo, Jiepeng Zhou, Ruixuan Yang, Jiayi Lu, Jiajun Xu, Jiangcheng Song, Boran Zhao, Pengju Ren

分类: cs.CL, cs.AI

发布日期: 2026-01-20

备注: 11pages, 9figures

💡 一句话要点

提出COMPACT框架,通过兼容性感知的多教师CoT蒸馏提升小模型推理能力。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Chain-of-Thought 知识蒸馏 多教师学习 兼容性感知 推理能力

📋 核心要点

- 现有CoT蒸馏方法依赖单一教师,导致学生模型受限于教师的能力偏差和灾难性遗忘问题。

- COMPACT框架通过兼容性感知机制,动态融合多教师的监督信号,提升学生模型的推理能力。

- 实验表明,COMPACT在多个基准测试中达到SOTA性能,有效缓解了灾难性遗忘现象。

📝 摘要(中文)

Chain-of-Thought (CoT) 推理赋予大型语言模型 (LLM) 卓越的能力,但通常需要极高的参数规模。CoT 蒸馏已成为一种有前景的范例,可以将推理能力转移到紧凑型学生模型 (SLM) 中,但现有方法通常依赖于单一教师,限制了学生的潜力,因为单个 LLM 通常表现出不同的能力偏差,并且可能遭受灾难性遗忘。虽然利用不同的教师似乎很有吸引力,但有效地融合他们的监督仍然具有挑战性:教师-学生不兼容会增加幻觉的风险,而被动监督无法确保真正地内化逻辑。为了解决这个问题,我们引入了 COMPACT,该框架通过基于学生实时兼容性动态加权教师梯度来适应性地融合来自不同教师的监督,该兼容性通过多维指标评估:(1)基于图的共识,通过识别主流推理路径来过滤误导性理由;(2)基于互信息的适应性,用于检测“顿悟时刻”,以真正理解推理过程,而不仅仅是模仿;(3)基于损失的难度,用于评估学生对教师指导的接受程度并防止负迁移。大量的实验和潜在空间分析表明,COMPACT 有效地整合了不同的推理能力,而不会损害模型的原始知识结构,在各种基准测试中实现了最先进的性能,同时减轻了灾难性遗忘。

🔬 方法详解

问题定义:现有CoT蒸馏方法通常依赖于单个大型语言模型(LLM)作为教师,这限制了学生模型的性能,因为单个LLM可能存在固有的能力偏差,并且在知识迁移过程中容易发生灾难性遗忘。如何有效地利用多个教师LLM的优势,同时避免教师之间的不兼容性带来的负面影响,是本文要解决的核心问题。

核心思路:COMPACT的核心思路是设计一个兼容性感知的多教师CoT蒸馏框架,该框架能够根据学生模型与不同教师的兼容性,动态地调整教师的监督权重。通过这种方式,COMPACT能够有效地融合来自不同教师的知识,同时避免学生模型受到不兼容教师的误导,从而提升学生模型的推理能力。

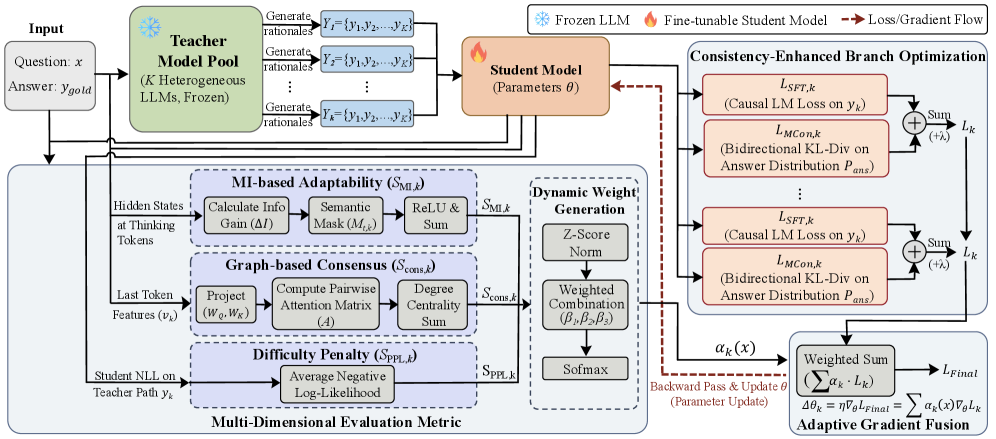

技术框架:COMPACT框架包含以下几个主要模块:1) 多教师CoT生成模块:利用多个预训练的LLM生成CoT推理过程;2) 兼容性评估模块:该模块包含三个子模块:a) 基于图的共识模块,用于识别主流推理路径,过滤误导性理由;b) 基于互信息的适应性模块,用于检测学生模型真正理解推理过程的“顿悟时刻”;c) 基于损失的难度模块,用于评估学生模型对教师指导的接受程度;3) 动态权重调整模块:根据兼容性评估模块的结果,动态调整不同教师的梯度权重;4) 学生模型训练模块:利用调整后的梯度权重,训练学生模型。

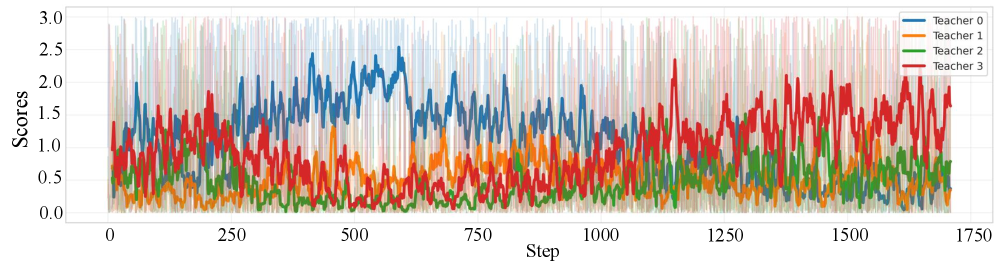

关键创新:COMPACT的关键创新在于提出了一个多维度的兼容性评估指标,该指标能够综合考虑教师与学生之间的共识程度、适应性和难度,从而更准确地评估教师对学生的指导效果。此外,COMPACT还提出了一种动态权重调整机制,该机制能够根据兼容性评估结果,自适应地调整不同教师的梯度权重,从而实现更有效的多教师知识融合。

关键设计:在兼容性评估模块中,基于图的共识模块使用图神经网络来建模推理路径,并利用图的结构信息来识别主流推理路径。基于互信息的适应性模块使用互信息来衡量学生模型对教师推理过程的理解程度。基于损失的难度模块使用损失函数的变化率来评估学生模型对教师指导的接受程度。在动态权重调整模块中,使用Softmax函数将兼容性评估结果转换为教师的梯度权重。

🖼️ 关键图片

📊 实验亮点

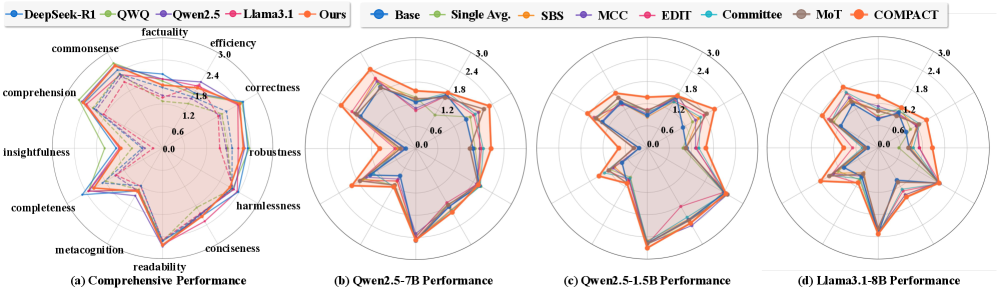

实验结果表明,COMPACT在多个基准测试中取得了state-of-the-art的性能,例如在GSM8K数据集上,COMPACT的准确率超过了现有最佳方法。此外,COMPACT还能够有效缓解灾难性遗忘问题,在知识迁移过程中保持模型的原有知识结构。消融实验验证了兼容性评估模块和动态权重调整机制的有效性。

🎯 应用场景

COMPACT框架可应用于各种需要复杂推理能力的场景,例如问答系统、对话系统、知识图谱推理等。通过将大型语言模型的推理能力蒸馏到小型模型中,COMPACT能够降低计算成本和部署难度,使得这些应用能够在资源受限的环境中运行。此外,COMPACT的多教师学习机制可以有效提升模型的鲁棒性和泛化能力。

📄 摘要(原文)

Chain-of-Thought (CoT) reasoning empowers Large Language Models (LLMs) with remarkable capabilities but typically requires prohibitive parameter scales. CoT distillation has emerged as a promising paradigm to transfer reasoning prowess into compact Student Models (SLMs), but existing approaches often rely on a solitary teacher, capping the student's potential since individual LLMs often exhibit distinct capability biases and may suffer from catastrophic forgetting. While leveraging diverse teachers seems appealing, effectively fusing their supervisions remains challenging: teacher-student incompatibility risks amplifying hallucinations, and passive supervision fails to ensure genuine logic internalization. To address this, we introduce COMPACT, a framework that adaptively fuses supervisions from different teachers by dynamically weighting teacher gradients based on the student's real-time compatibility evaluated by a multi-dimensional metric: (1) Graph-based Consensus to filter misleading rationales by identifying mainstream reasoning paths; (2) Mutual-Information-based Adaptability to detect "epiphany moments" for genuinely understanding the reasoning process rather than merely imitating; and (3) Loss-based Difficulty to assess student receptivity to the teacher's guidance and prevent negative transfer. Extensive experiments and latent space analysis demonstrate that COMPACT effectively integrates diverse reasoning capabilities without damaging the model's original knowledge structure, achieving state-of-the-art performance on various benchmarks while mitigating catastrophic forgetting.