Knowledge Graph-Assisted LLM Post-Training for Enhanced Legal Reasoning

作者: Dezhao Song, Guglielmo Bonifazi, Frank Schilder, Jonathan Richard Schwarz

分类: cs.CL, cs.LG

发布日期: 2026-01-20

💡 一句话要点

提出知识图谱辅助的LLM后训练方法,提升法律领域的推理能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 知识图谱 LLM后训练 法律推理 监督微调 直接偏好优化

📋 核心要点

- 现有LLM后训练主要依赖大型文本语料库和人类反馈,缺乏领域知识结构,导致模型难以处理复杂的推理任务。

- 论文提出利用知识图谱(KG)辅助LLM后训练,通过IRAC框架建模法律概念,构建包含12K案例的KG,提升法律推理能力。

- 实验结果表明,该方法在多个法律基准测试中优于现有方法,尤其是在推理任务上,证明了KG的有效性。

📝 摘要(中文)

本文提出了一种知识图谱(KG)辅助的方法,用于增强LLM在法律领域的推理能力,并可推广到其他高风险领域。该方法遵循IRAC(Issue, Rule, Analysis, Conclusion)框架对关键法律概念进行建模,并构建了一个包含12K法律案例的KG。然后,利用IRAC KG生成训练数据,并使用三种最先进的LLM(30B、49B和70B)进行监督微调(SFT)和直接偏好优化(DPO),模型架构和基础模型系列各不相同。后训练的模型在五个不同的法律基准(14个任务)中的四个上获得了比基线更好的平均性能。特别是,70B DPO模型在六个推理任务中的四个上取得了最佳成绩,优于基线和一个141B的SOTA法律LLM,证明了KG在增强LLM法律推理能力方面的有效性。

🔬 方法详解

问题定义:现有LLM在法律等高风险领域的推理能力不足,主要原因是后训练过程缺乏对领域知识结构的有效利用。传统方法依赖于大规模文本数据和人工反馈,难以捕捉法律概念之间的复杂关系,导致模型在处理复杂法律推理任务时表现不佳。

核心思路:论文的核心思路是利用知识图谱(KG)来显式地表示法律领域的知识结构,并将其融入到LLM的后训练过程中。通过KG,模型可以更好地理解法律概念之间的关系,从而提升其推理能力。

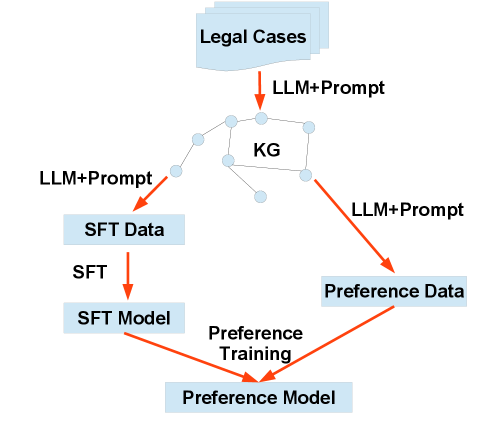

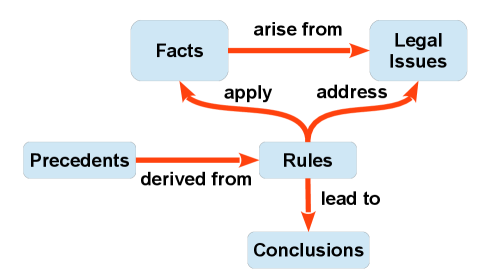

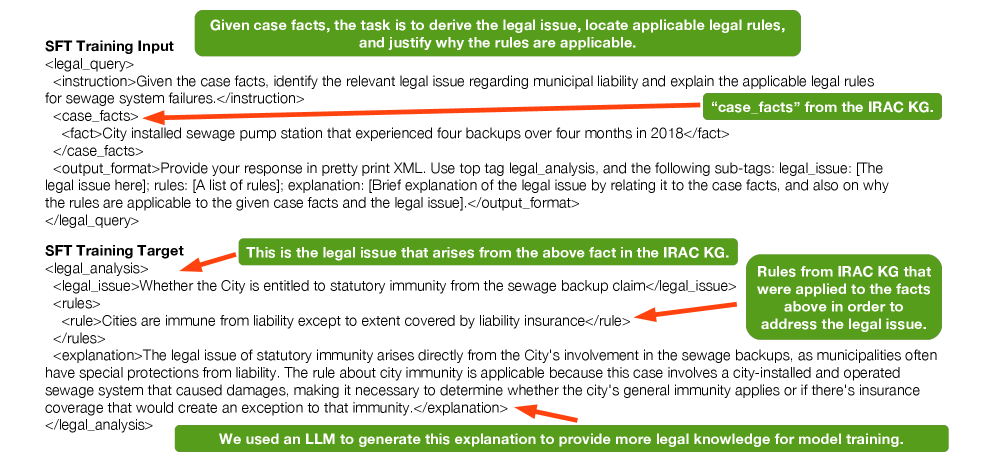

技术框架:该方法主要包含以下几个阶段:1) 法律知识图谱构建:遵循IRAC框架(Issue, Rule, Analysis, Conclusion)对法律概念进行建模,并从12K法律案例中抽取知识,构建KG。2) 训练数据生成:利用构建好的KG,生成用于LLM后训练的数据。3) LLM后训练:使用生成的训练数据,对LLM进行监督微调(SFT)和直接偏好优化(DPO)。

关键创新:该方法最重要的创新点在于将知识图谱引入到LLM的后训练过程中,从而显式地利用领域知识结构。与传统的基于文本的后训练方法相比,该方法能够更好地捕捉法律概念之间的关系,从而提升模型的推理能力。

关键设计:在知识图谱构建方面,采用了IRAC框架对法律概念进行建模,并从大量法律案例中抽取知识。在LLM后训练方面,采用了监督微调(SFT)和直接偏好优化(DPO)两种方法,并对三种不同架构和规模的LLM(30B、49B和70B)进行了实验。具体参数设置和损失函数等细节未在摘要中详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在五个不同的法律基准(14个任务)中的四个上获得了比基线更好的平均性能。特别是,70B DPO模型在六个推理任务中的四个上取得了最佳成绩,优于基线和一个141B的SOTA法律LLM,证明了KG在增强LLM法律推理能力方面的有效性。

🎯 应用场景

该研究成果可应用于智能法律咨询、法律文书自动生成、案件分析与预测等领域。通过提升LLM在法律领域的推理能力,可以为法律从业者提供更高效、准确的辅助工具,并促进法律服务的智能化发展。未来,该方法还可推广到其他高风险领域,如医疗、金融等。

📄 摘要(原文)

LLM post-training has primarily relied on large text corpora and human feedback, without capturing the structure of domain knowledge. This has caused models to struggle dealing with complex reasoning tasks, especially for high-stakes professional domains. In Law, reasoning requires deep understanding of the relations between various legal concepts, a key component missing in current LLM post-training. In this paper, we propose a knowledge graph (KG)-assisted approach for enhancing LLMs' reasoning capability in Legal that is generalizable to other high-stakes domains. We model key legal concepts by following the \textbf{IRAC} (Issue, Rule, Analysis and Conclusion) framework, and construct a KG with 12K legal cases. We then produce training data using our IRAC KG, and conduct both Supervised Fine-Tuning (SFT) and Direct Preference Optimization (DPO) with three state-of-the-art (SOTA) LLMs (30B, 49B and 70B), varying architecture and base model family. Our post-trained models obtained better average performance on 4/5 diverse legal benchmarks (14 tasks) than baselines. In particular, our 70B DPO model achieved the best score on 4/6 reasoning tasks, among baselines and a 141B SOTA legal LLM, demonstrating the effectiveness of our KG for enhancing LLMs' legal reasoning capability.