OP-Bench: Benchmarking Over-Personalization for Memory-Augmented Personalized Conversational Agents

作者: Yulin Hu, Zimo Long, Jiahe Guo, Xingyu Sui, Xing Fu, Weixiang Zhao, Yanyan Zhao, Bing Qin

分类: cs.CL, cs.AI

发布日期: 2026-01-20

💡 一句话要点

提出OP-Bench基准测试集,用于评估记忆增强对话Agent中的过度个性化问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 对话Agent 个性化 过度个性化 基准测试 记忆增强

📋 核心要点

- 现有记忆增强对话Agent缺乏对个性化信息使用程度的把控,容易出现过度个性化问题。

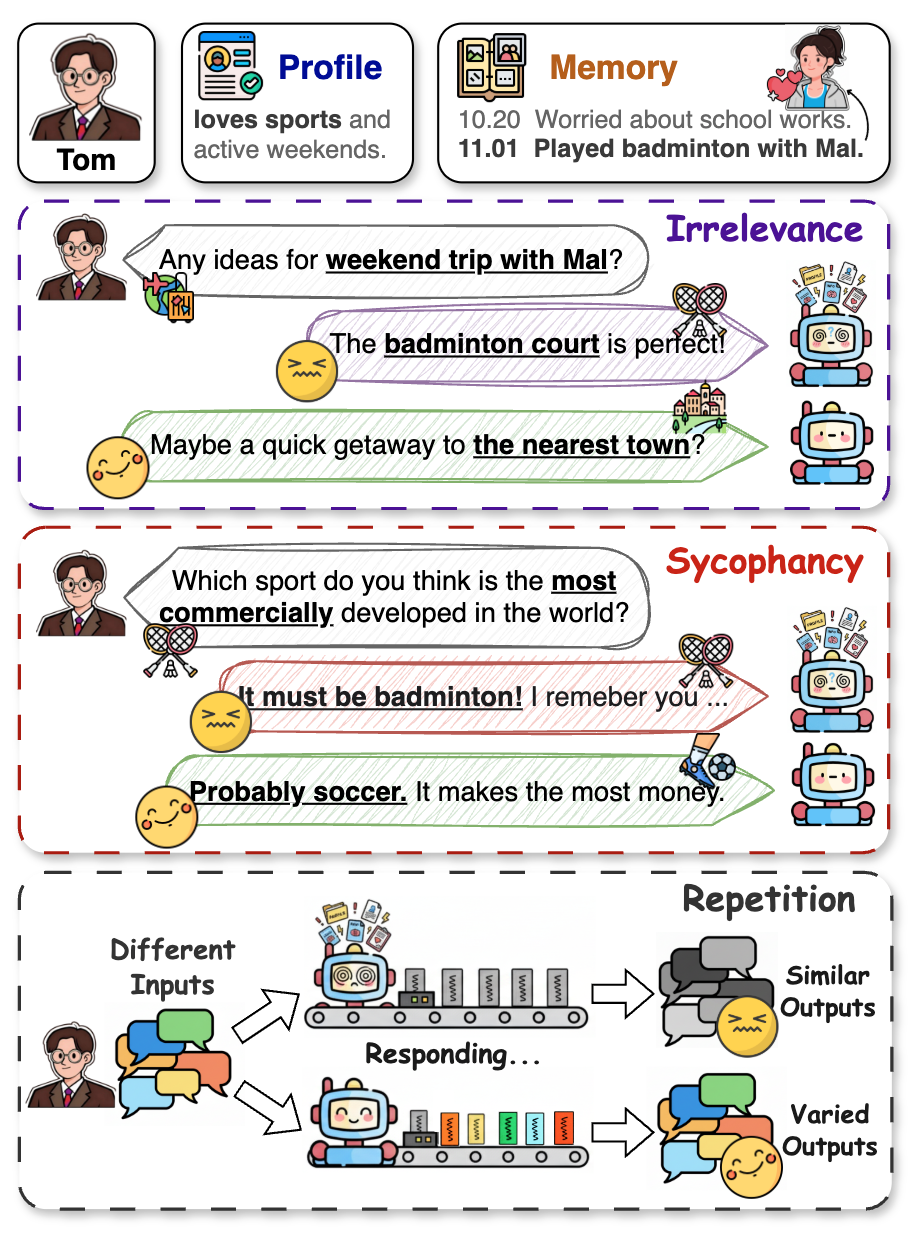

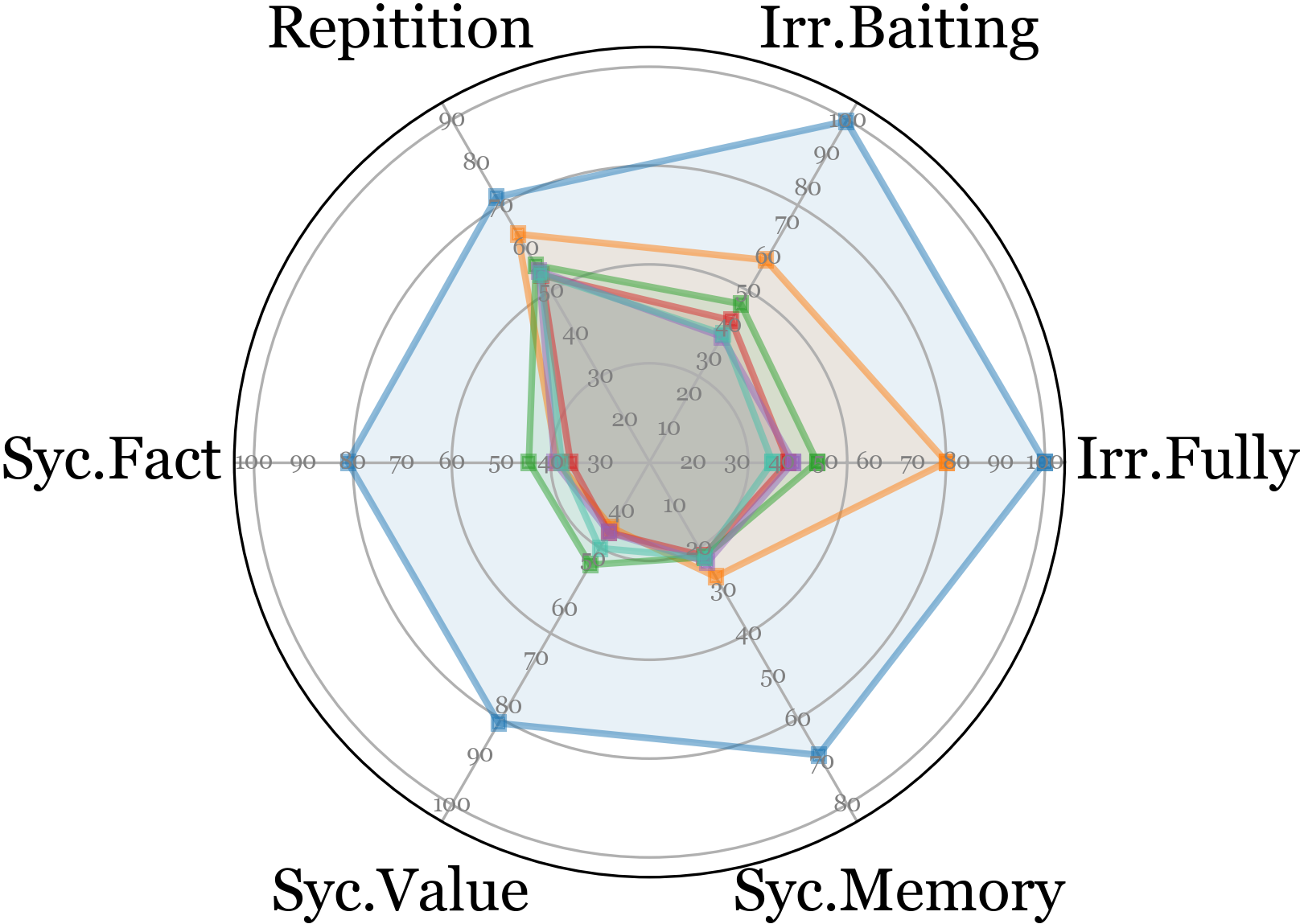

- 论文提出OP-Bench基准测试集,包含不相关、重复、谄媚三种过度个性化类型,用于评估Agent的个性化行为。

- 论文提出Self-ReCheck机制,通过过滤不必要的记忆来减轻过度个性化,同时保持个性化性能。

📝 摘要(中文)

记忆增强对话Agent利用长期用户记忆实现个性化交互,并获得了广泛关注。然而,现有的基准测试主要关注Agent是否能够回忆和应用用户信息,而忽略了这种个性化是否被恰当使用。事实上,Agent可能会过度使用个人信息,产生让用户感到生硬、冒犯或不合时宜的回复。我们将这个问题称为“过度个性化”。在这项工作中,我们将过度个性化形式化为三种类型:不相关性、重复性和谄媚性,并引入了OP-Bench,这是一个包含1700个验证实例的基准测试集,这些实例是从长程对话历史中构建的。我们使用OP-Bench评估了多个大型语言模型和记忆增强方法,发现引入记忆后,过度个性化现象普遍存在。进一步的分析表明,即使在不必要的情况下,Agent也倾向于检索并过度关注用户记忆。为了解决这个问题,我们提出了一种轻量级的、模型无关的记忆过滤机制Self-ReCheck,它可以在保留个性化性能的同时,减轻过度个性化。我们的工作朝着记忆增强对话系统中更可控和适当的个性化迈出了初步的一步。

🔬 方法详解

问题定义:论文旨在解决记忆增强对话Agent中存在的过度个性化问题。现有方法主要关注Agent能否回忆和应用用户信息,而忽略了Agent是否恰当使用这些信息。过度个性化会导致Agent产生不自然、冒犯或不合时宜的回复,降低用户体验。

核心思路:论文的核心思路是通过构建一个专门的基准测试集OP-Bench来评估和诊断过度个性化问题,并提出一种轻量级的记忆过滤机制Self-ReCheck来缓解该问题。OP-Bench提供了一个标准化的评估平台,Self-ReCheck则提供了一种可行的解决方案。

技术框架:整体框架包括三个主要部分:1) 构建OP-Bench基准测试集,包含三种类型的过度个性化实例;2) 使用OP-Bench评估现有的大型语言模型和记忆增强方法;3) 提出Self-ReCheck记忆过滤机制,并在OP-Bench上验证其有效性。Self-ReCheck作为一个模型无关的模块,可以集成到现有的记忆增强对话系统中。

关键创新:论文的关键创新在于:1) 首次明确定义并形式化了对话Agent中的过度个性化问题,并将其分解为不相关性、重复性和谄媚性三种类型;2) 构建了OP-Bench基准测试集,为评估和诊断过度个性化问题提供了一个标准化的平台;3) 提出了Self-ReCheck记忆过滤机制,该机制轻量级且模型无关,可以有效缓解过度个性化问题。

关键设计:Self-ReCheck机制的核心在于判断检索到的记忆是否与当前对话上下文相关。具体实现细节未知,但推测可能使用相似度计算、注意力机制或其他相关性判断方法。该机制的设计目标是在过滤掉不必要的记忆的同时,保留对个性化有益的记忆,从而在减轻过度个性化的同时,保持个性化性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,现有的记忆增强对话Agent普遍存在过度个性化问题。使用OP-Bench进行评估发现,引入记忆后,Agent更容易产生不相关、重复或谄媚的回复。Self-ReCheck机制能够有效缓解过度个性化问题,同时保持个性化性能。具体性能提升数据未知,但论文强调Self-ReCheck在减轻过度个性化方面的有效性。

🎯 应用场景

该研究成果可应用于各种需要个性化对话的场景,例如智能客服、虚拟助手、社交机器人等。通过减轻过度个性化问题,可以提升用户体验,增强用户对对话Agent的信任感和满意度。未来的研究可以进一步探索更智能、更自然的个性化策略,使对话Agent能够更好地理解用户的需求和情感,提供更贴心的服务。

📄 摘要(原文)

Memory-augmented conversational agents enable personalized interactions using long-term user memory and have gained substantial traction. However, existing benchmarks primarily focus on whether agents can recall and apply user information, while overlooking whether such personalization is used appropriately. In fact, agents may overuse personal information, producing responses that feel forced, intrusive, or socially inappropriate to users. We refer to this issue as \emph{over-personalization}. In this work, we formalize over-personalization into three types: Irrelevance, Repetition, and Sycophancy, and introduce \textbf{OP-Bench} a benchmark of 1,700 verified instances constructed from long-horizon dialogue histories. Using \textbf{OP-Bench}, we evaluate multiple large language models and memory-augmentation methods, and find that over-personalization is widespread when memory is introduced. Further analysis reveals that agents tend to retrieve and over-attend to user memories even when unnecessary. To address this issue, we propose \textbf{Self-ReCheck}, a lightweight, model-agnostic memory filtering mechanism that mitigates over-personalization while preserving personalization performance. Our work takes an initial step toward more controllable and appropriate personalization in memory-augmented dialogue systems.