Dr. Assistant: Enhancing Clinical Diagnostic Inquiry via Structured Diagnostic Reasoning Data and Reinforcement Learning

作者: Yue Guo, Fanfu Wang, Jianwei Lv, Xincheng Shi, Yuchen Li, Youya Wang, Yunsheng Zeng, Yujing Liu, Yunhao Qiao, Gen Li, Junfeng Wang, Bo Yuan

分类: cs.CL

发布日期: 2026-01-20

💡 一句话要点

提出Dr. Assistant,通过结构化推理数据和强化学习增强临床诊断问询能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 临床决策支持系统 大型语言模型 诊断推理 强化学习 临床诊断推理数据 医疗AI 自然语言处理

📋 核心要点

- 现有临床决策支持系统维护成本高,泛化能力弱,大型语言模型在诊断推理和问询方面存在局限性。

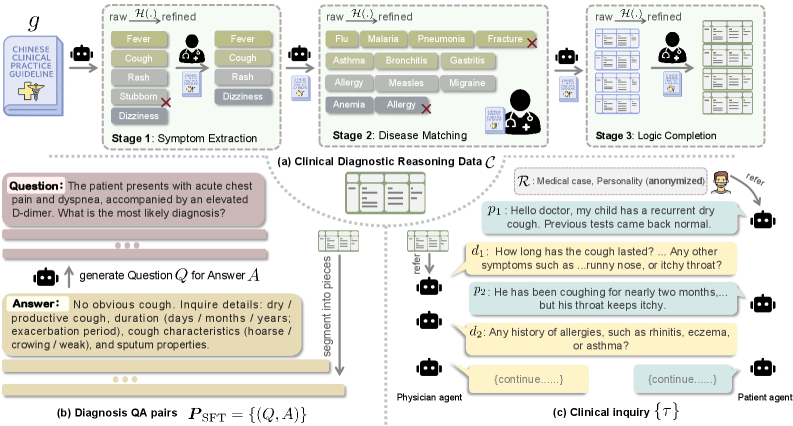

- 论文提出临床诊断推理数据结构(CDRD)来捕获临床推理逻辑,并设计Dr. Assistant模型。

- Dr. Assistant通过SFT和强化学习进行训练,实验结果表明其性能优于开源模型,并与闭源模型具有竞争力。

📝 摘要(中文)

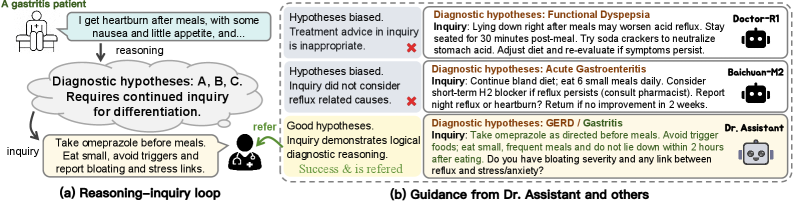

临床决策支持系统(CDSSs)为医生提供推理和问询指导,但面临维护成本高和泛化能力低等挑战。近年来,大型语言模型(LLMs)因其广泛的知识储备、检索和沟通能力而被广泛应用于医疗保健领域。虽然LLMs在医疗基准测试中表现出色,但其诊断推理和问询技能仍受到限制。为了解决这个问题,我们提出了(1)临床诊断推理数据(CDRD)结构,用于捕获抽象的临床推理逻辑,以及构建CDRD的流程;(2)Dr. Assistant,一个具备临床推理和问询技能的临床诊断模型。其训练包括两个阶段:SFT,然后是使用定制奖励函数的RL。我们还引入了一个基准来评估诊断推理和问询。实验表明,Dr. Assistant优于开源模型,并实现了与闭源模型具有竞争力的性能,为临床诊断问询指导提供了一个有效的解决方案。

🔬 方法详解

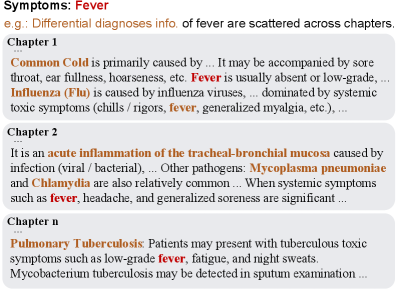

问题定义:现有临床决策支持系统(CDSSs)面临维护成本高、泛化能力差的问题。大型语言模型(LLMs)虽然在医疗领域展现出潜力,但在诊断推理和问询技能方面仍存在不足,无法很好地模拟医生进行诊断时的推理过程和提问策略。

核心思路:论文的核心思路是利用结构化的临床诊断推理数据(CDRD)来指导LLM进行诊断推理和问询。通过构建CDRD,将抽象的临床推理逻辑显式地表示出来,并利用强化学习来训练模型,使其能够更好地进行诊断推理和问询。

技术框架:Dr. Assistant的训练包含两个阶段:(1)监督微调(SFT):使用CDRD对LLM进行微调,使其初步具备临床推理和问询能力。(2)强化学习(RL):使用定制的奖励函数对模型进行强化学习,进一步提升其诊断推理和问询能力。同时,论文还提出了一个新的基准来评估模型的诊断推理和问询能力。

关键创新:论文的关键创新在于提出了临床诊断推理数据(CDRD)结构,这是一种用于捕获抽象临床推理逻辑的结构化数据。CDRD的构建使得模型能够更好地理解和学习临床推理过程,从而提升诊断推理和问询能力。此外,定制的奖励函数也对强化学习起到了关键作用。

关键设计:论文中定制的奖励函数是强化学习阶段的关键设计。奖励函数的设计需要充分考虑临床诊断的特点,例如,诊断的准确性、问询的效率和相关性等。具体的参数设置和网络结构等技术细节在论文中可能有所描述,但摘要中未明确提及,属于未知信息。

🖼️ 关键图片

📊 实验亮点

Dr. Assistant在实验中表现出色,优于开源模型,并实现了与闭源模型具有竞争力的性能。这表明该方法在提升临床诊断问询能力方面具有显著效果。论文还提出了一个新的基准来评估诊断推理和问询,为该领域的研究提供了新的评估工具。

🎯 应用场景

该研究成果可应用于构建更智能、更高效的临床决策支持系统,辅助医生进行诊断和治疗决策。Dr. Assistant有望降低医疗成本,提高诊断准确率,并为医疗资源匮乏地区提供远程医疗支持。未来,该技术还可扩展到其他医疗领域,如疾病预测和个性化治疗。

📄 摘要(原文)

Clinical Decision Support Systems (CDSSs) provide reasoning and inquiry guidance for physicians, yet they face notable challenges, including high maintenance costs and low generalization capability. Recently, Large Language Models (LLMs) have been widely adopted in healthcare due to their extensive knowledge reserves, retrieval, and communication capabilities. While LLMs show promise and excel at medical benchmarks, their diagnostic reasoning and inquiry skills are constrained. To mitigate this issue, we propose (1) Clinical Diagnostic Reasoning Data (CDRD) structure to capture abstract clinical reasoning logic, and a pipeline for its construction, and (2) the Dr. Assistant, a clinical diagnostic model equipped with clinical reasoning and inquiry skills. Its training involves a two-stage process: SFT, followed by RL with a tailored reward function. We also introduce a benchmark to evaluate both diagnostic reasoning and inquiry. Our experiments demonstrate that the Dr. Assistant outperforms open-source models and achieves competitive performance to closed-source models, providing an effective solution for clinical diagnostic inquiry guidance.