Hierarchical Orthogonal Residual Spread for Precise Massive Editing in Large Language Models

作者: Xiaojie Gu, Guangxu Chen, Yuheng Yang, Jingxin Han, Andi Zhang

分类: cs.CL, cs.AI, cs.LG

发布日期: 2026-01-16

备注: ICASSP 2026

🔗 代码/项目: GITHUB

💡 一句话要点

提出HORSE方法,通过分层正交残差扩展实现大语言模型中的精确批量编辑。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 模型编辑 知识干预 正交残差 分层结构

📋 核心要点

- 现有模型编辑方法侧重优化信息矩阵,但计算成本高昂,易产生知识冲突,影响编辑效果。

- HORSE方法关注信息矩阵的分层正交残差扩展,旨在减少噪声梯度,实现更稳定和精确的模型编辑。

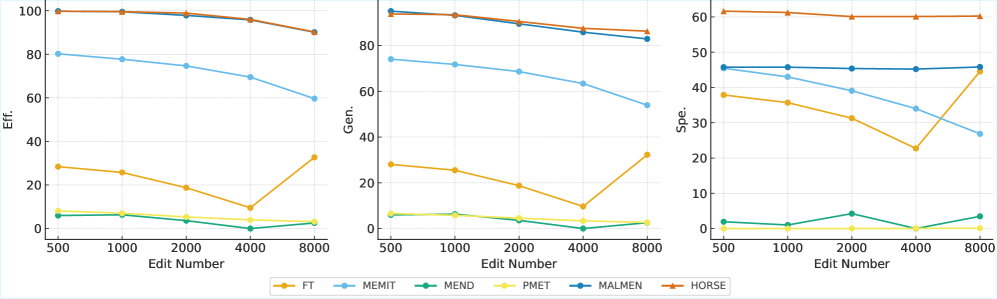

- 实验结果表明,HORSE在多种LLM和数据集上,能够保持精确的大规模编辑能力,优于现有方法。

📝 摘要(中文)

大型语言模型(LLMs)在各个领域表现出卓越的性能,但同时也面临着严重的安全问题。模型编辑已成为缓解这些问题的有效方法。现有的模型编辑方法通常侧重于优化融合新旧知识的信息矩阵。虽然有效,但这些方法计算成本可能很高,并可能导致冲突。相比之下,我们将注意力转移到信息矩阵的分层正交残差扩展(Hierarchical Orthogonal Residual SprEad, HORSE)上,从不同的角度减少噪声梯度,从而实现更稳定的编辑。通过与几种流行方法的清晰理论比较以及在多个LLM的两个数据集上进行的大量实验,我们证明了HORSE的有效性。结果表明,HORSE在各种场景中保持了精确的大规模编辑。代码可在https://github.com/XiaojieGu/HORSE 获取。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)中模型编辑的效率和稳定性问题。现有方法,如直接优化信息矩阵,计算复杂度高,容易引入噪声梯度,导致编辑不稳定,甚至产生知识冲突,影响编辑的精确性。

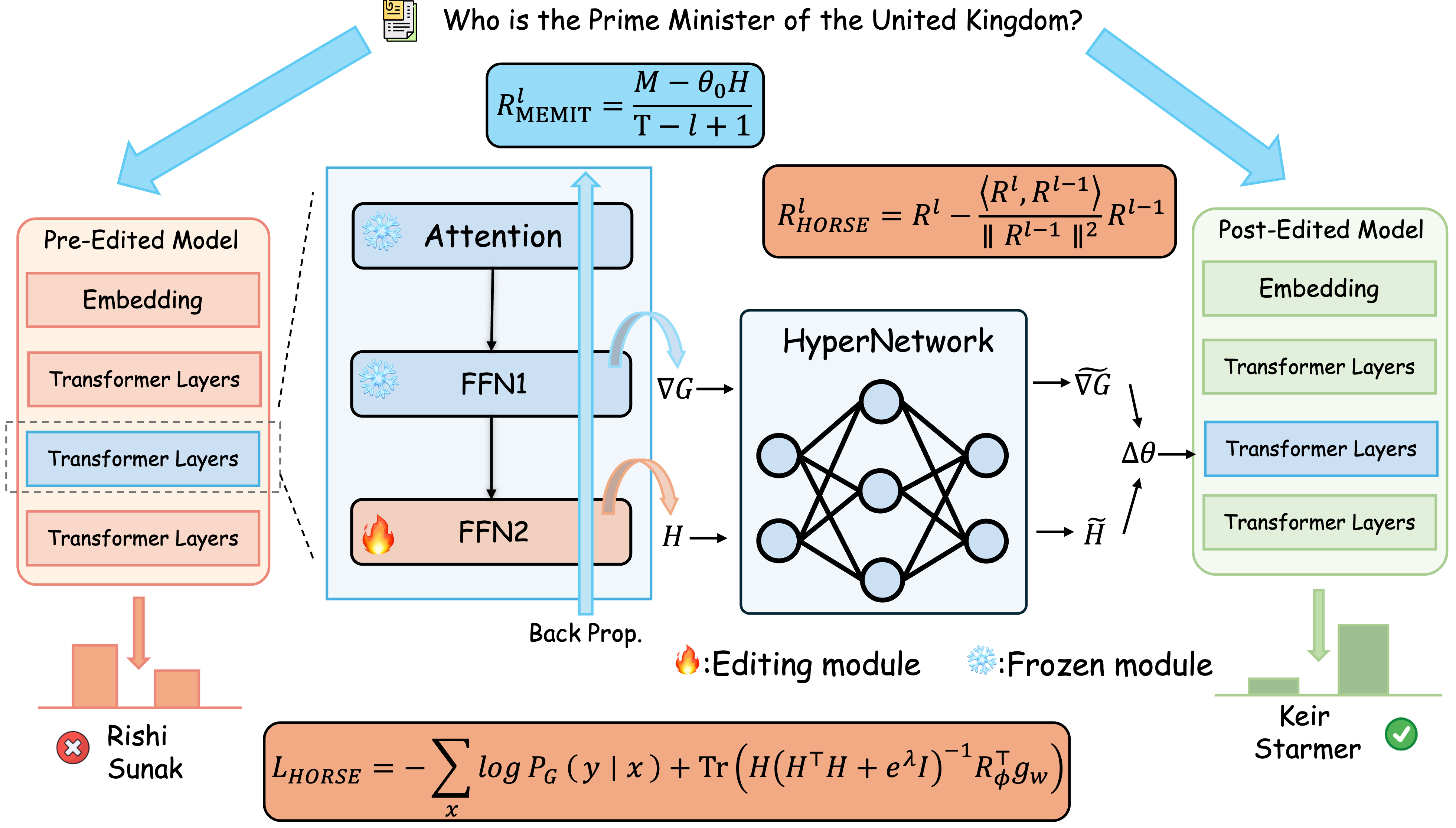

核心思路:论文的核心思路是利用信息矩阵的分层正交残差扩展(Hierarchical Orthogonal Residual Spread, HORSE)。通过正交化残差,减少不同编辑之间的干扰,降低噪声梯度的影响,从而实现更稳定和精确的批量编辑。分层结构允许对不同层次的知识进行编辑,提高灵活性。

技术框架:HORSE方法主要包含以下几个阶段:1) 确定需要编辑的知识;2) 构建信息矩阵,该矩阵融合了新旧知识;3) 对信息矩阵进行分层正交残差扩展,提取关键的残差信息;4) 利用提取的残差信息更新模型参数,实现知识编辑。整体流程旨在减少编辑过程中的噪声,提高编辑的稳定性和精确性。

关键创新:HORSE的关键创新在于其分层正交残差扩展机制。与直接优化信息矩阵的方法不同,HORSE通过正交化残差,降低了不同编辑之间的耦合性,减少了噪声梯度的影响。分层结构允许对不同层次的知识进行编辑,提高了编辑的灵活性和可控性。

关键设计:HORSE的关键设计包括:1) 正交化方法:具体采用何种正交化算法(如Gram-Schmidt正交化)来保证残差之间的正交性;2) 分层结构:如何确定分层结构,以及每一层所代表的知识粒度;3) 残差扩展:如何利用残差信息更新模型参数,以及如何控制更新的幅度,避免过度修改模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,HORSE方法在多个LLM和数据集上均取得了显著的性能提升。相较于现有模型编辑方法,HORSE能够更精确地进行大规模编辑,同时保持更好的模型稳定性和泛化能力。具体的性能数据(如编辑成功率、知识保留率等)需要在论文中查找。

🎯 应用场景

该研究成果可应用于各种需要对大型语言模型进行安全干预的场景,例如:过滤有害信息、修正错误知识、调整模型偏见等。通过精确的模型编辑,可以提高LLM的安全性、可靠性和公平性,使其更好地服务于人类社会。未来,该技术有望应用于个性化模型定制、知识图谱更新等领域。

📄 摘要(原文)

Large language models (LLMs) exhibit exceptional performance across various domains, yet they face critical safety concerns. Model editing has emerged as an effective approach to mitigate these issues. Existing model editing methods often focus on optimizing an information matrix that blends new and old knowledge. While effective, these approaches can be computationally expensive and may cause conflicts. In contrast, we shift our attention to Hierarchical Orthogonal Residual SprEad of the information matrix, which reduces noisy gradients and enables more stable edits from a different perspective. We demonstrate the effectiveness of our method HORSE through a clear theoretical comparison with several popular methods and extensive experiments conducted on two datasets across multiple LLMs. The results show that HORSE maintains precise massive editing across diverse scenarios. The code is available at https://github.com/XiaojieGu/HORSE