Neural Chain-of-Thought Search: Searching the Optimal Reasoning Path to Enhance Large Language Models

作者: Guoming Ling, Zhongzhan Huang, Yupei Lin, Junxin Li, Shanshan Zhong, Hefeng Wu, Liang Lin

分类: cs.CL

发布日期: 2026-01-16

🔗 代码/项目: GITHUB

💡 一句话要点

提出神经链式思考搜索(NCoTS),优化大语言模型的推理路径,提升准确率并减少计算成本。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 链式思考 大语言模型 推理优化 搜索算法 启发式搜索 动态规划 问题求解

📋 核心要点

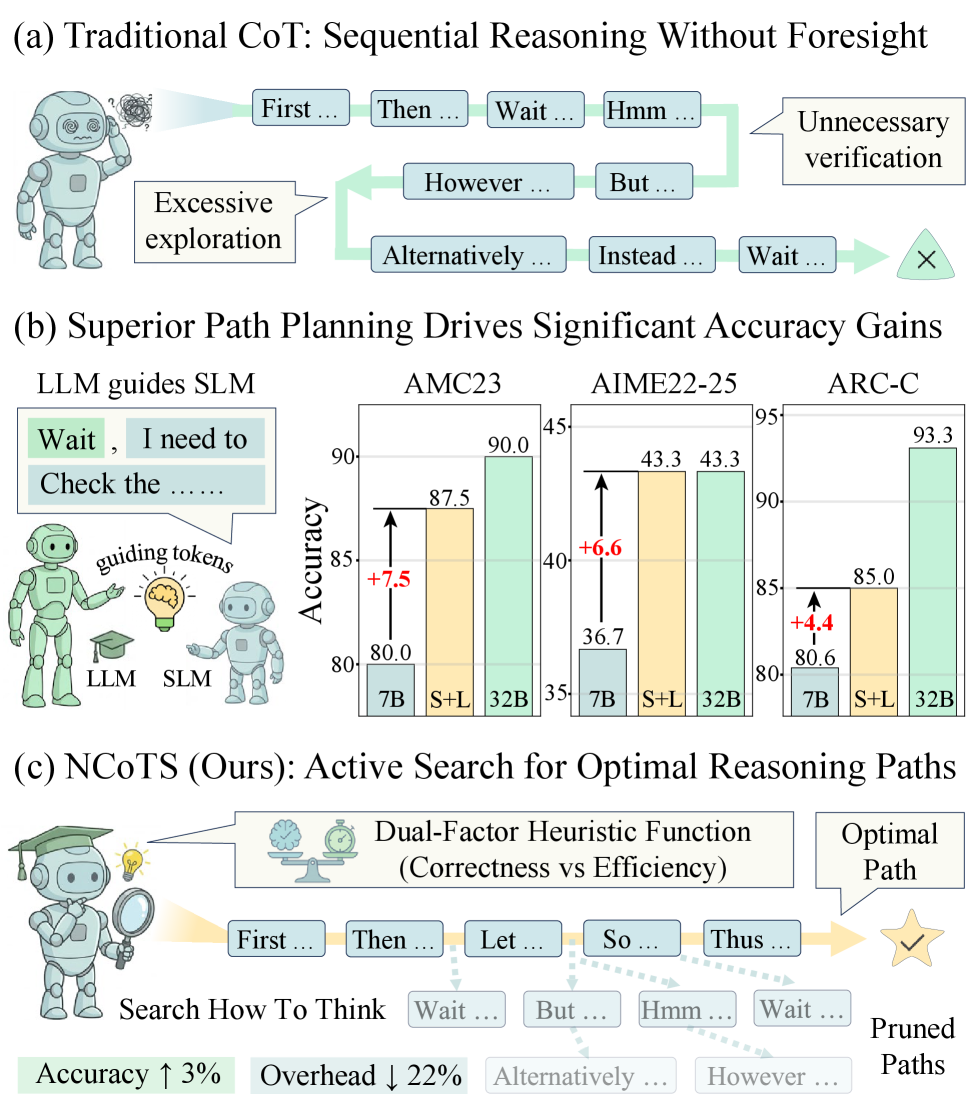

- 现有大语言模型在链式思考推理中,缺乏对推理路径的全局规划,容易陷入次优解,产生冗余步骤。

- NCoTS将推理过程视为动态搜索,通过评估候选推理算子,寻找最优的思考策略,从而提升推理效率。

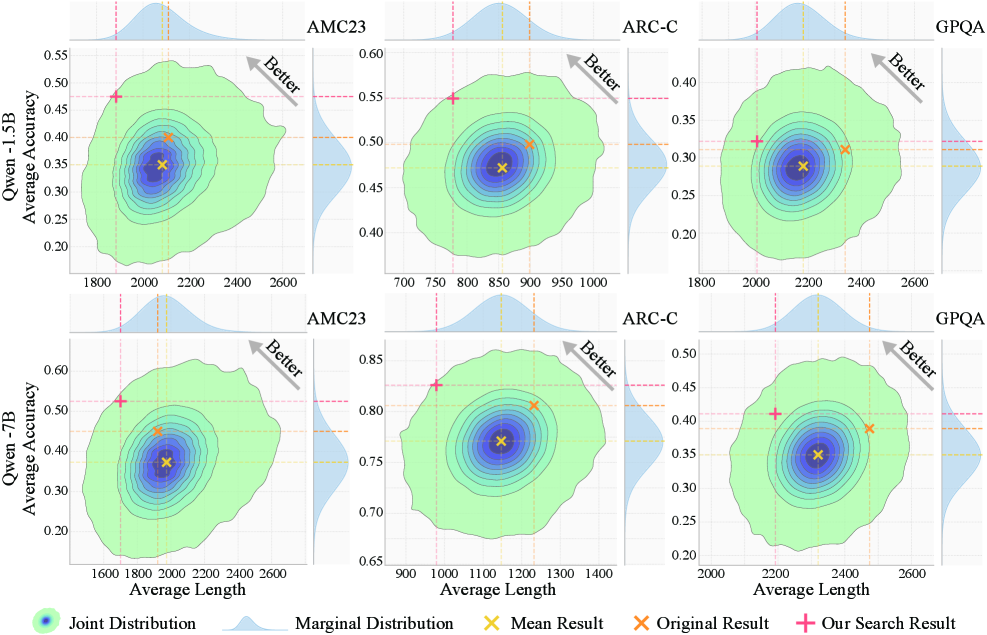

- 实验表明,NCoTS在多个推理基准测试中,显著提升了准确率(超过3.5%)并减少了生成长度(超过22%)。

📝 摘要(中文)

链式思考(Chain-of-Thought, CoT)推理显著提升了大语言模型的问题解决能力。然而,现有模型通常按顺序生成推理步骤,缺乏预见性,容易陷入冗余步骤的次优推理路径。本文提出了神经链式思考搜索(Neural Chain-of-Thought Search, NCoTS)框架,将推理过程重新定义为寻找最优思考策略的动态搜索。通过量化解空间,揭示了存在比标准输出更准确、更简洁的稀疏的优秀推理路径。NCoTS通过双因素启发式方法评估候选推理算子,优化正确性和计算成本,从而积极地导航到这些路径。在多个推理基准测试中,NCoTS实现了帕累托改进,在准确率提高超过3.5%的同时,生成长度减少超过22%。代码和数据已公开。

🔬 方法详解

问题定义:论文旨在解决大语言模型在链式思考推理过程中,由于缺乏全局规划而导致的推理路径冗余和效率低下问题。现有方法通常是顺序生成推理步骤,无法预见后续步骤的影响,容易陷入局部最优,产生不必要的计算开销。

核心思路:论文的核心思路是将链式思考推理过程建模为一个动态搜索问题,通过搜索算法寻找最优的推理路径。核心在于定义一个搜索空间,并设计有效的启发式搜索策略,引导模型探索更准确、更简洁的推理路径。

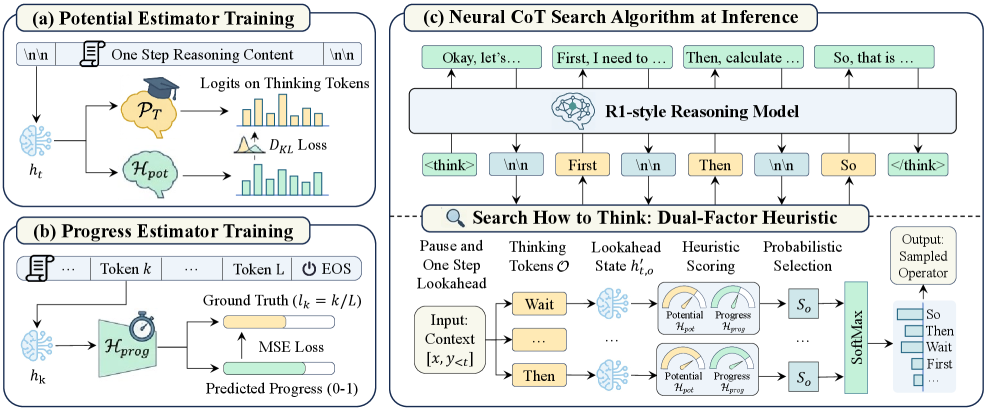

技术框架:NCoTS框架包含以下主要模块:1) 推理算子生成器:生成候选的推理步骤(即CoT中的每个reasoning step)。2) 双因素启发式评估器:评估每个候选推理算子的质量,综合考虑正确性和计算成本。3) 搜索算法:基于启发式评估结果,选择最优的推理算子,并迭代生成完整的推理路径。框架通过不断探索和评估不同的推理路径,最终找到最优的解决方案。

关键创新:NCoTS的关键创新在于将链式思考推理过程转化为一个可搜索的问题,并提出了双因素启发式评估方法。与传统的顺序生成方法不同,NCoTS能够主动探索不同的推理路径,并根据启发式评估结果进行选择,从而避免陷入局部最优。双因素启发式评估同时考虑了正确性和计算成本,使得模型能够在保证准确率的同时,减少计算开销。

关键设计:双因素启发式评估器是NCoTS的关键设计。具体而言,它包含两个部分:1) 正确性评估:使用一个预训练的语言模型来评估候选推理步骤的正确性。2) 计算成本评估:通过估计生成候选推理步骤所需的计算资源(例如,token数量),来评估计算成本。然后,将正确性和计算成本进行加权组合,得到最终的启发式评估值。论文中可能还涉及搜索算法的具体实现细节,例如搜索策略、剪枝策略等,但摘要中未详细说明。

🖼️ 关键图片

📊 实验亮点

NCoTS在多个推理基准测试中实现了显著的性能提升。具体而言,在保证准确率提高超过3.5%的同时,生成长度减少超过22%。这意味着NCoTS不仅能够更准确地解决问题,还能更高效地利用计算资源。这些实验结果表明,NCoTS是一种有效的优化大语言模型推理路径的方法。

🎯 应用场景

NCoTS框架可应用于各种需要复杂推理的任务,例如数学问题求解、常识推理、代码生成等。通过优化推理路径,可以提升大语言模型在这些任务上的性能,并降低计算成本。该研究对于提升AI系统的智能化水平和降低能源消耗具有重要意义,未来可能应用于智能客服、自动驾驶、医疗诊断等领域。

📄 摘要(原文)

Chain-of-Thought reasoning has significantly enhanced the problem-solving capabilities of Large Language Models. Unfortunately, current models generate reasoning steps sequentially without foresight, often becoming trapped in suboptimal reasoning paths with redundant steps. In contrast, we introduce Neural Chain-of-Thought Search (NCoTS), a framework that reformulates reasoning as a dynamic search for the optimal thinking strategy. By quantitatively characterizing the solution space, we reveal the existence of sparse superior reasoning paths that are simultaneously more accurate and concise than standard outputs. Our method actively navigates towards these paths by evaluating candidate reasoning operators using a dual-factor heuristic that optimizes for both correctness and computational cost. Consequently, NCoTS achieves a Pareto improvement across diverse reasoning benchmarks, boosting accuracy by over 3.5% while reducing generation length by over 22%. Our code and data are available at https://github.com/MilkThink-Lab/Neural-CoT-Search.