SubTokenTest: A Practical Benchmark for Real-World Sub-token Understanding

作者: Shuyang Hou, Yi Hu, Muhan Zhang

分类: cs.CL, cs.AI

发布日期: 2026-01-14

💡 一句话要点

SubTokenTest:一个评估LLM在现实场景中子词理解能力的实用基准测试。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 子词理解 基准测试 分词算法 文本导航 表格理解 字符级别任务 模型评估

📋 核心要点

- 现有LLM在字符级别任务上表现不佳,根源在于其分词过程,但现有基准测试缺乏实际应用场景。

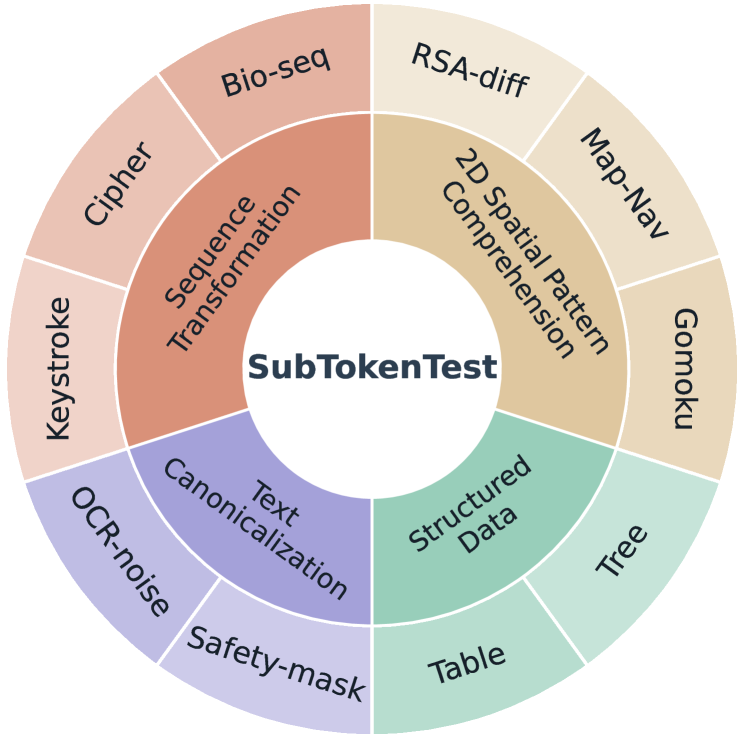

- 论文提出SubTokenTest基准,包含四个领域十个实用任务,旨在评估LLM在真实场景下的子词理解能力。

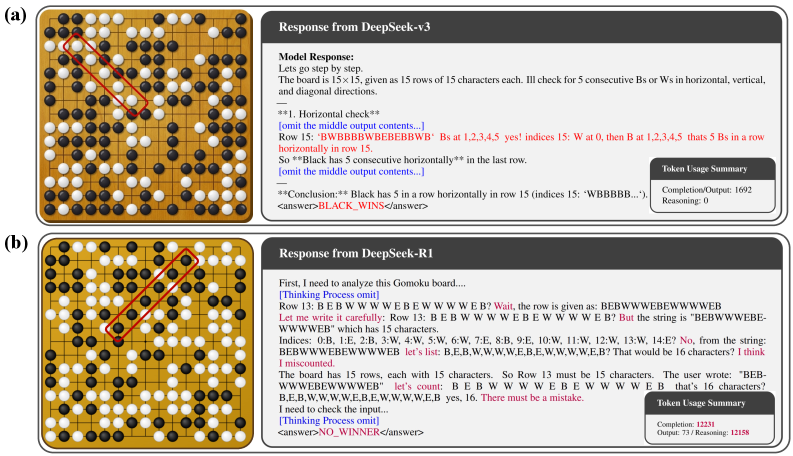

- 通过对九个先进LLM的评估,揭示了模型在子词推理上的不足,并探索了测试时缩放和隐藏状态编码的影响。

📝 摘要(中文)

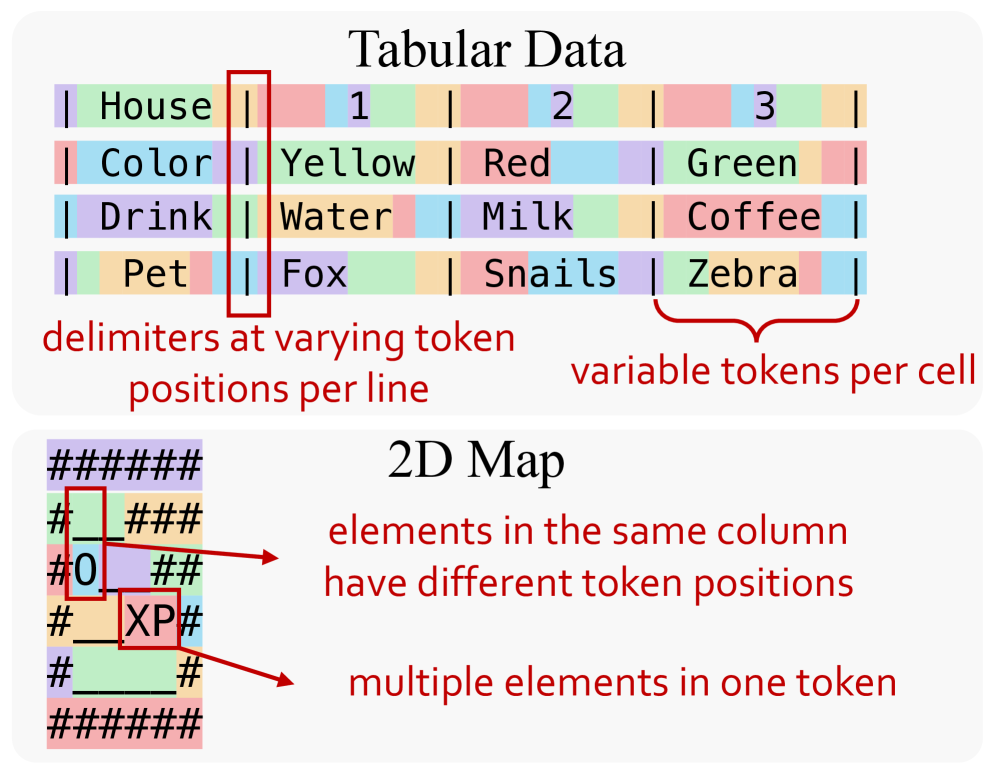

大型语言模型(LLM)的最新进展显著增强了其推理能力。然而,它们在基本的字符级别任务(例如计算单词中的字母数)方面仍然存在困难,这源于其分词过程。虽然现有的基准测试通过基本的字符操作突出了这一弱点,但由于缺乏实际相关性,这些失败通常被忽视。然而,许多实际应用,例如导航基于文本的地图或解释结构化表格,都严重依赖于精确的子词理解。为此,我们引入了SubTokenTest,这是一个全面的基准测试,通过实用的、效用驱动的任务来评估子词理解。我们的基准测试包括跨四个领域的十个任务,并通过将性能与复杂的推理分离来隔离与分词相关的失败。我们对九个先进的LLM进行了全面的评估。此外,我们还研究了测试时缩放对子词推理的影响,并探讨了字符级别的信息是如何在隐藏状态中编码的。

🔬 方法详解

问题定义:现有的大型语言模型在处理字符级别的任务时表现不佳,例如计算单词中的字母数量。这主要是由于模型的分词(tokenization)过程造成的。虽然现有的基准测试已经暴露了这个问题,但由于缺乏实际应用场景,这些问题往往被忽略。因此,需要一个更贴近实际应用的基准来评估模型在子词层面的理解能力。

核心思路:论文的核心思路是构建一个名为SubTokenTest的基准测试,该基准包含一系列实用的、效用驱动的任务,这些任务需要模型具备良好的子词理解能力。通过设计这些任务,可以更准确地评估模型在真实场景下的表现,并找出模型在子词理解方面的不足。

技术框架:SubTokenTest基准测试包含四个领域,共十个任务。这些任务的设计旨在隔离与分词相关的失败,并避免复杂的推理过程对评估结果产生干扰。通过对九个先进的LLM进行评估,可以全面了解模型在子词理解方面的能力。此外,论文还研究了测试时缩放对子词推理的影响,并探索了字符级别的信息是如何在隐藏状态中编码的。

关键创新:该论文的关键创新在于提出了SubTokenTest基准测试,该基准测试专注于评估LLM在实际应用场景中的子词理解能力。与现有的基准测试相比,SubTokenTest更加实用,并且能够更准确地反映模型在真实场景下的表现。

关键设计:SubTokenTest基准测试包含十个任务,这些任务涵盖了不同的领域,例如文本导航和表格理解。每个任务都经过精心设计,以确保能够有效地评估模型在子词理解方面的能力。此外,论文还对九个先进的LLM进行了评估,并分析了测试时缩放和隐藏状态编码对模型性能的影响。具体的任务设计和评估指标在论文中有详细描述,但在此处无法完全展开。

🖼️ 关键图片

📊 实验亮点

论文对九个先进的LLM进行了全面评估,揭示了它们在SubTokenTest基准测试上的性能差异。实验结果表明,即使是大型LLM在子词理解方面仍然存在不足。此外,研究还发现测试时缩放可以提高模型的性能,并深入分析了字符级别信息在隐藏状态中的编码方式。具体的性能数据和对比基线在论文中有详细呈现。

🎯 应用场景

该研究成果可应用于提升LLM在各种实际场景中的性能,例如文本导航、表格数据处理、代码理解和生成等。通过提高LLM的子词理解能力,可以使其更好地处理复杂的文本信息,从而在信息检索、自然语言推理和机器翻译等领域发挥更大的作用。未来,该研究可以促进LLM在更多实际应用中的部署和发展。

📄 摘要(原文)

Recent advancements in large language models (LLMs) have significantly enhanced their reasoning capabilities. However, they continue to struggle with basic character-level tasks, such as counting letters in words, a problem rooted in their tokenization process. While existing benchmarks have highlighted this weakness through basic character operations, such failures are often dismissed due to lacking practical relevance. Yet, many real-world applications, such as navigating text-based maps or interpreting structured tables, rely heavily on precise sub-token understanding. In this regard, we introduce SubTokenTest, a comprehensive benchmark that assesses sub-token understanding through practical, utility-driven tasks. Our benchmark includes ten tasks across four domains and isolates tokenization-related failures by decoupling performance from complex reasoning. We provide a comprehensive evaluation of nine advanced LLMs. Additionally, we investigate the impact of test-time scaling on sub-token reasoning and explore how character-level information is encoded within the hidden states.