Enhancing Self-Correction in Large Language Models through Multi-Perspective Reflection

作者: Mariana Costa, Alberlucia Rafael Soarez, Daniel Kim, Camila Ferreira

分类: cs.CL

发布日期: 2026-01-12

💡 一句话要点

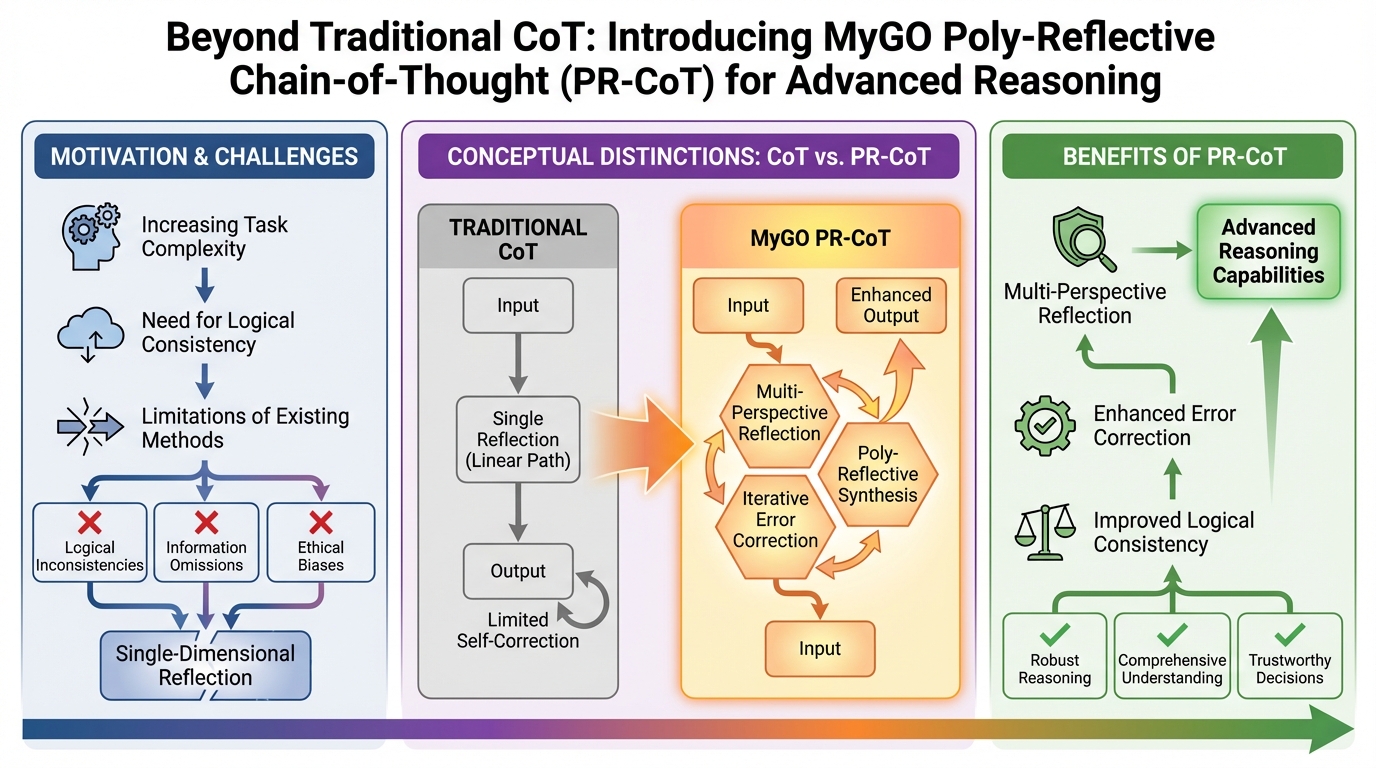

提出PR-CoT,通过多视角反思增强大语言模型的自我纠错能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 自我纠错 多视角反思 链式思考 提示工程

📋 核心要点

- 现有CoT方法在复杂任务和伦理敏感任务中,一致性、准确性和自我纠错能力不足。

- PR-CoT通过提示LLM从逻辑、信息、伦理和替代方案等多角度反思,提升推理质量。

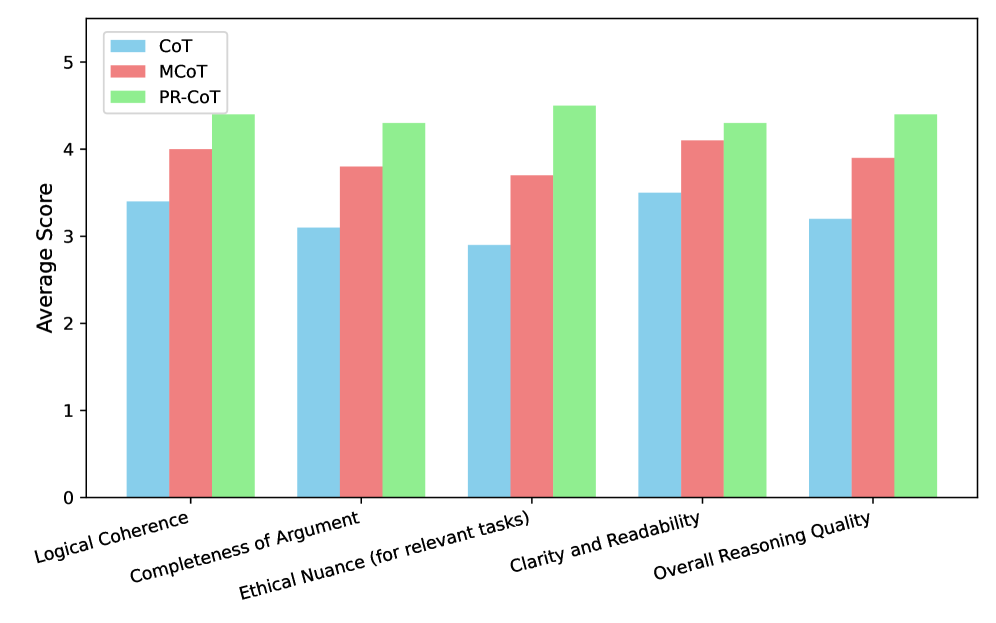

- 实验表明,PR-CoT在算术、常识、伦理和逻辑任务上优于传统CoT和现有反思方法。

📝 摘要(中文)

本文提出了一种名为多视角反思链(PR-CoT)的新方法,旨在提升大型语言模型(LLM)的推理能力,尤其是在一致性、准确性和自我纠错方面。现有方法在复杂或涉及伦理的任务中表现不足。PR-CoT通过结构化的多视角反思,在初始CoT之后,引导LLM从逻辑一致性、信息完整性、偏见/伦理以及替代方案等多个预定义角度进行自我评估。该方法完全通过提示工程实现,无需模型再训练,即可将初始CoT改进为更稳健和准确的最终答案。在算术、常识、伦理决策和逻辑谜题等任务上的实验表明,PR-CoT优于传统的CoT和现有的反思方法,尤其在伦理决策等细微领域表现出显著优势。消融研究、人工评估和定性分析进一步验证了每个反思视角的贡献以及多视角反思范式在促进更可靠的LLM推理方面的整体有效性。

🔬 方法详解

问题定义:大型语言模型在复杂推理和伦理决策等任务中,常常出现逻辑不一致、信息不完整、带有偏见等问题,导致结果不准确或不合理。现有的单维度反思方法难以有效解决这些问题,无法充分提升模型的自我纠错能力。

核心思路:PR-CoT的核心在于引导LLM从多个不同的角度(逻辑一致性、信息完整性、伦理偏见、替代方案)对自身的推理过程进行反思和评估。通过多维度的审视,可以更全面地发现推理过程中的潜在问题,从而进行更有效的修正。

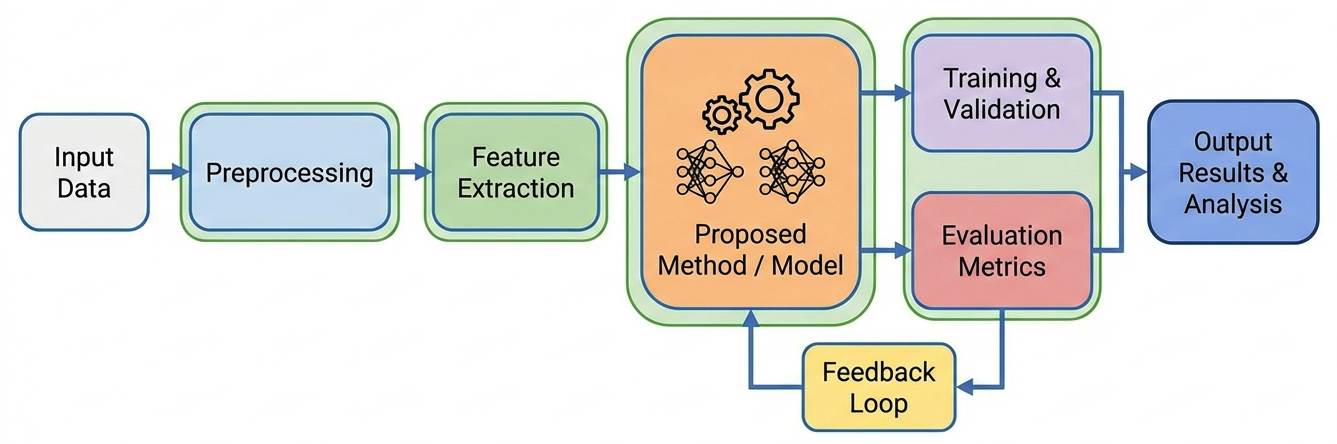

技术框架:PR-CoT的整体流程如下:首先,使用标准的Chain-of-Thought (CoT) 提示LLM生成初始推理过程和答案。然后,PR-CoT提示LLM从预定义的多个角度(逻辑一致性、信息完整性、伦理偏见、替代方案)对CoT过程进行自我评估。最后,基于多角度的反思结果,LLM对初始推理过程和答案进行修正,生成最终的答案。整个过程完全通过prompt engineering实现,无需模型训练。

关键创新:PR-CoT的关键创新在于引入了多视角反思机制。与以往的单维度反思方法不同,PR-CoT能够更全面地评估LLM的推理过程,从而更有效地发现和纠正错误。这种多视角的设计使得模型能够从不同的维度审视问题,避免了单一视角可能存在的盲点。

关键设计:PR-CoT的关键设计在于四个反思角度的选择:逻辑一致性确保推理过程的严谨性;信息完整性保证推理基于充分的事实;伦理偏见避免不公正或有害的结论;替代方案鼓励探索不同的解决方案。这些角度的选择旨在覆盖LLM推理中常见的错误来源。具体的提示语设计需要根据不同的任务进行调整,以引导LLM进行有效的反思。

🖼️ 关键图片

📊 实验亮点

实验结果表明,PR-CoT在算术、常识、伦理决策和逻辑谜题等任务上均优于传统的CoT和现有的反思方法。例如,在伦理决策任务中,PR-CoT的性能提升尤为显著,表明其在处理涉及伦理考量的复杂问题时具有更强的能力。消融研究也验证了每个反思视角的贡献。

🎯 应用场景

PR-CoT可应用于各种需要可靠推理和决策的场景,例如医疗诊断、金融分析、法律咨询等。通过提升LLM的自我纠错能力,可以减少错误决策带来的风险,提高工作效率和决策质量。未来,该方法有望应用于更广泛的领域,并与其他技术结合,构建更智能、更可靠的人工智能系统。

📄 摘要(原文)

While Chain-of-Thought (CoT) prompting advances LLM reasoning, challenges persist in consistency, accuracy, and self-correction, especially for complex or ethically sensitive tasks. Existing single-dimensional reflection methods offer insufficient improvements. We propose MyGO Poly-Reflective Chain-of-Thought (PR-CoT), a novel methodology employing structured multi-perspective reflection. After initial CoT, PR-CoT guides the LLM to self-assess its reasoning across multiple predefined angles: logical consistency, information completeness, biases/ethics, and alternative solutions. Implemented purely via prompt engineering, this process refines the initial CoT into a more robust and accurate final answer without model retraining. Experiments across arithmetic, commonsense, ethical decision-making, and logical puzzles, using GPT-three point five and GPT-four models, demonstrate PR-CoT's superior performance. It significantly outperforms traditional CoT and existing reflection methods in logical consistency and error correction, with notable gains in nuanced domains like ethical decision-making. Ablation studies, human evaluations, and qualitative analyses further validate the contribution of each reflection perspective and the overall efficacy of our poly-reflective paradigm in fostering more reliable LLM reasoning.