A Unified Framework for Emotion Recognition and Sentiment Analysis via Expert-Guided Multimodal Fusion with Large Language Models

作者: Jiaqi Qiao, Xiujuan Xu, Xinran Li, Yu Liu

分类: cs.CL, cs.AI

发布日期: 2026-01-12

💡 一句话要点

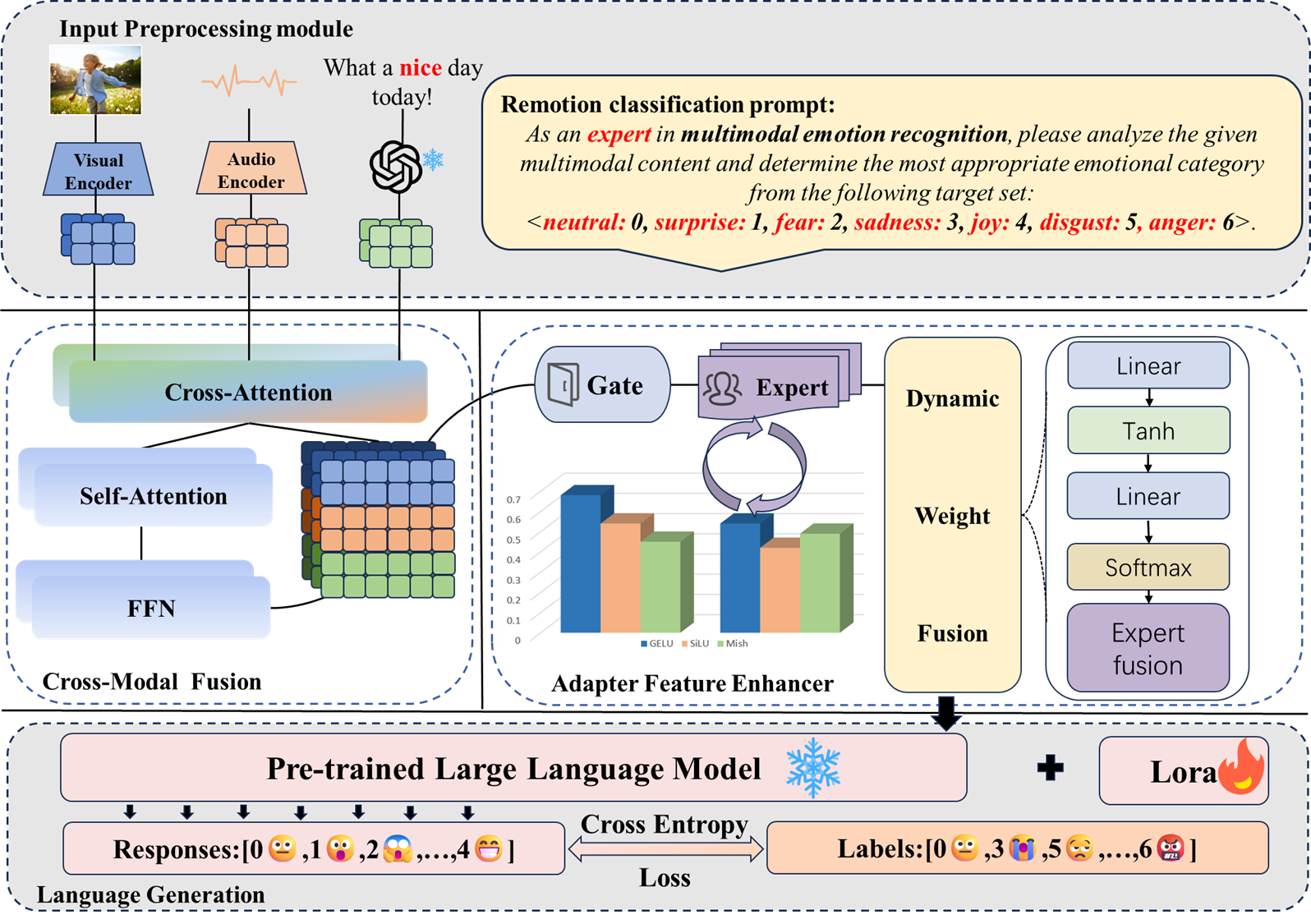

提出EGMF框架,通过专家引导的多模态融合与大语言模型,统一解决情感识别和情感分析任务。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态融合 情感识别 情感分析 大语言模型 专家系统

📋 核心要点

- 现有方法难以有效融合文本、音频和视觉等多模态信息,从而限制了情感理解的准确性。

- EGMF框架通过专家网络提取不同层面的情感特征,并利用分层动态门控机制进行自适应融合。

- 实验结果表明,EGMF在多个双语数据集上取得了显著的性能提升,并展现出良好的跨语言泛化能力。

📝 摘要(中文)

本文提出了一种统一框架EGMF,它结合了专家引导的多模态融合与大语言模型,用于离散情感识别和连续情感分析。该方法包含三个专业专家网络:用于捕捉细微情感的细粒度局部专家、用于建模跨模态关系的语义相关性专家,以及用于处理长程依赖的全局上下文专家。这些专家通过分层动态门控自适应地集成,实现上下文感知的特征选择。增强的多模态表示通过伪token注入和基于prompt的条件作用与大语言模型集成,使得单个生成框架能够通过自然语言生成处理分类和回归任务。采用LoRA微调以提高计算效率。在双语基准测试(MELD、CHERMA、MOSEI、SIMS-V2)上的实验表明,该方法优于现有技术,并且具有卓越的跨语言鲁棒性,揭示了英语和汉语中多模态情感表达的通用模式。源代码将会公开。

🔬 方法详解

问题定义:多模态情感理解需要有效整合文本、音频和视觉信息,以进行离散情感识别和连续情感分析。现有方法在处理细微情感差异、跨模态关系以及长程依赖方面存在不足,难以实现准确的情感理解。

核心思路:EGMF的核心在于利用多个专家网络分别提取不同层面的情感特征,并通过动态门控机制自适应地融合这些特征。这种设计旨在更全面地捕捉情感信息,并提高模型对不同模态之间复杂关系的理解能力。同时,结合大语言模型,将情感理解任务转化为自然语言生成任务,实现统一的框架。

技术框架:EGMF框架包含三个主要模块:专家网络、动态门控融合模块和大语言模型集成模块。专家网络由细粒度局部专家、语义相关性专家和全局上下文专家组成,分别负责提取细微情感、跨模态关系和长程依赖。动态门控融合模块根据上下文信息自适应地选择和融合专家网络的输出。大语言模型集成模块通过伪token注入和prompt-based conditioning将多模态表示与大语言模型结合,实现情感识别和情感分析。

关键创新:EGMF的关键创新在于专家引导的多模态融合机制和与大语言模型的集成方式。专家网络的设计能够更全面地捕捉情感信息,动态门控融合机制能够自适应地选择和融合特征,而与大语言模型的集成则使得模型能够以自然语言的形式输出情感理解结果。与现有方法相比,EGMF能够更有效地利用多模态信息,并实现更准确的情感理解。

关键设计:EGMF采用分层动态门控机制,根据上下文信息自适应地调整各个专家网络的权重。具体来说,门控机制由多个全连接层组成,输入为多模态特征,输出为各个专家网络的权重。此外,EGMF采用LoRA(Low-Rank Adaptation)微调大语言模型,以提高计算效率。损失函数包括情感分类损失和情感回归损失,用于训练模型的情感识别和情感分析能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,EGMF在MELD、CHERMA、MOSEI和SIMS-V2等双语基准数据集上均取得了显著的性能提升,超越了现有最先进的方法。尤其是在跨语言情感理解方面,EGMF展现出卓越的鲁棒性,验证了多模态情感表达的通用模式。具体性能提升数据未知,需参考论文原文。

🎯 应用场景

该研究成果可应用于智能客服、情感聊天机器人、心理健康监测、舆情分析等领域。通过准确理解用户的情感状态,可以提供更个性化、更贴心的服务,并为心理健康评估和干预提供技术支持。未来,该技术有望在人机交互、社交媒体分析等领域发挥更大的作用。

📄 摘要(原文)

Multimodal emotion understanding requires effective integration of text, audio, and visual modalities for both discrete emotion recognition and continuous sentiment analysis. We present EGMF, a unified framework combining expert-guided multimodal fusion with large language models. Our approach features three specialized expert networks--a fine-grained local expert for subtle emotional nuances, a semantic correlation expert for cross-modal relationships, and a global context expert for long-range dependencies--adaptively integrated through hierarchical dynamic gating for context-aware feature selection. Enhanced multimodal representations are integrated with LLMs via pseudo token injection and prompt-based conditioning, enabling a single generative framework to handle both classification and regression through natural language generation. We employ LoRA fine-tuning for computational efficiency. Experiments on bilingual benchmarks (MELD, CHERMA, MOSEI, SIMS-V2) demonstrate consistent improvements over state-of-the-art methods, with superior cross-lingual robustness revealing universal patterns in multimodal emotional expressions across English and Chinese. We will release the source code publicly.