ActiShade: Activating Overshadowed Knowledge to Guide Multi-Hop Reasoning in Large Language Models

作者: Huipeng Ma, Luan Zhang, Dandan Song, Linmei Hu, Yuhang Tian, Jun Yang, Changzhi Zhou, Chenhao Li, Yizhou Jin, Xudong Li, Meng Lin, Mingxing Zhang, Shuhao Zhang

分类: cs.CL

发布日期: 2026-01-12

备注: Accepted to AAAI 2026

💡 一句话要点

ActiShade:激活被掩盖知识,引导大语言模型进行多跳推理

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多跳推理 知识掩盖 检索增强生成 大语言模型 信息检索

📋 核心要点

- 多跳推理中,现有RAG方法易受知识掩盖影响,导致检索不相关信息,误差累积。

- ActiShade通过检测并激活被掩盖的关键短语,指导LLM生成更准确的查询。

- 实验证明,ActiShade在多个数据集和LLM上显著优于现有方法,提升推理性能。

📝 摘要(中文)

多跳推理中,多轮检索增强生成(RAG)方法通常依赖于LLM生成的内容作为检索查询。然而,这些方法容易受到知识掩盖的影响,即关键信息在生成过程中被掩盖。这导致LLM生成的内容不完整或不准确,进而导致不相关的检索,并在迭代过程中造成误差累积。为了解决这个问题,我们提出了ActiShade,它检测并激活被掩盖的关键短语,以指导LLM进行多跳推理。具体来说,ActiShade迭代地检测给定查询中被掩盖的关键短语,检索与查询和被掩盖的关键短语都相关的文档,并基于检索到的文档生成新的查询,以指导下一轮迭代。通过在下一轮查询的制定过程中补充被掩盖的知识,同时最大限度地减少不相关噪声的引入,ActiShade减少了由知识掩盖引起的误差累积。大量实验表明,ActiShade在多个数据集和LLM上优于现有方法。

🔬 方法详解

问题定义:论文旨在解决多跳推理任务中,由于大语言模型(LLM)在生成检索查询时出现“知识掩盖”现象,导致后续检索到的信息质量下降,最终影响推理准确性的问题。现有方法主要依赖LLM生成的内容作为检索query,但LLM生成的内容可能不完整或不准确,从而导致检索到的文档与推理目标的相关性降低,造成误差累积。

核心思路:ActiShade的核心思路是主动检测并激活被LLM生成内容掩盖的关键知识。通过识别query中被忽略的重要信息,并将其纳入后续的检索过程中,从而补充LLM在生成query时的不足,避免关键信息的丢失,提高检索质量。

技术框架:ActiShade的整体框架是一个迭代过程,主要包含以下几个模块:1) 掩盖知识检测:识别当前query中可能被掩盖的关键短语。2) 文档检索:基于原始query和检测到的被掩盖关键短语,检索相关文档。3) query生成:利用检索到的文档,生成新的query,用于下一轮迭代。这个过程不断循环,直到达到预设的迭代次数或满足停止条件。

关键创新:ActiShade的关键创新在于其主动检测和激活被掩盖知识的机制。与传统RAG方法直接使用LLM生成的query进行检索不同,ActiShade能够识别LLM可能忽略的关键信息,并将其补充到检索过程中,从而提高检索的准确性和完整性。这种方法有效地缓解了知识掩盖问题,减少了误差累积。

关键设计:ActiShade的具体实现细节包括:1) 使用特定的算法(具体算法未知)来检测被掩盖的关键短语。2) 检索模块同时考虑原始query和被掩盖的关键短语,以确保检索到的文档既与当前推理步骤相关,又包含被掩盖的知识。3) query生成模块利用检索到的文档,生成更全面、更准确的query,以指导下一轮迭代。具体的参数设置、损失函数和网络结构等技术细节在论文中可能有所描述,但摘要中未提及。

🖼️ 关键图片

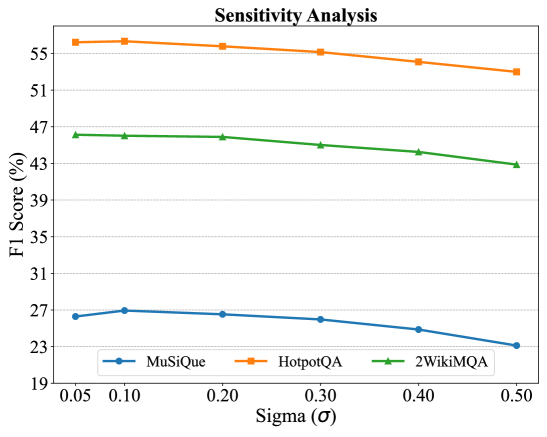

📊 实验亮点

实验结果表明,ActiShade在多个数据集和LLM上均优于现有方法。具体性能提升数据未知,但论文强调ActiShade能够有效减少知识掩盖引起的误差累积,从而显著提高多跳推理的准确性。ActiShade的有效性证明了主动激活被掩盖知识在多跳推理中的重要性。

🎯 应用场景

ActiShade技术可应用于问答系统、智能助手、知识图谱推理等领域。通过提升多跳推理的准确性和可靠性,ActiShade能够帮助用户更有效地获取和利用信息,解决复杂问题。未来,该技术有望在医疗诊断、金融分析、法律咨询等专业领域发挥重要作用。

📄 摘要(原文)

In multi-hop reasoning, multi-round retrieval-augmented generation (RAG) methods typically rely on LLM-generated content as the retrieval query. However, these approaches are inherently vulnerable to knowledge overshadowing - a phenomenon where critical information is overshadowed during generation. As a result, the LLM-generated content may be incomplete or inaccurate, leading to irrelevant retrieval and causing error accumulation during the iteration process. To address this challenge, we propose ActiShade, which detects and activates overshadowed knowledge to guide large language models (LLMs) in multi-hop reasoning. Specifically, ActiShade iteratively detects the overshadowed keyphrase in the given query, retrieves documents relevant to both the query and the overshadowed keyphrase, and generates a new query based on the retrieved documents to guide the next-round iteration. By supplementing the overshadowed knowledge during the formulation of next-round queries while minimizing the introduction of irrelevant noise, ActiShade reduces the error accumulation caused by knowledge overshadowing. Extensive experiments show that ActiShade outperforms existing methods across multiple datasets and LLMs.