World model inspired sarcasm reasoning with large language model agents

作者: Keito Inoshita, Shinnosuke Mizuno

分类: cs.CL

发布日期: 2025-12-30

💡 一句话要点

提出WM-SAR框架,利用世界模型指导的大语言模型智能体进行反讽推理

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 反讽检测 自然语言处理 大语言模型 世界模型 可解释性

📋 核心要点

- 现有反讽理解方法依赖黑盒预测,缺乏对认知因素的结构化解释,难以捕捉语义与规范期望的差异。

- WM-SAR将反讽理解建模为世界模型指导的推理过程,分解为字面意义、语境、规范期望和意图等智能体。

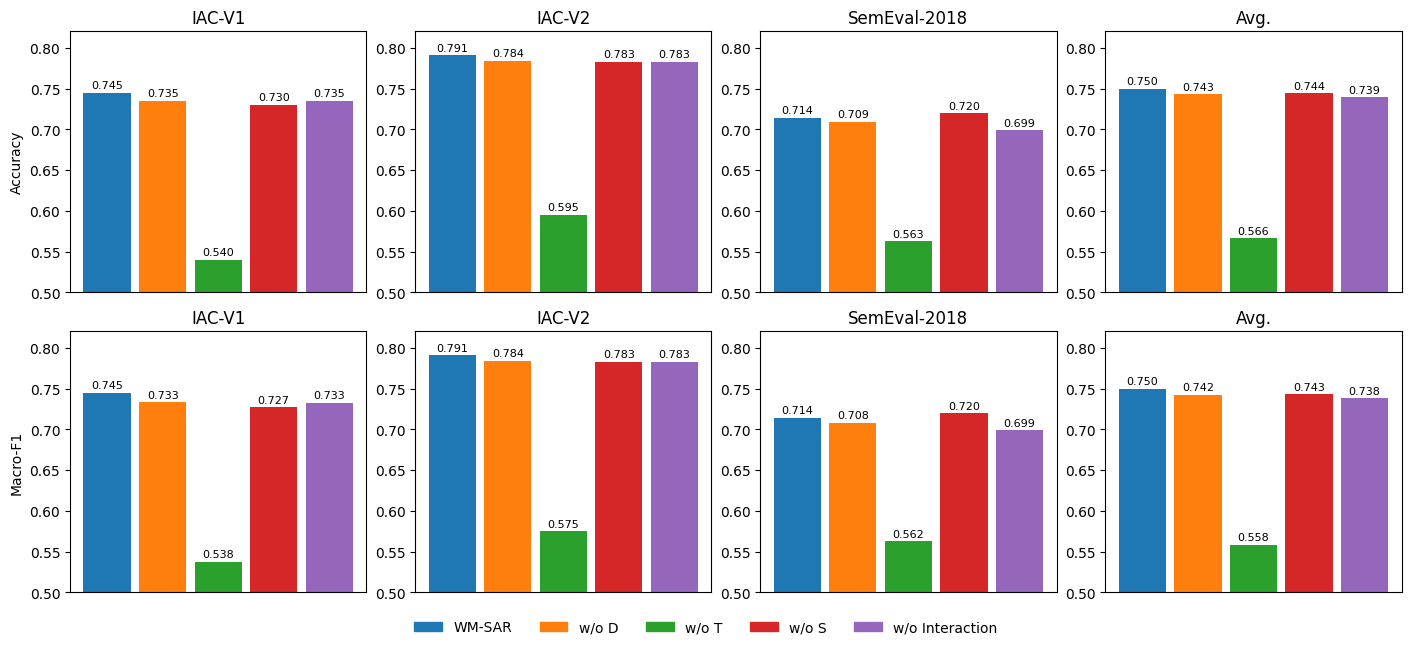

- 实验表明,WM-SAR在反讽检测基准上优于现有方法,消融实验验证了语义不一致性和意图推理的重要性。

📝 摘要(中文)

反讽理解是自然语言处理中一个具有挑战性的问题,因为它需要捕捉话语的表面含义与说话者意图之间的差异,以及周围的社会背景。尽管深度学习和大语言模型(LLMs)的最新进展已显著提高了性能,但大多数现有方法仍然依赖于单个模型的黑盒预测,难以从结构上解释反讽背后的认知因素。此外,虽然反讽通常表现为语义评估与规范期望或意图之间的不匹配,但显式分解和建模这些组成部分的框架仍然有限。本文将反讽理解重新定义为受世界模型启发的推理过程,并提出了世界模型启发的反讽推理(WM-SAR),它将字面意义、语境、规范期望和意图分解为基于LLM的专用智能体。字面评估和规范期望之间的差异被明确量化为确定性的不一致性得分,并与意图得分一起,通过轻量级的Logistic回归模型整合这些信号,以推断最终的反讽概率。这种设计利用了LLM的推理能力,同时保持了可解释的数值决策结构。在代表性的反讽检测基准上的实验表明,WM-SAR始终优于现有的深度学习和基于LLM的方法。消融研究和案例分析进一步表明,整合语义不一致性和意图推理对于有效的反讽检测至关重要,从而实现了强大的性能和高度的可解释性。

🔬 方法详解

问题定义:论文旨在解决反讽理解问题,现有方法主要依赖于黑盒模型,缺乏可解释性,难以捕捉反讽中语义与语境、意图之间的复杂关系。这些方法无法有效分解和建模反讽产生的认知因素,导致性能瓶颈。

核心思路:论文的核心思路是将反讽理解分解为多个可解释的组成部分,并利用大语言模型(LLM)作为智能体来分别处理这些组成部分。通过显式地建模字面意义、语境、规范期望和意图,并量化语义不一致性,从而实现更准确和可解释的反讽检测。这种分解的思想借鉴了世界模型的概念,即通过构建一个对世界的理解模型来进行推理。

技术框架:WM-SAR框架包含以下主要模块:1) 字面意义智能体:负责提取话语的字面含义。2) 语境智能体:负责理解话语的上下文信息。3) 规范期望智能体:负责判断话语是否符合规范期望。4) 意图智能体:负责推断说话者的意图。5) 不一致性评分模块:计算字面意义和规范期望之间的不一致性得分。6) Logistic回归模型:将不一致性得分和意图得分作为输入,预测反讽概率。整体流程是,首先利用LLM智能体提取各个组成部分的信息,然后计算不一致性得分,最后通过Logistic回归模型进行反讽判断。

关键创新:最重要的技术创新点在于将反讽理解分解为多个可解释的智能体,并显式地建模语义不一致性和意图。与现有方法的本质区别在于,WM-SAR不是一个黑盒模型,而是通过结构化的方式来模拟人类的反讽推理过程,从而提高了可解释性和性能。

关键设计:论文使用LLM(具体模型未知)作为各个智能体的基础模型,并针对每个智能体设计了特定的prompt。不一致性得分的计算方式未知,但应该是基于字面意义和规范期望之间的差异。Logistic回归模型是一个轻量级的分类器,用于整合不一致性得分和意图得分。具体的损失函数和训练细节未知。

🖼️ 关键图片

📊 实验亮点

WM-SAR在多个反讽检测基准上 consistently 优于现有深度学习和基于LLM的方法。消融实验表明,语义不一致性和意图推理对于反讽检测至关重要。案例分析进一步验证了WM-SAR的可解释性,能够清晰地展示反讽推理的过程。具体的性能提升数据未知。

🎯 应用场景

该研究成果可应用于情感分析、社交媒体监控、对话系统等领域。更准确的反讽检测可以提高情感分析的准确性,帮助识别网络欺凌和恶意言论,并改善人机对话的自然性和流畅性。未来,该方法可以扩展到其他需要理解言语背后含义的任务中。

📄 摘要(原文)

Sarcasm understanding is a challenging problem in natural language processing, as it requires capturing the discrepancy between the surface meaning of an utterance and the speaker's intentions as well as the surrounding social context. Although recent advances in deep learning and Large Language Models (LLMs) have substantially improved performance, most existing approaches still rely on black-box predictions of a single model, making it difficult to structurally explain the cognitive factors underlying sarcasm. Moreover, while sarcasm often emerges as a mismatch between semantic evaluation and normative expectations or intentions, frameworks that explicitly decompose and model these components remain limited. In this work, we reformulate sarcasm understanding as a world model inspired reasoning process and propose World Model inspired SArcasm Reasoning (WM-SAR), which decomposes literal meaning, context, normative expectation, and intention into specialized LLM-based agents. The discrepancy between literal evaluation and normative expectation is explicitly quantified as a deterministic inconsistency score, and together with an intention score, these signals are integrated by a lightweight Logistic Regression model to infer the final sarcasm probability. This design leverages the reasoning capability of LLMs while maintaining an interpretable numerical decision structure. Experiments on representative sarcasm detection benchmarks show that WM-SAR consistently outperforms existing deep learning and LLM-based methods. Ablation studies and case analyses further demonstrate that integrating semantic inconsistency and intention reasoning is essential for effective sarcasm detection, achieving both strong performance and high interpretability.