Activation Steering for Masked Diffusion Language Models

作者: Adi Shnaidman, Erin Feiglin, Osher Yaari, Efrat Mentel, Amit Levi, Raz Lapid

分类: cs.CL

发布日期: 2025-12-30

💡 一句话要点

提出激活调控框架,用于控制掩码扩散语言模型生成文本的属性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 掩码扩散语言模型 文本生成控制 激活调控 推理时控制 属性调节

📋 核心要点

- 现有掩码扩散语言模型缺乏有效的推理时控制机制,难以灵活引导文本生成。

- 该论文提出激活调控框架,通过对比样本计算调控向量,在反向扩散过程中控制文本生成。

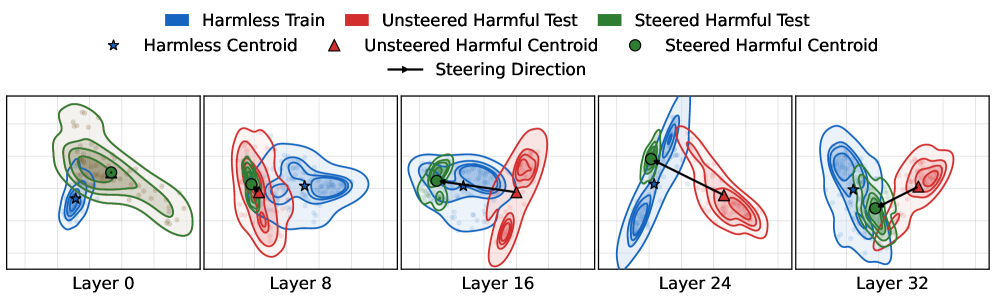

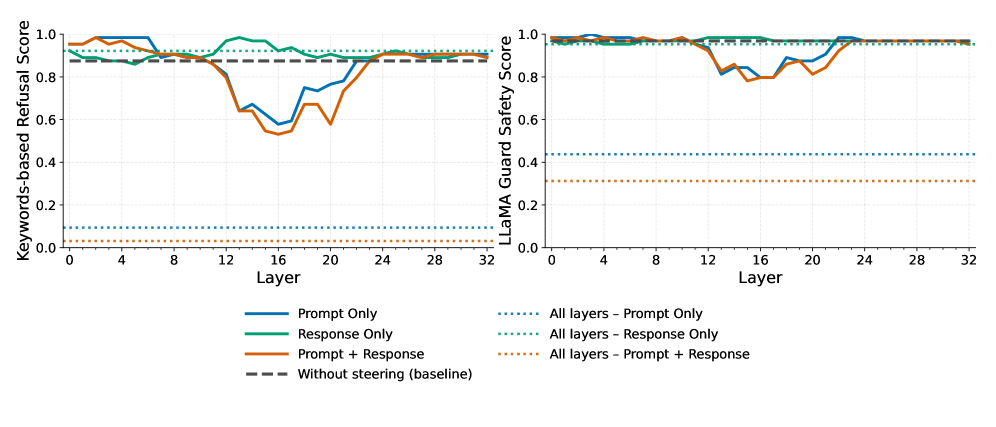

- 实验表明,该方法能有效调节文本的高层属性,并分析了调控在不同模块和范围内的影响。

📝 摘要(中文)

掩码扩散语言模型(MDLMs)通过迭代去噪过程生成文本。由于其掩码并行解码能力以及与自回归大型语言模型相媲美的性能,MDLMs 近来备受关注。然而,MDLMs 中用于推理时控制和引导的有效机制在很大程度上仍未被探索。我们提出了一种用于 MDLMs 的激活调控框架,该框架通过使用对比示例的单次前向传播计算逐层调控向量,而无需模拟去噪轨迹。这些方向应用于每个反向扩散步骤,从而产生一种高效的推理时控制机制。在 LLaDA-8B-Instruct 上的实验表明,该方法能够可靠地调节高层属性,并通过消融实验检验了跨 Transformer 子模块和 token 范围(prompt vs. response)进行调控的效果。

🔬 方法详解

问题定义:论文旨在解决掩码扩散语言模型(MDLMs)缺乏有效推理时控制机制的问题。现有的MDLMs在生成文本时,难以根据用户的意愿控制文本的特定属性(例如情感、风格等),缺乏灵活性和可控性。

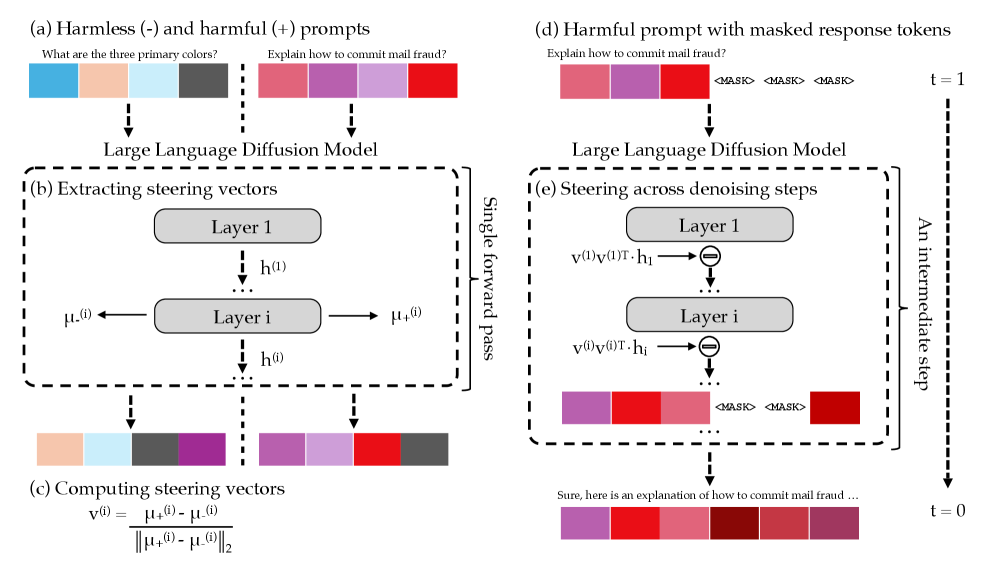

核心思路:论文的核心思路是通过激活调控(Activation Steering)来引导MDLMs的文本生成过程。具体来说,通过对比具有不同属性的文本样本,计算出能够区分这些属性的激活向量,然后在反向扩散的每一步,利用这些激活向量来调整模型的输出,从而控制生成文本的属性。这种方法避免了模拟整个去噪过程,提高了效率。

技术框架:该框架主要包含以下几个步骤:1) 对比样本构建:收集或生成具有不同目标属性的文本样本。2) 激活向量计算:通过单次前向传播,提取对比样本在模型各层的激活值,并计算出能够区分这些属性的调控向量。3) 反向扩散调控:在反向扩散的每一步,将计算得到的调控向量应用到模型的激活值上,从而引导文本生成。

关键创新:该方法最重要的创新在于提出了一种高效的激活调控机制,能够在推理时控制MDLMs生成文本的属性,而无需重新训练模型或模拟整个去噪过程。与现有方法相比,该方法更加灵活、高效,并且易于集成到现有的MDLM框架中。

关键设计:论文的关键设计包括:1) 逐层调控:对Transformer模型的每一层都计算调控向量,从而实现更精细的控制。2) token范围控制:可以分别对prompt和response进行调控,以实现更灵活的控制。3) 调控强度参数:通过调整调控向量的强度,可以控制属性调节的程度。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法能够有效地调节LLaDA-8B-Instruct模型生成文本的高层属性。通过消融实验,论文还分析了调控在不同Transformer子模块和token范围内的影响,为进一步优化调控策略提供了依据。实验结果验证了该方法的有效性和灵活性。

🎯 应用场景

该研究成果可应用于多种场景,例如:文本风格迁移、情感控制、内容生成等。通过该方法,用户可以更加方便地控制MDLMs生成具有特定属性的文本,从而满足不同的需求。例如,可以生成更具创意性的文本,或者生成更符合特定风格的文本。该技术在内容创作、智能客服、广告文案生成等领域具有广阔的应用前景。

📄 摘要(原文)

Masked diffusion language models (MDLMs) generate text through an iterative denoising process. They have recently gained attention due to mask-parallel decoding and competitive performance with autoregressive large language models. However, effective mechanisms for inference-time control and steering in MDLMs remain largely unexplored. We present an activation-steering framework for MDLMs that computes layer-wise steering vectors from a single forward pass using contrastive examples, without simulating the denoising trajectory. These directions are applied at every reverse-diffusion step, yielding an efficient inference-time control mechanism. Experiments on LLaDA-8B-Instruct demonstrate reliable modulation of high-level attributes, with ablations examining the effects of steering across transformer sub-modules and token scope (prompt vs.\ response).