Training a Huggingface Model on AWS Sagemaker (Without Tears)

作者: Liling Tan

分类: cs.CL, cs.LG

发布日期: 2025-12-30 (更新: 2026-01-02)

💡 一句话要点

提供Hugging Face模型在AWS SageMaker上训练的完整指南,降低云平台使用门槛。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Hugging Face AWS SageMaker 云平台 模型训练 大型语言模型

📋 核心要点

- 大型语言模型训练需要大量计算资源,但研究人员常因缺乏本地资源而受限。

- 论文旨在提供一个完整的指南,帮助研究人员在AWS SageMaker上训练Hugging Face模型。

- 通过集中必要信息,降低云平台的使用门槛,使研究人员能够更轻松地进行模型训练。

📝 摘要(中文)

大型语言模型(LLM)的开发主要由资源丰富的研究团队和行业伙伴推动。由于日益复杂的模型需要大量的本地计算资源,许多研究人员正在转向AWS SageMaker等云服务来训练Hugging Face模型。然而,云平台陡峭的学习曲线常常成为习惯于本地环境的研究人员的障碍。现有的文档经常存在知识缺口,迫使用户在网络上寻找零散的信息。本演示论文旨在通过集中研究人员从头开始在AWS SageMaker上成功训练其第一个Hugging Face模型所需的基本信息,从而普及云平台的采用。

🔬 方法详解

问题定义:论文旨在解决研究人员在AWS SageMaker上训练Hugging Face模型时面临的学习曲线陡峭和信息分散的问题。现有文档缺乏系统性和完整性,导致研究人员难以快速上手并成功完成模型训练。

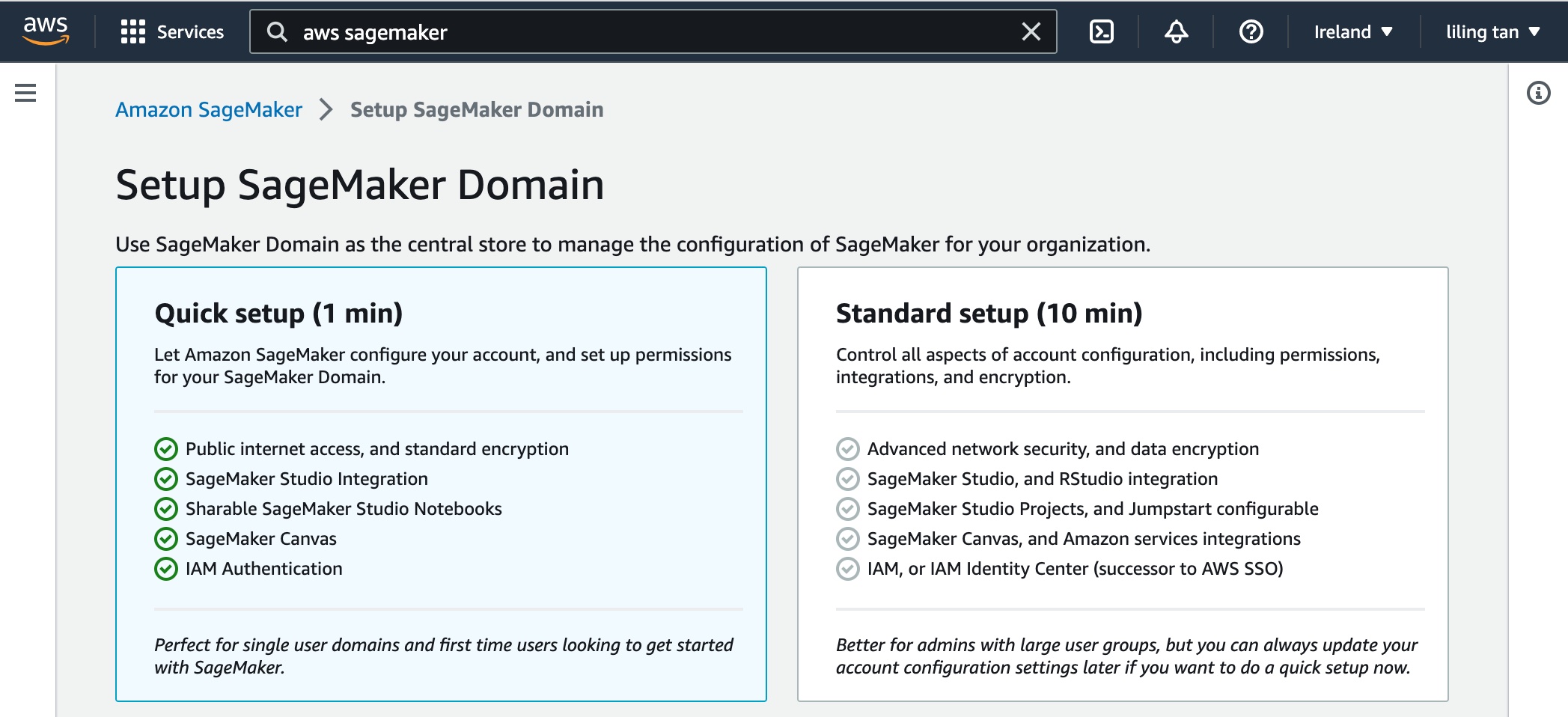

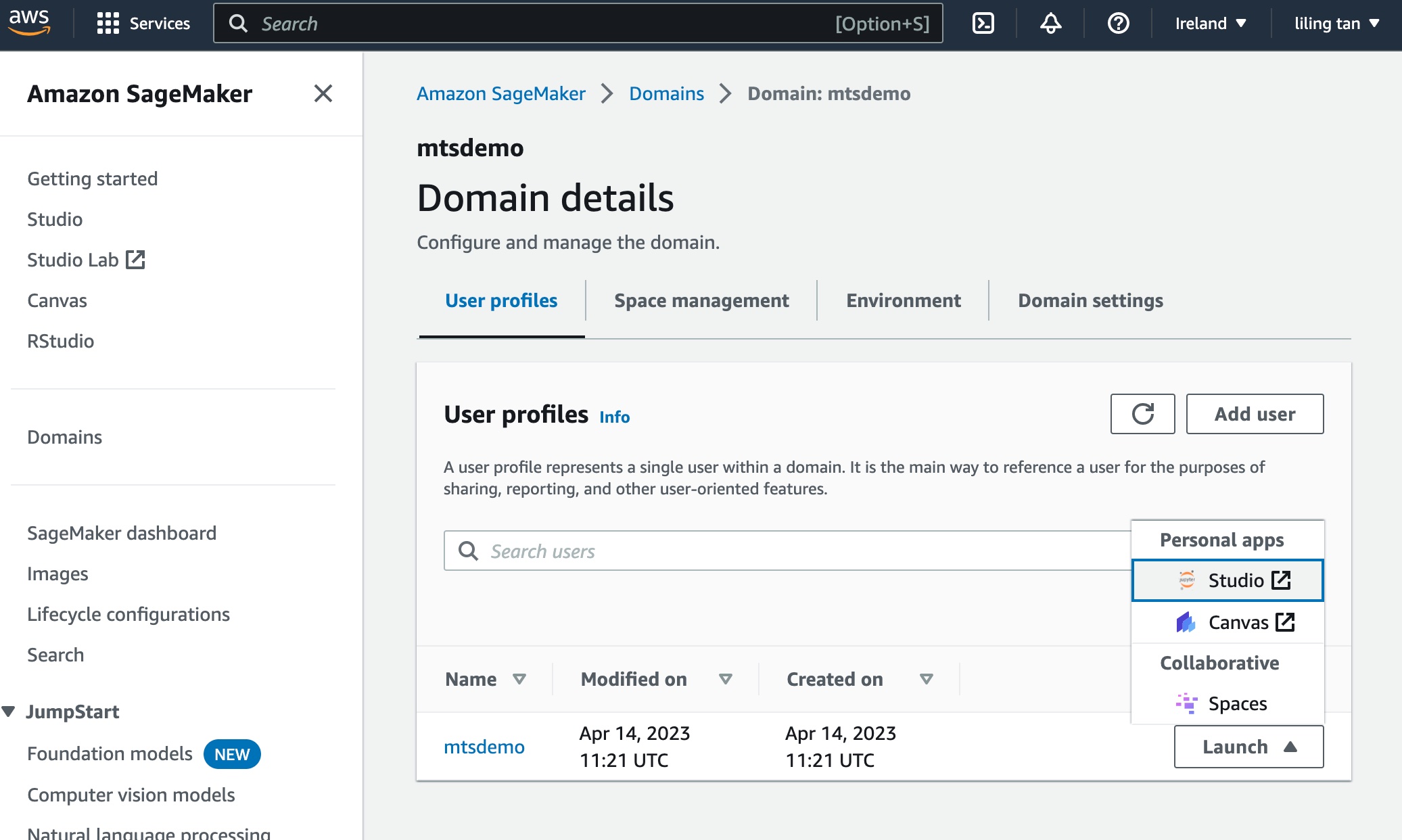

核心思路:论文的核心思路是提供一个集中、完整、易于理解的指南,涵盖从零开始在AWS SageMaker上训练Hugging Face模型的所有必要步骤和信息。通过提供清晰的示例和最佳实践,降低云平台的使用门槛。

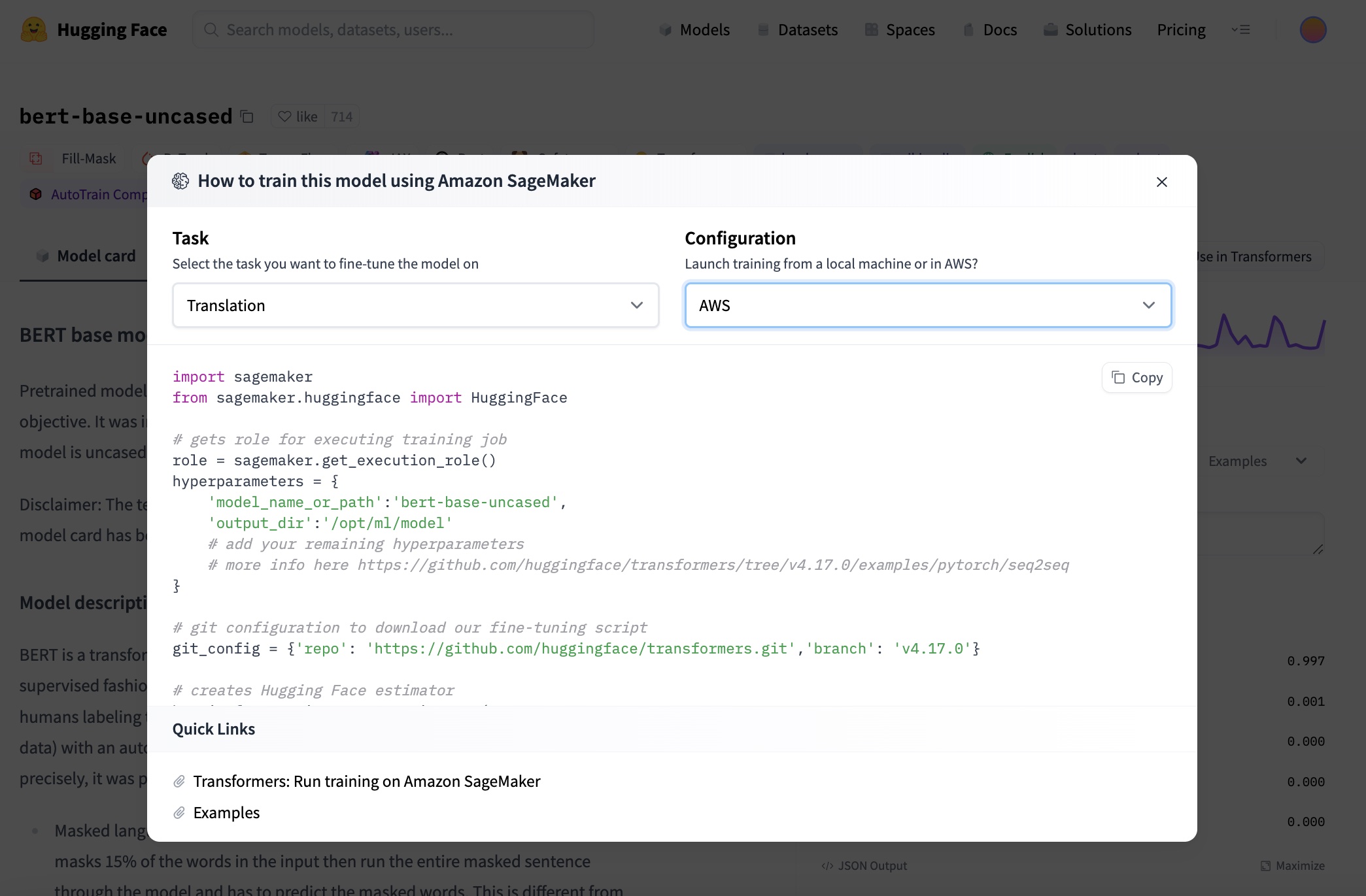

技术框架:论文本身并非提出新的技术框架,而是提供一个操作指南。其核心在于整理和组织了在AWS SageMaker上训练Hugging Face模型所需的各种资源和步骤,包括环境配置、数据准备、模型训练、评估和部署等。具体的技术栈包括AWS SageMaker、Hugging Face Transformers库等。

关键创新:论文的创新点在于其系统性和完整性,它将分散在各处的知识整合到一个易于理解的文档中,降低了研究人员使用云平台进行模型训练的门槛。虽然没有提出新的算法或模型,但通过提供实用的指导,加速了研究人员对云平台的采用。

关键设计:论文的关键设计在于其结构化的内容组织和清晰的示例代码。具体的技术细节取决于用户选择的Hugging Face模型和训练任务,例如,可以选择不同的预训练模型、调整训练参数、使用不同的优化器和损失函数等。论文旨在提供一个通用的框架,用户可以根据自己的需求进行定制。

🖼️ 关键图片

📊 实验亮点

该论文的主要亮点在于提供了一个完整的、易于理解的Hugging Face模型在AWS SageMaker上训练的指南,旨在帮助研究人员克服云平台使用的障碍,加速模型训练过程。虽然没有提供具体的性能数据,但其价值在于降低了云平台的使用门槛。

🎯 应用场景

该研究成果可广泛应用于自然语言处理、计算机视觉等领域,帮助研究人员和开发者更便捷地利用云平台进行大规模模型训练。通过降低云平台使用门槛,加速人工智能技术的创新和应用。

📄 摘要(原文)

The development of Large Language Models (LLMs) has primarily been driven by resource-rich research groups and industry partners. Due to the lack of on-premise computing resources required for increasingly complex models, many researchers are turning to cloud services like AWS SageMaker to train Hugging Face models. However, the steep learning curve of cloud platforms often presents a barrier for researchers accustomed to local environments. Existing documentation frequently leaves knowledge gaps, forcing users to seek fragmented information across the web. This demo paper aims to democratize cloud adoption by centralizing the essential information required for researchers to successfully train their first Hugging Face model on AWS SageMaker from scratch.