Forgetting as a Feature: Cognitive Alignment of Large Language Models

作者: Hien Tran, Quinten Steenhuis, Alexandros Christoforos, Chadbourne Davis

分类: cs.CL, cs.AI

发布日期: 2025-12-28

备注: Under submission

💡 一句话要点

提出概率记忆提示,通过模拟人类遗忘机制提升LLM长程推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 遗忘机制 长程推理 认知建模 概率记忆 提示学习 自适应智能

📋 核心要点

- 现有LLM在长程推理中存在系统性遗忘问题,影响性能,通常被视为缺陷。

- 论文将遗忘重新定义为认知机制,模拟人类记忆衰减过程,提升模型适应性。

- 提出概率记忆提示方法,通过控制证据整合,使LLM遗忘模式更接近人类,提升推理能力。

📝 摘要(中文)

大型语言模型(LLM)通常以完美的贝叶斯推理为理想标准进行评估,但越来越多的证据表明,它们的上下文推理表现出对过去信息的系统性遗忘。本文将这种行为重新解释为一种功能性的认知机制,而非将其视为一种局限。借鉴人类记忆动态,我们将LLM推理建模为由指数衰减控制的概率记忆过程。我们引入了一个基准测试套件,用于评估时间推理、概念漂移适应和联想回忆,从而可以直接比较模型行为和人类认知模式。实验结果表明,LLM表现出与人类记忆效率相似的遗忘率,在稳定性和适应性之间进行权衡。基于这些观察,我们提出了一种概率记忆提示策略,该策略通过塑造证据整合来模仿类人记忆衰减,从而提高长程推理性能。我们的发现表明,遗忘不是一种失败模式,而是一种自适应智能的原则性机制。

🔬 方法详解

问题定义:大型语言模型在处理长序列或需要整合长期信息的任务时,会表现出对先前信息的遗忘现象。这种遗忘被认为是模型性能的瓶颈,尤其是在需要持续更新知识或适应环境变化的任务中。现有的方法往往侧重于增强模型的记忆能力,而忽略了遗忘可能带来的积极作用。

核心思路:论文的核心思路是将LLM的推理过程建模为一种概率记忆过程,该过程受到指数衰减的影响,类似于人类的记忆遗忘曲线。通过模拟人类的遗忘模式,使模型能够更好地适应新的信息,并减少旧信息对当前推理的干扰。这种方法旨在平衡模型的稳定性和适应性,从而提高其在长程推理任务中的表现。

技术框架:论文提出的技术框架主要包括三个部分:首先,建立一个基准测试套件,用于评估LLM在时间推理、概念漂移适应和联想回忆等任务中的表现。其次,将LLM的推理过程建模为概率记忆过程,并引入指数衰减函数来模拟遗忘。最后,提出概率记忆提示策略,通过调整输入提示,控制模型对不同时间点信息的关注程度,从而模拟人类的遗忘模式。

关键创新:论文的关键创新在于将遗忘视为一种功能性的认知机制,并将其应用于LLM的推理过程中。与以往侧重于增强记忆的方法不同,该论文强调了遗忘在自适应智能中的作用。通过模拟人类的遗忘模式,使模型能够更好地适应新的信息,并减少旧信息对当前推理的干扰。

关键设计:概率记忆提示策略是关键设计之一。具体来说,该策略通过调整输入提示中不同信息的权重,来控制模型对不同时间点信息的关注程度。例如,对于时间较早的信息,可以降低其权重,使其对当前推理的影响减小。此外,指数衰减函数的参数设置也至关重要,需要根据具体的任务和数据集进行调整,以达到最佳的遗忘效果。

🖼️ 关键图片

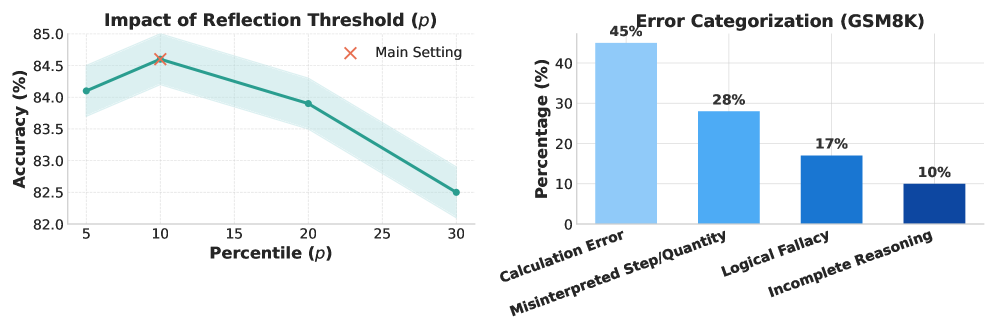

📊 实验亮点

实验结果表明,LLM表现出与人类记忆效率相似的遗忘率,并在稳定性和适应性之间进行权衡。通过应用概率记忆提示策略,模型在长程推理任务中的性能得到了显著提升。具体的性能数据和对比基线在论文中进行了详细的展示,证明了该方法的有效性。

🎯 应用场景

该研究成果可应用于需要持续学习和适应环境变化的各种场景,例如对话系统、智能助手、机器人导航等。通过模拟人类的遗忘机制,可以使这些系统更好地处理长期信息,提高其在复杂环境中的适应性和鲁棒性。此外,该研究也为理解人类认知和构建更智能的AI系统提供了新的思路。

📄 摘要(原文)

Large Language Models (LLMs) are often evaluated against ideals of perfect Bayesian inference, yet growing evidence suggests that their in-context reasoning exhibits systematic forgetting of past information. Rather than viewing this behavior as a limitation, we reinterpret forgetting as a functional cognitive mechanism. Drawing inspiration from human memory dynamics, we model LLM inference as a probabilistic memory process governed by exponential decay. We introduce a benchmark suite that evaluates temporal reasoning, concept drift adaptation, and associative recall, enabling direct comparison between model behavior and human cognitive patterns. Our empirical results reveal that LLMs demonstrate forgetting rates analogous to human memory efficiency trade-offs between stability and adaptability. Building on these observations, we propose probabilistic memory prompting, a lightweight strategy that shapes evidence integration to mimic human-like memory decay, leading to improved long-horizon reasoning performance. Our findings position forgetting not as a failure mode, but as a principled mechanism for adaptive intelligence.