Learning When Not to Attend Globally

作者: Xuan Luo, Kailai Zhang, Xifeng Yan

分类: cs.CL, cs.AI

发布日期: 2025-12-27

💡 一句话要点

提出All-or-Here Attention,使LLM动态决定何时关注全局上下文以提升效率。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 注意力机制 长序列建模 动态注意力 高效推理

📋 核心要点

- 现有大语言模型(LLM)在处理长序列时,全局注意力计算成本高昂,效率低下。

- 论文提出All-or-Here Attention (AHA),通过动态选择全局或局部注意力,减少冗余计算。

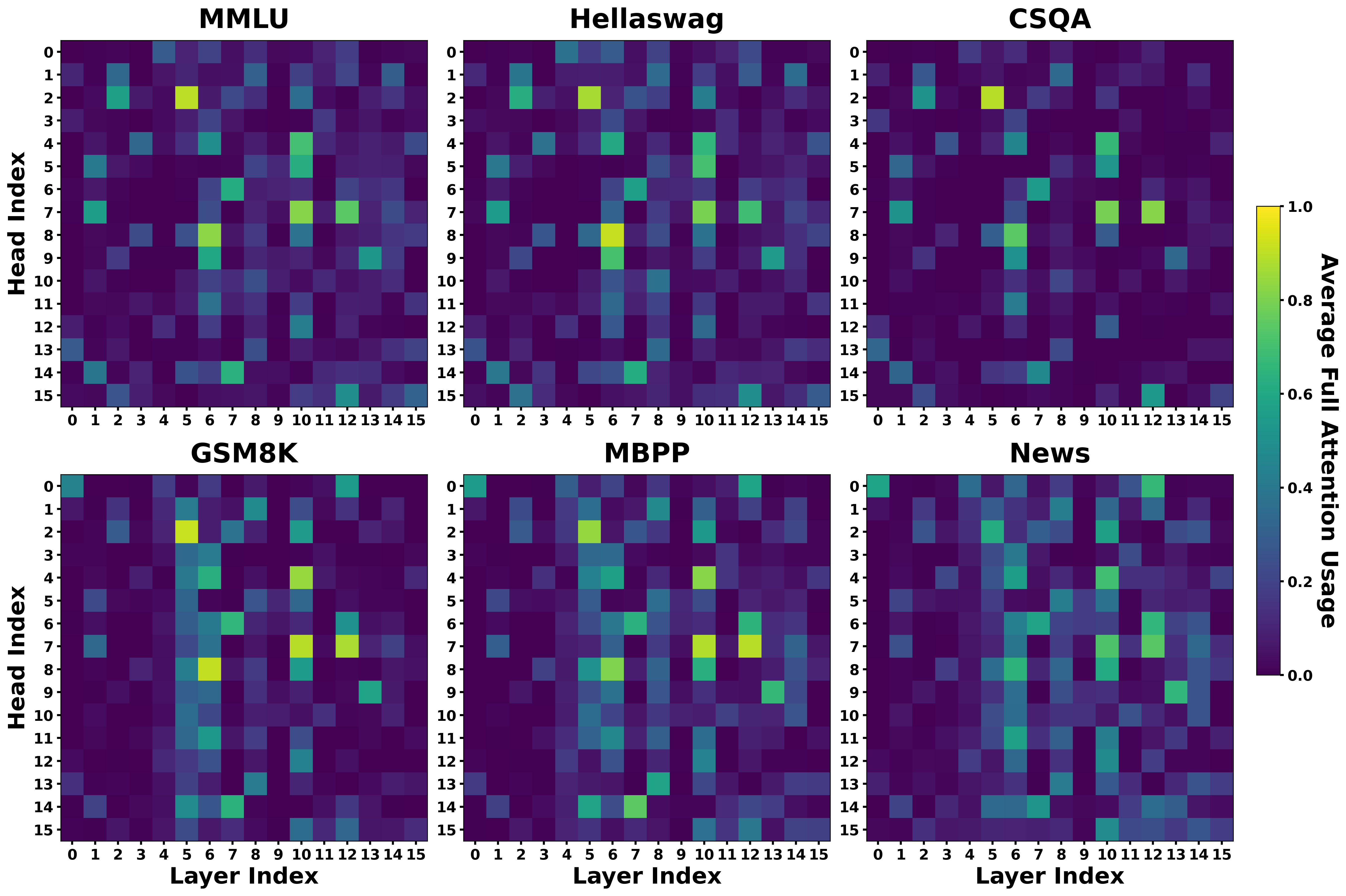

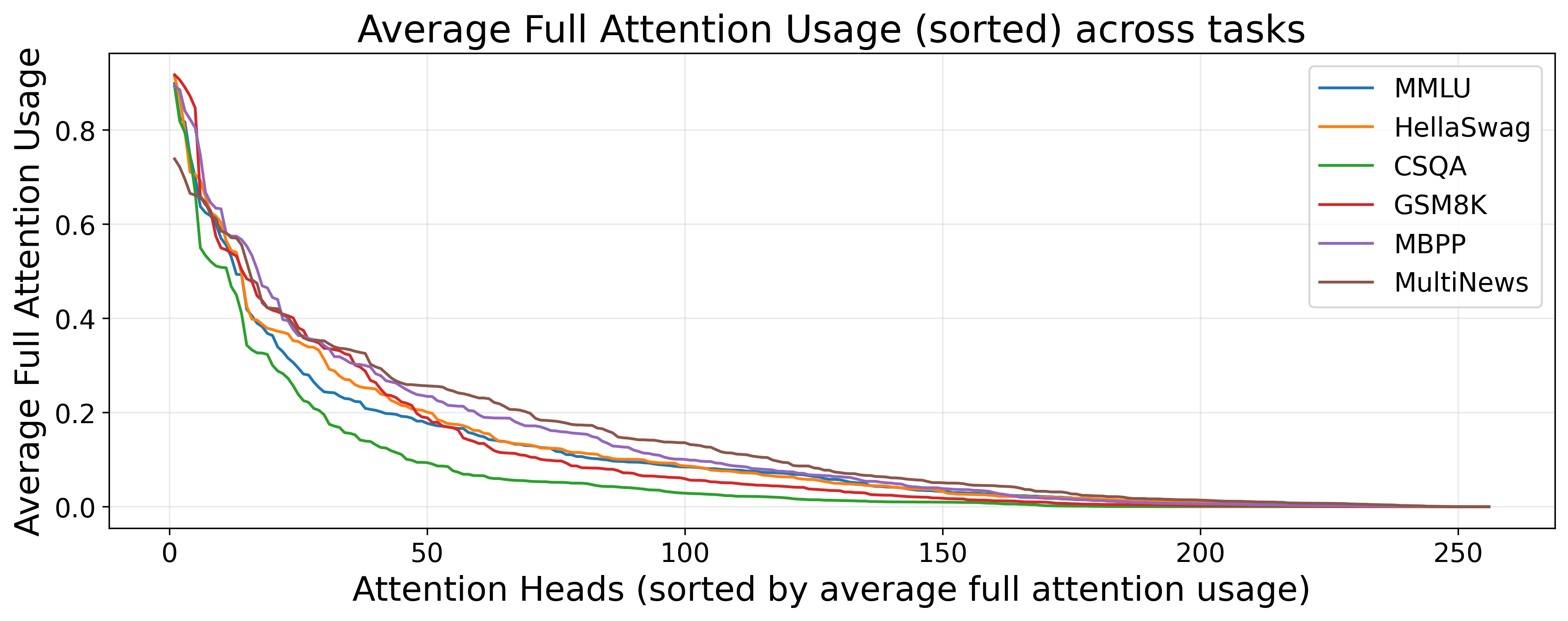

- 实验表明,AHA在性能无损的情况下,可将高达93%的全注意力操作替换为滑动窗口注意力。

📝 摘要(中文)

本文提出了一种名为All-or-Here Attention (AHA) 的方法,该方法利用每个注意力头的二元路由器,为每个token动态地切换全局全注意力机制和局部滑动窗口注意力机制。实验结果表明,在窗口大小为256个token的情况下,高达93%的原始全注意力操作可以被滑动窗口注意力替代,而不会造成性能损失。此外,通过评估不同窗口大小下的AHA,我们发现上下文依赖性存在长尾分布,即随着局部窗口的扩大,对全注意力的需求迅速衰减。通过将局部处理与全局访问解耦,AHA揭示了全注意力在很大程度上是冗余的,高效的推理只需要按需访问全局上下文。

🔬 方法详解

问题定义:现有的大语言模型在处理长序列时,通常采用全局注意力机制,这导致计算复杂度随着序列长度的增加而呈平方级增长。这种全局注意力机制在很多情况下是冗余的,因为并非所有token都需要关注全局上下文。因此,如何降低全局注意力的计算成本,提高长序列处理的效率,是一个重要的研究问题。

核心思路:论文的核心思路是让模型能够动态地决定何时需要关注全局上下文,何时只需要关注局部上下文。通过引入一个二元路由器,每个注意力头可以根据当前token的上下文信息,选择使用全局全注意力或局部滑动窗口注意力。这样,模型可以根据实际需要,灵活地调整注意力范围,从而减少不必要的计算。

技术框架:AHA的核心在于为每个注意力头引入一个二元路由器。该路由器根据当前token的输入,输出一个二元决策,决定是使用全局全注意力还是局部滑动窗口注意力。如果路由器选择全局全注意力,则该注意力头将关注整个序列;如果路由器选择局部滑动窗口注意力,则该注意力头只关注当前token周围的一个固定大小的窗口。整个框架可以嵌入到现有的Transformer架构中,替换原有的全局注意力层。

关键创新:AHA最重要的技术创新点在于动态选择注意力范围的能力。与传统的全局注意力或局部注意力相比,AHA可以根据token的上下文信息,自适应地调整注意力范围,从而在性能和效率之间取得更好的平衡。这种动态选择机制使得模型能够更加高效地利用上下文信息,减少冗余计算。

关键设计:二元路由器的具体实现可以采用多种方式,例如使用一个小型神经网络,输入当前token的嵌入向量,输出一个二元概率分布。损失函数可以设计为鼓励路由器选择更高效的局部滑动窗口注意力,同时保证模型的性能。滑动窗口的大小是一个重要的超参数,需要根据具体的任务和数据集进行调整。论文中窗口大小设置为256。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在窗口大小为256个token的情况下,AHA可以将高达93%的原始全注意力操作替换为滑动窗口注意力,而不会造成性能损失。这表明AHA能够显著降低全局注意力的计算成本,提高推理效率。此外,通过评估不同窗口大小下的AHA,论文还发现上下文依赖性存在长尾分布,即随着局部窗口的扩大,对全注意力的需求迅速衰减。

🎯 应用场景

AHA具有广泛的应用前景,可以应用于各种需要处理长序列的任务,例如机器翻译、文本摘要、问答系统等。通过降低全局注意力的计算成本,AHA可以使得大语言模型能够更加高效地处理长文本,提高推理速度,降低计算资源消耗。此外,AHA还可以应用于移动设备等资源受限的场景,使得大语言模型能够在这些设备上运行。

📄 摘要(原文)

When reading books, humans focus primarily on the current page, flipping back to recap prior context only when necessary. Similarly, we demonstrate that Large Language Models (LLMs) can learn to dynamically determine when to attend to global context. We propose All-or-Here Attention (AHA), which utilizes a binary router per attention head to dynamically toggle between full attention and local sliding window attention for each token. Our results indicate that with a window size of 256 tokens, up to 93\% of the original full attention operations can be replaced by sliding window attention without performance loss. Furthermore, by evaluating AHA across various window sizes, we identify a long-tail distribution in context dependency, where the necessity for full attention decays rapidly as the local window expands. By decoupling local processing from global access, AHA reveals that full attention is largely redundant, and that efficient inference requires only on-demand access to the global context.