Coherence in the brain unfolds across separable temporal regimes

作者: Davide Staub, Finn Rabe, Akhil Misra, Yves Pauli, Roya Hüppi, Ni Yang, Nils Lang, Lars Michels, Victoria Edkins, Sascha Frühholz, Iris Sommer, Wolfram Hinzen, Philipp Homan

分类: q-bio.NC, cs.CL

发布日期: 2025-12-23 (更新: 2025-12-25)

💡 一句话要点

利用LLM提取的漂移和位移信号,揭示大脑在自然听觉中连贯性处理的时域分离机制

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语言理解 大脑连贯性 大型语言模型 fMRI 默认模式网络

📋 核心要点

- 现有研究缺乏对大脑如何在自然听觉中同时处理语境积累和事件边界重构的清晰理解。

- 利用大型语言模型提取的漂移和位移信号,分别对应语境的逐渐变化和事件的突变。

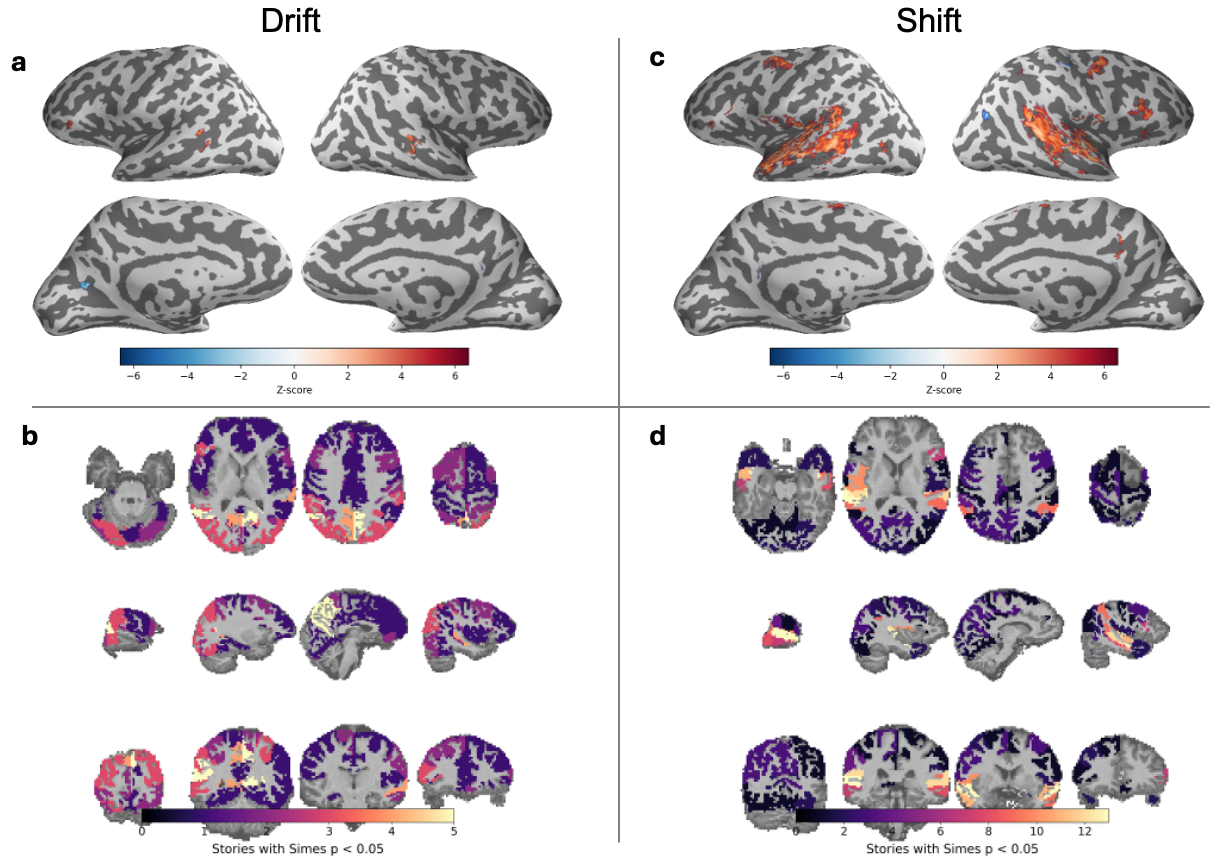

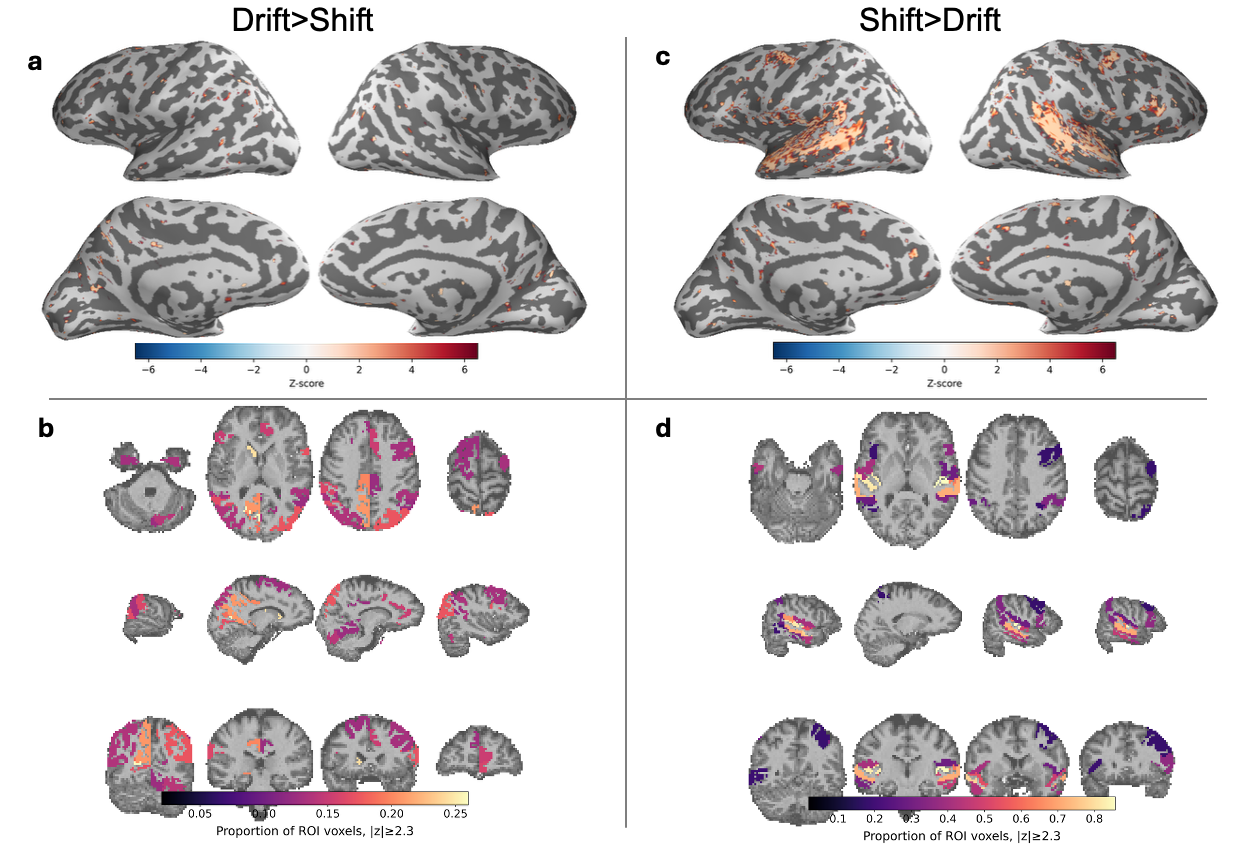

- 实验结果表明,漂移信号与默认模式网络相关,而位移信号与听觉和语言皮层相关,揭示了大脑处理连贯性的时域分离机制。

📝 摘要(中文)

语言的连贯性要求大脑满足两个相互竞争的时间需求:跨越扩展语境逐步积累意义,以及在事件边界快速重构表征。尽管这些过程对于语言和思维至关重要,但它们在人类大脑自然听觉过程中是如何实现的仍不清楚。本文测试了这两个过程是否可以被无标注的漂移和位移信号捕获,以及它们的大脑神经表达是否在大尺度皮层系统中分离。这些信号来自大型语言模型(LLM),并直接从叙事输入中形式化了语境漂移和事件位移。为了实现具有稳定参数估计的高精度体素编码模型,我们密集采样了一名健康成年人,在超过7小时的时间里听取了13个犯罪故事,同时收集了超高场(7T)BOLD数据。然后,我们使用在独立故事上验证的正则化编码框架,对特征信息驱动的血流动力学反应进行建模。漂移预测主要出现在默认模式网络枢纽中,而位移预测在初级听觉皮层和语言联合皮层双侧均很明显。此外,默认模式网络和顶叶网络中的活动最好由一个信号来解释,该信号捕捉了意义如何在叙事过程中积累和逐渐消退。总之,这些发现表明,语言理解过程中的连贯性是通过缓慢的语境整合和快速的事件驱动重构的可分离神经机制来实现的,为理解精神疾病中语言连贯性障碍提供了一个机械性的切入点。

🔬 方法详解

问题定义:论文旨在研究在自然听觉过程中,大脑如何实现语言连贯性,特别是如何同时处理语境的逐渐积累和事件边界的快速重构。现有方法难以区分这两个过程,并且缺乏对它们在大脑中神经表达的精细刻画。

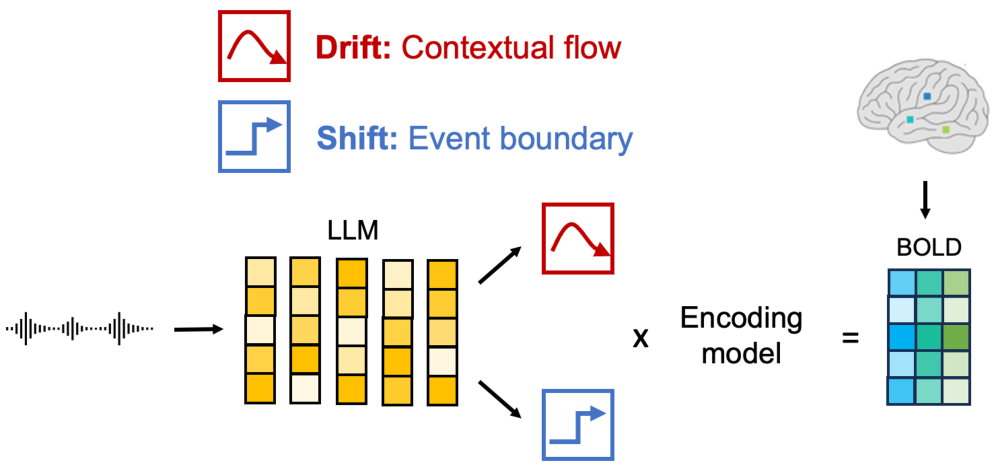

核心思路:论文的核心思路是利用大型语言模型(LLM)提取的漂移和位移信号,将语境的逐渐变化(漂移)和事件的突变(位移)形式化。通过将这些信号与大脑活动进行关联,揭示大脑中负责处理这两种不同时间尺度信息的神经机制。这样设计的目的是为了克服传统方法中缺乏对语境和事件边界进行明确建模的局限性。

技术框架:整体框架包括以下几个主要阶段:1) 使用LLM从叙事文本中提取漂移和位移信号;2) 使用超高场(7T)fMRI技术采集受试者在听取故事时的脑活动数据;3) 使用正则化编码模型,将LLM提取的信号与脑活动数据进行关联,从而确定大脑中对漂移和位移信号敏感的区域;4) 对结果进行统计分析,验证漂移和位移信号在大脑中的分布模式。

关键创新:最重要的技术创新点在于使用LLM来提取与大脑处理语言连贯性相关的特征,并将其与脑活动数据进行关联。与传统方法相比,这种方法能够更准确地捕捉语境的动态变化和事件边界的突变,从而更深入地理解大脑处理语言连贯性的机制。

关键设计:关键设计包括:1) 使用大型语言模型(LLM)来提取漂移和位移信号,具体LLM模型未知;2) 使用正则化编码模型来关联LLM信号和fMRI数据,正则化方法未知;3) 使用超高场(7T)fMRI技术来提高脑活动数据的空间分辨率,具体参数设置未知;4) 实验设计中,受试者需要听取多个犯罪故事,以增加数据的可靠性。

🖼️ 关键图片

📊 实验亮点

研究发现,漂移预测主要出现在默认模式网络枢纽中,而位移预测在初级听觉皮层和语言联合皮层双侧均很明显。此外,默认模式网络和顶叶网络中的活动最好由一个信号来解释,该信号捕捉了意义如何在叙事过程中积累和逐渐消退。这些结果表明,大脑通过不同的神经机制来处理语境的逐渐变化和事件的突变。

🎯 应用场景

该研究成果可应用于精神疾病的诊断和治疗,例如精神分裂症患者常常表现出语言连贯性障碍。通过理解大脑处理语言连贯性的神经机制,可以为开发针对这些疾病的神经调控或认知训练方法提供理论基础。此外,该研究方法也可用于开发更自然、更智能的语音助手和人机交互系统。

📄 摘要(原文)

Coherence in language requires the brain to satisfy two competing temporal demands: gradual accumulation of meaning across extended context and rapid reconfiguration of representations at event boundaries. Despite their centrality to language and thought, how these processes are implemented in the human brain during naturalistic listening remains unclear. Here, we tested whether these two processes can be captured by annotation-free drift and shift signals and whether their neural expression dissociates across large-scale cortical systems. These signals were derived from a large language model (LLM) and formalized contextual drift and event shifts directly from the narrative input. To enable high-precision voxelwise encoding models with stable parameter estimates, we densely sampled one healthy adult across more than 7 hours of listening to thirteen crime stories while collecting ultra high-field (7T) BOLD data. We then modeled the feature-informed hemodynamic response using a regularized encoding framework validated on independent stories. Drift predictions were prevalent in default-mode network hubs, whereas shift predictions were evident bilaterally in the primary auditory cortex and language association cortex. Furthermore, activity in default-mode and parietal networks was best explained by a signal capturing how meaning accumulates and gradually fades over the course of the narrative. Together, these findings show that coherence during language comprehension is implemented through dissociable neural regimes of slow contextual integration and rapid event-driven reconfiguration, offering a mechanistic entry point for understanding disturbances of language coherence in psychiatric disorders.