Less is more: Not all samples are effective for evaluation

作者: Wentang Song, Jinqiang Li, Kele Huang, Junhui Lin, Shengxiang Wu, Zhongshi Xie

分类: cs.CL, cs.AI

发布日期: 2025-12-22

💡 一句话要点

提出一种无需历史数据的测试集压缩框架,降低LLM评测成本并保持高保真度。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 测试集压缩 领域自适应 语义嵌入 任务感知聚类

📋 核心要点

- 现有测试集压缩方法依赖历史模型数据,无法应用于新任务或模型冷启动场景。

- 提出一种无需历史数据的测试集压缩框架,通过领域自适应嵌入和任务感知聚类实现。

- 实验表明,该方法在3GPP通信基准上可降低90%以上的评估成本,同时保持高保真度。

📝 摘要(中文)

大型语言模型(LLM)在垂直领域的广泛应用催生了大量专业评估基准。然而,这些基准通常存在显著的语义冗余,并导致高昂的计算成本。现有的压缩方法,例如tinyBenchmarks,严重依赖于在完整测试集上评估的多个历史模型的正确性标签,这使得它们不适用于冷启动场景,例如引入没有先前评估历史的新任务、领域或模型。为了解决这个限制,我们提出了一种无需历史数据的测试集压缩框架,该框架不需要先前的模型性能数据。我们的方法首先在少量领域特定数据上微调基础LLM,以内部化任务相关的语义。然后,它仅使用原始文本内容为所有原始测试样本生成高级语义嵌入。在这个领域自适应的嵌入空间中,我们执行任务感知的聚类,并引入一种新颖的数据集X射线机制,该机制分析聚类几何形状,以基于基准的内在冗余动态校准压缩强度。在专业领域数据集(特别是大规模3GPP通信基准)上的实验表明,我们的方法有效地识别和删除冗余样本,在保持对完整基准的高保真度的同时,将评估成本降低了90%以上。

🔬 方法详解

问题定义:现有测试集压缩方法,如tinyBenchmarks,需要依赖多个历史模型在完整测试集上的评估结果,即需要模型的正确性标签。这使得它们无法应用于冷启动场景,例如当引入一个新的任务、领域或者模型时,由于缺乏历史评估数据,无法进行有效的测试集压缩。因此,如何设计一种无需历史数据的测试集压缩方法是一个关键问题。

核心思路:论文的核心思路是通过领域自适应的语义嵌入和任务感知的聚类来识别和移除测试集中的冗余样本。首先,利用少量领域数据微调LLM,使其能够理解任务相关的语义信息。然后,利用微调后的LLM为每个测试样本生成语义嵌入。最后,在嵌入空间中进行聚类,并根据聚类结果动态调整压缩强度,从而在保证测试集代表性的前提下,减少样本数量。

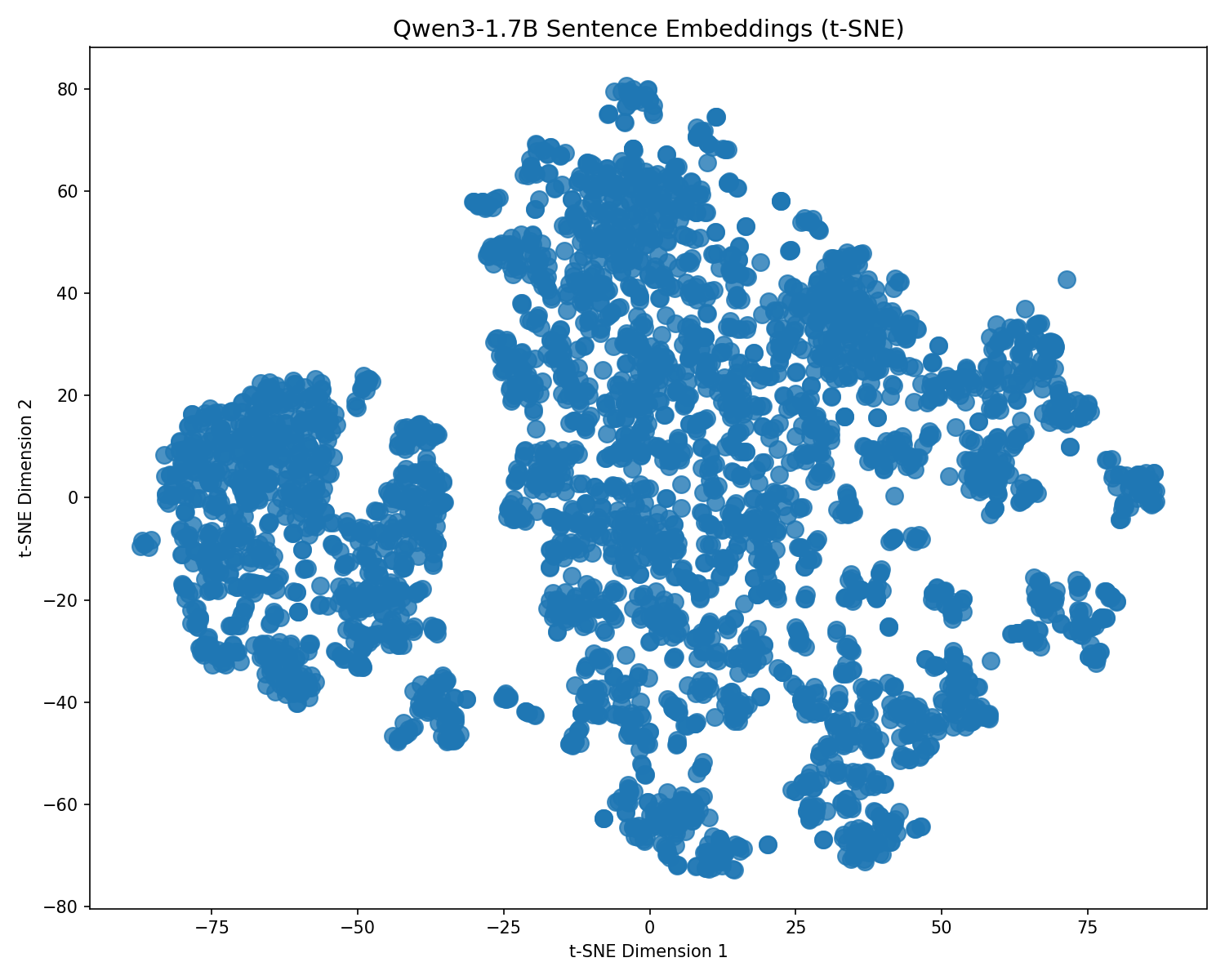

技术框架:该框架主要包含以下几个阶段:1. 领域自适应微调:使用少量领域特定数据微调基础LLM,使其具备理解任务相关语义的能力。2. 语义嵌入生成:使用微调后的LLM为所有测试样本生成高层语义嵌入。3. 任务感知聚类:在嵌入空间中执行聚类,将语义相似的样本归为一类。4. 数据集X射线机制:分析聚类几何形状,动态校准压缩强度,确定每个簇中需要保留的样本数量。

关键创新:该方法最重要的创新点在于提出了一个无需历史数据的测试集压缩框架。与现有方法相比,该方法不需要依赖任何历史模型的评估结果,因此可以应用于冷启动场景。此外,该方法还引入了一种新颖的数据集X射线机制,可以根据聚类几何形状动态调整压缩强度,从而更好地平衡压缩率和测试集代表性。

关键设计:在领域自适应微调阶段,选择合适的预训练LLM和微调数据集至关重要。在语义嵌入生成阶段,需要选择合适的嵌入维度和生成方式。在任务感知聚类阶段,需要选择合适的聚类算法和距离度量。数据集X射线机制的具体实现方式(例如,如何定义聚类几何形状,如何根据几何形状调整压缩强度)也是一个关键的设计细节。论文中具体使用的参数设置、损失函数和网络结构等技术细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在3GPP通信基准上可以将评估成本降低90%以上,同时保持对完整基准的高保真度。这意味着可以使用更少的样本来获得与使用完整基准相似的评估结果,从而大大降低了计算成本和时间。具体的性能数据和对比基线未知。

🎯 应用场景

该研究成果可广泛应用于各种需要对LLM进行评估的场景,尤其是在计算资源有限或需要快速迭代的场景下。例如,在开发新的垂直领域LLM时,可以使用该方法快速压缩评估基准,从而降低开发成本和时间。此外,该方法还可以用于持续监控LLM的性能,及时发现潜在的问题。

📄 摘要(原文)

The versatility of Large Language Models (LLMs) in vertical domains has spurred the development of numerous specialized evaluation benchmarks. However, these benchmarks often suffer from significant semantic redundancy and impose high computational costs during evaluation. Existing compression methods, such as tinyBenchmarks depend critically on correctness labels from multiple historical models evaluated on the full test set, making them inapplicable in cold-start scenarios, such as the introduction of a new task, domain, or model with no prior evaluation history. To address this limitation, we propose a history-free test set compression framework that requires no prior model performance data. Our method begins by fine-tuning a base LLM on a small amount of domain-specific data to internalize task-relevant semantics. It then generates high-level semantic embeddings for all original test samples using only their raw textual content. In this domain-adapted embedding space, we perform task-aware clustering and introduce a novel dataset X-ray mechanism that analyzes cluster geometry to dynamically calibrate the compression intensity based on the intrinsic redundancy of the benchmark. Experiments on professional-domain dataset, notably a large-scale 3GPP communications benchmark, demonstrate that our approach effectively identifies and removes redundant samples, reducing evaluation cost by over 90% while preserving high fidelity to the full benchmark.