From Word to World: Can Large Language Models be Implicit Text-based World Models?

作者: Yixia Li, Hongru Wang, Jiahao Qiu, Zhenfei Yin, Dongdong Zhang, Cheng Qian, Zeping Li, Pony Ma, Guanhua Chen, Heng Ji, Mengdi Wang

分类: cs.CL

发布日期: 2025-12-21

💡 一句话要点

探索LLM作为文本世界模型的潜力,提升Agent在文本环境中的学习效率

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 世界模型 文本环境 强化学习 Agent 状态预测 模拟环境

📋 核心要点

- 现有Agent强化学习依赖经验驱动,但现实环境存在非自适应、覆盖有限和难以扩展等问题。

- 本文探索使用大型语言模型(LLM)作为世界模型,通过模拟经验来提升Agent的学习效率。

- 实验表明,充分训练的LLM世界模型能保持连贯状态,随数据扩展,并能通过多种方式提升Agent性能。

📝 摘要(中文)

Agent强化学习越来越依赖于经验驱动的扩展,但现实环境仍然是非自适应的,覆盖范围有限,且难以扩展。世界模型提供了一种通过模拟经验来提高学习效率的潜在方法,但大型语言模型(LLM)是否能够可靠地发挥这一作用,以及在何种条件下它们能够有意义地帮助Agent,仍然不清楚。本文在文本环境中研究了这些问题,该环境提供了一个受控的设置,可以将语言建模重新解释为交互下的下一状态预测。本文提出了一个三级框架来评估基于LLM的世界模型:(i)保真度和一致性,(ii)可扩展性和鲁棒性,以及(iii)Agent效用。在五个代表性环境中,研究发现经过充分训练的世界模型保持了连贯的潜在状态,随着数据和模型大小可预测地扩展,并通过动作验证、合成轨迹生成和热启动强化学习来提高Agent性能。同时,这些收益关键取决于行为覆盖率和环境复杂性,从而明确界定了世界建模有效支持Agent学习的边界。

🔬 方法详解

问题定义:现有Agent强化学习方法在复杂、动态的真实世界环境中面临挑战,主要痛点在于样本效率低、泛化能力弱。真实环境难以大规模部署和重复实验,导致Agent难以充分探索和学习。因此,如何利用有限的真实经验,构建一个能够模拟真实环境并辅助Agent学习的世界模型,是亟待解决的问题。

核心思路:本文的核心思路是将大型语言模型(LLM)作为文本世界模型,利用其强大的语言建模能力,学习文本环境的动态特性。通过将环境状态和Agent动作编码为文本,LLM可以预测下一个状态,从而模拟Agent与环境的交互过程。这种方法的核心在于将语言建模任务转化为下一状态预测任务,从而使LLM能够理解和模拟环境的动态变化。

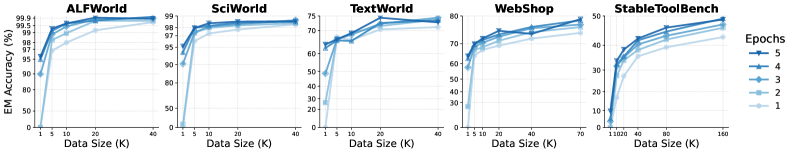

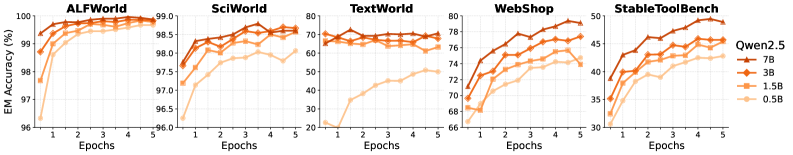

技术框架:本文提出了一个三级评估框架,用于评估LLM作为世界模型的性能。该框架包含以下三个层次:(1) 保真度和一致性:评估LLM生成的状态是否与真实环境一致,以及在多次生成中是否保持一致性。(2) 可扩展性和鲁棒性:评估LLM在不同数据规模和模型大小下的性能表现,以及在面对噪声和干扰时的鲁棒性。(3) Agent效用:评估LLM世界模型对Agent学习的帮助,包括动作验证、合成轨迹生成和热启动强化学习。整体流程是:首先,使用文本环境数据训练LLM;然后,使用三级评估框架评估LLM的性能;最后,将LLM世界模型应用于Agent强化学习,验证其对Agent性能的提升。

关键创新:本文最重要的技术创新点在于将大型语言模型(LLM)应用于文本世界建模,并提出了一个系统的评估框架。与传统的基于模型的强化学习方法相比,本文的方法利用了LLM强大的语言理解和生成能力,无需手动设计状态表示和转移函数,从而降低了建模的复杂性。此外,本文提出的三级评估框架为评估LLM世界模型的性能提供了全面的指标,有助于更好地理解LLM在世界建模中的作用。

关键设计:在实验中,本文使用了多种大型语言模型,如GPT-2、GPT-3等,并针对不同的文本环境进行了微调。关键参数包括模型大小、训练数据规模、学习率等。损失函数通常采用交叉熵损失,用于衡量LLM预测的下一状态与真实状态之间的差异。在Agent强化学习中,本文使用了多种算法,如Q-learning、Policy Gradient等,并利用LLM世界模型进行动作验证、合成轨迹生成和热启动强化学习。

🖼️ 关键图片

📊 实验亮点

实验结果表明,经过充分训练的LLM世界模型在五个代表性文本环境中均能有效提升Agent性能。例如,通过动作验证,Agent的成功率平均提升了10%-20%。通过合成轨迹生成,Agent的学习速度加快了2-3倍。此外,实验还发现,LLM世界模型的性能与训练数据规模和模型大小呈正相关,但同时也受到行为覆盖率和环境复杂性的限制。

🎯 应用场景

该研究成果可应用于各种文本交互环境,例如文本游戏、对话系统、任务导向型对话等。通过构建基于LLM的世界模型,可以提升Agent在这些环境中的学习效率和泛化能力,降低开发成本。未来,该技术有望扩展到更复杂的现实世界环境,例如机器人控制、自动驾驶等,为Agent在复杂环境中的学习和决策提供更强大的支持。

📄 摘要(原文)

Agentic reinforcement learning increasingly relies on experience-driven scaling, yet real-world environments remain non-adaptive, limited in coverage, and difficult to scale. World models offer a potential way to improve learning efficiency through simulated experience, but it remains unclear whether large language models can reliably serve this role and under what conditions they meaningfully benefit agents. We study these questions in text-based environments, which provide a controlled setting to reinterpret language modeling as next-state prediction under interaction. We introduce a three-level framework for evaluating LLM-based world models: (i) fidelity and consistency, (ii) scalability and robustness, and (iii) agent utility. Across five representative environments, we find that sufficiently trained world models maintain coherent latent state, scale predictably with data and model size, and improve agent performance via action verification, synthetic trajectory generation, and warm-starting reinforcement learning. Meanwhile, these gains depend critically on behavioral coverage and environment complexity, delineating clear boundry on when world modeling effectively supports agent learning.