LIR$^3$AG: A Lightweight Rerank Reasoning Strategy Framework for Retrieval-Augmented Generation

作者: Guo Chen, Junjie Huang, Huaijin Xie, Fei Sun, Tao Jia

分类: cs.CL

发布日期: 2025-12-20 (更新: 2026-01-19)

备注: AAAI2026

💡 一句话要点

提出LiR$^3$AG框架,通过重构检索证据链,提升RAG中非推理模型在多跳QA任务上的性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 检索增强生成 多跳问答 推理策略 证据重构 轻量级框架

📋 核心要点

- 现有RAG系统在多跳QA任务中依赖推理模型,但推理模型引入了显著的计算成本,如token消耗和推理延迟。

- LiR$^3$AG框架通过重构检索到的证据,形成连贯的推理链,使非推理模型能够模仿推理策略,从而提升性能。

- 实验表明,LiR$^3$AG显著降低了计算开销,同时提升了非推理模型的F1性能,甚至超越了更大的推理模型。

📝 摘要(中文)

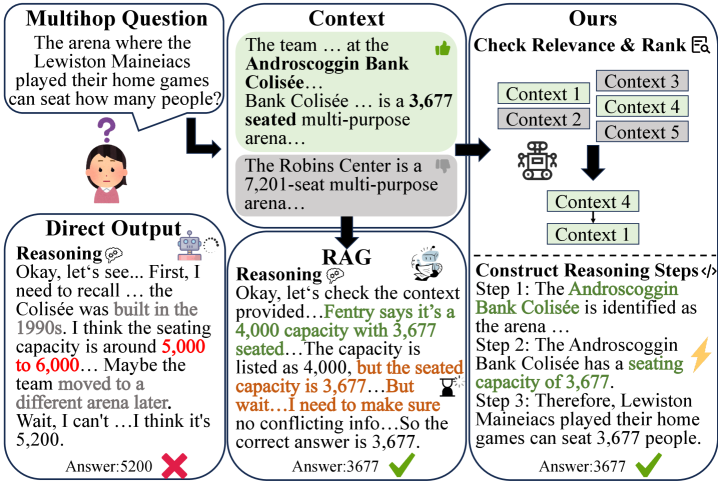

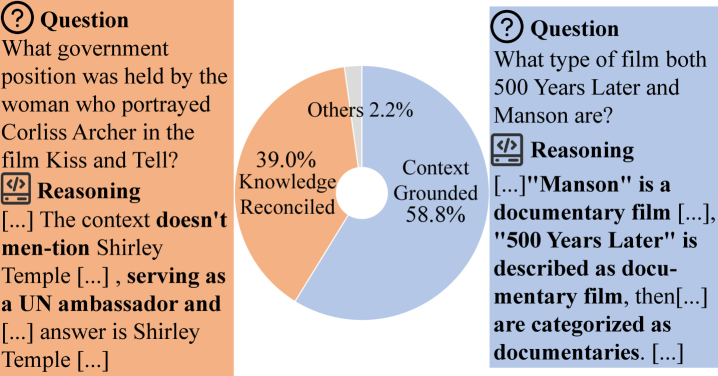

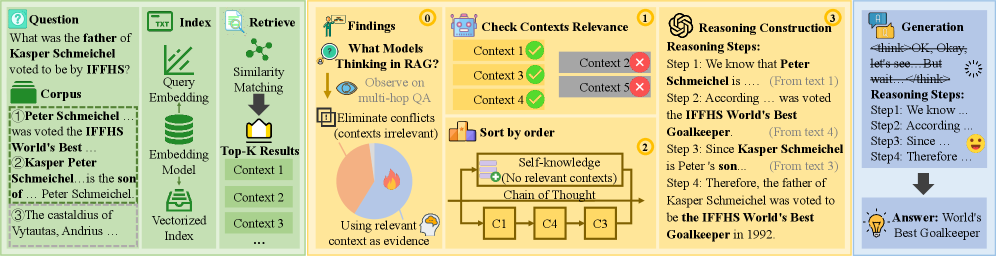

检索增强生成(RAG)通过将检索到的外部知识融入生成过程,有效地增强了大型语言模型(LLM)。推理模型可以提高LLM在多跳QA任务中的性能,这类任务需要整合和推理多个文档中的证据来回答复杂问题。然而,它们通常会带来巨大的计算成本,包括增加token消耗和推理延迟。为了更好地理解和缓解这种权衡,我们对RAG多跳QA任务中推理模型的推理策略进行了全面的研究。我们的研究结果表明,推理模型采用结构化的策略来整合检索到的知识和内部知识,主要遵循两种模式:上下文相关的推理,直接依赖于检索到的内容;知识协调的推理,利用内部知识解决冲突或填补空白。为此,我们提出了一种新颖的轻量级重排序推理策略框架LiR$^3$AG,通过将检索到的证据重构为连贯的推理链,使非推理模型能够迁移推理策略。LiR$^3$AG显著降低了平均98%的输出token开销和58.6%的推理时间,同时将8B非推理模型的F1性能提高了6.2%到22.5%,超过了RAG中32B推理模型的性能,为RAG系统提供了一条实用且高效的前进道路。

🔬 方法详解

问题定义:论文旨在解决RAG系统中,推理模型在多跳QA任务中计算成本高昂的问题。现有方法依赖大型推理模型来整合多文档证据,导致token消耗和推理延迟显著增加,限制了RAG系统的实际应用。

核心思路:论文的核心思路是通过分析推理模型的推理策略,发现其主要采用上下文相关推理和知识协调推理两种模式。然后,通过重构检索到的证据,模拟推理模型的推理过程,使非推理模型也能获得类似的推理能力,从而在降低计算成本的同时提升性能。

技术框架:LiR$^3$AG框架主要包含以下几个阶段:1) 检索:从外部知识库中检索相关文档。2) 推理策略分析:分析推理模型在多跳QA任务中的推理模式(上下文相关推理和知识协调推理)。3) 证据重构:根据分析得到的推理策略,对检索到的证据进行重排序和组织,形成连贯的推理链。4) 生成:使用重构后的证据作为上下文,输入非推理模型进行答案生成。

关键创新:该论文的关键创新在于提出了一种轻量级的重排序推理策略框架,通过重构检索到的证据,使非推理模型能够迁移推理策略。这种方法避免了直接使用大型推理模型带来的高计算成本,同时提升了非推理模型在多跳QA任务中的性能。

关键设计:论文的关键设计包括:1) 推理策略的分析和建模,确定了上下文相关推理和知识协调推理两种主要模式。2) 证据重构算法,如何根据推理策略对检索到的证据进行重排序和组织,形成连贯的推理链。3) 框架的轻量级设计,确保在降低计算成本的同时,保持性能提升。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LiR$^3$AG框架能够显著降低计算开销,平均降低98%的输出token开销和58.6%的推理时间。同时,该框架将8B非推理模型的F1性能提高了6.2%到22.5%,甚至超越了RAG中32B推理模型的性能,证明了其在提升RAG系统效率和性能方面的有效性。

🎯 应用场景

该研究成果可应用于各种需要多跳推理的RAG系统,例如智能问答、知识图谱推理、文档摘要等。通过降低计算成本并提升性能,LiR$^3$AG框架有望推动RAG技术在资源受限环境下的应用,并促进更高效、更智能的知识服务。

📄 摘要(原文)

Retrieval-Augmented Generation (RAG) effectively enhances Large Language Models (LLMs) by incorporating retrieved external knowledge into the generation process. Reasoning models improve LLM performance in multi-hop QA tasks, which require integrating and reasoning over multiple pieces of evidence across different documents to answer a complex question. However, they often introduce substantial computational costs, including increased token consumption and inference latency. To better understand and mitigate this trade-off, we conduct a comprehensive study of reasoning strategies for reasoning models in RAG multi-hop QA tasks. Our findings reveal that reasoning models adopt structured strategies to integrate retrieved and internal knowledge, primarily following two modes: Context-Grounded Reasoning, which relies directly on retrieved content, and Knowledge-Reconciled Reasoning, which resolves conflicts or gaps using internal knowledge. To this end, we propose a novel Lightweight Rerank Reasoning Strategy Framework for RAG (LiR$^3$AG) to enable non-reasoning models to transfer reasoning strategies by restructuring retrieved evidence into coherent reasoning chains. LiR$^3$AG significantly reduce the average 98% output tokens overhead and 58.6% inferencing time while improving 8B non-reasoning model's F1 performance ranging from 6.2% to 22.5% to surpass the performance of 32B reasoning model in RAG, offering a practical and efficient path forward for RAG systems.