When F1 Fails: Granularity-Aware Evaluation for Dialogue Topic Segmentation

作者: Michael H. Coen

分类: cs.CL, cs.AI

发布日期: 2025-12-18 (更新: 2025-12-31)

备注: 34 pages, 4 figures. Evaluation and methodology study on dialogue topic segmentation

💡 一句话要点

提出一种细粒度对话主题分割评估框架,解决传统F1指标的局限性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 对话主题分割 评估框架 粒度选择 大型语言模型 边界密度 片段对齐 窗口容忍F1

📋 核心要点

- 现有对话主题分割评估主要依赖严格边界匹配和F1指标,无法有效评估LLM对话系统中的分割质量。

- 该论文提出一种新的评估框架,分离边界评分与选择,引入边界密度和片段对齐诊断指标。

- 跨数据集评估表明,性能差异常源于注释粒度不匹配,而非边界放置质量,强调粒度选择的重要性。

📝 摘要(中文)

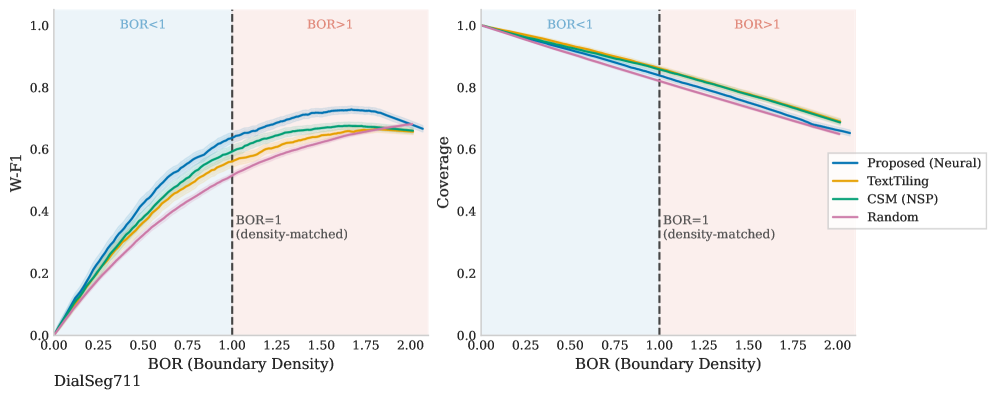

对话主题分割支持摘要生成、信息检索、记忆管理和对话连贯性。尽管经过数十年的研究,评估实践仍然主要依赖于严格的边界匹配和基于F1的指标。现代基于大型语言模型(LLM)的对话系统越来越多地依赖分割来管理超出固定上下文窗口的对话历史。在此类系统中,非结构化的上下文累积会降低效率和连贯性。本文介绍了一种评估框架,该框架报告边界密度和片段对齐诊断(纯度和覆盖率),以及窗口容忍F1(W-F1)。通过将边界评分与边界选择分离,我们在密度范围内评估分割质量,而不是在单个操作点。跨数据集评估表明,报告的性能差异通常反映的是注释粒度不匹配,而不仅仅是边界放置质量。我们评估了跨越任务型、开放域、会议式和合成交互的八个对话数据集上结构不同的分割策略。基于边界的指标与边界密度密切相关:阈值扫描产生的W-F1变化大于在方法之间切换。这些发现支持将主题分割视为粒度选择问题,而不是预测单个正确的边界集。这促使人们将边界评分与边界选择分开,以便在不同的注释粒度下分析和调整分割。

🔬 方法详解

问题定义:对话主题分割旨在将对话划分为语义连贯的片段,这对对话摘要、信息检索等任务至关重要。然而,现有评估方法,特别是基于F1的指标,对边界的严格匹配要求较高,无法有效反映分割的整体质量,尤其是在注释粒度存在差异的情况下。此外,大型语言模型驱动的对话系统依赖主题分割来管理长程对话历史,而现有评估方法难以有效指导此类系统的分割策略优化。

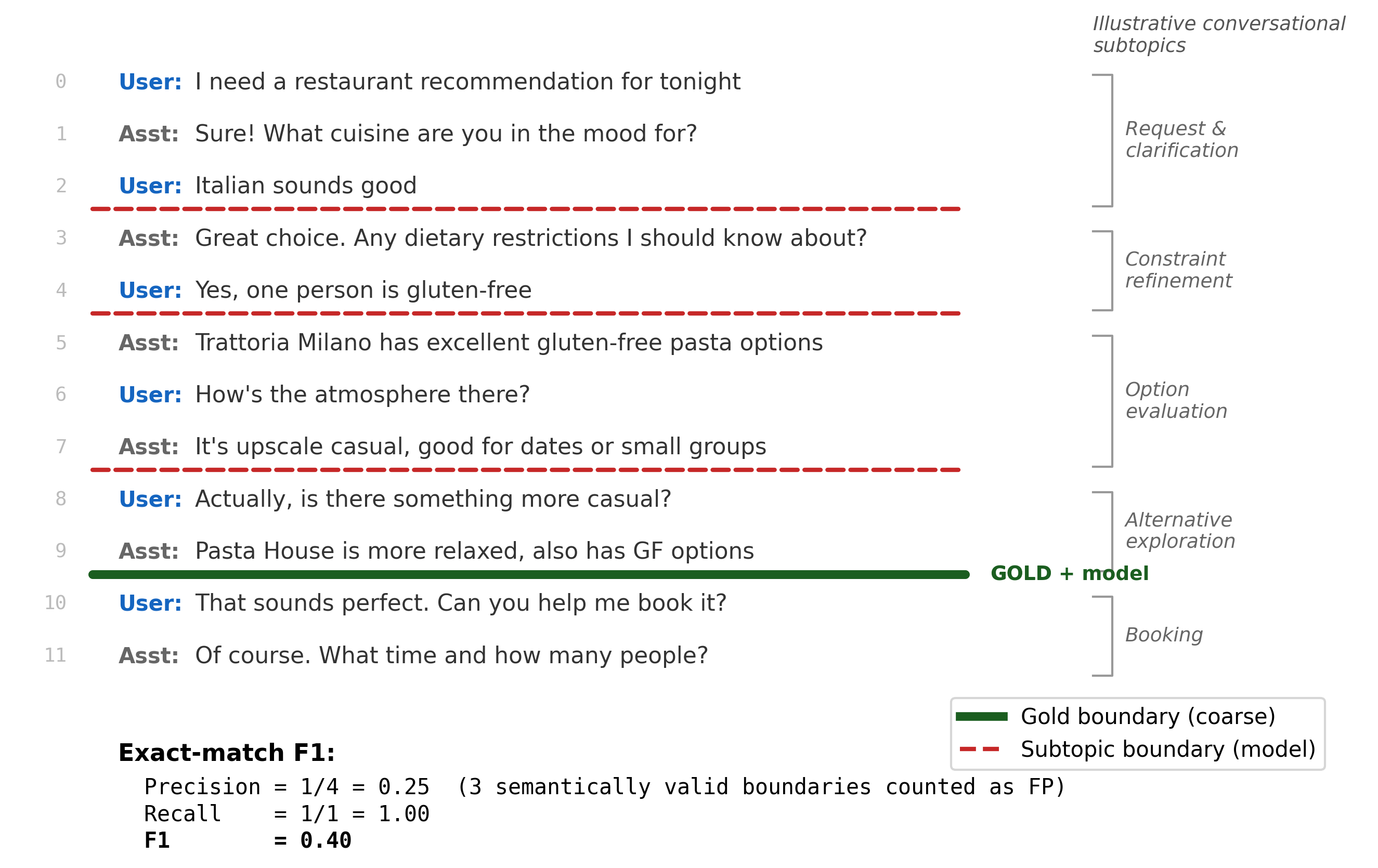

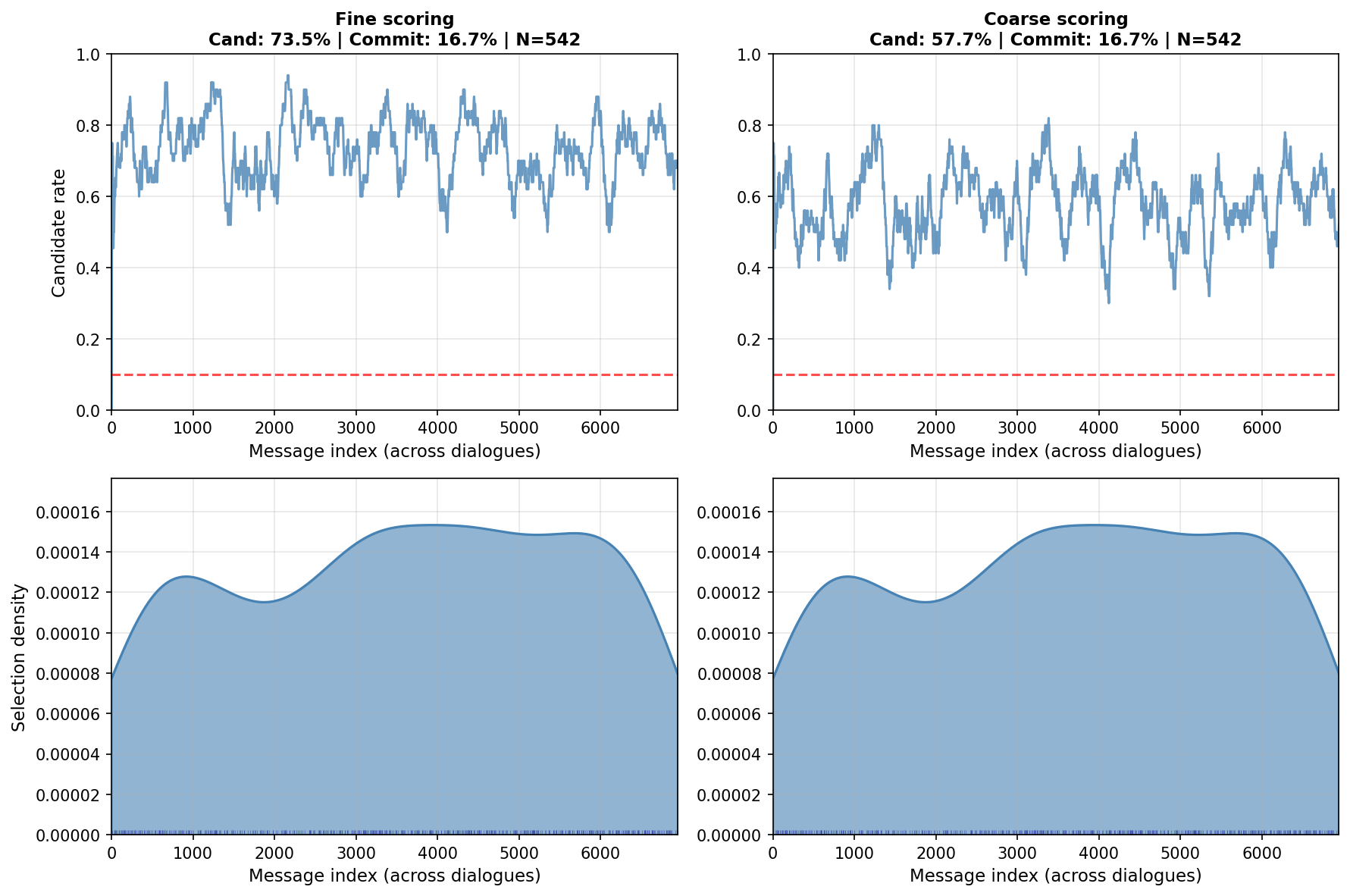

核心思路:该论文的核心思路是将边界的评分与边界的选择过程解耦。传统方法直接基于预测的边界集合与真实边界集合的匹配程度计算F1值,而该论文提出的框架首先对每个可能的边界进行评分,然后独立地评估边界密度和片段对齐情况。这种解耦使得评估能够更全面地反映分割质量,并对不同粒度的分割结果进行有效比较。

技术框架:该评估框架主要包含以下几个模块:1) 边界密度评估:衡量预测边界的密度分布情况。2) 片段对齐诊断:包括纯度(purity)和覆盖率(coverage),用于评估预测片段与真实片段的对齐程度。3) 窗口容忍F1(W-F1):在一定窗口范围内允许边界误差的F1指标,作为补充参考。框架通过综合分析这些指标,提供对分割质量的更细粒度理解。

关键创新:该论文的关键创新在于提出了一个与边界选择过程解耦的评估框架。传统评估方法将分割视为一个边界预测问题,而该论文将其视为一个粒度选择问题。通过分离边界评分和边界选择,该框架能够更有效地分析和调整不同注释粒度下的分割结果,从而更好地指导分割策略的优化。

关键设计:该框架的关键设计包括:1) 使用边界密度来反映分割的粒度;2) 使用纯度和覆盖率来评估片段的对齐程度,从而更全面地反映分割质量;3) 采用窗口容忍F1作为补充指标,以考虑边界误差的影响。此外,该框架还强调了跨数据集评估的重要性,并提出了相应的评估方法,以解决注释粒度不匹配的问题。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于边界的指标与边界密度密切相关,阈值扫描对W-F1的影响大于方法选择。跨数据集评估揭示,性能差异常源于注释粒度不匹配,而非边界放置质量。这些发现强调了将主题分割视为粒度选择问题的重要性,并验证了所提出评估框架的有效性。

🎯 应用场景

该研究成果可应用于提升基于LLM的对话系统的性能,例如改进对话摘要生成、优化信息检索结果、提升对话连贯性。通过更准确地评估和优化对话主题分割,可以更好地管理和利用长程对话历史,从而提升用户体验和系统效率。此外,该评估框架也可用于指导对话数据标注,提高标注质量和一致性。

📄 摘要(原文)

Dialogue topic segmentation supports summarization, retrieval, memory management, and conversational continuity. Despite decades of work, evaluation practice remains dominated by strict boundary matching and F1-based metrics. Modern large language model (LLM) based conversational systems increasingly rely on segmentation to manage conversation history beyond fixed context windows. In such systems, unstructured context accumulation degrades efficiency and coherence. This paper introduces an evaluation framework that reports boundary density and segment alignment diagnostics (purity and coverage) alongside window-tolerant F1 (W-F1). By separating boundary scoring from boundary selection, we evaluate segmentation quality across density regimes rather than at a single operating point. Cross-dataset evaluation shows that reported performance differences often reflect annotation granularity mismatch rather than boundary placement quality alone. We evaluate structurally distinct segmentation strategies across eight dialogue datasets spanning task-oriented, open-domain, meeting-style, and synthetic interactions. Boundary-based metrics are strongly coupled to boundary density: threshold sweeps produce larger W-F1 changes than switching between methods. These findings support viewing topic segmentation as a granularity selection problem rather than prediction of a single correct boundary set. This motivates separating boundary scoring from boundary selection for analyzing and tuning segmentation under varying annotation granularities.