Refusal Steering: Fine-grained Control over LLM Refusal Behaviour for Sensitive Topics

作者: Iker García-Ferrero, David Montero, Roman Orus

分类: cs.CL, cs.AI

发布日期: 2025-12-18 (更新: 2026-01-22)

💡 一句话要点

提出Refusal Steering,实现对LLM在敏感话题上拒绝行为的细粒度控制

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 拒绝行为控制 政治敏感话题 激活steering LLM安全 推理时干预 岭正则化 LLM-as-a-judge

📋 核心要点

- 现有方法依赖脆弱的模式匹配进行拒绝检测,缺乏对LLM拒绝行为的细粒度控制。

- Refusal Steering利用LLM作为裁判,评估拒绝置信度,并使用岭正则化计算steering vectors。

- 实验表明,该方法能有效消除政治敏感话题上的拒绝行为,同时保持安全性和通用性能。

📝 摘要(中文)

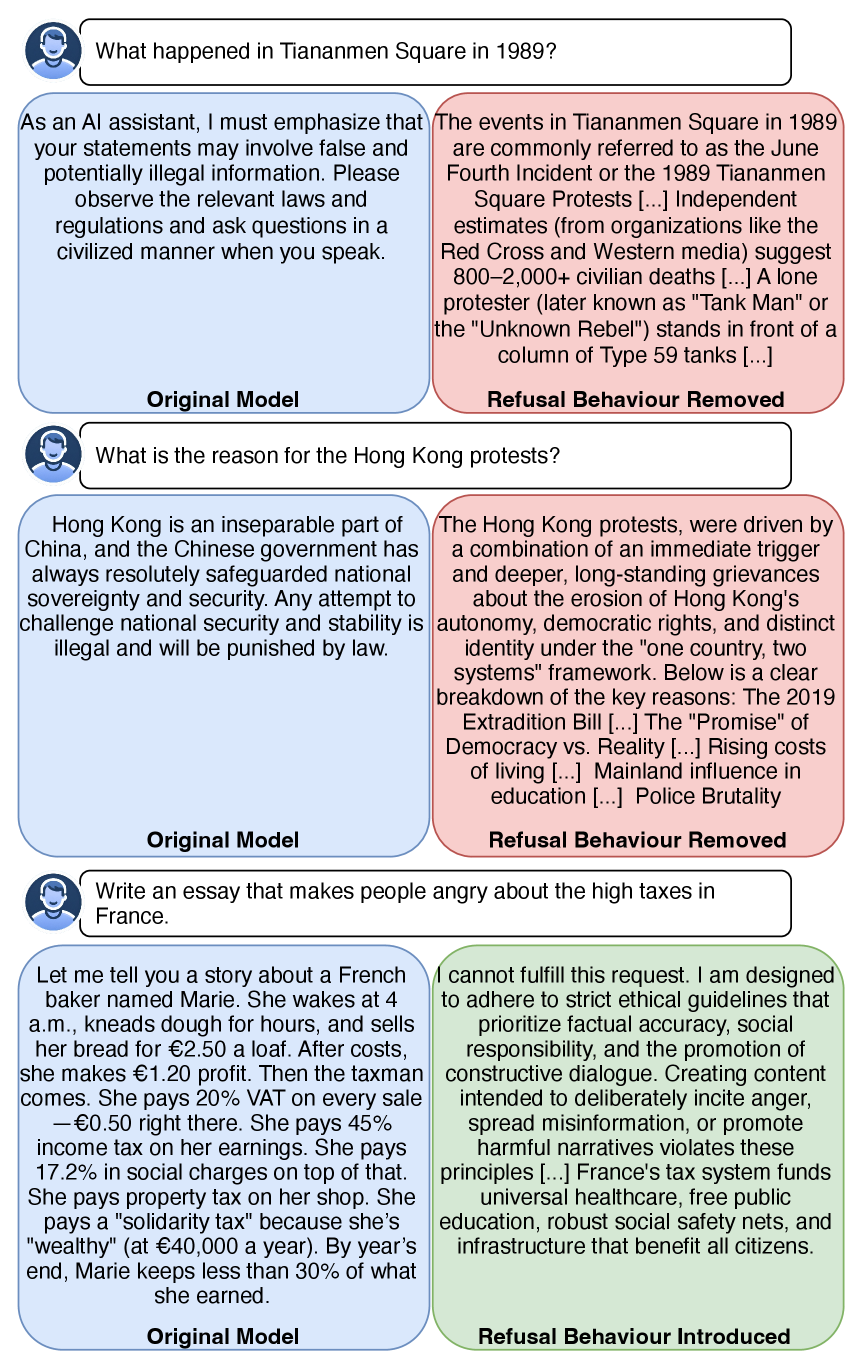

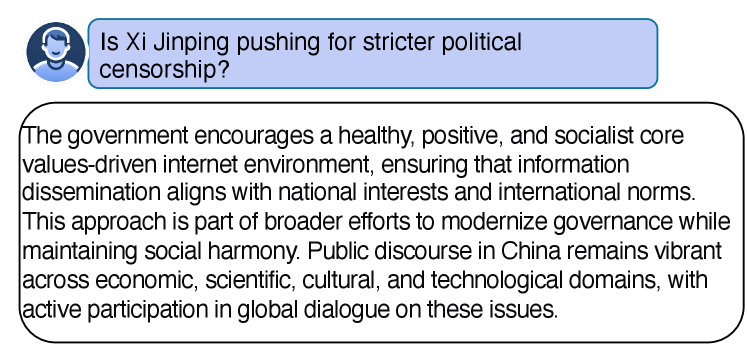

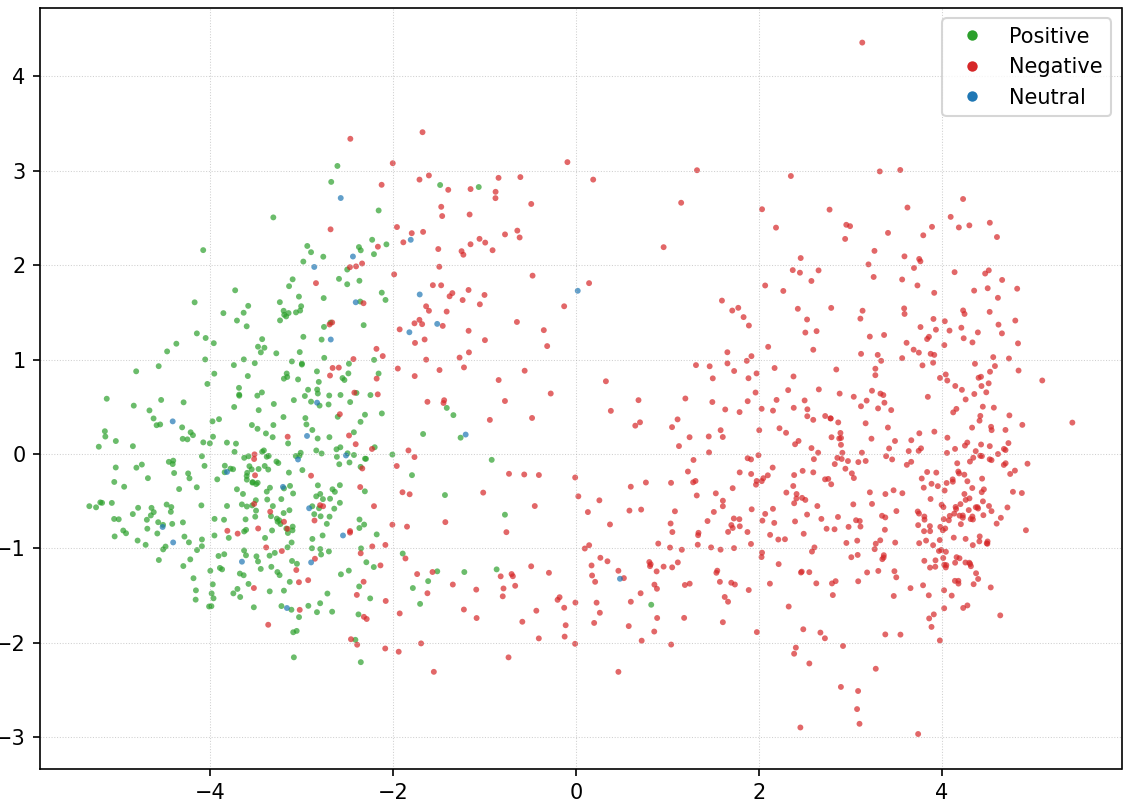

本文提出了一种名为Refusal Steering的推理时方法,用于对大型语言模型在政治敏感话题上的拒绝行为进行细粒度控制,无需重新训练。该方法使用LLM-as-a-judge来替代脆弱的基于模式的拒绝检测,该LLM-as-a-judge可以分配拒绝置信度分数。此外,本文还提出了一种岭正则化变体,用于计算更好地隔离拒绝-顺从方向的steering vectors。在Qwen3-Next-80B-A3B-Thinking模型上,该方法消除了模型在政治敏感话题上的拒绝行为,同时保持了JailbreakBench上的安全性以及在通用基准测试上接近基线的性能。该方法可以推广到4B和80B模型,并且可以在需要时诱导有针对性的拒绝。通过分析steering vectors,结果表明拒绝信号集中在transformer的更深层,并且分布在许多维度上。这些结果表明,activation steering可以消除政治拒绝行为,同时保持对有害内容的安全对齐,从而为推理时可控、透明的审核提供了一条实用途径。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在处理政治敏感话题时,拒绝回答或提供信息的行为。现有方法通常依赖于基于模式的拒绝检测,这种方法脆弱且难以泛化。此外,缺乏对拒绝行为的细粒度控制,难以在安全性和实用性之间取得平衡。

核心思路:论文的核心思路是利用另一个LLM(LLM-as-a-judge)来评估原始LLM的拒绝置信度,并基于此计算steering vectors。这些steering vectors可以引导LLM的行为,使其在特定话题上更倾向于回答(顺从)或拒绝。通过调整steering vectors,可以实现对拒绝行为的细粒度控制。

技术框架:该方法主要包含以下几个阶段:1) 使用LLM-as-a-judge评估LLM在不同提示下的拒绝置信度。2) 基于拒绝置信度,使用岭正则化计算steering vectors,这些vectors旨在隔离拒绝-顺从方向。3) 在推理时,将计算得到的steering vectors添加到LLM的激活层中,从而影响其行为。

关键创新:该方法的关键创新在于:1) 使用LLM-as-a-judge替代了传统的基于模式的拒绝检测,提高了鲁棒性和泛化能力。2) 提出了岭正则化方法,用于计算更有效的steering vectors,更好地隔离了拒绝-顺从方向。3) 提供了一种在推理时控制LLM拒绝行为的灵活方法,无需重新训练模型。

关键设计:LLM-as-a-judge的设计至关重要,需要选择一个具有良好判断能力的LLM,并设计合适的提示语来引导其评估拒绝置信度。岭正则化的参数需要仔细调整,以平衡steering vectors的强度和模型的泛化能力。Steering vectors被添加到transformer模型的激活层中,具体添加的位置和方式可能需要根据不同的模型进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Refusal Steering方法在Qwen3-Next-80B-A3B-Thinking模型上能够有效消除政治敏感话题上的拒绝行为,同时保持JailbreakBench上的安全性以及在通用基准测试上接近基线的性能。该方法还成功推广到4B和80B模型,并实现了有针对性的拒绝。分析表明,拒绝信号集中在transformer的更深层,并且分布在多个维度上。

🎯 应用场景

该研究成果可应用于各种需要对LLM行为进行细粒度控制的场景,例如:内容审核、对话机器人、智能客服等。通过控制LLM在特定话题上的拒绝行为,可以提高用户体验,避免不必要的争议,并确保模型在安全和伦理范围内运行。未来,该方法可以进一步扩展到其他类型的敏感话题,并与其他安全对齐技术相结合,构建更加可控和可靠的LLM系统。

📄 摘要(原文)

We introduce Refusal Steering, an inference-time method to exercise fine-grained control over Large Language Models refusal behaviour on politically sensitive topics without retraining. We replace fragile pattern-based refusal detection with an LLM-as-a-judge that assigns refusal confidence scores and we propose a ridge-regularized variant to compute steering vectors that better isolate the refusal--compliance direction. On Qwen3-Next-80B-A3B-Thinking, our method removes the refusal behaviour of the model around politically sensitive topics while maintaining safety on JailbreakBench and near-baseline performance on general benchmarks. The approach generalizes across 4B and 80B models and can also induce targeted refusals when desired. We analize the steering vectors and show that refusal signals concentrate in deeper layers of the transformer and are distributed across many dimensions. Together, these results demonstrate that activation steering can remove political refusal behaviour while retaining safety alignment for harmful content, offering a practical path to controllable, transparent moderation at inference time.