Beyond Majority Voting: Towards Fine-grained and More Reliable Reward Signal for Test-Time Reinforcement Learning

作者: Weiqin Wang, Yile Wang, Kehao Chen, Hui Huang

分类: cs.CL

发布日期: 2025-12-17 (更新: 2025-12-18)

🔗 代码/项目: GITHUB

💡 一句话要点

提出SCOPE框架,通过细粒度置信度加权伪标签提升测试时强化学习效果

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 测试时强化学习 伪标签 置信度加权 子群划分 大型语言模型

📋 核心要点

- 多数投票策略在测试时强化学习中易产生确认偏差和奖励稀疏问题,限制了模型性能。

- SCOPE框架通过整合模型置信度和动态子群划分,实现更精细、可靠的伪标签估计。

- 实验表明,SCOPE在AIME 2025和AMC等基准测试中显著优于现有方法,提升了模型性能。

📝 摘要(中文)

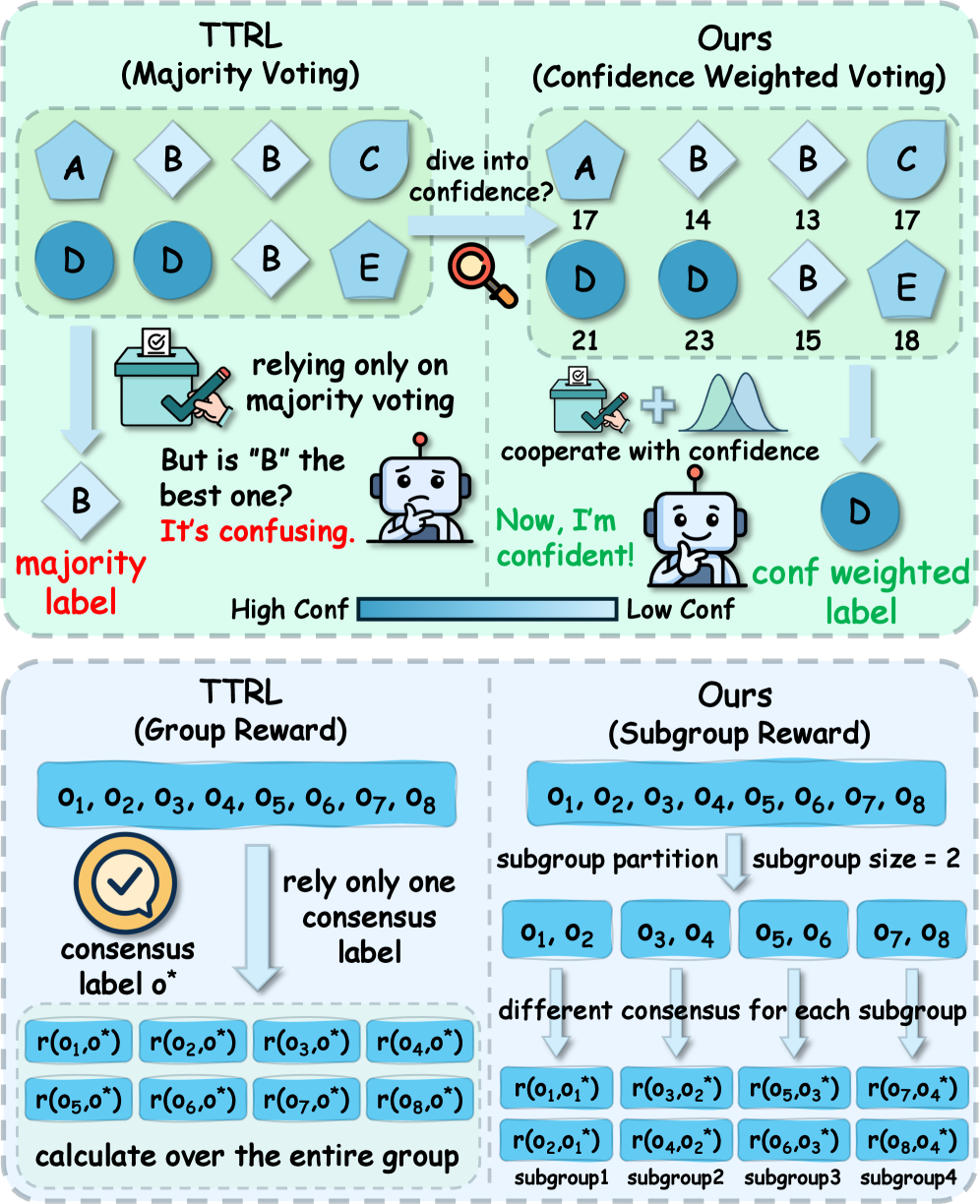

本文提出了一种名为子群特异性步进置信度加权伪标签估计(SCOPE)的框架,旨在解决测试时强化学习中多数投票策略引起的确认偏差和稀疏奖励问题。该框架集成了模型置信度和动态子群划分,通过步进置信度加权伪标签推导,优先考虑高质量的推理路径。此外,SCOPE通过平衡推理质量和探索多样性,将候选输出池动态划分为独立的子群,并通过重复采样为每个子群推导出局部共识,从而提供多样化的监督目标以鼓励更广泛的探索。实验结果表明,SCOPE在各种模型和基准测试中始终优于现有方法,在具有挑战性的AIME 2025和AMC上分别实现了13.1%和8.1%的相对改进。

🔬 方法详解

问题定义:测试时强化学习依赖多数投票结果作为伪标签,但这种方法容易受到确认偏差的影响,并且奖励信号稀疏,导致模型难以有效学习。现有方法无法充分利用模型自身的置信度信息,并且缺乏对探索多样性的有效控制。

核心思路:SCOPE的核心在于利用模型在每一步推理中的置信度来加权伪标签,并动态地将候选输出划分为多个子群,在每个子群内进行局部共识,从而提供更准确、更丰富的奖励信号。通过置信度加权,优先考虑高质量的推理路径;通过子群划分,鼓励模型探索更多样化的策略。

技术框架:SCOPE框架主要包含两个关键模块:步进置信度加权伪标签估计和动态子群划分。首先,对每个推理步骤的输出赋予置信度权重,并将其融入伪标签的计算中。然后,根据推理质量和探索多样性,将候选输出池动态划分为多个独立的子群。最后,在每个子群内进行重复采样,以获得局部共识,作为最终的监督目标。

关键创新:SCOPE的关键创新在于将模型置信度与动态子群划分相结合,从而克服了传统多数投票策略的局限性。与现有方法相比,SCOPE能够更准确地估计伪标签,并提供更丰富的奖励信号,从而促进更有效的学习。

关键设计:SCOPE使用步进置信度来衡量每个推理步骤的质量,并将其作为权重应用于伪标签的计算。子群划分的标准是平衡推理质量和探索多样性,具体实现方式未知(论文未明确说明)。损失函数的设计目标是最大化与局部共识的相似度,具体形式未知(论文未明确说明)。

🖼️ 关键图片

📊 实验亮点

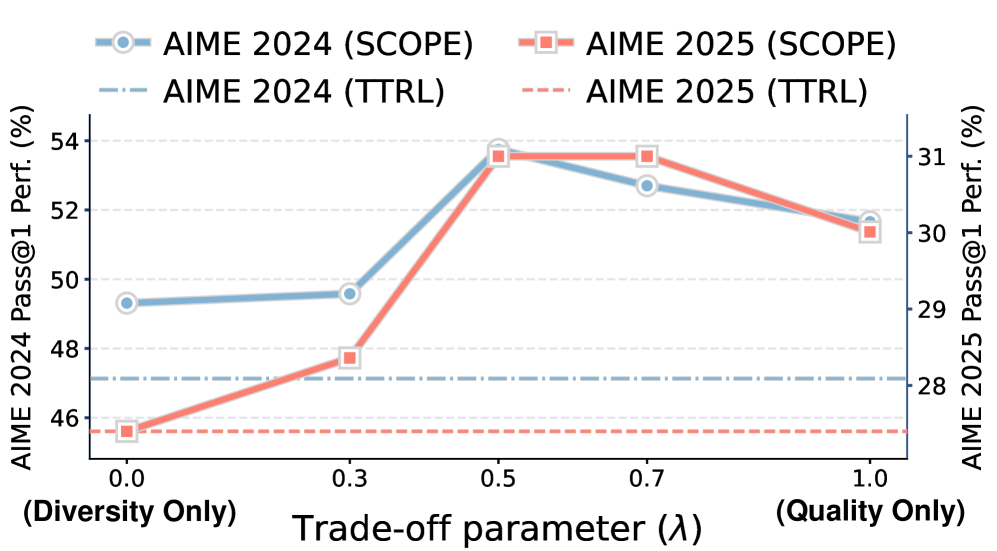

SCOPE在AIME 2025和AMC等具有挑战性的基准测试中取得了显著的性能提升。具体而言,SCOPE在AIME 2025上实现了13.1%的相对改进,在AMC上实现了8.1%的相对改进,表明该方法能够有效提升LLM的推理能力。

🎯 应用场景

SCOPE框架可应用于各种需要利用大型语言模型进行推理的任务,例如问答、数学问题求解、代码生成等。该方法通过提升测试时强化学习的效果,降低了对标注数据的依赖,从而可以更高效地训练和部署LLM,具有广泛的应用前景。

📄 摘要(原文)

Test-time reinforcement learning mitigates the reliance on annotated data by using majority voting results as pseudo-labels, emerging as a complementary direction to reinforcement learning with verifiable rewards (RLVR) for improving reasoning ability of large language models (LLMs). However, this voting strategy often induces confirmation bias and suffers from sparse rewards, limiting the overall performance. In this work, we propose subgroup-specific step-wise confidence-weighted pseudo-label estimation (SCOPE), a framework integrating model confidence and dynamic subgroup partitioning to address these issues. Specifically, SCOPE integrates the proposed step-wise confidence into pseudo label deduction, prioritizing high-quality reasoning paths over simple frequency count. Furthermore, it dynamically partitions the candidate outputs pool into independent subgroups by balancing reasoning quality against exploration diversity. By deriving local consensus via repeat sampling for each sub group, SCOPE provides diverse supervision targets to encourage broader exploration. We conduct experiments across various models and benchmarks, experimental results show that SCOPE consistently outperforms recent baselines. Notably, SCOPE achieving relative improvements of 13.1% on challenging AIME 2025 and 8.1% on AMC. The code is released at https://github.com/szu-tera/SCOPE.