ReFusion: A Diffusion Large Language Model with Parallel Autoregressive Decoding

作者: Jia-Nan Li, Jian Guan, Wei Wu, Chongxuan Li

分类: cs.CL, cs.AI, cs.LG

发布日期: 2025-12-15

💡 一句话要点

ReFusion:一种具有并行自回归解码的扩散大语言模型,提升效率与性能。

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 扩散模型 大语言模型 并行解码 自回归模型 文本生成 Key-Value缓存 Slot级别解码

📋 核心要点

- 自回归模型推理速度慢,掩码扩散模型虽然并行但计算开销大且生成质量差。

- ReFusion通过slot级别的并行解码,结合扩散模型的规划能力和自回归模型的填充能力,提升效率。

- 实验表明,ReFusion在性能和速度上均优于现有掩码扩散模型,并缩小了与自回归模型的差距。

📝 摘要(中文)

自回归模型(ARMs)受到缓慢的顺序推理的限制。虽然掩码扩散模型(MDMs)提供了一种并行的替代方案,但它们存在严重的缺点:由于排除了键值(KV)缓存而导致的高计算开销,以及由于在难以处理的token组合空间上学习依赖关系而产生的不连贯生成。为了解决这些限制,我们引入了ReFusion,这是一种新颖的掩码扩散模型,通过将并行解码从token级别提升到更高的slot级别来实现卓越的性能和效率,其中每个slot都是固定长度的连续子序列。这是通过迭代的“计划和填充”解码过程实现的:基于扩散的规划步骤首先识别一组弱相关的slot,然后自回归填充步骤并行解码这些选定的slot。基于slot的设计同时通过统一的因果框架解锁了完整的KV缓存重用,并将学习复杂度从token组合空间降低到可管理的slot级别排列空间。在七个不同的基准测试上的大量实验表明,ReFusion不仅以34%的性能提升和平均超过18倍的加速大大超过了先前的MDM,而且在保持平均2.33倍加速的同时,弥合了与强大的ARM的性能差距。

🔬 方法详解

问题定义:现有自回归模型(ARMs)推理速度慢,难以满足实时性要求。掩码扩散模型(MDMs)虽然支持并行解码,但由于无法有效利用Key-Value (KV) 缓存,计算开销巨大,并且在token组合空间学习依赖关系导致生成文本不连贯。因此,需要一种既能并行解码又能保证生成质量的模型。

核心思路:ReFusion的核心思路是将并行解码的粒度从token级别提升到slot级别。Slot是固定长度的连续token子序列。通过先规划哪些slot需要填充,再并行地自回归填充这些slot,从而在保证并行性的同时,降低学习复杂度,并充分利用KV缓存。

技术框架:ReFusion包含两个主要阶段:规划阶段和填充阶段。在规划阶段,使用扩散模型预测哪些slot需要被填充。在填充阶段,使用自回归模型并行地填充这些slot。整个过程迭代进行,直到生成完整的文本序列。模型整体采用encoder-decoder架构,encoder负责提取输入文本的特征,decoder负责生成文本。

关键创新:ReFusion的关键创新在于slot级别的并行解码策略。与token级别的并行解码相比,slot级别的解码降低了学习复杂度,使得模型更容易学习token之间的依赖关系。同时,slot级别的解码允许模型充分利用KV缓存,从而降低计算开销。此外,ReFusion采用扩散模型进行规划,使得模型能够更好地把握全局信息,从而生成更连贯的文本。

关键设计:ReFusion的关键设计包括:1) Slot的长度选择:需要根据具体任务进行调整,过短会导致学习复杂度增加,过长会降低并行性。2) 扩散模型的噪声schedule:需要仔细设计,以保证规划的准确性。3) 自回归模型的训练方式:采用标准的自回归训练方式,并加入slot级别的mask,以保证并行解码的正确性。

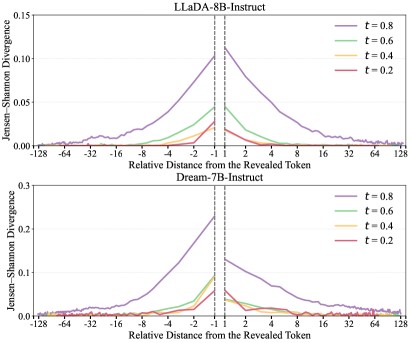

🖼️ 关键图片

📊 实验亮点

ReFusion在七个不同的基准测试上取得了显著的成果。与之前的掩码扩散模型相比,ReFusion在性能上平均提升了34%,速度上平均提升了18倍以上。此外,ReFusion在保持平均2.33倍加速的同时,弥合了与强大的自回归模型的性能差距。这些结果表明,ReFusion是一种高效且高质量的文本生成模型。

🎯 应用场景

ReFusion具有广泛的应用前景,例如机器翻译、文本摘要、代码生成等。其并行解码的特性使其能够应用于对实时性要求较高的场景。此外,ReFusion还可以作为一种新的文本生成范式,为未来的研究提供新的思路。

📄 摘要(原文)

Autoregressive models (ARMs) are hindered by slow sequential inference. While masked diffusion models (MDMs) offer a parallel alternative, they suffer from critical drawbacks: high computational overhead from precluding Key-Value (KV) caching, and incoherent generation arising from learning dependencies over an intractable space of token combinations. To address these limitations, we introduce ReFusion, a novel masked diffusion model that achieves superior performance and efficiency by elevating parallel decoding from the token level to a higher slot level, where each slot is a fixed-length, contiguous sub-sequence. This is achieved through an iterative ``plan-and-infill'' decoding process: a diffusion-based planning step first identifies a set of weakly dependent slots, and an autoregressive infilling step then decodes these selected slots in parallel. The slot-based design simultaneously unlocks full KV cache reuse with a unified causal framework and reduces the learning complexity from the token combination space to a manageable slot-level permutation space. Extensive experiments on seven diverse benchmarks show that ReFusion not only overwhelmingly surpasses prior MDMs with 34% performance gains and an over 18$\times$ speedup on average, but also bridges the performance gap to strong ARMs while maintaining a 2.33$\times$ average speedup.