AutoTool: Dynamic Tool Selection and Integration for Agentic Reasoning

作者: Jiaru Zou, Ling Yang, Yunzhe Qi, Sirui Chen, Mengting Ai, Ke Shen, Jingrui He, Mengdi Wang

分类: cs.CL, cs.LG

发布日期: 2025-12-15

备注: Best Paper Award at ICCV 2025 Workshop on Multi-Modal Reasoning for Agentic Intelligence

💡 一句话要点

AutoTool:面向Agentic推理的动态工具选择与集成框架

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Agentic推理 动态工具选择 大型语言模型 强化学习 多模态理解 代码生成 工具集成

📋 核心要点

- 现有方法依赖固定的工具集,限制了LLM Agent对新工具或演进工具集的适应性,无法充分发挥LLM的潜力。

- AutoTool框架通过动态工具选择,使LLM Agent能够根据推理过程中的需求灵活选择和集成工具,提升解决复杂问题的能力。

- 实验表明,AutoTool在多个任务上显著优于现有方法,并在利用未见过的工具时表现出更强的泛化能力。

📝 摘要(中文)

本文提出AutoTool框架,旨在赋予LLM Agent在推理过程中动态选择工具的能力,从而提升其适应性和泛化性。首先,构建了一个包含20万条数据的数据集,其中涵盖1000+工具和100+任务,覆盖数学、科学、代码生成和多模态推理等领域,并显式标注了工具选择的理由。在此基础上,AutoTool采用双阶段优化流程:(1) 基于监督学习和强化学习的轨迹稳定化,以保证推理的连贯性;(2) 基于KL正则化的Plackett-Luce排序,以优化多步工具选择的一致性。实验结果表明,AutoTool在十个不同的基准测试中,优于现有的LLM Agent和工具集成方法,在数学和科学推理、基于搜索的问答、代码生成和多模态理解方面分别取得了6.4%、4.5%、7.7%和6.9%的平均增益。此外,AutoTool还展现出更强的泛化能力,能够在推理过程中动态利用来自不断演进的工具集中未见过的工具。

🔬 方法详解

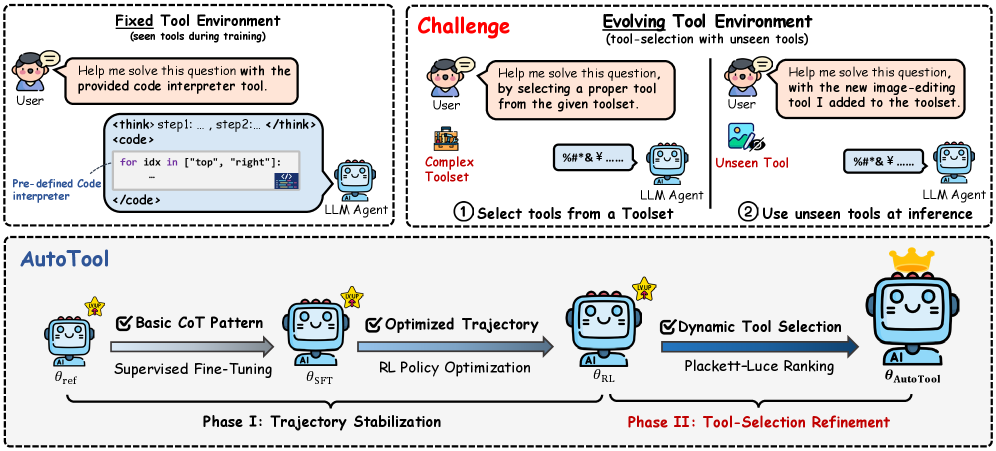

问题定义:现有Agentic推理方法通常依赖于预定义的、固定的工具集。这种静态的工具选择方式无法适应不断变化的工具环境,限制了LLM Agent解决复杂问题的能力。当面对新的任务或工具时,Agent无法动态地选择和集成合适的工具,导致性能下降甚至失效。

核心思路:AutoTool的核心思路是赋予LLM Agent动态选择工具的能力。Agent在推理的每一步都可以根据当前的状态和目标,从一个庞大的工具集中选择最合适的工具。通过这种动态选择机制,Agent可以更好地适应不同的任务和工具环境,提高解决问题的效率和准确性。

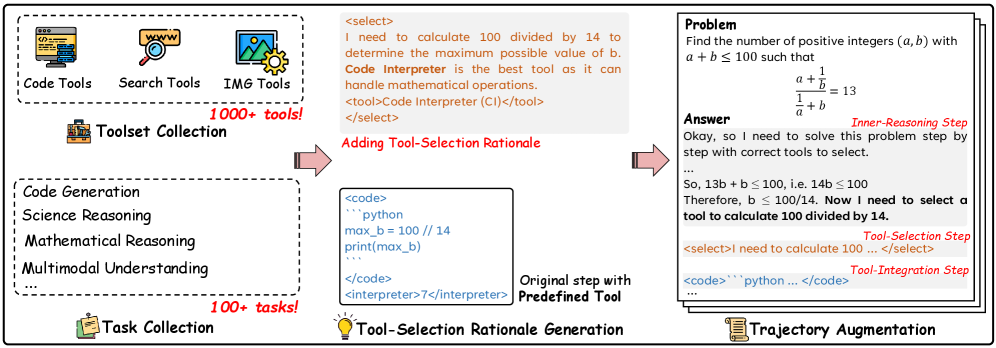

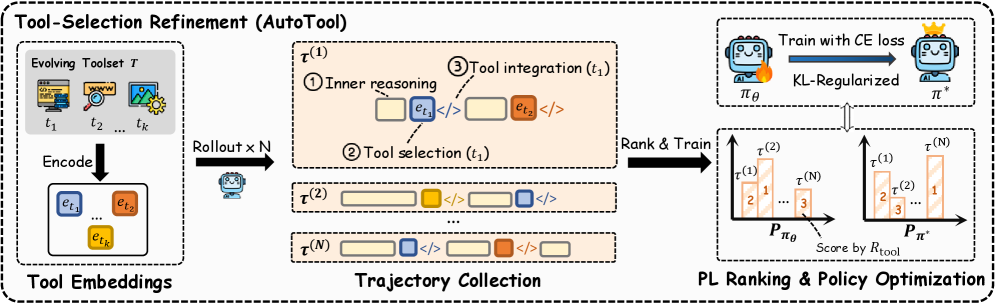

技术框架:AutoTool框架包含两个主要阶段:数据构建和模型训练。首先,构建一个大规模数据集,其中包含各种任务和工具,并标注了工具选择的理由。然后,采用双阶段优化流程训练模型:(1) 轨迹稳定化阶段,使用监督学习和强化学习来保证推理轨迹的连贯性;(2) 工具选择优化阶段,使用KL正则化的Plackett-Luce排序来优化多步工具选择的一致性。

关键创新:AutoTool的关键创新在于动态工具选择机制和双阶段优化流程。动态工具选择机制允许Agent在推理过程中灵活选择工具,而双阶段优化流程则保证了推理的连贯性和工具选择的一致性。与现有方法相比,AutoTool能够更好地适应不同的任务和工具环境,提高解决问题的效率和准确性。

关键设计:在数据构建方面,论文构建了一个包含20万条数据的数据集,涵盖1000+工具和100+任务。在模型训练方面,轨迹稳定化阶段使用了监督学习和强化学习,工具选择优化阶段使用了KL正则化的Plackett-Luce排序。KL正则化用于约束工具选择的分布,避免模型过度自信,Plackett-Luce排序则用于学习工具的相对排序,从而提高选择的准确性。

🖼️ 关键图片

📊 实验亮点

AutoTool在十个不同的基准测试中,优于现有的LLM Agent和工具集成方法。具体来说,在数学和科学推理方面取得了6.4%的平均增益,在基于搜索的问答方面取得了4.5%的平均增益,在代码生成方面取得了7.7%的平均增益,在多模态理解方面取得了6.9%的平均增益。此外,AutoTool还展现出更强的泛化能力,能够在推理过程中动态利用来自不断演进的工具集中未见过的工具。

🎯 应用场景

AutoTool具有广泛的应用前景,可应用于智能助手、自动化编程、科学研究等领域。例如,在智能助手中,AutoTool可以帮助Agent动态选择合适的工具来完成用户的各种请求。在自动化编程中,AutoTool可以帮助Agent自动选择合适的代码库和API来生成代码。在科学研究中,AutoTool可以帮助Agent自动选择合适的模拟器和分析工具来进行实验。

📄 摘要(原文)

Agentic reinforcement learning has advanced large language models (LLMs) to reason through long chain-of-thought trajectories while interleaving external tool use. Existing approaches assume a fixed inventory of tools, limiting LLM agents' adaptability to new or evolving toolsets. We present AutoTool, a framework that equips LLM agents with dynamic tool-selection capabilities throughout their reasoning trajectories. We first construct a 200k dataset with explicit tool-selection rationales across 1,000+ tools and 100+ tasks spanning mathematics, science, code generation, and multimodal reasoning. Building on this data foundation, AutoTool employs a dual-phase optimization pipeline: (i) supervised and RL-based trajectory stabilization for coherent reasoning, and (ii) KL-regularized Plackett-Luce ranking to refine consistent multi-step tool selection. Across ten diverse benchmarks, we train two base models, Qwen3-8B and Qwen2.5-VL-7B, with AutoTool. With fewer parameters, AutoTool consistently outperforms advanced LLM agents and tool-integration methods, yielding average gains of 6.4% in math & science reasoning, 4.5% in search-based QA, 7.7% in code generation, and 6.9% in multimodal understanding. In addition, AutoTool exhibits stronger generalization by dynamically leveraging unseen tools from evolving toolsets during inference.