The American Ghost in the Machine: How language models align culturally and the effects of cultural prompting

作者: James Luther, Donald Brown

分类: cs.CL

发布日期: 2025-12-13

💡 一句话要点

研究揭示大型语言模型文化倾向,并通过文化提示实现文化对齐。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 文化对齐 文化提示 人机交互 跨文化交流

📋 核心要点

- 大型语言模型在人机交互中扮演重要角色,但其文化倾向可能影响交互效果,现有研究对此关注不足。

- 该研究通过文化提示,探索了调整LLM文化倾向的方法,旨在提升模型对不同文化的适应性。

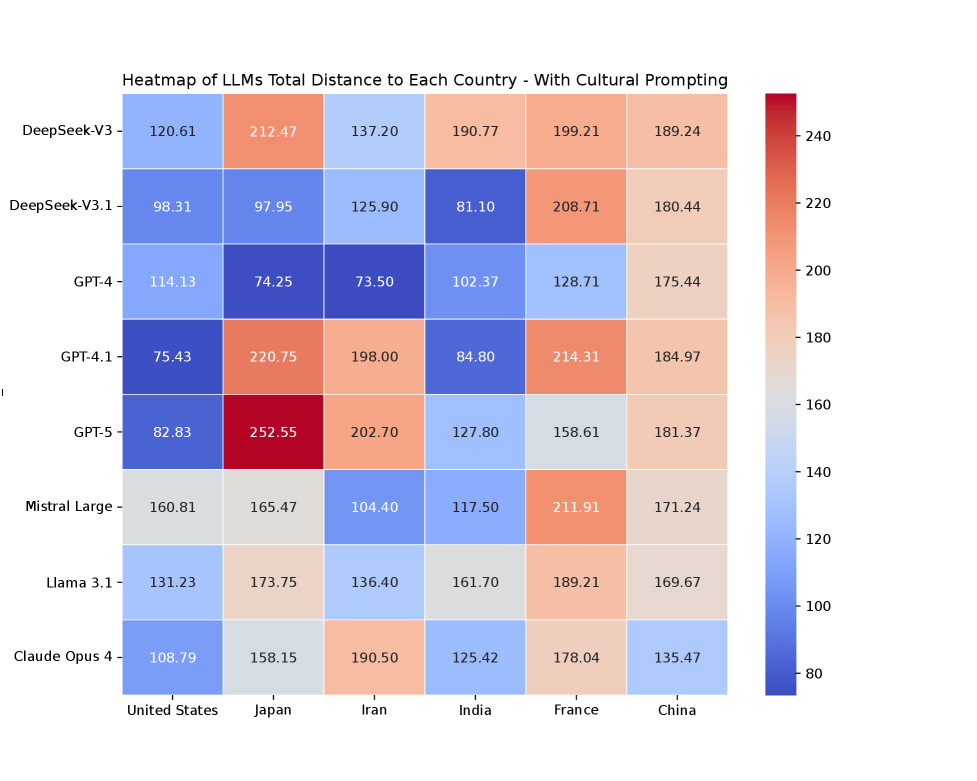

- 实验表明,多数LLM默认倾向于美国文化,通过文化提示可以使其向目标文化靠拢,但对某些文化适应性较差。

📝 摘要(中文)

文化是人类互动的基础,它决定了我们如何感知和回应日常互动。随着生成式大型语言模型(LLM)的兴起,人机交互领域日益发展,这些模型的文化对齐成为一个重要的研究领域。本研究利用VSM13国际调查和霍夫斯泰德文化维度,识别了流行LLM(DeepSeek-V3、V3.1、GPT-5、GPT-4.1、GPT-4、Claude Opus 4、Llama 3.1和Mistral Large)的文化倾向。然后,我们使用文化提示,即使用系统提示将模型的文化倾向转移到期望的国家,来测试这些模型对其他文化的适应性,包括中国、法国、印度、伊朗、日本和美国。我们发现,在未指定文化的情况下,大多数被测试的LLM倾向于美国文化,而在提示其他文化时,结果各不相同。在使用文化提示时,八个模型中有七个更接近预期的文化。我们发现,尽管测试的两个模型来自中国公司DeepSeek,但这些模型在与日本和中国文化对齐方面存在困难。

🔬 方法详解

问题定义:该论文旨在解决大型语言模型(LLM)在文化上的不对齐问题。现有LLM在生成内容时,往往带有隐含的文化倾向,这可能会导致在跨文化交流中产生误解或冒犯。现有方法缺乏有效手段来调整LLM的文化倾向,使其更好地适应不同的文化背景。

核心思路:该论文的核心思路是通过“文化提示”(Cultural Prompting)来引导LLM的文化倾向。具体来说,通过在系统提示中加入特定文化的描述或指令,来影响LLM的输出,使其更符合目标文化的价值观和行为规范。这种方法类似于情境学习,但更侧重于文化维度的控制。

技术框架:该研究的技术框架主要包括以下几个步骤:1) 选择代表性的LLM模型;2) 利用VSM13国际调查和霍夫斯泰德文化维度来定义不同文化的特征;3) 设计文化提示,包括针对不同文化的描述性文本;4) 使用文化提示来引导LLM生成内容;5) 评估LLM生成内容的文化倾向,并与预期结果进行比较。

关键创新:该论文的关键创新在于提出了“文化提示”这一概念,并将其应用于LLM的文化对齐。与传统的微调方法相比,文化提示更加灵活和高效,无需重新训练模型即可实现文化倾向的调整。此外,该研究还系统地评估了不同LLM对文化提示的响应程度,为后续研究提供了参考。

关键设计:文化提示的设计是关键。研究人员需要根据目标文化的特征,精心设计提示文本,使其能够有效地引导LLM的生成行为。此外,评估LLM生成内容的文化倾向也是一个挑战。研究人员可以采用人工评估或自动评估方法,但需要确保评估的准确性和可靠性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,大多数被测试的LLM在未指定文化的情况下倾向于美国文化。通过文化提示,七个模型能够向目标文化靠拢,但对日本和中国文化的适应性较差。DeepSeek的模型在对齐日本和中国文化时表现不佳,这一结果值得关注。

🎯 应用场景

该研究成果可应用于跨文化交流、国际市场营销、多语言内容生成等领域。通过调整LLM的文化倾向,可以使其更好地适应不同文化背景的用户,从而提升用户体验和沟通效率。未来,该技术有望应用于智能客服、虚拟助手等场景,实现更加个性化和文化敏感的服务。

📄 摘要(原文)

Culture is the bedrock of human interaction; it dictates how we perceive and respond to everyday interactions. As the field of human-computer interaction grows via the rise of generative Large Language Models (LLMs), the cultural alignment of these models become an important field of study. This work, using the VSM13 International Survey and Hofstede's cultural dimensions, identifies the cultural alignment of popular LLMs (DeepSeek-V3, V3.1, GPT-5, GPT-4.1, GPT-4, Claude Opus 4, Llama 3.1, and Mistral Large). We then use cultural prompting, or using system prompts to shift the cultural alignment of a model to a desired country, to test the adaptability of these models to other cultures, namely China, France, India, Iran, Japan, and the United States. We find that the majority of the eight LLMs tested favor the United States when the culture is not specified, with varying results when prompted for other cultures. When using cultural prompting, seven of the eight models shifted closer to the expected culture. We find that models had trouble aligning with Japan and China, despite two of the models tested originating with the Chinese company DeepSeek.