TeleMem: Building Long-Term and Multimodal Memory for Agentic AI

作者: Chunliang Chen, Ming Guan, Xiao Lin, Jiaxu Li, Luxi Lin, Qiyi Wang, Xiangyu Chen, Jixiang Luo, Changzhi Sun, Dell Zhang, Xuelong Li

分类: cs.CL, cs.AI, cs.CV

发布日期: 2025-12-12 (更新: 2026-01-22)

💡 一句话要点

TeleMem:构建Agentic AI的长期多模态记忆系统,提升交互性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长期记忆 多模态学习 Agentic AI 检索增强生成 ReAct推理

📋 核心要点

- 现有LLM在长期交互中受限,RAG方法虽有改进,但缺乏记忆更新机制,易产生幻觉。

- TeleMem通过叙事动态提取维护用户配置文件,并采用结构化写入管道优化记忆存储。

- TeleMem结合多模态记忆和ReAct推理,提升了在长期上下文中理解复杂视频内容的能力。

📝 摘要(中文)

大型语言模型(LLMs)在许多NLP任务中表现出色,但由于对话历史的注意力限制,难以维持长期交互。检索增强生成(RAG)缓解了这个问题,但缺乏更新或改进存储记忆的可靠机制,导致模式驱动的幻觉、低效的写入操作以及对多模态推理的最小支持。为了解决这些挑战,我们提出了TeleMem,一个统一的长期多模态记忆系统,通过叙事动态提取来维护连贯的用户配置文件,确保只保留基于对话的信息。TeleMem进一步引入了一个结构化的写入管道,对记忆条目进行批处理、检索、聚类和整合,从而显著提高存储效率,减少token使用量,并加速记忆操作。此外,一个多模态记忆模块与ReAct风格的推理相结合,使系统具备闭环的观察、思考和行动过程,从而能够在长期上下文中准确理解复杂的视频内容。实验结果表明,TeleMem超越了最先进的Mem0基线,在ZH-4O长期角色扮演游戏基准测试中,准确率提高了19%,token使用量减少了43%,速度提高了2.1倍。

🔬 方法详解

问题定义:现有的大型语言模型在处理长期对话时,由于上下文窗口的限制,难以记住之前的交互信息,导致对话不连贯或者产生幻觉。检索增强生成(RAG)方法虽然可以通过检索相关信息来缓解这个问题,但是缺乏有效的记忆更新和维护机制,导致存储效率低下,并且难以处理多模态信息。

核心思路:TeleMem的核心思路是构建一个长期且多模态的记忆系统,该系统能够动态地提取和更新用户配置文件,并有效地存储和检索相关信息。通过结构化的写入管道和多模态记忆模块,TeleMem能够提高存储效率,减少token使用量,并支持多模态推理。

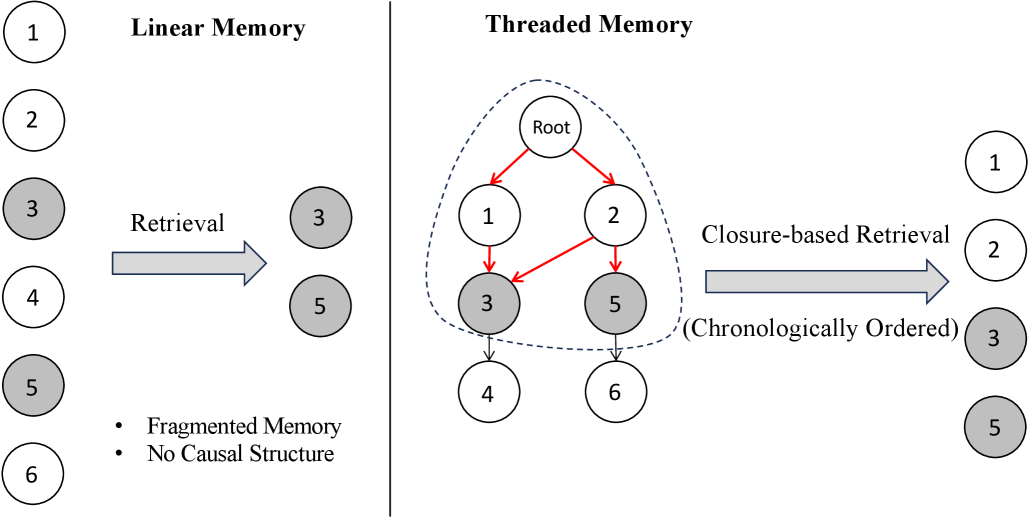

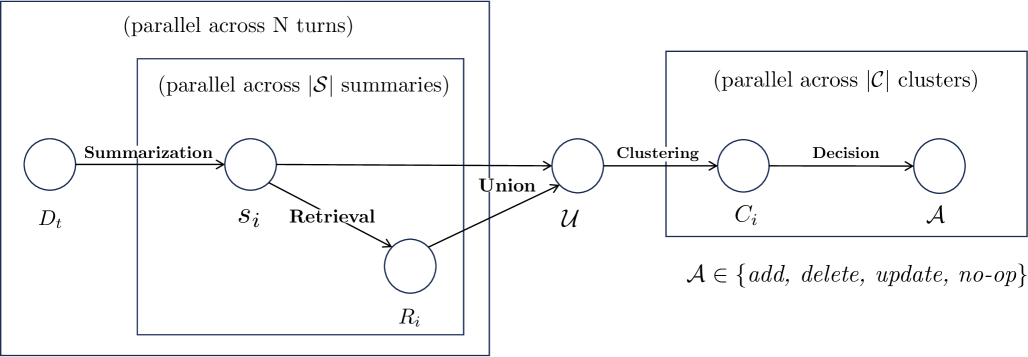

技术框架:TeleMem的整体架构包含以下几个主要模块:1) 叙事动态提取模块,用于从对话中提取关键信息并维护用户配置文件;2) 结构化写入管道,包括批处理、检索、聚类和整合等步骤,用于高效地存储和更新记忆条目;3) 多模态记忆模块,用于存储和检索多模态信息,例如视频内容;4) ReAct风格的推理模块,用于结合记忆信息进行推理和决策。

关键创新:TeleMem的关键创新在于其统一的长期多模态记忆系统,该系统不仅能够有效地存储和检索对话信息,还能够处理多模态数据,并结合ReAct风格的推理进行决策。结构化的写入管道和叙事动态提取模块是提高存储效率和信息准确性的关键。

关键设计:TeleMem的具体技术细节包括:1) 使用特定的算法来提取对话中的关键信息,例如命名实体识别和关系抽取;2) 设计结构化的写入管道,包括批处理大小、检索策略、聚类算法和整合规则等;3) 构建多模态记忆模块,例如使用向量数据库来存储和检索多模态信息;4) 实现ReAct风格的推理模块,包括观察、思考和行动三个步骤。

🖼️ 关键图片

📊 实验亮点

TeleMem在ZH-4O长期角色扮演游戏基准测试中,相较于Mem0基线,准确率提升了19%,token使用量减少了43%,速度提高了2.1倍。这些结果表明TeleMem在长期记忆和多模态推理方面具有显著优势。

🎯 应用场景

TeleMem可应用于智能客服、虚拟助手、游戏AI等领域,提升AI在长期交互中的表现。通过记忆用户偏好和历史行为,AI能够提供更个性化、更连贯的服务,增强用户体验。未来,TeleMem有望推动Agentic AI在复杂环境中的应用,例如智能家居、自动驾驶等。

📄 摘要(原文)

Large language models (LLMs) excel at many NLP tasks but struggle to sustain long-term interactions due to limited attention over extended dialogue histories. Retrieval-augmented generation (RAG) mitigates this issue but lacks reliable mechanisms for updating or refining stored memories, leading to schema-driven hallucinations, inefficient write operations, and minimal support for multimodal reasoning.To address these challenges, we propose TeleMem, a unified long-term and multimodal memory system that maintains coherent user profiles through narrative dynamic extraction, ensuring that only dialogue-grounded information is preserved. TeleMem further introduces a structured writing pipeline that batches, retrieves, clusters, and consolidates memory entries, substantially improving storage efficiency, reducing token usage, and accelerating memory operations. Additionally, a multimodal memory module combined with ReAct-style reasoning equips the system with a closed-loop observe, think, and act process that enables accurate understanding of complex video content in long-term contexts. Experimental results show that TeleMem surpasses the state-of-the-art Mem0 baseline with 19% higher accuracy, 43% fewer tokens, and a 2.1x speedup on the ZH-4O long-term role-play gaming benchmark.