Benchmarking Contextual Understanding for In-Car Conversational Systems

作者: Philipp Habicht, Lev Sorokin, Abdullah Saydemir, Ken E. Friedl, Andrea Stocco

分类: cs.CL

发布日期: 2025-12-12

💡 一句话要点

提出基于LLM的评测框架,用于评估车载对话系统中的上下文理解能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 车载对话系统 上下文理解 大型语言模型 自动化评估 提示工程

📋 核心要点

- 车载对话系统评估面临挑战,现有方法难以准确衡量系统对用户上下文的理解能力。

- 利用大型语言模型和高级提示技术,自动生成测试用例并评估系统响应的上下文一致性。

- 实验表明,推理模型表现优于非推理模型,DeepSeek-R1模型在成本可控的情况下取得了优秀的F1分数。

📝 摘要(中文)

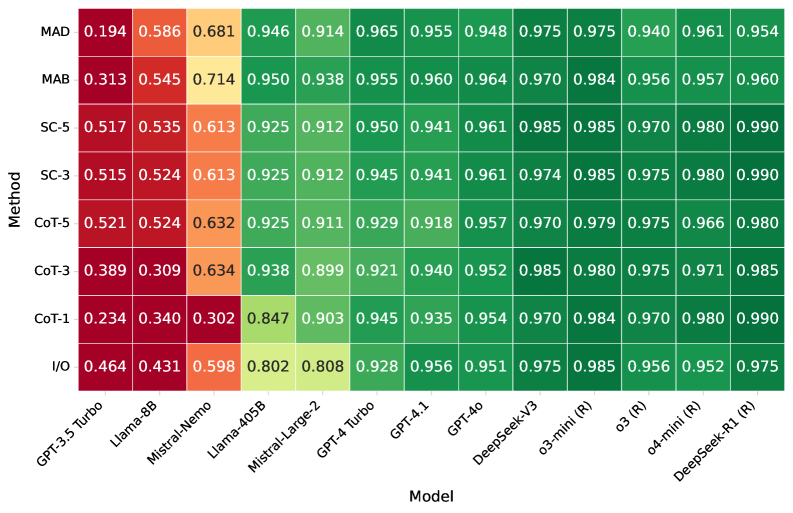

车载对话问答(ConvQA)系统通过无缝的语音交互显著提升用户体验。然而,评估其准确性和可靠性仍然是一个挑战。本文探索了使用大型语言模型(LLM)以及先进的提示技术和基于代理的方法,来评估ConvQA系统响应与用户话语的一致性程度。重点在于上下文理解以及在考虑用户约束和情境上下文的情况下提供准确的场所推荐的能力。为了使用LLM评估话语-响应一致性,我们合成生成用户话语,并伴随正确的和包含修改后的失败的系统响应。我们使用输入-输出、思维链、自洽性提示和多代理提示技术,以及来自OpenAI、DeepSeek、Mistral AI和Meta的13个不同大小和提供商的推理和非推理LLM。我们通过一个涉及餐厅推荐的案例研究来评估我们的方法。当应用高级提示技术,特别是多代理提示时,小型非推理模型的改进最为显著。然而,推理模型始终优于非推理模型,使用具有自洽性的单代理提示可实现最佳性能。值得注意的是,DeepSeek-R1以每个请求0.002美元的成本达到了0.99的F1分数。总的来说,非推理模型DeepSeek-V3在有效性和成本-时间效率之间达到了最佳平衡。我们的研究结果表明,基于LLM的评估为基准测试ConvQA系统中上下文理解提供了一种可扩展且准确的替代传统人工评估的方法。

🔬 方法详解

问题定义:论文旨在解决车载对话问答系统中上下文理解能力的评估问题。现有的人工评估方法成本高昂且难以扩展,缺乏一种高效、自动化的评估方案。因此,需要一种能够准确衡量系统在理解用户意图和上下文信息后,给出合理响应的评估方法。

核心思路:论文的核心思路是利用大型语言模型(LLM)作为评估器,通过设计合适的提示策略,让LLM判断系统响应与用户话语的上下文一致性。这种方法可以模拟人工评估,但具有更高的效率和可扩展性。

技术框架:整体框架包括以下几个主要步骤:1) 合成生成用户话语和系统响应对,其中包含正确响应和错误响应。2) 使用不同的提示技术(如输入-输出、思维链、自洽性、多代理)来引导LLM进行评估。3) 使用不同的LLM(包括推理模型和非推理模型)进行实验。4) 分析LLM的评估结果,并与人工评估进行对比,验证LLM评估的有效性。

关键创新:最重要的创新点在于将LLM应用于车载对话系统的上下文理解评估。通过设计不同的提示策略,可以有效地利用LLM的推理能力,从而实现对系统响应的自动化评估。此外,论文还比较了不同LLM和不同提示策略的性能,为实际应用提供了指导。

关键设计:论文的关键设计包括:1) 用户话语和系统响应的合成生成方法,需要保证数据的多样性和真实性。2) 提示策略的设计,不同的提示策略会影响LLM的评估效果。3) 评估指标的选择,如F1分数,用于衡量LLM评估的准确性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用自洽性提示的单代理LLM表现最佳,DeepSeek-R1模型达到了0.99的F1分数,但成本较高。综合考虑性能和成本,DeepSeek-V3模型在有效性和成本-时间效率之间取得了最佳平衡。此外,高级提示技术对小型非推理模型的提升效果显著,特别是多代理提示。

🎯 应用场景

该研究成果可应用于车载对话系统的开发和测试阶段,帮助开发者快速评估和改进系统的上下文理解能力。此外,该方法还可以推广到其他类型的对话系统,例如智能客服、虚拟助手等,具有广泛的应用前景和实际价值。未来,可以进一步研究如何利用LLM生成更复杂的测试用例,以及如何将LLM评估与系统的训练过程相结合,实现端到端的优化。

📄 摘要(原文)

In-Car Conversational Question Answering (ConvQA) systems significantly enhance user experience by enabling seamless voice interactions. However, assessing their accuracy and reliability remains a challenge. This paper explores the use of Large Language Models (LLMs) alongside advanced prompting techniques and agent-based methods to evaluate the extent to which ConvQA system responses adhere to user utterances. The focus lies on contextual understanding and the ability to provide accurate venue recommendations considering user constraints and situational context. To evaluate utterance-response coherence using an LLM, we synthetically generate user utterances accompanied by correct and modified failure-containing system responses. We use input-output, chain-of-thought, self-consistency prompting, and multi-agent prompting techniques with 13 reasoning and non-reasoning LLMs of varying sizes and providers, including OpenAI, DeepSeek, Mistral AI, and Meta. We evaluate our approach on a case study involving restaurant recommendations. The most substantial improvements occur for small non-reasoning models when applying advanced prompting techniques, particularly multi-agent prompting. However, reasoning models consistently outperform non-reasoning models, with the best performance achieved using single-agent prompting with self-consistency. Notably, DeepSeek-R1 reaches an F1-score of 0.99 at a cost of 0.002 USD per request. Overall, the best balance between effectiveness and cost-time efficiency is reached with the non-reasoning model DeepSeek-V3. Our findings show that LLM-based evaluation offers a scalable and accurate alternative to traditional human evaluation for benchmarking contextual understanding in ConvQA systems.