Does Less Hallucination Mean Less Creativity? An Empirical Investigation in LLMs

作者: Mohor Banerjee, Nadya Yuki Wangsajaya, Syed Ali Redha Alsagoff, Min Sen Tan, Zachary Choy Kit Chun, Alvin Chan Guo Wei

分类: cs.CL, cs.AI

发布日期: 2025-12-12 (更新: 2026-01-21)

备注: Accepted at the AAAI 2026 Workshop on AI for Scientific Research (AI4Research)

💡 一句话要点

研究表明,降低LLM幻觉的方法对创造力有不同影响,为科学应用提供指导

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 幻觉 创造力 验证链 分层对比解码 检索增强生成 科学发现 发散性思维

📋 核心要点

- 大型语言模型虽然强大,但存在生成不实信息的“幻觉”问题,如何降低幻觉且不损害创造力是一个挑战。

- 该研究考察了三种降低幻觉的技术(CoVe、DoLa、RAG)对LLM创造力的影响,旨在找到平衡事实准确性和创造性探索的方法。

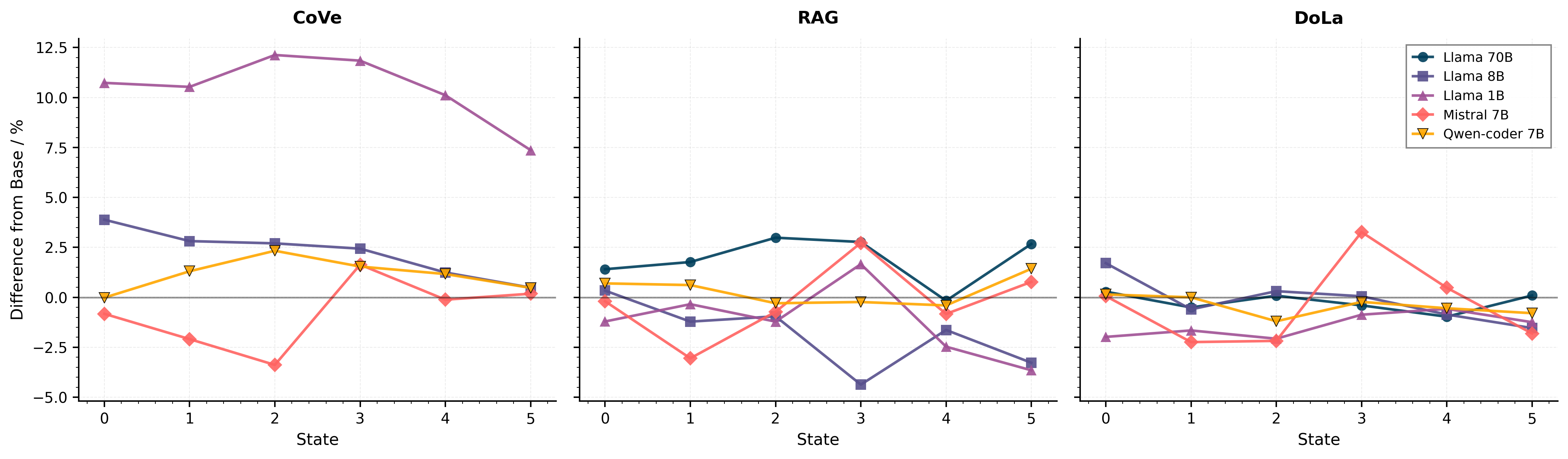

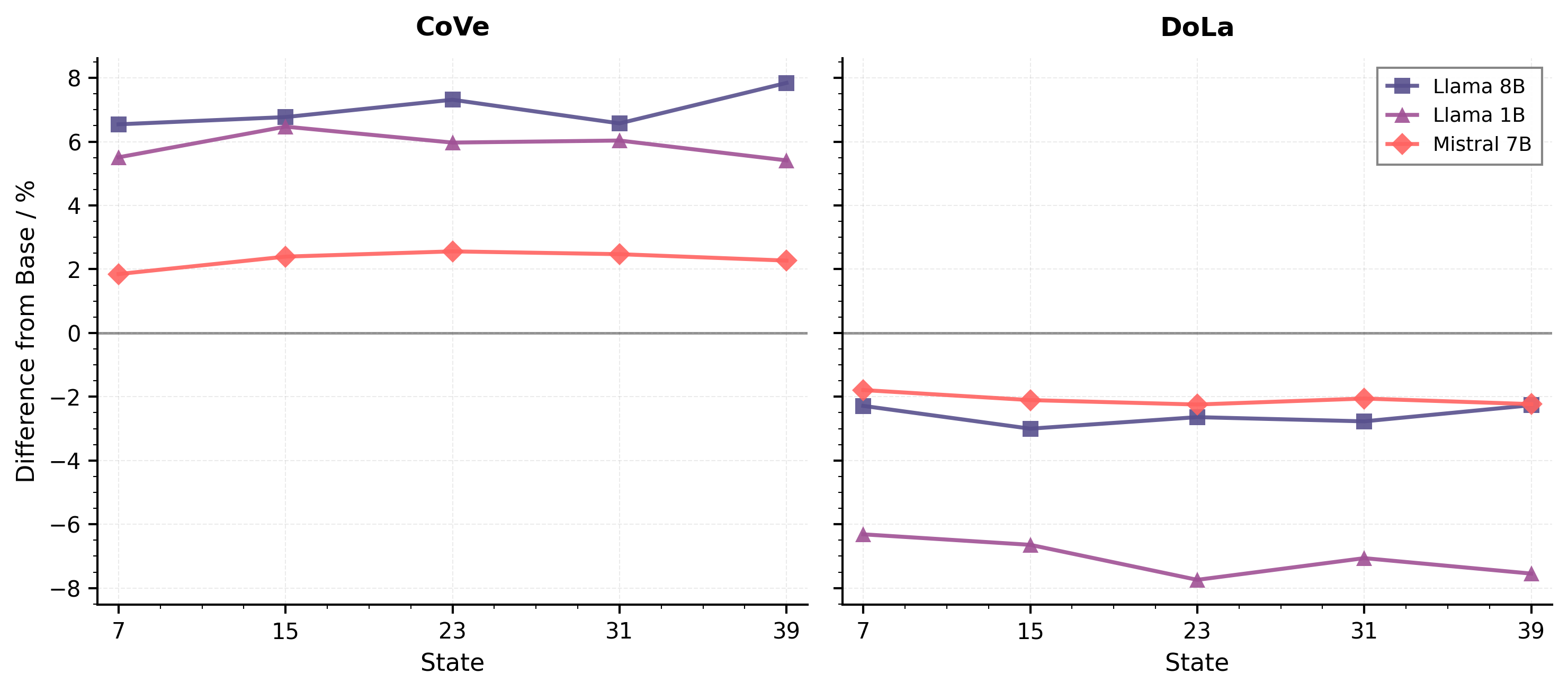

- 实验结果表明,CoVe能增强发散性思维,DoLa会抑制,RAG影响较小,为科学应用选择方法提供指导。

📝 摘要(中文)

大型语言模型(LLMs)在自然语言理解和推理方面表现出卓越的能力,但存在幻觉问题,即生成不符合事实的内容。虽然已经开发了许多减少幻觉的方法,但它们对创造性生成的影响仍未被探索。这一差距对于人工智能辅助的科学发现至关重要,科学发现既需要事实准确性,也需要创造性的假设生成。我们研究了三种减少幻觉的技术:验证链(CoVe)、分层对比解码(DoLa)和检索增强生成(RAG)如何影响LLM的创造力。通过在多个模型系列(LLaMA、Qwen、Mistral)的不同规模(1B - 70B参数)上,使用两个创造力基准(NeoCoder和CS4)进行评估,我们发现这些方法对发散性创造力有相反的影响。CoVe增强了发散性思维,DoLa抑制了它,而RAG的影响最小。我们的发现为在科学应用中选择合适的幻觉减少方法提供了指导,在这些应用中,事实准确性和创造性探索之间的平衡至关重要。

🔬 方法详解

问题定义:大型语言模型(LLMs)在生成文本时,经常会产生与事实不符的内容,即“幻觉”。虽然已经有很多方法致力于减少LLM的幻觉,但是这些方法对LLM创造力的影响尚不明确。尤其是在AI辅助科学发现等领域,既需要模型输出准确的事实,也需要模型具备创造性地提出假设的能力。因此,如何降低幻觉的同时,尽可能保持甚至提升LLM的创造力是一个重要的问题。

核心思路:该研究的核心思路是实证分析三种不同的幻觉减少技术(CoVe、DoLa和RAG)对LLM创造力的影响。通过在不同的模型和数据集上进行实验,观察这些技术如何影响LLM的发散性思维能力。研究假设不同的幻觉减少技术可能以不同的方式影响创造力,某些技术可能更适合需要创造性输出的特定应用场景。

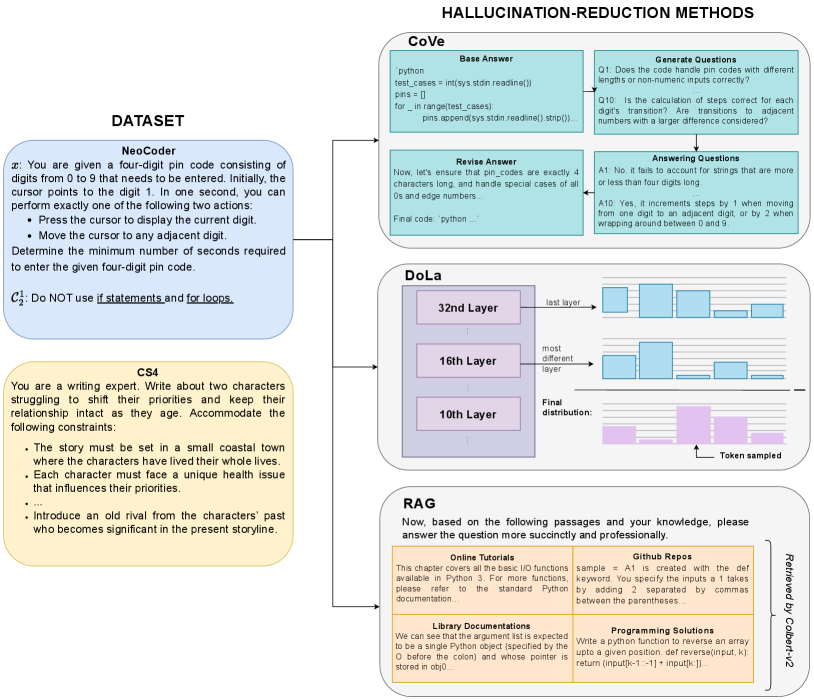

技术框架:该研究的技术框架主要包括以下几个部分:1) 选择三种具有代表性的幻觉减少技术:CoVe、DoLa和RAG。2) 选择多个不同规模和架构的LLM模型,包括LLaMA、Qwen和Mistral等。3) 使用两个创造力基准数据集(NeoCoder和CS4)来评估LLM的创造力。4) 对比应用不同幻觉减少技术后,LLM在创造力基准上的表现,分析其对发散性思维的影响。

关键创新:该研究的关键创新在于首次系统性地研究了幻觉减少技术对LLM创造力的影响。之前的研究主要集中在如何减少幻觉本身,而忽略了对创造力的潜在影响。该研究揭示了不同幻觉减少技术对创造力的不同影响,为在实际应用中选择合适的技术提供了重要的参考依据。

关键设计:研究中关键的设计包括:1) 选择了具有代表性的幻觉减少技术,CoVe侧重于验证生成过程,DoLa侧重于对比不同层的输出,RAG侧重于从外部知识库检索信息。2) 选择了多个不同规模和架构的LLM模型,以确保研究结果的泛化性。3) 使用了两个不同的创造力基准数据集,以从不同角度评估LLM的创造力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,三种幻觉减少技术对LLM的创造力有不同的影响:CoVe能够增强发散性思维,DoLa会抑制发散性思维,而RAG的影响相对较小。这些发现为在实际应用中选择合适的幻觉减少技术提供了重要的指导,尤其是在需要平衡事实准确性和创造性探索的场景下。

🎯 应用场景

该研究成果可应用于AI辅助科学发现、创意写作、产品设计等领域。通过选择合适的幻觉减少技术,可以在保证事实准确性的前提下,最大限度地发挥LLM的创造力,从而加速科学研究进程,提升创意产品的质量,并为各行各业带来创新性的解决方案。未来的研究可以进一步探索如何设计更有效的幻觉减少技术,使其在不牺牲创造力的前提下,更好地保证LLM生成内容的准确性。

📄 摘要(原文)

Large Language Models (LLMs) exhibit remarkable capabilities in natural language understanding and reasoning, but suffer from hallucination: the generation of factually incorrect content. While numerous methods have been developed to reduce hallucinations, their impact on creative generations remains unexplored. This gap is particularly critical for AI-assisted scientific discovery, which requires both factual accuracy and creative hypothesis generation. We investigate how three hallucination-reduction techniques: Chain of Verification (CoVe), Decoding by Contrasting Layers (DoLa), and Retrieval-Augmented Generation (RAG), affect creativity in LLMs. Evaluating multiple model families (LLaMA, Qwen, Mistral) at varying scales (1B - 70B parameters) on two creativity benchmarks (NeoCoder and CS4), we find that these methods have opposing effects on divergent creativity. CoVe enhances divergent thinking, DoLa suppresses it, and RAG shows minimal impact. Our findings provide guidance for selecting appropriate hallucination-reduction methods in scientific applications, where the balance between factual accuracy and creative exploration is crucial.