Mistake Notebook Learning: Batch-Clustered Failures for Training-Free Agent Adaptation

作者: Xuanbo Su, Yingfang Zhang, Hao Luo, Xiaoteng Liu, Leo Huang

分类: cs.CL

发布日期: 2025-12-12 (更新: 2026-01-16)

🔗 代码/项目: GITHUB

💡 一句话要点

提出Mistake Notebook Learning以解决LLM代理自我学习不足问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 自我学习 错误模式提炼 记忆机制 任务适应性 智能代理 批量聚类

📋 核心要点

- 现有方法主要存储原始实例级经验,无法有效学习和适应代理在任务中遇到的失败。

- 本文提出的MNL框架通过批量聚类失败,帮助代理自我整理出可推广的错误模式,提升学习能力。

- 实验结果显示,MNL在多个基准测试中表现优异,相比现有记忆机制和上下文方法在效果和效率上均有显著提升。

📝 摘要(中文)

随着大型语言模型(LLM)代理在实际应用中的广泛采用,它们不可避免地会遇到持续的任务流和失败。然而,现有方法无法系统性地从这些错误中学习,导致在相似情境中重复相同的错误。为此,本文提出了一种新颖的记忆框架——Mistake Notebook Learning(MNL),使代理能够从批量聚类的失败中自我整理出可推广的指导。该机制允许代理将共享的错误模式提炼为结构化的“错误笔记”,并仅在批量性能改善时更新外部记忆,以确保稳定性。通过与测试时缩放相结合,MNL能够利用聚合的失败模式主动引导搜索过程,避免已知的陷阱。实验结果表明,MNL在数学推理、文本到SQL和交互代理基准测试中表现出色,具有竞争力的效果和效率。

🔬 方法详解

问题定义:本文旨在解决大型语言模型代理在面对持续任务流时无法有效学习和适应失败的问题。现有方法往往仅依赖于存储原始经验,缺乏系统性学习机制,导致代理在相似情境中重复错误。

核心思路:MNL通过批量聚类失败,提炼出共享的错误模式,并将其整理为结构化的“错误笔记”,从而为代理提供可推广的学习指导。这种设计旨在增强代理的自我学习能力,减少重复错误的发生。

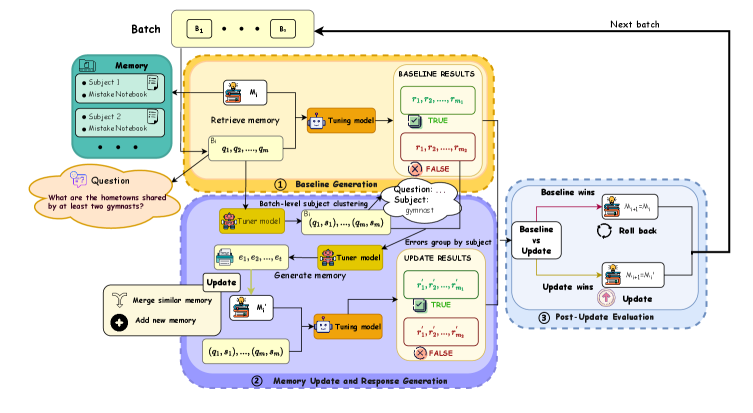

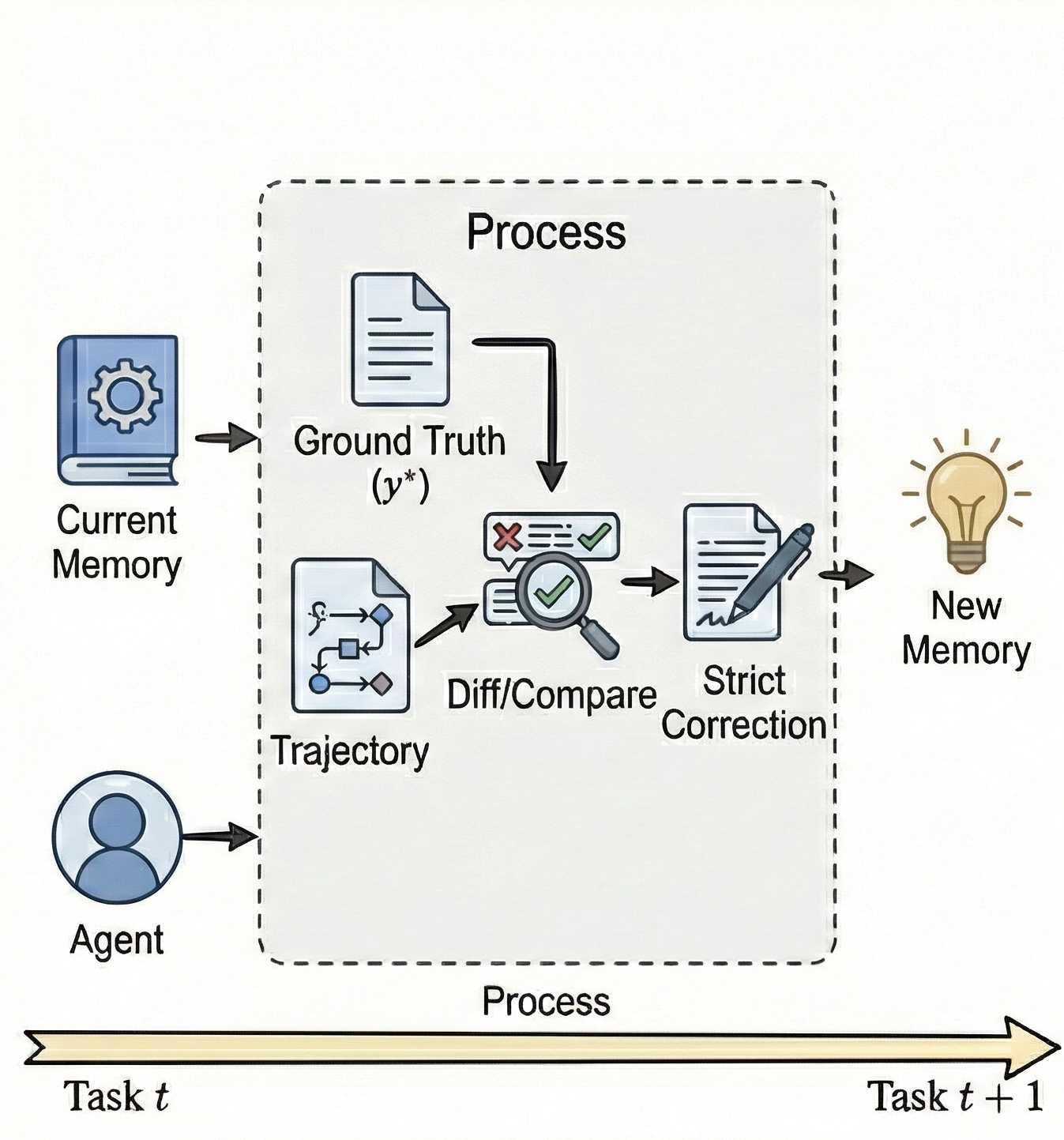

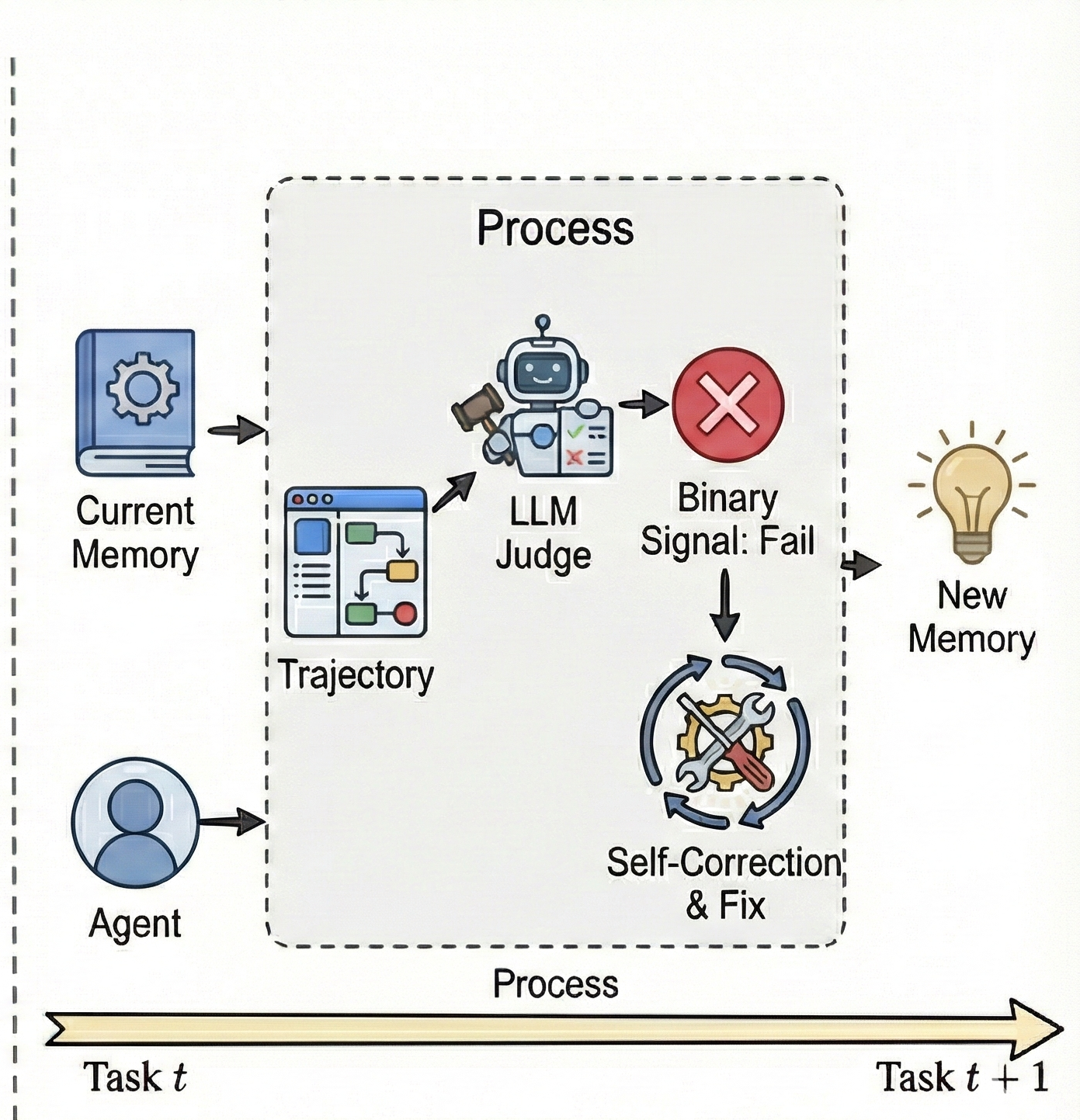

技术框架:MNL的整体架构包括两个主要模块:错误模式提取模块和外部记忆更新模块。错误模式提取模块负责从批量失败中识别和提炼共享错误,而外部记忆更新模块则在性能改善时更新记忆,以确保学习的稳定性。

关键创新:MNL的核心创新在于其批量聚类失败的自我整理机制,与现有方法相比,它不仅存储成功轨迹,还能有效提炼错误模式,形成结构化的学习指导。

关键设计:在设计上,MNL采用了动态更新的外部记忆机制,只有在批量性能提升时才进行更新。此外,结合测试时缩放策略,MNL能够更有效地引导代理避开已知的错误模式。具体的参数设置和损失函数设计在实验中经过优化,以确保最佳性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MNL在数学推理、文本到SQL和交互代理基准测试中均表现出色,尤其在效率和效果上相较于现有记忆机制和上下文方法有显著提升,具体性能数据未详述,但整体表现被认为具有竞争力。

🎯 应用场景

该研究的潜在应用领域包括智能助手、自动化客服和复杂任务处理等场景。通过提升代理的自我学习能力,MNL能够在实际应用中实现更高的效率和准确性,推动智能代理的持续进化和优化。未来,MNL可能在更广泛的领域中发挥重要作用,促进人机协作的智能化进程。

📄 摘要(原文)

With the growing adoption of Large Language Model (LLM) agents in persistent, real-world roles, they naturally encounter continuous streams of tasks and inevitable failures. A key limitation, however, is their inability to systematically learn from these mistakes, forcing them to repeat identical errors in similar contexts. Unlike prior training-free methods that primarily store raw instance-level experience or focus on retrieving successful trajectories, we propose Mistake Notebook Learning (MNL), a novel memory framework that enables agents to self-curate generalizable guidance from batch-clustered failures. This mechanism allows agents to distill shared error patterns into structured "mistake notes," updating an external memory only when batch performance improves to ensure stability. To further amplify adaptability, we integrate MNL with test-time scaling, leveraging aggregated failure patterns to actively steer the search process away from known pitfalls. Experiments on mathematical reasoning, Text-to-SQL, and interactive agent benchmarks show that MNL achieves competitive performance compared to existing memory mechanisms and in-context methods in both effectiveness and efficiency. These findings position structured mistake abstraction as a critical lever for robust agent evolution, enabling continuous improvement without the cost of parameter updates. The code is available at https://github.com/Bairong-Xdynamics/MistakeNotebookLearning/tree/main.