CIP: A Plug-and-Play Causal Prompting Framework for Mitigating Hallucinations under Long-Context Noise

作者: Qingsen Ma, Dianyun Wang, Ran Jing, Yujun Sun, Zhenbo Xu

分类: cs.CL, cs.AI

发布日期: 2025-12-12

💡 一句话要点

CIP:一种即插即用的因果提示框架,用于缓解长文本噪声下的幻觉问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 因果推理 长文本处理 幻觉缓解 提示学习 大型语言模型

📋 核心要点

- 现有大语言模型在处理长文本时易受噪声干扰,产生幻觉,原因是模型倾向于学习虚假相关性。

- CIP通过构建因果关系序列并注入提示中,引导模型关注因果相关的证据,抑制非因果推理路径。

- 实验表明,CIP显著提升了模型在长文本处理中的推理质量、事实依据和效率,降低了响应延迟。

📝 摘要(中文)

大型语言模型在处理冗长且嘈杂的检索上下文时,常常会产生幻觉,这是因为它们依赖于虚假的相关性而非真正的因果关系。我们提出了CIP,一个轻量级的即插即用因果提示框架,旨在输入阶段缓解幻觉问题。CIP构建了实体、动作和事件之间的因果关系序列,并将其注入到提示中,以引导模型推理到因果相关的证据。通过因果干预和反事实推理,CIP抑制了非因果推理路径,从而提高了事实依据和可解释性。在包括GPT-4o、Gemini 2.0 Flash和Llama 3.1在内的七个主流语言模型上的实验表明,CIP始终如一地提高了推理质量和可靠性,在可归因率上提高了2.6个百分点,在因果一致性得分上提高了0.38,有效信息密度提高了四倍。API级别的分析进一步表明,CIP加速了上下文理解,并将端到端响应延迟降低了高达55.1%。这些结果表明,因果推理可能成为提高大型语言模型的可解释性、稳定性和效率的有希望的范例。

🔬 方法详解

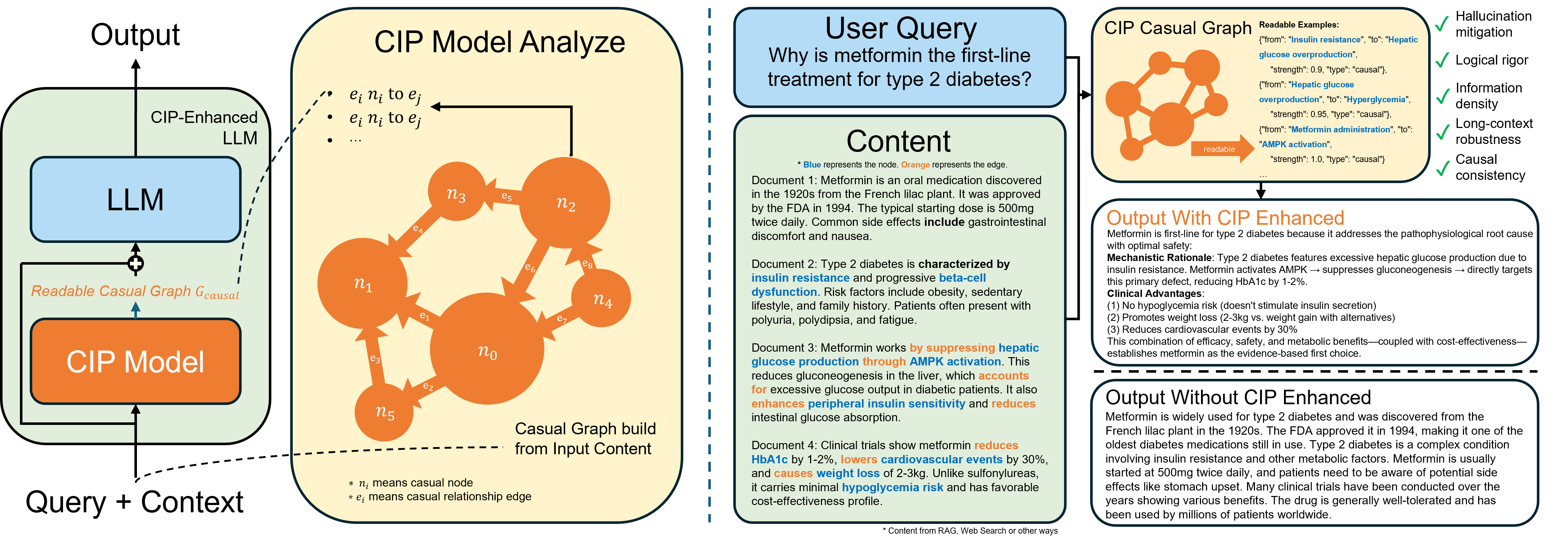

问题定义:论文旨在解决大型语言模型在处理包含噪声的长文本上下文时,容易产生幻觉的问题。现有的方法往往无法有效区分文本中的因果关系和相关关系,导致模型依赖于噪声信息进行推理,从而产生不准确或虚假的结果。这种幻觉问题严重影响了语言模型在实际应用中的可靠性和可信度。

核心思路:论文的核心思路是利用因果推理来引导语言模型关注文本中真正的因果关系,从而抑制模型对噪声信息的依赖,减少幻觉的产生。通过显式地构建和注入因果关系序列,模型可以更好地理解文本的深层含义,并进行更准确的推理。

技术框架:CIP框架主要包含以下几个阶段:1) 因果关系提取:从输入文本中提取实体、动作和事件,并构建它们之间的因果关系序列。2) 提示构建:将提取的因果关系序列注入到提示中,引导模型关注因果相关的证据。3) 因果干预:通过干预模型推理过程中的因果路径,抑制非因果推理路径。4) 反事实推理:利用反事实推理来验证模型的推理结果,并进一步提高模型的准确性。

关键创新:CIP的关键创新在于它是一种轻量级的即插即用框架,可以很容易地集成到现有的语言模型中,而无需对模型进行任何修改。此外,CIP通过显式地构建和注入因果关系序列,有效地引导模型关注因果相关的证据,从而显著提高了模型的推理质量和可靠性。与现有方法相比,CIP更加注重因果关系的建模和利用,能够更好地抑制噪声信息的干扰。

关键设计:CIP的关键设计包括:1) 因果关系序列的构建方法:论文提出了一种基于规则和统计的方法来构建因果关系序列。2) 提示注入策略:论文设计了一种有效的提示注入策略,可以将因果关系序列无缝地集成到提示中。3) 因果干预机制:论文提出了一种基于注意力机制的因果干预机制,可以有效地抑制非因果推理路径。具体的参数设置、损失函数和网络结构等技术细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

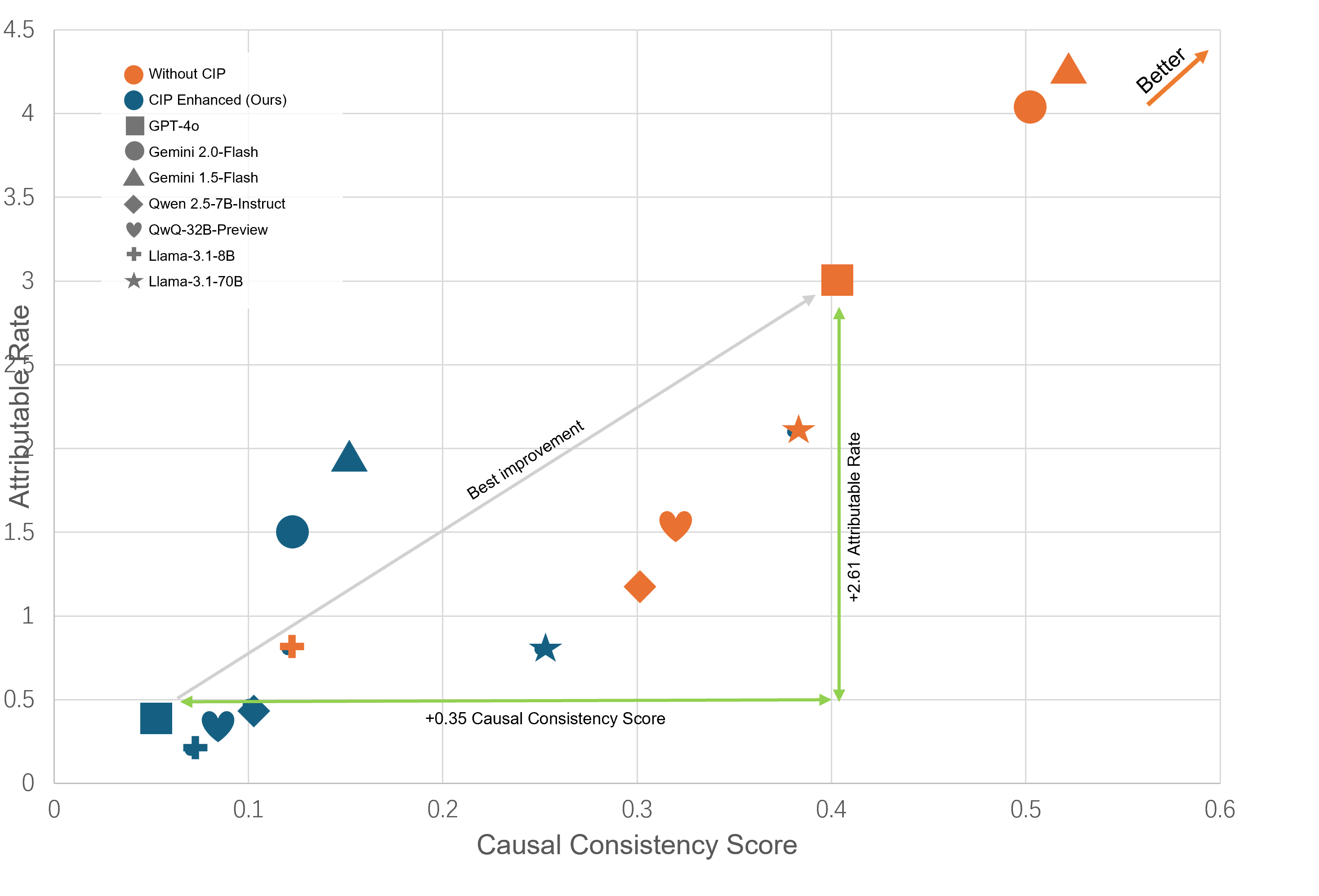

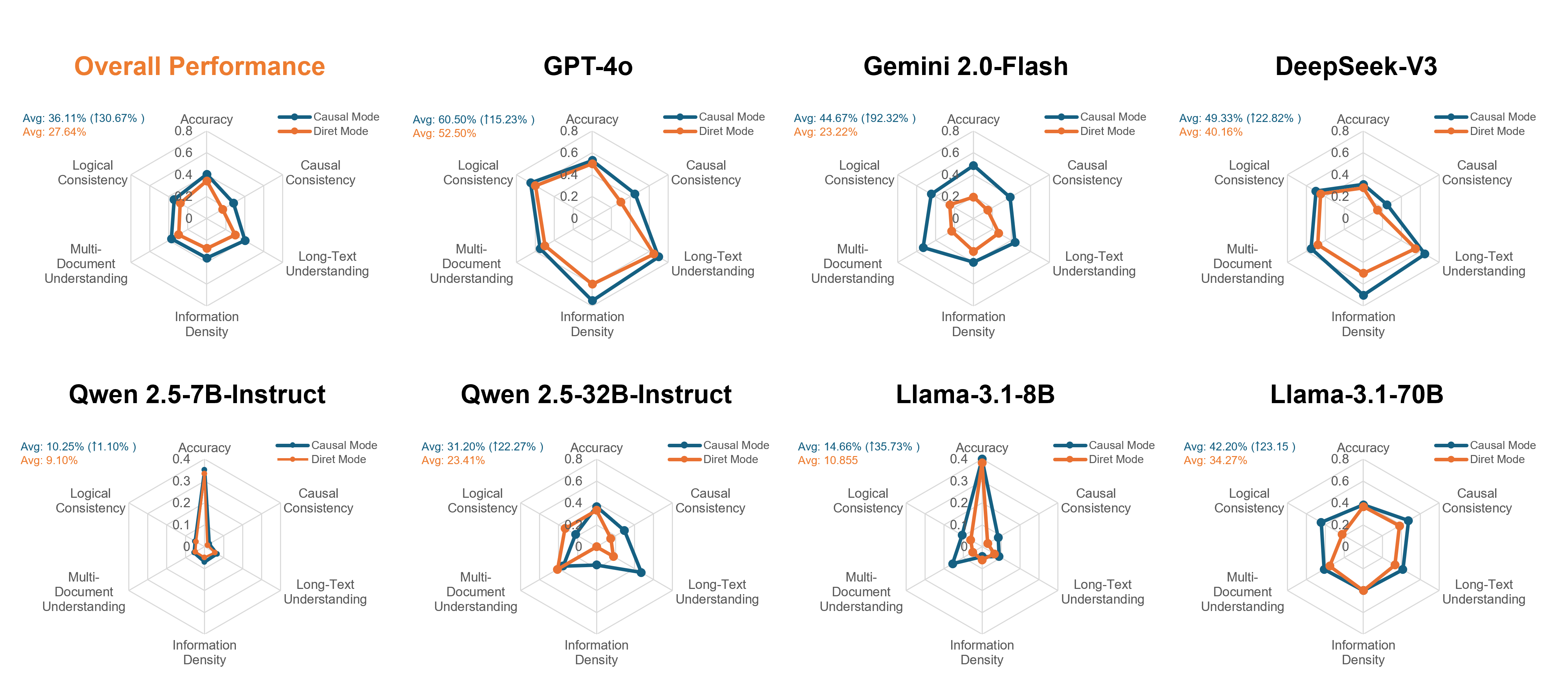

实验结果表明,CIP在七个主流语言模型上均取得了显著的性能提升。具体而言,CIP在可归因率上提高了2.6个百分点,在因果一致性得分上提高了0.38,有效信息密度提高了四倍。此外,API级别的分析表明,CIP加速了上下文理解,并将端到端响应延迟降低了高达55.1%。这些数据充分证明了CIP的有效性和优越性。

🎯 应用场景

该研究成果具有广泛的应用前景,可应用于问答系统、信息检索、文本摘要等领域。通过提高语言模型在长文本处理中的准确性和可靠性,可以提升用户体验,并为决策提供更可靠的依据。未来,该方法有望应用于更复杂的场景,例如医疗诊断、金融分析等,为这些领域提供更智能化的解决方案。

📄 摘要(原文)

Large language models often hallucinate when processing long and noisy retrieval contexts because they rely on spurious correlations rather than genuine causal relationships. We propose CIP, a lightweight and plug-and-play causal prompting framework that mitigates hallucinations at the input stage. CIP constructs a causal relation sequence among entities, actions, and events and injects it into the prompt to guide reasoning toward causally relevant evidence. Through causal intervention and counterfactual reasoning, CIP suppresses non causal reasoning paths, improving factual grounding and interpretability. Experiments across seven mainstream language models, including GPT-4o, Gemini 2.0 Flash, and Llama 3.1, show that CIP consistently enhances reasoning quality and reliability, achieving 2.6 points improvement in Attributable Rate, 0.38 improvement in Causal Consistency Score, and a fourfold increase in effective information density. API level profiling further shows that CIP accelerates contextual understanding and reduces end to end response latency by up to 55.1 percent. These results suggest that causal reasoning may serve as a promising paradigm for improving the explainability, stability, and efficiency of large language models.